简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

AI产品经理与传统PM的核心差异在于:AI PM需要聚焦目标定义、数据治理和效果评估,而非功能流程设计。转型AI PM需掌握三大核心能力:业务理解力(将需求转化为AI任务)、基础AI知识(Prompt工程、RAG等原理)以及数据工程能力(数据获取与合规)。学习路径分为认知破冰、技术概念掌握、产品设计方法和项目实战四个阶段。日常工作主要包括需求拆解、数据方案设计、Prompt优化和风险控制。简历应突

Skill 是 Hermes 从你的重复操作中自动提取的标准化流程,存储为 SKILL.md 文件。---name:"git-commit-helper"description:"标准化 Git 提交流程:暂存、审查、提交"triggers:-"提交代码"-"git commit"requires_toolsets:-"git"---## 流程1.运行gitstatus查看变更2.运行gitdif

文章摘要: Agentic AI项目面临高废弃率(超40%),核心挑战在于系统可靠性而非模型能力。文章剖析了多Agent协作的五大模式(如Anthropic的Workflow、OpenAI的Handoff机制)及六类典型失败原因(如上下文退化、工具调用失败等),提出三层防御策略:确定性护栏(硬性约束)、LLM评估(AI审查AI)和人类审批(高风险操作)。当前多Agent框架竞争激烈(如LangGr

AI产品开发中的RAG与LoRA技术选型解析 本文针对AI产品开发中的技术选型困境,深入分析了RAG(检索增强生成)与LoRA(低秩适应)两种技术的本质区别与应用场景。RAG通过外挂知识库解决"模型不知道"的问题,适合知识频繁更新、幻觉零容忍的场景;LoRA通过模型微调解决"模型不会说"的问题,适用于定制输出风格、严格格式要求的场景。文章提出了四项关键决策指标,并指出成熟产品应采用RAFT方案实现

本文通过三层金字塔模型解析AI应用架构:大语言模型(大脑)提供核心智能但存在知识盲区和被动性;多模态技术(感官四肢)扩展交互能力;联网知识库、工作流和智能体(骨骼工具)则解决大模型的局限性,使其成为主动工作的数字员工。文章强调理解这一底层逻辑对有效使用AI工具的重要性,并指出AI应用开发工程师是连接技术与业务的关键角色,其核心职责包括需求分析、技术适配、开发测试等,当前市场薪资最高达60k/月,凸

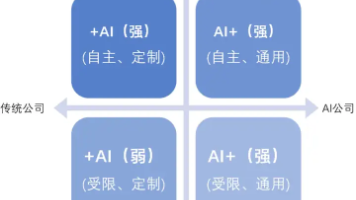

AI产品经理与通用型产品经理在产品生命周期管理上思路相似,但在思维模式、AI能力要求、使用群体和载体上存在显著差异。AI产品经理需要掌握AI场景、算法和数据理解等核心技能,并熟悉产品评价指标。成为AI产品经理需了解AI应用场景和技术,重视数据作用,参与产品全周期。建议新人多问、多做、多听,轮岗体验不同岗位。AI大模型应用开发工程师则是将AI技术转化为实用产品的关键角色,负责需求分析、技术选型、开发

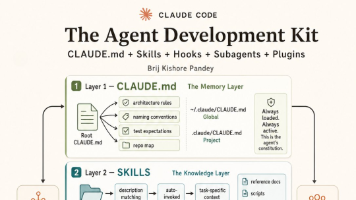

文章提出5层Agent架构解决LLM应用问题:CLAUDE.md规则层固化规范,Skills知识层按需加载,Hooks质量层硬性约束,Subagents任务层隔离执行,Plugins团队层协作分发。配合MCP Servers扩展工具边界和Agent Teams横向协作,该架构通过基础设施而非Prompt优化确保Agent行为一致性,是生产级系统的必要设计。

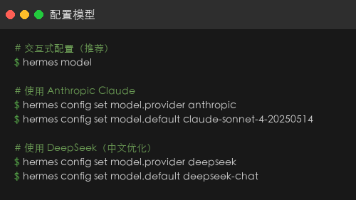

Hermes Agent 是由 Nous Research 开源的 AI Agent 框架。它不是那种"问一句答一句"的普通 AI 助手——它能记住你是谁、你的偏好、你的工作环境,而且越用越聪明,可以自主进化。它能执行代码、操作文件、浏览网页它能记住你上次聊了什么,不用每次重新介绍自己它能定时执行任务,即使你不在电脑前它能同时出现在你的 Telegram、Discord、Slack、微信等 10+

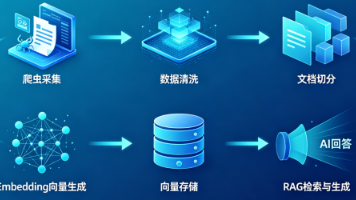

企业AI Agent落地的核心在于构建高质量私有知识库,需满足真实性、时效性、可控性、语义完整性和持续进化五大要求。知识库建设分为六个关键阶段:精准采集高价值数据、严格清洗预处理、语义化文档切分、向量生成存储、多阶段检索优化。其中数据采集和清洗环节决定知识库质量上限,需投入50%以上精力。运营层面强调增量更新、质量闭环和权限管理。建议企业从小规模核心知识起步,采用技术+业务+运营的三维驱动模式,通

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应