简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

大语言模型(Large Language Models,LLM)是一种由包含数百亿以上权重的深度神经网络构建的语言模型,使用自监督学习方法通过大量无标记文本进行训练。自2018年以来,包含Google、OpenAI、Meta、百度、华为等公司和研究机构都纷纷发布了包括BERT, GPT等在内多种模型,并在几乎所有自然语言处理任务中都表现出色。2021年开始大模型呈现爆发式的增长,特别是2022年1

我们处在一个信息过载,而并非信息匮乏的时代。只有提高 AI 生产信息的质量,才能真正减少人类阅读、筛选信息的成本,解放生产力。做足够好的 PDF Parser ,准确提取文档中的文本、表格等数据,按照知识单元进行存储,是问答的基础。基于规则的文档切分效果有限,深度学习模型具有更强的文档理解能力。做足够好的 Embedding 模型,进行向量化表示,计算文本语义相似度,实现问题与答案的准确匹配。采用

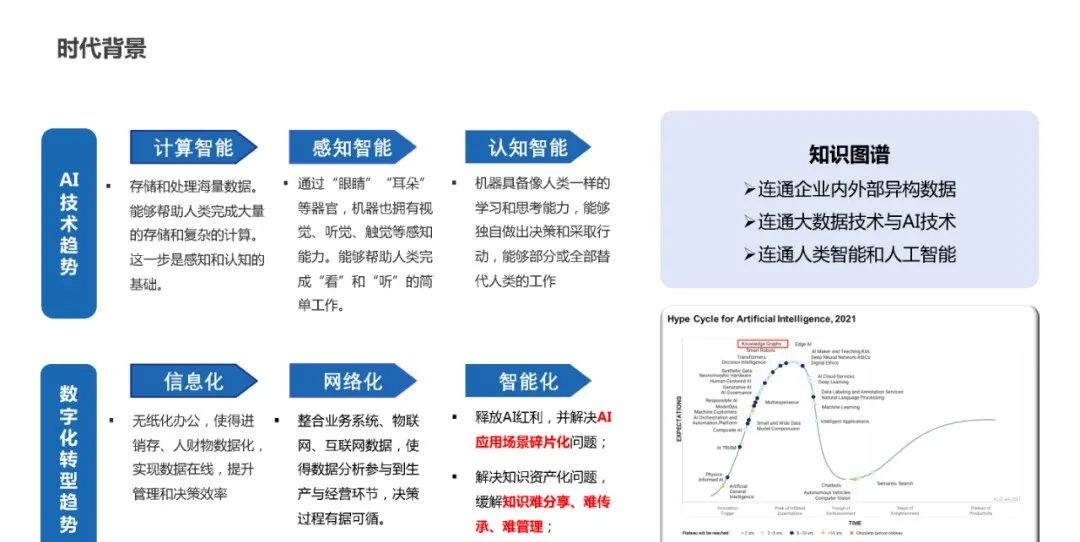

知识图谱构建过程是一个人机结合的不断迭代过程,以机器自动学习为主、专家定义与修正结合。需要人工介入的工作包括Schema定义、部分结构化知识准备、机器学习结果校验,依据用户的反馈、语料的增加与更新,不断进行模型的更新与迭代。专业领域的知识图谱已经构建完成,在其具备的特有应用形态,与领域数据和业务场景相结合后,将实际助力企业在该领域取得实际的商业价值。现今知识图谱在很多行业中都有了成功的应用。

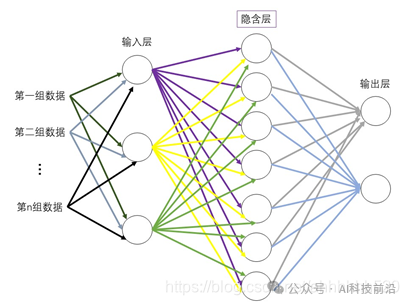

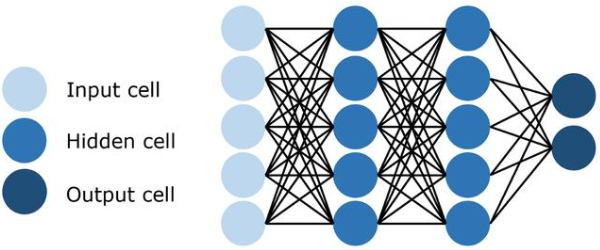

现在大语言模型变化很快,隔一小段时间就有很多新动态,普通人看的眼花缭乱。虽然大模型变化很快,但背后的技术原理变化不快,了解背后原理有益于我们快速理解和预知大模型的变化。因此,笔者计划开展系列讲解,将所学内容给大家做分享呈现,希望能够共同进步。深度神经网络(Deep Neural Networks,DNNs)是近年来人工智能领域在大模型上取得重大突破的关键技术之一。神经元(Neuron):神经元是神

现在大模型微调的门槛越来越低,市场上有大量开源微调框架。只要你会部署、有机器就能出个结果,赶紧动手玩起来吧!读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用如果你是零基础小白,想快速入门大模型是可以考虑的。一方面是学习时间相对较短,学习内容更全面更集中。二方面是可以根据这些资料规划好学习计划和方向。包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学

学了那么久的AI Agent的概念了,是时候该落地一个Agent看看自己的掌握程度了对不对,我们都理解大脑是自动节能的,但是知识的确需要倒逼自己一把才能真的掌握,不瞒大家说,笔者对于真正落地一个Agent一直有规划,但是就是苦苦没有动手,要么觉得没掌握什么知识要么觉得什么理解的还不够,说白了就是懒…虽然百炼上还是有一些操作不太丝滑的地方,但是不影响最后的效果,学了这么久的Agent,终于成功的落地

作为一名软件工程师,我们应该活到老学到老,时刻与不断发展的框架、标准和范式保持同步。同时,还要能活学活用,在工作中使用最合适的工具,以提高工作效率。随着机器学习在越来越多的应用程序中寻得了一席之地,越来越多的程序员加入 AI 领域,那么,入行 AI 领域需要哪些技能呢?①人工智能/大模型学习路线②AI产品经理入门指南③大模型方向必读书籍PDF版④超详细海量大模型实战项目⑤LLM大模型系统学习教程⑥

随着人工智能(AI)技术的迅猛发展,尤其是大规模预训练模型(如GPT-4、BERT等)的出现,程序员迎来了一个前所未有的机会窗口。AI不仅能提高开发效率,还能为程序员提供创新创业的机会。本文将探讨程序员如何利用AI大模型实现逆袭。

基于这篇关于量子计算的长文,生成一个不超过 100 字的摘要,突出其对加密技术的潜在影响。清晰指定了摘要长度和需强调的信息点,有利于 AI 提取核心内容,生成精确摘要。“摘要这篇文章。未给出摘要长度限制和重点信息提示,可能导致摘要内容散乱,缺乏针对性。文本生成摘要Prompt 提示词的设计是一门平衡艺术,它既要求精确明确,又需留有创意空间。掌握编写高效 Prompt 的技巧,对于提升 AI 辅助工

人工智能是指通过模拟、延伸人类智能的机制,使机器能够执行需要智力的任务。这包括理解语言、学习、推理、问题解决等能力。人工智能系统通过算法和模型从大量数据中学习,并能够做出智能决策。人工智能的核心在于算法和模型,这些算法和模型能够处理、分析和解释数据,以模拟人类的智能行为。通过不断的学习和优化,人工智能系统能够逐渐提升其性能,以更好地完成各种任务。概念:机器学习是人工智能的一个重要分支,其核心思想是