简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

最近对大模型这部分内容比较感兴趣,作者最早接触大模型是22年下半年的时候。当时觉得非常amazing,并认为这是一个颠覆性的工作,目前随着开源大模型的逐渐变多。我觉得我们得学习并了解这些基础知识,以便后续在工作中可以学习并使用。在深度学习中,微调是一种重要的技术,用于改进预训练模型的性能。除了微调ChatGPT之外,还有许多其他预训练模型可以进行微调。微调所有层:将预训练模型的所有层都参与微调,以

随着各厂商相继发布大型模型,排行榜变化频繁,新旧交替,呈现出一片繁荣景象。有些技术爱好者也开始心痒难耐,萌生了构建一个庞大模型并进行训练的想法。每天都能看到各个厂家推出内测版本,这让人不禁思考:为何不在本地环境尝试一番呢?然而,当前手头仅有一块性能有限的老破小GPU显卡,这就引发了一个问题:如何在这样的条件下成功运行模型?

随着科技的飞速发展,人工智能已经逐渐渗透到各行各业,为许多领域带来了翻天覆地的变化。。华为作为全球领先的科技企业,一直致力于将人工智能技术应用于医药领域,推动传统医学与现代科技的深度融合。其中,华为中医药大模型便是其在这一领域的重要成果之一。。这一天,浙江九为健康科技股份有限公司与华为云计算技术有限公司在华为深圳总部签署了中医药大模型全面深化合作协议,共同推出了这一创新性的中医药大模型。该模型的出

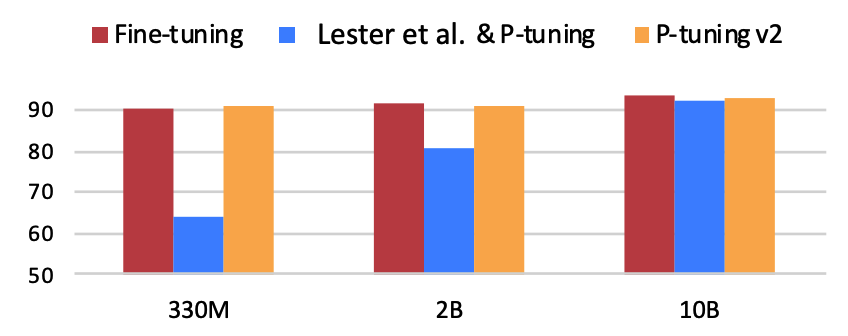

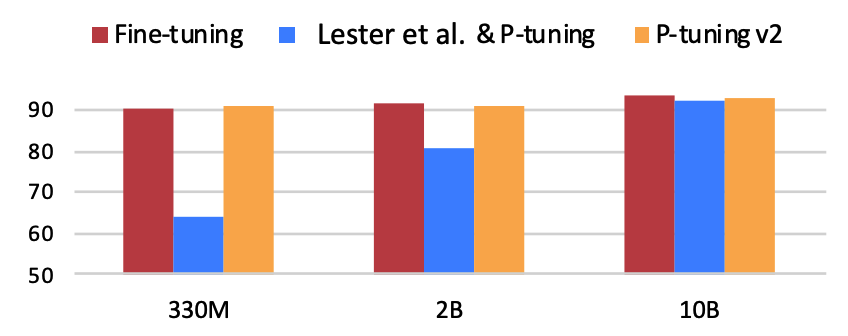

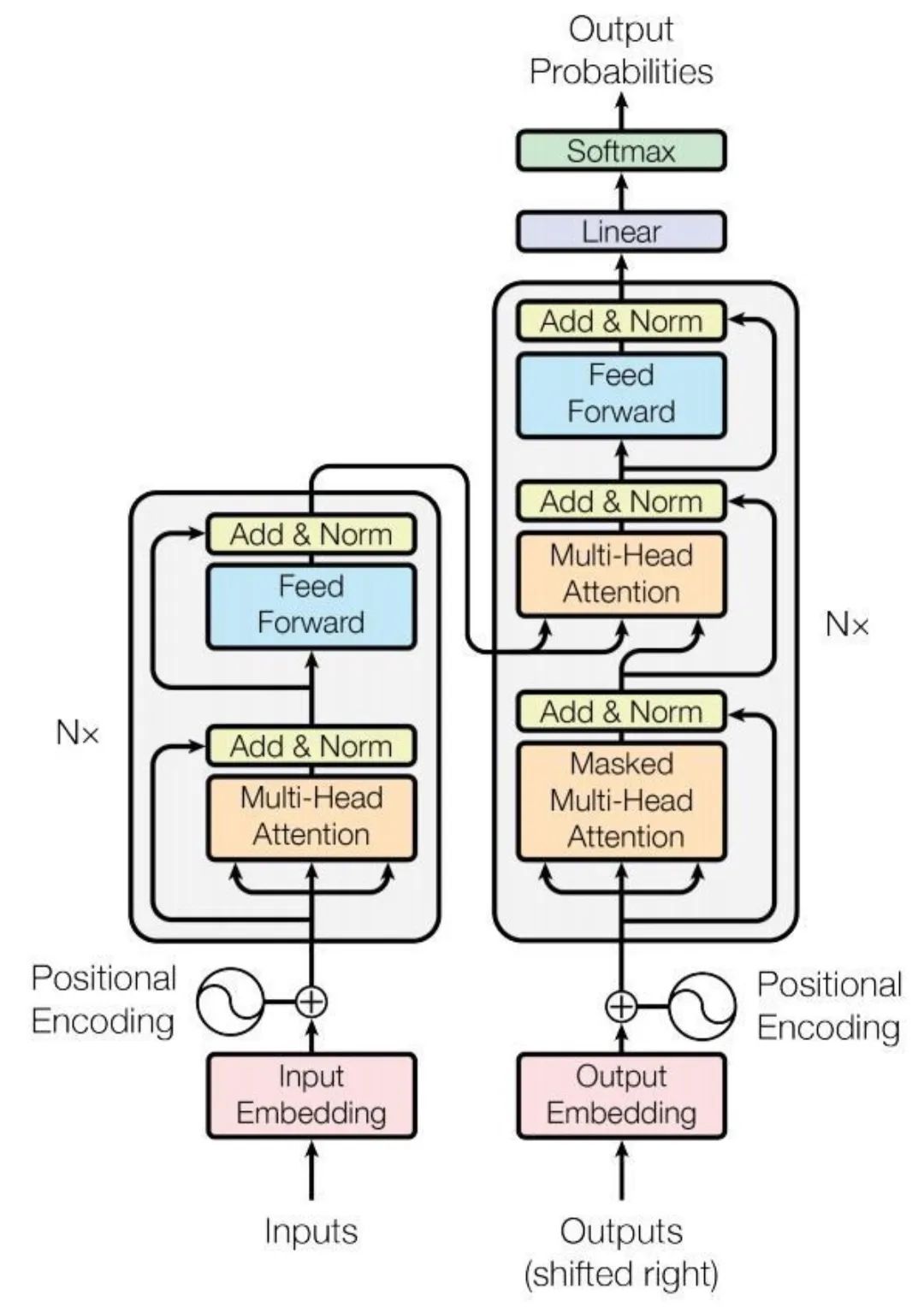

自2018年BERT发布以来,“预训练+微调”成为语言模型的通用范式。以ChatGPT为代表的大语言模型针对不同任务构造Prompt来训练,本质上仍然是预训练与微调的使用范式。千亿规模的参数微调需要大量算力,即使提供了预训练的基座模型,一般的研究机构也很难对其进行全量微调(即对所有参数进行微调)。为了应对这个问题,相关学者提出了PEFT(Parameter-Efficient Fine-Tunin

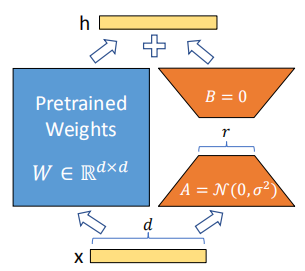

在本文中,我们探讨了 LoRA 微调方法,并以 StarCoder 模型的微调为例介绍了实践过程。通过实践过程的经验来为大家展示一些细节及需要注意的点,希望大家也能通过这种低资源高效微调方法微调出符合自己需求的模型。。

LangChain 的作者是 Harrison Chase,最初是于 2022 年 10 月开源的一个项目,在 GitHub 上获得大量关注之后迅速转变为一家初创公司。2017 年 Harrison Chase 还在哈佛上大学,如今已是硅谷的一家热门初创公司的 CEO,这对他来说是一次重大而迅速的跃迁。Insider 独家报道,人工智能初创公司 LangChain 在种子轮一周后,再次获得红杉领投

随着各厂商相继发布大型模型,排行榜变化频繁,新旧交替,呈现出一片繁荣景象。有些技术爱好者也开始心痒难耐,萌生了构建一个庞大模型并进行训练的想法。每天都能看到各个厂家推出内测版本,这让人不禁思考:为何不在本地环境尝试一番呢?然而,当前手头仅有一块性能有限的老破小GPU显卡,这就引发了一个问题:如何在这样的条件下成功运行模型?

大型语言模型(LLM)正在给各个行业带来革命性的变化。从客户服务聊天机器人到复杂的数据分析工具,这项强大技术的能力正在重塑数字交互和自动化的格局。然而,LLM的实际应用受到需要高性能计算硬件环境的限制。这些模型通常需要复杂的硬件和广泛的依赖关系,这使得在更受约束的环境中采用它们变得困难。而LLaMa.cpp 正是为了解决这个问题而诞生。LLaMa.cpp由Georgi Gerganov开发,它在高

本篇文章深入分析了大型模型微调的基本理念和多样化技术,细致介绍了LoRA、适配器调整(Adapter Tuning)、前缀调整(Prefix Tuning)等多个微调方法。详细讨论了每一种策略的基本原则、主要优点以及适宜应用场景,使得读者可以依据特定的应用要求和计算资源限制,挑选最适合的微调方案。大型语言模型(LLM)的训练过程通常分为两大阶段:阶段一:预训练阶段在这个阶段,大型模型会在大规模的无

最近对大模型这部分内容比较感兴趣,作者最早接触大模型是22年下半年的时候。当时觉得非常amazing,并认为这是一个颠覆性的工作,目前随着开源大模型的逐渐变多。我觉得我们得学习并了解这些基础知识,以便后续在工作中可以学习并使用。在深度学习中,微调是一种重要的技术,用于改进预训练模型的性能。除了微调ChatGPT之外,还有许多其他预训练模型可以进行微调。微调所有层:将预训练模型的所有层都参与微调,以