简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

为了更直观地理解 HCCL 是如何维护通信状态的,以下展示了 HCCL 内部用于管理一个通信域(Communicator)的核心数据结构定义。这是驱动层维护全局拓扑视图的关键。

说实话,在体验星云之前,我对「数字人」这个品类是持怀疑态度的。之前接触的数字人产品,无一例外都是「看起来很酷,用起来很蠢」——延迟高、对话假、交互生硬,更像是技术 demo 而非可用的产品。星云让我改变了这个看法。真正打动我的不是某个单一技术点,而是「端到端」带来的体验质变。AI 端渲与端侧解算解决了延迟问题,一体化管线解决了口型同步问题,Agent 认知层解决了对话能力问题——当这些环节不再是拼

2026年4月16日,Anthropic正式发布Claude Opus 4.7。Opus 4.7定价与 Opus 4.6持平,但新版分词器可能导致实际输入消耗的token增长0%-35%。另外,由于思考强度也比4.6高,也会耗费更多输出token。所以在实际体验上,Opus 4.7的总体成本会高一些。本指南将详细介绍Claude Opus 4.7的使用方法、实际发生了哪些变化,以及如何将它的新功能

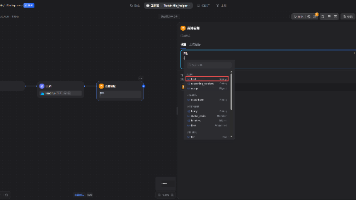

总体来看,Nexent 在智能体构建方面提供了一条比较清晰的路径,从模型配置到能力扩展,都可以通过平台完成,整体上手成本较低。对于初学者来说,可以快速完成从“想法”到“可用智能体”的转化,在实际体验中也能感受到平台在效率和易用性上的优势。当然,从更深入的使用角度来看,平台在一些细节上还有提升空间,比如部分配置逻辑不够直观,功能增多后理解成本会有所上升,在复杂场景下仍需要一定的调优经验。不过整体而言

在 ModelEngine 平台上,我们从零开始完成了一个智能体的创建,通过简单配置模型信息、提示词和业务逻辑,快速搭建出了一个可用的旅游助手。整个过程不需要复杂开发,只需围绕需求进行基础设置,即可实现从用户输入到结果输出的完整闭环。整体来看,这种方式门槛低、上手快,非常适合用来快速验证想法或构建简单实用的智能应用,也是新手入门智能体开发的一种高效路径。

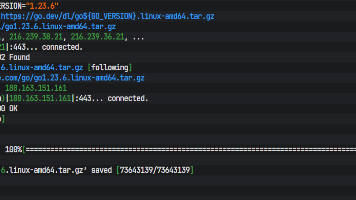

在云计算与微服务架构日益复杂的当下,传统的基于静态阈值的服务器监控系统正面临严峻挑战。海量的告警噪音与滞后的故障定位能力,促使运维体系向 AIOps(人工智能运维)转型。本文将详细阐述如何利用高性能的 Go 语言结合 DeepSeek 大语言模型,从零构建一个具备智能分析能力的服务器监控探针。我们将深入探讨 Linux 内核信息采集机制、Go 语言并发编程模式以及大模型 API 的工程化集成。本文

在现代软件工程中,图形用户界面(GUI)虽占据主导地位,但终端用户界面(TUI, Text User Interface)凭借其低资源占用、高响应速度及对键盘操作的极致优化,在开发者工具与服务器运维领域依然保持着不可替代的地位。本文将深度剖析如何利用 Go 语言及其生态中的 Charmbracelet 库,构建一个功能完备、界面现代化的 AI 对话终端应用。

在现代软件工程中,图形用户界面(GUI)虽占据主导地位,但终端用户界面(TUI, Text User Interface)凭借其低资源占用、高响应速度及对键盘操作的极致优化,在开发者工具与服务器运维领域依然保持着不可替代的地位。本文将深度剖析如何利用 Go 语言及其生态中的 Charmbracelet 库,构建一个功能完备、界面现代化的 AI 对话终端应用。

在文本智能领域,非结构化数据的精准解析与结构化转化是实现 AI 应用落地的核心环节。随着大语言模型技术的演进,如何高效处理复杂的 PDF 文档、图片报表并提取其中的深度价值,已成为开发者关注的重点。本文聚焦于基于合合信息旗下 TextIn “大模型加速器”与火山引擎豆包大模型的集成实践,详细展示在 Dify 平台中构建自动化文档处理工作流的技术路径。TextIn 凭借其高精度的 OCR 解析能力与

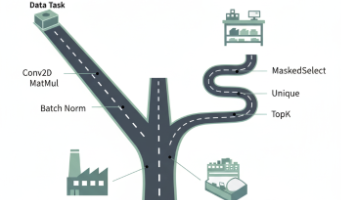

在昇腾CANN算子开发的旅程中,我们的目光往往聚焦于AI Core(Da Vinci核心)的极致性能——我们学习Tiling、流水线、向量化,旨在榨干其强大的张量计算能力。将AI Core的性能优化技艺与AI CPU的灵活编程能力相结合,你将成为一名能够驾驭整个异构计算平台的、真正的全栈AI系统工程师。它让我们明白,昇腾NPU的强大,不仅在于AI Core的磅礴算力,更在于异构单元之间协同工作的智