简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

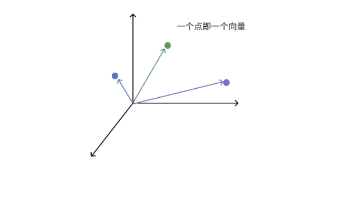

首先我们要知道,嵌入的结果是就是一个向量,它本质上是一个数字列表(一维数组)。例如:嵌入结果得到的列表长度是固定的,称为向量的“维度”。例如,OpenAI 的 text-embeddingada-002 模型会生成一个 1536 维的向量, text-embedding-3-large 模型会生成一个 3072 维的向量。维度越高,通常能捕捉更细微的语义信息,但也需要更多的计算和存储资源。想象一个

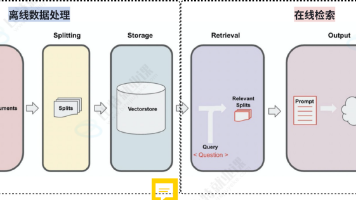

你已经用 PyPDFLoader 把 PDF 加载成了 Document 对象。一个 Document 可能包含一整页甚至整个文件的文本。直接拿整个文档去检索有三大问题:文本分割器的任务就是:把大文档切成小块,每块语义相对完整,大小可控。一个 Document(整篇 MD 文件)│▼文本分割器│N 个 Document(每个小块都是一个 Document,保留原始 metadata)我们已经知道可

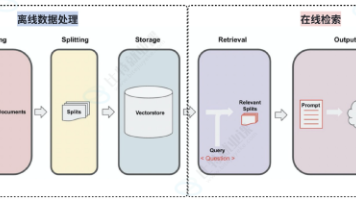

我们将重点放在 RAG 阶段(Retrieval-Augmented Generation,检索增强生成)。这是当前大语言模型应用的核心模式。RAG 的流程相对复杂,为了更好的理解 RAG,我们先用 AI 搜索来引出 RAG。• 对于【AI 大模型】来说,它最擅长的是语义理解和文本总结,最不擅长的就是获取实时的信息。因为大模型的训练数据是有截止日期的!• 对于【搜索引擎】来说,它最擅长的就是获取实

快速简单的解释一下输出解析器到底解决什么问题:每次都要 .content 很烦,而且如果你想把模型输出传给下一个环节(比如存入数据库),你需要的是纯字符串。

快速简单的解释一下输出解析器到底解决什么问题:每次都要 .content 很烦,而且如果你想把模型输出传给下一个环节(比如存入数据库),你需要的是纯字符串。

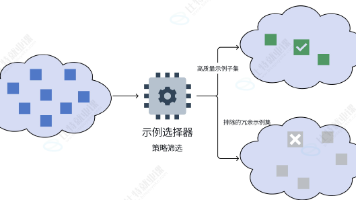

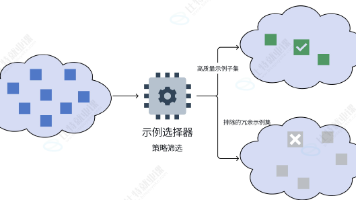

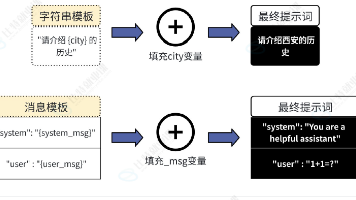

我要让模型学会什么任务?然后用一个列表,把“输入→输出”的例子写出来。python{"input": "用户会说的话", "output": "模型应该回答的话"},为什么先做这一步?因为示例是少样本提示的灵魂。你的示例质量,直接决定了模型学得好不好。花时间打磨示例,比改代码更重要。用一个每个示例应该按什么格式转换成聊天消息?python("user", "{input}"),# 用户角色,取示例

我要让模型学会什么任务?然后用一个列表,把“输入→输出”的例子写出来。python{"input": "用户会说的话", "output": "模型应该回答的话"},为什么先做这一步?因为示例是少样本提示的灵魂。你的示例质量,直接决定了模型学得好不好。花时间打磨示例,比改代码更重要。用一个每个示例应该按什么格式转换成聊天消息?python("user", "{input}"),# 用户角色,取示例

每条消息都有一个角色和内容,以及因 LLM 的不同而不同的附加元数据。:用来区分对话中不同类型的消息,并帮助聊天模型了解如何响应给定的消息序 列。表示多模态数据 (例如,图像、音频、视频)的消息文本或字典列表的内 容。内容的具体格式可能因底层不同的 LLM 而异。目前,大多数模型都支持文本作为主要内容类 型,对多模态数据的支持仍然有限。• 消息其他元数据 (Additional metadata)

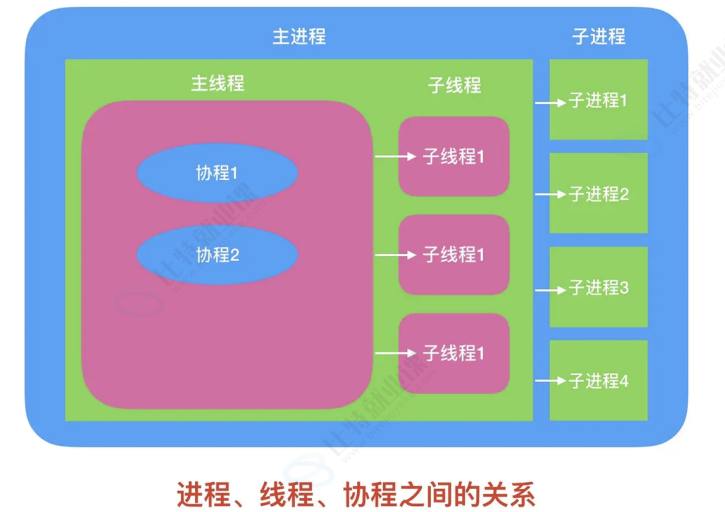

• 多进程通常利用的是多核 CPU 的优势,同时执行多个计算任务。每个进程有自己独立的内存管 理,所以不同进程之间要进行数据通信比较麻烦。• 多线程是在一个 cpu 上创建多个子任务,当某一个子任务休息的时候其他任务接着执行。多线程 的控制是由 python 自己控制的。线程存在数据同步问题,所以要有锁机制。• 协程的实现是在一个线程内实现的,相当于流水线作业。由于线程切换的消耗比较大,所以对于

大语言模型 (LLM) 在各种与语言相关的任务(例如文本生成、翻译、摘要、问答等)中表现出色。现代 LLM 通常通过聊天模型接口访问,该接口将消息列表作为输入,并返回消息作为输出,而不是使 用纯文本。LLM 与 LangChain 中 聊天模型 的关系:• 在 LangChain 的官方文档中,认为 LLM 大多数是纯文本补全模型。这些纯文本模型封装的 API 接 受一个字符串提示作为输入,并输出