智体世界建模:基础、能力、法则及展望(下)

26年4月来自港科大、新加坡国立、牛津、南阳理工、港中文、港大、西雅图华盛顿大学和港科大(广州)等10单位的综述论文“Agentic World Modeling: Foundations, Capabilities, Laws, and Beyond”。随着AI系统从单纯的文本生成向通过持续交互实现特定目标演进,对环境动态进行建模的能力正成为一个核心瓶颈。无论是操纵物体、在软件界面中导航、与其他

26年4月来自港科大、新加坡国立、牛津、南阳理工、港中文、港大、西雅图华盛顿大学和港科大(广州)等10单位的综述论文“Agentic World Modeling: Foundations, Capabilities, Laws, and Beyond”。

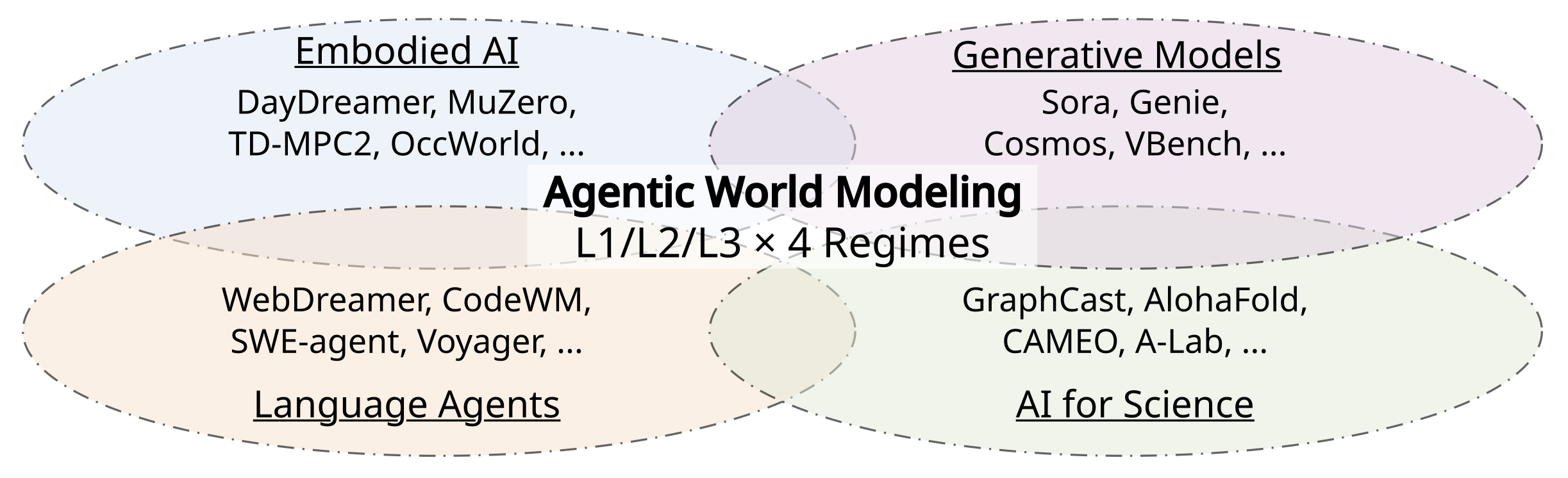

随着AI系统从单纯的文本生成向通过持续交互实现特定目标演进,对环境动态进行建模的能力正成为一个核心瓶颈。无论是操纵物体、在软件界面中导航、与其他智体协同工作,还是设计科学实验,各类智体(Agents)都需要具备预测环境动态的能力,然而,“世界模型”(World Model)这一术语在不同的研究社区中却有着各异的内涵。为此,提出一套基于“层级 × 规律”双轴维度的分类体系。第一条轴线定义三种能力层级:L1 预测器(Predictor),负责学习单步局部的状态转移算子;L2 模拟器(Simulator),能够将这些算子组合成受动作序列驱动的多步演化过程,且该过程严格遵循特定领域的内在规律;L3 演化器(Evolver),具备自主修正自身模型的能力,即当其预测结果与新获取的证据相悖时,能够对模型进行自适应的修订。第二条轴线则划定四类主导性规律(governing law)领域(物理、数字、社会及科学),这些领域决定世界模型必须满足哪些约束条件,以及在何种情境下最容易发生预测失效。

基于这一分类框架,对400余项相关研究成果进行综合梳理,并归纳总结100多个具有代表性的系统案例,其应用范围涵盖基于模型的强化学习、视频生成、Web与GUI交互智体、多智体社会仿真,以及AI驱动的科学发现等诸多前沿领域。针对不同的“层级—规律”组合,深入剖析各类建模方法、潜在的失效模式以及相应的评估范式;同时,提出一套以决策能力为核心的评估原则,并构建一个旨在确保评估结果可复现性的最小化评估工具包;此外,还对世界模型的架构设计提供指导性建议,并指出当前尚待解决的开放性难题及相关的治理挑战。

。。。。。。继续。。。。。。

科学发现的本质结构是一个循环:研究人员设计实验、执行实验、观察结果,并进行反思以指导下一步行动。近期的各类系统虽然实现了这一过程中的一个或多个环节,但许多系统并未实现完全自主的闭环运作。决策模拟器主要作用于“设计”环节:它们模拟实验结果并更新信念,但所有的更新操作均局限于既定的信息范畴内,并不涉及主动的数据收集。而在另一端,基于强化学习(RL)的自反思系统(如 VL-Rethinker [Wang et al., 2025c])通过显式的“验证与重思”行为实现“反思”环节,但它们并未维护一个持续演进的“世界模型”栈。许多自动化研究流程(Yang et al., 2024c; Li et al., 2024c)虽然将“设计”与“反思”(即假设生成与文献综合)环节串联起来,却缺失能够构成完整闭环所需的“执行”与“观察”环节。

L3 系统的核心特质,在于其获取与利用新信息的方式。L3 系统并非被动地拟合输入数据,也非仅仅利用固定的模型进行规划;相反,它会主动设计干预措施,旨在降低其自身“世界模型”中的不确定性。在上文图 7 所示的统一视图中,这种模型修订过程由那支垂直向下的“反思”箭头所表征——该箭头连接着上层模块(即作用于环境 X 的模型 M_t)与下层模块(即作用于“有效环境”X’ 的修订后模型 M_t+1):循环过程中的每一次迭代,都会对 L2 系统据以展开运作的“潜图谱”进行修正。循环过程的每一次迭代都致力于消弭预测结果与实际观测结果之间的差异,并利用这些差异来优化模型参数、扩展模型结构,乃至修正底层的基本假设。从这一意义上讲,L3 系统的驱动力并非单纯的“奖励最大化”,而是通过在无数次“设计—执行—反思”的循环迭代中不断积累证据,从而系统性地降低模型的不确定性。

元学习范式——尤其是其中的“学会学习”(Learning to Learn)理念 [Andrychowicz et al., 2016]——将优化器本身的设计视为一个学习任务,这一理念已然预示上述的“自我修订”能力:系统不再仅仅局限于拟合数据,而是能够对其自身的学习流程进行优化与改进。L3 系统将这一核心原理进一步拓展,使其应用范围从单纯的参数优化延伸至了对“世界模型”本身的修订。其结果为下一阶段的世界建模树立一个典范:即那些不仅能够进行模拟,还能自主演化的系统,它们具备持续学习和自我修正的能力。在智体(Agent)的语境下,这意味着智体的世界模型不再是一个仅在推理阶段被动调用的静态产物;相反,它演化为一个充满好奇心的“鲜活”组件——它能诊断自身的失效点,设计针对性的实验以消除不确定性,并将由此获得的证据提炼转化为对模型的持久性更新。这种能够自我演化的智体标志着一种质的飞跃:从L2阶段(模型仅作为规划的固定工具)跃升至L3阶段(模型本身成为持续改进的对象,且改进过程由其自身的部署实践所驱动)。

1 形式化定义

L3阶段将L2阶段的能力(即在既定信息框架内的模拟)进一步扩展,使其具备基于证据进行闭环式模型修正的能力。简而言之,L3系统的核心特征在于实现完整的“设计—执行—观察—反思”闭环流程;在此流程中,系统会主动获取新的证据,并在迭代过程中利用这些证据来挑战并修正现有的模型。

从形式上定义,一个L3系统维护并持续更新着一个“世界建模栈”:

设计 → 执行 → 观察 → 反思

M_t → a_t → o_t → d_t → M_t+1

其中,M_t 代表在第 t 次迭代时系统的当前世界建模栈;a_t 代表系统所设计并执行的实验或动作;o_t 代表由此产生的原始观测结果;而 d_t 则代表经过提炼后、用于更新该建模堆栈的证据(参见图 9所示)。

至关重要的是,仅仅具备上述闭环结构尚不足以确立其L3系统的地位。L3系统的独特之处在于:它能将所获取的证据转化为对模型的持久且可复用的更新——这些更新必须通过回归测试的验证——而非仅仅停留在瞬时性的、仅在当前情境下生效的局部调整层面。在此模式下,模型本身已然升格为系统改进的核心对象,而不再仅仅充当规划任务的固定基础架构。

这一形式化表述与科学研究的实践结构有着极高的契合度。我们可以将一个科学共同体视为一个L3系统,该共同体围绕着一个共享的“模型”M_t(即当前公认的世界模型)展开运作;这一模型由既定的理论体系与已知的反常现象共同构成。在“常态科学”(Kuhn, 1962)的范式下,该科学共同体通过一系列渐进式的修正手段,持续地将模型从 M_t 更新至 M_t+1,而在这一过程中,作为基础的模型类别(或理论框架)本身则得以维系不变。当累积的异常超出现有模型的解释能力时,同样的更新过程便会引发一场更为重大的转变——在此过程中,模型 Mt 本身的结构会被修正,从而对应于一种“范式转换”。依此观之,无论是渐进式的完善还是范式转换,本质上都是同一类由证据驱动的更新过程的体现,二者仅在规模上有所差异。

在实际应用中,L3 系统的瓶颈通常不在于生成候选修复方案,而在于如何安全地对这些方案进行验证。多模态评论(critic)模型(Zhang et al., 2025b)以及基于回归门控的更新流水线(Ren et al., 2026; Jimenez et al., 2024; Yang et al., 2024a),为“观察”与“反思”阶段提供实用的基础架构。引用这些系统,并非将其视为完整的 L3 级范例,而是将其视为演化器设计空间中的组成部分——前提是,持久化的更新与验证机制已然就位。

修订触发机制与演化策略。反思阶段(reflect stage)负责决定何时以及如何对世界模型进行修订,特别是要区分“增量改进”与“结构性变革”。在实践中,这一决策主要由两类信号驱动。所谓“异常”(anomaly),是指预测结果与观测结果之间存在的不一致。虽然许多异常可以通过局部调整来消解,但那些在当前模型类别框架内无法得到解决的持续性异常,往往揭示了一种“认知鸿沟”(epistemic gap),表明模型底层的表征方式或假设空间存在不足。弥合此类鸿沟通常需要对模型进行结构性变革,这相当于一种“范式转换”。若套用第2.1节中的哲学框架,那些可被消解的异常对应于拉卡托斯(Lakatos)理论中“保护带”(即模型的可学习参数)内部的调整;而那些暴露了认知鸿沟的持续性异常,则要求对模型的“硬核”(即架构设计与归纳偏置)进行修改。从操作层面来看,这引发了一套层级式的响应机制:微小的异常通过单次交互周期(episode)内的在线自适应来处理;持续性的异常则触发参数更新,并将更新结果整合(distill)进模型之中;而认知鸿沟则要求进行结构性修改,例如引入新的模块或扩展模型的假设空间。杜恒-奎因(Duhem–Quine)整体论(见第2.1节)强调指出,这种归因过程本质上是具有模糊性的:预测与观测之间的不一致往往可以归因于模型的多个组成部分,包括表征方式、动力学机制或辅助性假设等。因此,要准确判定某一异常究竟可以通过当前模型类别内的局部更新来解决,还是反映了某种需要通过底层表征结构性变革才能弥合的深层认知鸿沟,绝非易事。

这种判定上的困难,在很大程度上还取决于所选取的表征方式。认知鸿沟往往源于模型中缺失某些归纳偏置或不变性(invariances),抑或是对这些要素的设定存在偏差。尽管从理论上讲,此类鸿沟可以通过对已学习模型进行结构性修改来弥合,但这种修改通常是间接且非直观的:单纯调整模型架构或训练流程,并不能保证模型所捕捉的底层不变性会随之产生可预测的、确定的变化。相比之下,符号表征(symbolic representations)允许将这些不变性显式地表达出来并对其进行直接操作——正如在科学定律与原理中所见的那样。这表明:尽管隐表征(latent representations)为通过参数更新来消解异常提供一种灵活的底层基础,但若要真正弥合认知鸿沟,可能需要借助那些能够将不变性显式揭示并加以直接操作的表征方式——这正是符号化科学模型所普遍采用的标准做法。

2 与L2层级的区分

采用三项边界条件来界定L2与L3之间的分界,每一项条件都对应于“设计—执行—观察—反思”循环中的一个过渡环节:

- 主动信息扩展(M_t → e_t):系统设计实验,主动探查不确定性或挑战其当前的信念,而非仅仅在既有知识框架内进行优化。

- 自主执行与观察(e_t → d_t):系统通过交互来执行实验并获取证据,而非单纯依赖模拟数据或预存数据。

- 面临挑战时的信念修正(d_t → M_t+1):系统利用观察结果进行反思并修正模型——包括更新参数、结构或资产——从而得以纠正先前的假设。

上述边界条件可归结为一条统一的原则:即世界模型在部署阶段是保持固定不变,还是具备可塑性。这种从L2向L3的跃迁体现在三个方面:模型在部署后能否更新其参数与结构;模型如何随时间推移积累新的能力;以及模型是消极地消耗数据,还是通过实验主动生成数据。

固定性与适应性。L2层级的模拟器在训练完成后通常是固定不变的。尽管它可以基于训练数据生成无限次的展开序列(rollouts),但其核心的状态转移函数却不会发生演化;它所做的仅仅是探索其“冻结”知识所蕴含的各种推论。相比之下,L3层级的系统在部署后则具备适应性:它将自身的参数或结构视为一种有待更新的假设——即 M_t+1 = M_t + 证据(Evidence)。

增长模式。L3层级的增长远不止于简单的数据缓冲(data buffering),而是涵盖三种截然不同的模式:

• 参数更新:基于新获取的证据,通过梯度下降法或贝叶斯更新来调整模型权重;例如,在线学习、持续强化学习微调以及贝叶斯模型更新。

• 架构更新:动态添加新的模块、专家单元或扩充容量,以应对日益增长的复杂性;例如,扩展上下文窗口或分配新的内存槽(slots)。

• 假设空间扩展:扩展模型的类别(model class),使其能够表征那些此前无法表达或解释的概念。这相当于引入新的变量、机制或抽象概念,从而实现一种转变——从“我不知道这 k 个选项中哪一个是真的”转变为“正确的解释并不包含在当前的这 k 个选项之中”。这是最具挑战性的一种模式,且与溯因推理(abduction)及真正的科学发现紧密相连。

被动与主动。尽管 L2 系统可能支持被动的在线学习(即根据流入的数据流更新权重)或决策模拟,但 L3 系统的显著特征在于其主动的试错循环。它并非仅仅被动地等待数据,而是会主动采取行动去生成数据,旨在最大化针对特定假设或不确定性领域的“信息增益”。这种主动的姿态将智体(agent)的角色从“经验的消费者”转变为“实验的设计者”——这是一次质的飞跃,直接呼应溯因推理哲学与科学方法论的核心思想。L3 系统的定义不应局限于一般规划意义上的“闭环使用”;相反,其核心定义在于实现“从证据到修正”的闭环机制——这意味着在连续的迭代使用过程中,系统的实际部署成效将被反哺回来,用于诊断、更新并验证其内部的“世界建模堆栈”本身。

3 案例与应用

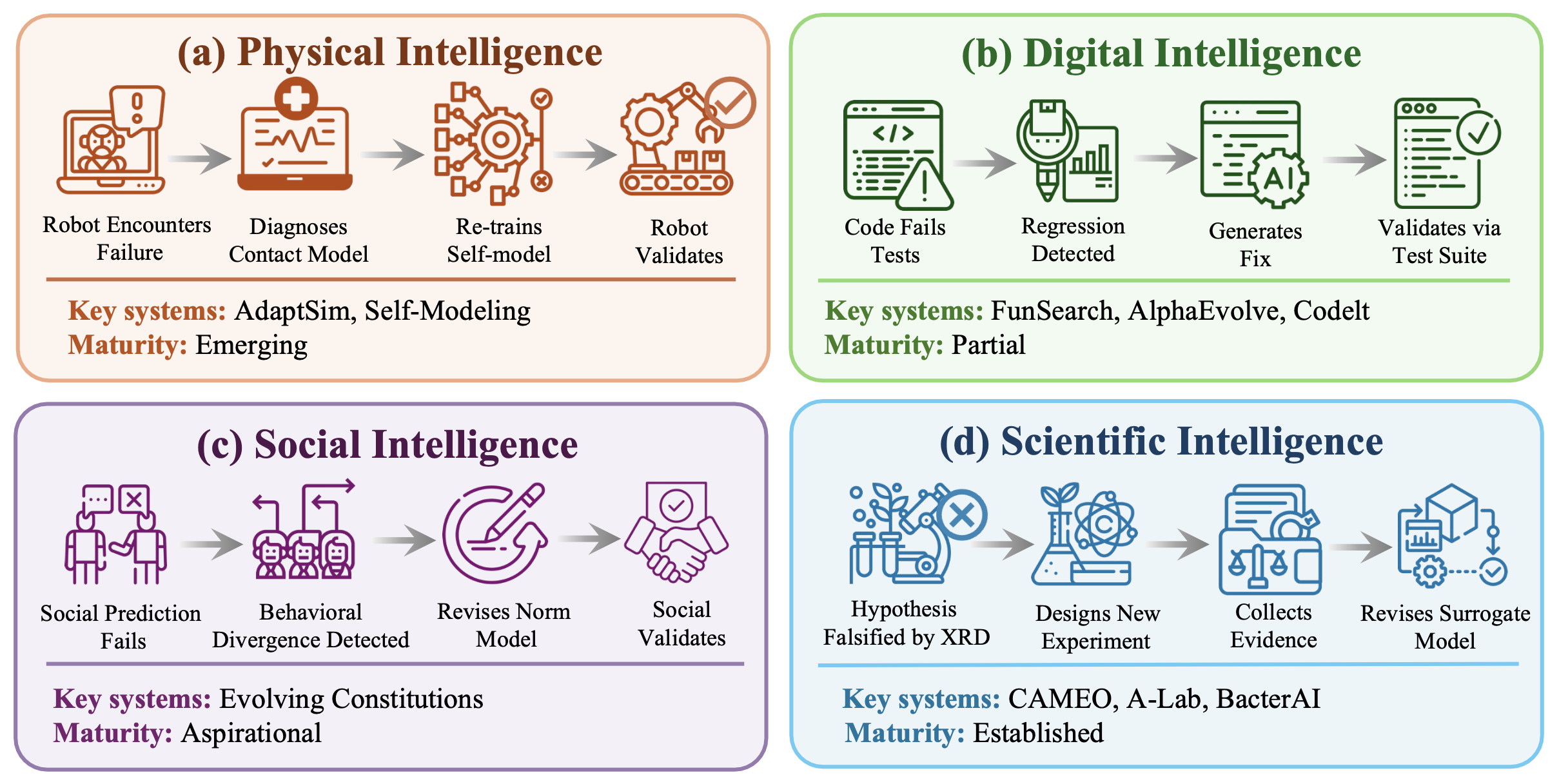

在那些具备高度仪器化监测能力、能够提供快速反馈且拥有明确评估标准的领域中,L3 系统的应用往往最为顺畅可行。目前,L3 系统在不同领域的实证支持程度尚不均衡:以“自主科学研究”为代表的高度仪器化环境提供了最清晰、最有力的实证案例;而在涉及社会交互、代码开发及具身环境(embodied environments)的领域中,L3 系统的应用仍处于实证探索与前瞻性设计空间相互交织的阶段。如图 10 所示,依据四种不同的“主导法则体系”,对这一应用图景进行梳理与展示;同时,也列举在各类体系下所特有的证据信号与潜失效模式。

物理智能。在具身智能的应用场景中,L3 系统主要体现为一种“自适应探测”机制,旨在通过主动探测来推断并更新动力学模型。当机器人遭遇意料之外的接触动力学现象时——例如接触到光滑的表面或柔性的可变形物体——系统便会主动执行一系列“诊断性动作”(即设计精巧的微小扰动,旨在消除关于接触模型假设之间的歧义);随后,系统利用这些动作所产生的实证数据,对自身的动力学模型进行更新与修正。在这一领域中,异常信号本质上均属于物理层面的信号:诸如力/扭矩的偏差、意料之外的接触事件,以及预测末端执行器轨迹与实际观测轨迹之间的差异等,均可作为模型更新的定量化实证依据。近期研究表明,机器人能够自主检测物理损伤,并重新训练具有持续性的自我模型:Hu(2025b)展示一种以自我为中心的视觉自我模型,该模型通过对比预测结果与实际观测结果之间的差异来检测形态变化,并进行重新训练以恢复运动能力。AdaptSim(Ren,2023)通过元学习获得一种自适应策略,该策略利用少量现实世界的任务表现数据,迭代地修正仿真参数;它通过“证据驱动的仿真修正”而非“固定的域随机化”来弥合“仿真-到-现实”(sim-to-real)的鸿沟,其中每一次现实世界的部署都会为下一轮仿真更新提供依据。

数字智能。软件和网络环境天然适用于L3智能,因为在这些环境中,系统状态是完全可观测的,动作执行是确定且可复现的,且回归测试机制提供一个内置的验证关卡。以“评估器驱动的发现循环”为代表的范式正是这一领域的典型体现。Romera-Paredes(2024)将一个预训练的大语言模型(LLM)与一个自动化评估器相结合,构建了一个演化循环:LLM负责生成候选程序,评估器依据形式化规范对这些程序进行评分,得分较高的解决方案随后被反馈回系统中,以供进一步的优化与完善。通过这一循环,该系统不仅为“集合覆盖问题”(cap set problem,组合数学领域的一个长期未解难题)发现新的构造方法,还找到性能优于现有基准的全新“装箱问题”(bin-packing)启发式算法。尽管该系统仅实现了L3智能中的“设计”与“观测”环节(即程序生成与自动化评分),且未涉及主动的信息扩展或持续的模型修正,但其中的评估器机制确实充当自动化的回归验证关卡——这正是L3智能的一项关键属性。Novikov(2025)进一步拓展这种演化式编程范式:通过将LLM生成的程序变体与自动化的正确性评估器相结合,该系统在Strassen矩阵乘法算法问世56年之后对其进行改进,并解决20%的数学未解难题——其表现超越了此前的最佳水平(SOTA);这一成果有力地展示形式化验证机制在算法领域作为L3智能“守门人”所蕴含的巨大潜力。CodeIt(Butt,2024)则构建一个更为紧密的智能循环:该系统利用“优先级的后见重放”(prioritized hindsight replay)机制,基于LLM自身的搜索轨迹对其进行微调;得益于此,作为“程序空间隐式世界模型”的生成模型本身,得以在跨任务场景中实现持续性的自我提升。 AI Scientist-v2(Yamada,2025)通过采用基于智体的树搜索(agentic tree search)来进行实验选择,进一步深化计算实验的能力:该系统能够自主构建假设、设计并执行实验、分析实验结果,乃至撰写完整的学术论文。一个VLM反馈回路通过迭代过程来精进图表与内容。2025年,该系统生成一篇完全由AI撰写的论文,并成功通过ICLR研讨会的同行评审。然而,该系统的实验仅限于计算层面(即运行机器学习训练任务),且其修订回路侧重于提升论文的表层质量,而非深化对底层机制的理解;这充分揭示了在具备完善工具支持的计算领域实现L3智能,与在真正的科学发现领域应对更艰巨挑战之间存在的鸿沟。在AUI系统(Lin,2025a)中,一个由“编码智体”(Coder)与“计算机-使用智体”(CUA)构成的反馈回路,在网站开发场景中具体践行这一原理:编码智体负责迭代修订网站的实现代码,而计算机-使用智体则充当自动化评估员,通过执行一系列任务轨迹来验证网站的功能正确性(例如,导航是否顺畅、任务是否成功完成)。这种基于可执行交互而非静态代码审查所产生的反馈信号,可作为一种“回归信号”来指导后续的代码更新,从而形成一个与L3智能特性高度契合的闭环优化流程。

社会智能。在社会领域实现L3智能,要求当智体对其他智体行为的预测结果与实际观察到的行为发生偏差时,能够对自身的“社会模型”进行修订;例如,当其基于“心智理论”(Theory-of-Mind)所作的预测出现系统性失效,或者社会规范随时间推移发生漂移时,便需启动此类修订。目前,社会领域被视为实现L3智能最具挑战性的领域,原因有二:首先,行为归因本身具有内在的模糊性(即预测失败可能源于对其他智体目标理解有误、社会规范模型已过时,抑或是对方行为具有随机性);其次,涉及社会交互的实验往往受到严格的伦理约束。尽管关于多智体群体中规范涌现与惯例形成机制的早期研究已迈出通往“社会L3”的第一步,但如何依据实际部署过程中获取的证据,对社会世界模型进行持续且经过严格验证的迭代修订,目前仍是一个尚待攻克的开放性难题。通往“社会L3”的另一项初步探索,在于通过演化计算的方法来合成多智体治理规则:Kumar(2026)利用由大语言模型(LLM)驱动的遗传编程技术,依据群体社会的稳定性评分,演化生成一套具有良好可解释性的“宪法”式治理规则;其性能表现较人类专家设计的规则提升123%。

科学智能。目前,L3智能最完备的实例主要集中在“自主科学”(Autonomous Science)领域;在该领域中,得益于各类精密仪器的辅助,从实验设计、执行、观察到反思的整个闭环流程得以完整地贯通与实现。自主闭环科学发现的范式由“机器人科学家亚当”(Robot Scientist Adam,Sparkes et al., 2010)确立;这是首台能够自主设计关于基因功能的实验、执行实验、观测结果并修正自身模型的机器。其后续系统在酵母系统生物学领域展示了实验设计、执行与模型修正的闭环循环,从而加速了生物模型的开发(Coutant et al., 2019)。CAMEO(Kusne et al., 2020)利用同步辐射光束线,通过贝叶斯主动学习实现了闭环材料发现:该系统预测某种候选组分将形成何种物相,随后进行合成,利用X射线衍射对产物进行表征,更新其贝叶斯信念模型,并主动选择下一个实验以实现信息增益最大化。每个实验循环仅需数秒至数分钟,且该系统在无需额外人类干预训练的情况下,发现了一种新型相变存储材料。A-Lab(Szymanski et al., 2023)将这一范式进一步扩展至完全自主合成领域:三台机械臂自动完成了粉末配料、加热及XRD表征等操作;当合成目标未能达成时,主动学习算法便会生成经过优化的合成配方。在为期17天的闭环运行中,A-Lab共执行了353项实验,并从57个合成目标中成功制备出36种化合物。至关重要的是,对失败合成案例的分析提供了结构化的证据,从而有助于优化未来的合成策略;这些失败案例并未被简单舍弃,而是被提炼并转化为可长期留存的知识。Strieth-Kalthoff et al.(2024)将“自动驾驶实验室”(Self-Driving Laboratory, SDL)范式扩展至分布式、多站点的协同运行模式:这一去中心化的SDL系统通过迭代更新贝叶斯代理模型,并整合来自地理位置分散的多个设施所产生的合成与表征数据,从而自主发现了新型有机激光发射材料。BacterAI(Dama et al., 2023)展示了实验室自动化系统(L3)在完全不具备先验生物学知识的情况下依然能够高效运作:该系统通过迭代设计并执行实验,绘制出微生物对氨基酸的需求图谱,其代谢模型的修正过程完全基于实验所产生的实证数据。在计算化学领域,MOOSE-Chem(Yang,2025e)展示了这样一个事实:基于大语言模型(LLM)的框架仅利用2024年之前的文献,便能重新发现2024年发表于《自然》(Nature)和《科学》(Science)期刊上的化学假说。这提供了有力证据,表明 L3 循环中的“假说生成”组件在自然科学领域已具备可行性。其后续版本 MOOSE-Chem2(Yang,2025d)引入了针对细粒度假说组件的分层搜索机制,从而提升了所生成发现的准确性与新颖性。更广泛的智体系统正将 L3 循环进一步推向生物医学领域。Biomni (Huang et al., 2025a) 提供了一种通用型生物医学 AI 智体,集成跨越 25 个子领域的 100 多种工具和 59 个数据库,能够自主执行从因果基因优先级排序到药物重定位等各类任务。BioLab (Jin et al., 2025) 则基于生物基础模型构建一个多智体系统,将这一能力扩展至端到端的自主生命科学研究。OriGene (Zhang et al., 2025i) 展示一位能够自我演化的虚拟疾病生物学家,该智体通过迭代式的假设精炼过程,自主地发现治疗靶点。AI 协同科学家系统 (Gottweis et al., 2025) 采用“生成—辩论—演化”的方法来构建假设,其多智体竞赛机制已在药物重定位和表观遗传靶点发现等领域得到验证。作为对上述系统的补充,Yang et al. (2026) 引入一项动态基准测试,揭示出当前的大语言模型(LLMs)在进行真正的生物学知识推导方面仍显不足,这突显文献检索与真正能够更新底层模型的 L3 修正之间依然存在显著鸿沟。

证据的质量与可证伪性。演化过程的质量取决于所依据证据的质量。例如,一张结合 DOM 快照、错误代码及操作序列的屏幕截图,其内容是可复现且可反驳的;而诸如“我觉得页面没加载出来”之类的表述,则不具备这种特性。对于人类反馈,不应将其一概归入同一类可证伪性范畴:主观性反馈或偏好性反馈的可证伪性较弱;而专家提供的诊断性反馈,若其断言随后能通过测试、实验或结构化评估得到验证,则具有较强的可证伪性。演化系统的进步,有赖于确保所汲取的经验教训具有可验证性,并在证实有误时具备可回溯性。这一要求与定义的“异常”和“认知鸿沟”触发机制直接相关:只有当预测与观测之间的偏差能够基于记录的证据进行量化时,异常才具备可操作性;而只有当系统能够证明没有任何现有假设足以解释该观测结果时,认知鸿沟才可被识别。在进行大规模部署时,证据还必须具备可压缩性和可索引性。实用的系统通常维护多分辨率的证据:既包含用于快速检索的紧凑型错误类别、状态指纹及差异摘要,同时也包含指向更重量级工件(如屏幕截图、DOM 快照、完整日志)的指针,以便进行深度审计。证据的质量也与隐私及安全约束紧密耦合:Evolver 流水线必须将那些需要持久化存储的内容(经脱敏处理的日志、哈希指纹)与那些仅作瞬时保留或置于访问控制之下的内容区分开来,从而在保留审计追踪线索的同时保护敏感数据(Xie et al., 2024; Yang et al., 2025a)。

持续的自我改进机制同时也引入治理方面的挑战,其中包括基准过拟合、知识污染,以及将故障错误归因于错误组件等问题。

4 L3 的上下文:成熟度、治理与展望

在确立 L3 演化循环、其在各领域的具体实例化,以及证据质量所扮演的角色之后,现在将审视其当前的实际状态及相关启示。探讨两个相互补充的问题:其一是“成熟度”,即 L3 系统在不同主导规律领域中已取得成功实现的程度;其二是“治理”,即由持续、自动化的模型修订过程所引发的各类风险。综合来看,这些视角共同刻画 L3 的双重属性:它既是一种建模范式,又是一个必须在现实世界约束下实现可靠演化的已部署系统。

跨领域的成熟度。对 L3 在以下四个主导规律领域中的成熟度进行归纳:

- 科学领域(已成熟)。这是成熟度最高的领域,能够提供快速且结构化的反馈、明确的异常信号(即假设证伪),以及定义清晰的修订目标(如智体模型参数、合成配方等)(Kusne et al., 2020; Szymanski et al., 2023; Sparkes et al., 2010; Dama et al., 2023)。主要瓶颈在于:实验仪器的获取难度以及真实数据采集的资源预算限制。

- 数字领域(部分成熟)。回归测试机制提供一个自动化的验证关卡,但许多系统仍缺乏那种能够主动拓展信息边界的必要条件(Romera-Paredes et al., 2024; Novikov et al., 2025; Butt et al., 2024)。主要瓶颈在于:往往缺失主动式的实验设计环节。

- 物理领域(新兴阶段)。该领域前景广阔,但受限于“归因(attribution)困难”这一难题:一次失败的操作可能源于感知、动力学、执行机构或环境变化中的任何一环;若要精准定位究竟是哪一组件发生故障(即“脆弱组件”),则需要进行精心设计的实验(Ren et al., 2023; Hu et al., 2025b)。主要瓶颈在于:在感知、动力学与执行机构之间进行故障归因的难度。

- 社会领域(尚待实现)。社会实验受制于伦理道德的约束,故障归因过程本质上具有模糊性,且关于行为表现的“真值”(ground truth)往往充斥着噪声(Kumar et al., 2026)。主要瓶颈在于:归因的模糊性,以及社会实验所面临的伦理道德限制。

治理方面的挑战。具体而言,由持续、自动化的模型修订过程引发三类主要的治理风险。当回归测试门(regression gate)与训练数据分布过于接近时,就会发生“基准过拟合”(Benchmark overfitting);此时系统学会的仅仅是如何通过测试,而非实现真正的能力提升。当修订迭代循环中引入本身带有偏差或经对抗性手段刻意构建的证据时,就会发生“知识污染”(Knowledge contamination);这种污染会悄无声息地降低模型在分布外(OOD)输入上的性能。当针对某种故障模式的修复措施无意中损害系统的其他组件时,就会引发“归因级联”(Misattribution cascades);若缺乏全面的回归测试套件,某次更新的最终净效应甚至可能适得其反。针对上述问题的缓解策略包括:使用独立于训练数据且定期刷新的“预留探针集”(held-out probe sets)进行检测;采用“金丝雀发布”(canary deployment)模式,以便在全面上线前及时发现性能回退问题;以及运用“因果消融分析”(causal ablations)手段,以独立评估每次更新所带来的具体贡献。

从评估视角来看,对L3级能力进行评估所需的协议必须超越单纯的“单次任务准确率”指标;其核心衡量标准在于:系统能否在历次修订迭代周期(k)中持续进步,且在针对预留探针集的测试中未出现性能回退。从实现视角来看,L3级能力对系统技术栈(包括持久化存储、回放基础设施、回归测试框架及回滚机制等)提出极高的要求;而在当前的系统架构设计中,这些关键组件的规范往往定义得过于简略或不完备。因此,若要实现L3级能力,就意味着必须在评估基础设施的建设上投入与模型能力提升同等重要的资源与精力。

分类体系的价值并非为了分类而分类,而是为了指导系统设计。下面沿着三个架构维度——即表征、动力学和控制接口——对世界模型的实现方案进行拆解;并探讨“主导定律(governing- law)”如何制约哪些组合在实践中是可行的。部署这些系统会引发一系列贯穿始终的工程挑战:包括端到端训练与模块化训练之间的抉择、延迟与计算资源之间的权衡、从仿真-到-现实的迁移(sim-to-real transfer),以及在模型不确定性下的“优雅降级”能力。学习型世界模型在推理阶段将仿真成本摊销(amortize)到一个固定的计算图中,而显式仿真(explicit simulation)的成本通常会随着实体数量、交互次数、求解器步数或时间跨度(horizon length)的增加而更直接地线性增长。这并非意味着神经推理在涉及的所有相关变量上都能实现严格意义上的 O(1) 复杂度:其计算成本依然取决于模型规模、输入分辨率、序列长度以及展开深度(rollout depth)。其真正的实际优势在于:对于那些若采用显式仿真将导致成本急剧攀升的系统复杂性维度,学习型动力学模型能够提供一种成本近乎恒定的近似计算方案。在此语境下,各类效率优化技术之所以至关重要,并非仅仅因为它们是通用的部署技巧,而是因为它们与上述三个能力层级之间存在着截然不同的交互关系。对于 L1 级系统而言,模型压缩主要是在单步预测精度上进行权衡取舍。对于 L2 级系统,内存管理与展开(rollout)效率将直接决定系统所能达到的时间跨度、反事实分支(counterfactual branching)能力,进而影响其在长时序上的连贯性。对于 L3 级系统而言,同样的效率优化选择将决定“回归-门控更新环”(regression-gated update loops)在部署阶段是否足够轻量,从而能够实现持续不间断地运行。若要进一步实现规模化扩展,则必须依赖各类效率优化技术:例如用于实时规划的“少步蒸馏”(few-step distillation)技术;在“累积误差效应”(即微小的单步精度损失会被逐层放大)这一约束下进行的模型量化与剪枝操作;以及针对长时序自回归动力学模型所采用的 KV 缓存压缩技术。

1 架构构建基石:表征、动力学与控制

构建一套世界模型系统,需要在上述三个架构维度(轴线)上进行组件选型与配置。每一个选择都伴随着独特的权衡取舍,这些取舍决定了所得系统能够达到的能力层级(L1/L2/L3),以及所得设计在这三个维度中的每一个上,在哪种“主导法则”体系下能发挥出最佳效能。

表征(Representation)。 在一个极端上,符号化或程序化的状态表征(例如 VirtualHome [Puig et al., 2018])提供了良好的可解释性,并支持对硬约束的强制执行;但它们需要大量的人工工程投入,且仅能覆盖预先指定的有限状态空间。这类表征的最佳评估指标是任务成功率和错误分支覆盖率。在另一个极端上,潜连续表征——例如 DreamerV3 [Hafner et al., 2025] 中的 RSSM 和 V-JEPA2 [Assran et al., 2025]——能够处理高维多模态输入,且对人工设计的结构依赖度相对较低。它们的弱点在于,在较长的时间跨度(长时序)上,它们更容易受到语义漂移和状态混叠(state aliasing)问题的影响;因此,在评估这类表征时,保持长时序上的一致性以及进行故障归因分析显得尤为重要。VL-JEPA [Chen et al., 2025a] 提出一种联合嵌入预测架构,该架构能够预测目标文本的连续嵌入向量。VLog [Lin and Shou, 2025] 则利用一种可学习的token来检索叙述文本,随后将该token作为一种以视频为中心的词汇单元,应用于长视频的理解任务中。介于上述两个极端之间的是结构化三维表征,其中包括像 RoboOccWorld [Zhang et al., 2025j] 这样的占据模型(occupancy models),以及像 PointWorld [Huang et0 al., 2026b] 这样的点-流模型(point-flow models)。这类表征之所以具有吸引力,是因为它们能更自然地契合物理约束;然而,这种优势往往伴随着重建过程中的瓶颈以及计算资源的瓶颈。因此,在评估这类表征时,系统的可达性(reachability)与稳定性(stability)便显得尤为关键。最后,离散token表征(例如 IRIS [Micheli et al., 2023] 中的 VQ-VAE 码本)能够强制确保表征的组合性(compositionality),并通过交叉熵损失函数实现精确似然训练,从而在连续感知与自回归动态模型之间架起了一座桥梁。

动态(Dynamics)。以 DreamerV3 (Hafner et al., 2025) 为代表的随机隐动态模型,通过基于原理的 ELBO 训练及感知不确定性的轨迹展开(rollouts)机制,有效地表达不确定性与多模态特性;然而,在长时序预测任务中,其性能可能会出现退化或标定失准的问题。相比之下,在不确定性建模并非关键要素的场景下,确定性且感知价值的动态模型(如 MuZero (Schrittwieser et al., 2020) 和 TD-MPC2 (Hansen et al., 2024))会直接针对下游的价值预测任务来优化状态转移函数,从而牺牲了一定的生成灵活性,以换取与控制目标之间更为紧密的集成。自回归式Token动态建模方法(如 iVideoGPT [Wu et al., 2024c] 和 LWM [Liu et al., 2025])提供一种统一且可扩展的接口,能够通过共享词汇表处理多种模态数据,尽管其在长时程逻辑一致性方面仍存在短板。基于扩散模型的动态建模方法(如 Sora 技术路线 [Brooks et al., 2024]、DIAMOND [Alonso et al., 2024] 以及 Genie [Ball et al., 2025] 等交互式环境)能够生成逼真的观测层级状态过渡,但由于在推理阶段需要进行多步去噪处理,往往导致动作的可控性较弱。

控制接口方面,在线 MPC风格的方法(如 TD-MPC2 [Hansen et al., 2024] 和 PETS [Chua et al., 2018])利用短时程的轨迹展开(rollouts)在每一步进行重规划,从而实现快速纠错,但其代价是增加计算资源消耗和延迟压力。树搜索与扩展技术(如 MuZero [Schrittwieser et al., 2020] 和 EfficientZero [Ye et al., 2021])支持反事实分支探索和系统性的前瞻规划,但也容易放大模型误差,甚至可能利用基准测试中的漏洞进行投机取巧。另一种截然不同的策略是“想象轨迹策略优化”(如 Dreamer 系列 [Hafner et al., 2020; 2021; 2025]),该方法完全基于模型生成的轨迹来训练策略,从而避免学习过程中的真实环境交互,但前提是要求动态模型具备极高的准确性。在部署端,离线策略蒸馏技术(如 GR-1 [Wu et al., 2024a])能够实现低成本的推理,但在面临数据分布漂移(distribution shift)时表现脆弱,因此亟需进行“分布外”(OOD)鲁棒性压力测试。还有一种完全独特的策略是基于“可重演环境”的接口(如 OSWorld [Xie et al., 2024] 和 SWE-agent [Yang et al., 2024a]),这类方法彻底绕开对动态模型的学习,转而将真实环境本身视为模拟器,并通过解析执行回执和提取状态指纹来实现控制。从更宏观的角度来看,控制问题的一部分核心在于:究竟何时才需要调用外部计算资源——而不是将工具的使用视为一种非强制即缺席的二元选择。自适应工具集成工作为这一区分提供一个有益的规划器端示例(Wang et al., 2025b)。

2 跨主导-定律制度的设计权衡

上述构建模块并非可以相互替换;具体的主导-定律制度决定哪些组合是可行的,以及哪种故障模式占据主导地位。

物理世界系统。一切成败皆取决于在连续动作作用下的接触、可达性以及稳定性。表征模型必须能够保留几何结构和接触关系;动力学模型必须在短期至中期的时间跨度内保持稳定;而控制接口必须足够迅速,以实现闭环校正。在此类系统中,结合模型预测控制(MPC)或“想象式展开”(imagined-rollout)策略的隐式或结构化三维表征方案占据主导地位(Hafner et al., 2025; Hansen et al., 2024; Huang et al., 2026b)。短期展开有助于减少误差累积(Janner et al., 2019),而MPC则提供一种在线校正机制。此类系统的主要陷阱包括:预设“事实上的”三维场景的存在(即假设场景始终存在且稳定);三维重建能力退化;隐空间中出现语义漂移;在学习的表征模型中,某些违反物理约束的现象却显得“合情合理”;以及在涉及丰富接触交互的场景中存在的“仿真-现实”鸿沟(sim-to-real gap)。在实践中,区分至少三种不同的迁移曲线是十分有益的:跨输入模态的迁移、跨传感器套件的迁移,以及跨环境的迁移;因为每一种迁移情境都会暴露出学习动力学模型所特有的故障模式,并需要配备专门的诊断工具。

数字世界系统。在此类系统中,状态机与分支的一致性(而非学习的动力学模型)构成了主要的性能瓶颈。结合可复现环境的符号式或基于DOM的状态表征方案,是此类应用场景中的主流设计(Xie et al., 2024; Jimenez et al., 2024; Yang et al., 2024a)。由于这些方案能够显式地呈现状态机结构,并支持强有力的证据日志记录功能,因此能够使故障追踪变得更为简便,进而为“Evolver”风格的资产提炼(asset distillation)工作提供有力支撑。然而,这种高度的透明性并非毫无代价:当用户界面(UI)发生变更时,状态的“接地”(grounding)机制可能会失效;加载过程中的不确定性以及竞态条件(race conditions)会引入非确定性的噪声;此外,基准测试中的特定“伪影”(artifacts)依然容易受到“奖励博弈”(reward gaming)行为的干扰,且极易受底层软件栈中细微变动的影响而失效。

社会世界系统。当前面临的主要瓶颈在于,如何在漫长的交互过程中维持智体身份的连贯性及其相互关系的状态。智体的人设状态必须在数百轮交互中保持持久且不发生漂移;然而,“心智理论”(Theory-of-Mind, ToM)推断——即实时更新关于其他智体目标、知识和意图的信念——会带来逐步计算开销,且该开销随所建模智体数量的增加而呈线性增长。多智体通信进一步加剧这一难题:涉及 n 个智体的交互,每一步都会产生 O(n²) 级别的两两(pairwise)信念更新,这使得针对当前文献中已出现的、包含超过 10,000 个智体的模拟场景(Piao et al., 2025),采用简单的规模扩展策略变得不可行。对“规范一致性”的检查又增添一层额外约束:有效的社会行为展开(social rollouts)必须遵循不断演变的社会规范(如礼仪习俗、谈判协议、制度规则);且任何违规行为必须在展开(rollout)的当下即被检测出来,而非事后追溯(Zhou et al., 2024c)。其核心挑战在于:智体的身份并非一个固定的状态向量,而是其交互历史所涌现出的一种属性;如何在多轮动态交互中既维持身份的稳定性,又允许智体进行真正意义上的信念修正,仍是一个悬而未决的架构难题——当前基于大语言模型(LLM)的智能体,往往仅通过“系统提示”(system-prompt)的条件约束来肤浅地应对这一问题。

生成式模拟系统。此类系统的核心矛盾在于“视觉保真度”与“动作可控性”之间的权衡。高保真度的扩散模型或自回归模型(Brooks et al., 2024; Bruce et al., 2024; Alonso et al., 2024)虽擅长生成逼真的视觉输出——这对演示展示及合成数据生成极具价值——但其对动作的条件控制往往不够稳定,且难以维持跨越长时序的一致性。某些系统可能被误判为已具备“规划能力”,但实际上却尚不具备“决策可用性”;因此,在对这类系统进行评估时,应优先考量其“动作-响应的一致性”及“长时序的稳定性”,而非仅仅追求表层的“感知逼真度”(Wu et al., 2024c; Liu et al., 2025)。

科学世界模拟系统。在此类应用场景中,“证据链的有效性”与“可证伪性”远比表层的感知质量更为重要。系统内部的表征必须具备可解释性,且能够追溯至具体的实验证据;其动态演化过程必须严格遵循已知的科学机制边界;此外,其控制交互界面应主要服务于“实验方案的选取”及“信念体系的更新”,而非单纯的“动作执行”(Wang et al., 2022)。其特有的风险包括:看似合理却缺乏依据的虚构机制;将相关性误作因果关系;以及那些被悄然舍弃、而非在模型中加以传播的负面结果。

VLA 与原生世界模型。一个贯穿始终的架构问题在于:究竟是将世界模型的能力内嵌于“视觉-语言-动作”(VLA)模型之中,还是构建一个专用的世界模型模块?VLA 模型继承大语言模型(LLM)的规模化基础设施和预训练数据,但其世界建模能力是隐性的,且难以被独立拆分或评估。近期旨在使这种能力更加显性化的研究工作包括:引入“空间引导训练”,将几何结构注入 VLA 的策略学习过程之中(Chen et al., 2025d),旨在弥合隐性视觉知识与世界模型所必需的显性物理状态感知之间的鸿沟。另一些相关工作则将这种隐性能力更多地转化为程序性操作而非几何结构:例如 Pixel Reasoner 模型为 VLM(视觉-语言模型)配备诸如“放大”和“选帧”等显性视觉操作,用于驱动好奇心引导下的证据搜集;而 Visual Rationale Learning 方法则将此类视觉动作视为核心的推理基元而非可选项工具。这两项工作共同揭示一种更广泛的趋势:即便是那些未显式暴露独立状态转移模型的 VLM 类智体,其内部也正朝着显性化的感知控制方向演进(Su et al., 2025a; Wang et al., 2025a)。相比之下,原生世界模型则显式地暴露一个可供独立查询、组合及进行鲁棒性测试的状态转移函数。这两种范式之间的竞争,在某种程度上是一个社会技术问题:由于对 LLM 基础设施进行巨额投入,由此产生的“路径依赖”效应往往会倾向于 VLA 式的集成方案,即便从纯技术角度来看,构建一个专用的独立模块可能更为优越(Hooker, 2021)。从评估的角度来看,其关键的“试金石”在于:该系统的预测结果能否与其语言生成过程解耦,并依据前文所述的“三大边界”进行独立测试。此外,某些架构层面的抉择也并非纯粹基于算法考量,而是带有社会技术色彩:该领域最终究竟会趋向于采用原生世界模型,还是转向 VLA 式的替代方案,除了取决于模型本身的内在建模能力外,在一定程度上还将受制于现有的工具生态系统、可用的数据集资源以及硬件兼容性等因素。

值得注意的是,上述各类范式并非相互排斥。在实际应用中,成熟的系统往往会采取多种设计模式的叠加组合:顶层采用符号规划或工作流规划,负责高层级的任务拆解;中间层构建可回放的仿真环境,用于验证执行结果的正确性及定位故障归因;底层则采用短时域的连续控制机制,负责执行实时的动作校正(Moerland et al., 2023)。这表明,相关的分析单元应当是整个复合系统,而非任何孤立的单一模块。因此,应当结合它们所施加的约束以及它们所提供的证据,对表征、动力学和控制这三个方面进行综合评估。如此一来,文献中许多看似分歧之处,就不再像是关于“世界模型是否有效”这一根本性问题的争论,而更像是不同系统在上述设计维度上所处位置的差异。

3 实施路线图

有三项贯穿始终的工程原则适用于表中的所有单元格。第一,将“学习所得”与“强制约束”区分开来:硬约束层(如碰撞检测器、状态机验证器、回归门控等)应当在推理阶段显式应用,而非通过隐式方式进行学习;因为通过训练损失函数实现的软性约束,无法保证在系统展开(rollout)过程中实现零违规。第二,先构建检测工具,再进行迭代优化:日志记录、回放机制以及故障归因等基础设施,应当从系统构建之初就集成在内;若缺乏回放机制,第三层级(L3)的系统修订工作将沦为基于个别案例的零散修补,从而变得难以管控。第三,使表征形式与规划器的查询需求相匹配:一种外观逼真却未能显露规划器所需关键变量(如自由空间、通行权限状态、反应速率等)的表征形式,其效用甚至不如那种保真度较低但能显露这些关键变量的表征形式。

下面考察正推动各级能力向前迈进的研究前沿,并梳理那些悬而未决的问题——这些问题的解决将决定世界模型能否从令人惊叹的演示成果,真正成熟为可靠的科学与工程工具。

1 历史演进

数学原理阶段(–1956年)。构建现实世界预测模型的冲动,早在人工智能诞生之前便已存在。牛顿的《自然哲学的数学原理》(Newton, 1687)提供了首个统一的数学世界模型:给定初始位置与速度,其运动定律和万有引力定律在理论上能够预测机械系统的任意未来状态。拉普拉斯(1814)将这一宏大抱负提炼为一个思想实验,即如今广为人知的“拉普拉斯妖”(Laplace’s demon):一种假想的智体,若能掌握当下的全部知识,便可推算出整个宇宙的未来演变。随后,图灵(1950)提出“机器能否思考”这一问题,从而架起从数学建模通向人工智能的概念桥梁。上述发展确立了至今依然存在的核心张力:即模型保真度与可处理的时间跨度(horizon)之间的权衡取舍。

符号智能阶段(1956–1986年)。早期的人工智能研究试图通过人工编码的方式,将世界模型表达为一系列逻辑规则与约束条件。STRIPS 系统(Fikes 和 Nilsson, 1971)率先引入用于机器人规划的“动作图式”(action-schema)表示法;然而,“框架问题”(Frame Problem,McCarthy & Hayes, 1969;详见第 4.1 节)的出现揭示了一个难题:针对每一个动作,系统都必须显式地设定公理来指明哪些事物保持不变——这种显式规定的负担会随着动作数量的增加而呈组合级数般地暴增。随后发布的《莱特希尔报告》(Lighthill, 1973)通过揭露实验室演示成果与现实世界实际应用能力之间存在的巨大鸿沟,直接引发人工智能史上的第一次“寒冬”(1974–1980年)。第二次“寒冬”(1987–1993年)紧随专家系统的脆弱性暴露及Lisp机器市场的崩溃而来:像CYC这类手工构建的知识库,无法优雅地处理不确定性及常识性例外情况(Lenat, 1995)。其核心教训显而易见:纯粹基于符号的世界模型无法扩展至开放世界领域。

联结主义的复兴(1986–2020年)。神经网络的复兴——从反向传播算法(Rumelhart et al., 1986),历经深度卷积网络(LeCun et al., 1998; Krizhevsky et al., 2012),直至Transformer架构(Vaswani et al., 2017)——将研究范式从手工编码规则转向了基于学习的表征。世界模型在基于模型的强化学习中重新焕发生机,其应用范围从潜动力学模型扩展至通用的基于像素的控制任务。

生成式革命(2020年至今)。扩散模型(Ho et al., 2020)以及像GPT-3(Brown et al., 2020)这样的大规模语言模型,在上一时代确立的Transformer骨干架构基础上,催生一场质的飞跃。视频生成模型(Brooks et al., 2024; Agarwal et al., 2025; Bruce et al., 2024)与基于大语言模型(LLM)的智体(Hao et al., 2023; Wang et al., 2024b)正逐渐模糊“预测”与“仿真”之间的界限,尽管其中仍存在系统性的物理规律违背现象(Gu et al., 2025a)。从更宏观的角度来看,该领域正趋向于一个“神经-符号”融合的前沿地带(Marra et al., 2024; Zhao et al., 2026);这一前沿范式将用于学习状态转移函数(L1/L2)的神经动力学模块,与负责实施约束及扩展假设空间的符号组件(L3)有机地结合在一起。贯穿这四个时代,表征学习始终充当着共享的基础设施:所学状态 z_t 的质量,决定预测(L1)、模拟(L2)以及修正(L3)能力的上限。无论该表征是隐向量、离散的符号序列、三维点云,还是某种程序,其背后的“支配律机制”决定该表征必须保留哪些不变性特征。

这一历史演进轨迹揭示一个一以贯之的启示:世界建模领域的进步并非仅源于规模的扩大,而更在于对“何为被表征对象”、“何种要素可在时间跨度上进行组合构建”,以及“何种内容可依据证据进行修正”这三个核心问题的重新定义。

2 按能力层级划分的开放性问题

前文勾勒出一条清晰的发展轨迹:世界模型正从孤立的“单步预测器”,向着集成化的、面向智体的“模拟器”演进;后者必须在较长的时间跨度内,严格遵循特定域内的主导定律(governing law)。在上述所有四个机制范畴内,这一演进过程呈现出一种普遍的模式。在具身智能领域中,模型的“视觉逼真度”已超越了其“物理保真度”:尽管模型能生成极具说服力的视频画面,但在进行序列展开(rollout)时,却往往违背能量守恒定律及物体永存性原理;即便目前最顶尖的系统,在物理一致性测试中的成功率也仅为 0.262(Gu et al., 2025a; Li et al., 2025e)。在社会领域,大规模智体仿真能够复现诸如观点极化和治理机制形成等涌现现象(Piao et al., 2025; Dai et al., 2024);然而,基于大语言模型(LLM)的智体却表现出一种系统性的“趋同”偏差,这种偏差与人类的行为模式存在显著差异(Taubenfeld et al., 2024; Chuang et al., 2024)。在代码领域,智体往往将软件视为确定性的状态机,而真实的系统环境却是部分可观测、异步且多租户的(Kara et al., 2025)。在科学领域,那些基于仿真数据训练的神经代理模型(neural surrogates)在应用于真实的实验测量数据时,其性能会显著下降;这一现象揭示了一种“代理-现实(surrogate-to-reality)”鸿沟,其性质类似于机器人学领域中的“仿真-现实”迁移难题(sim-to-real)(Minami et al., 2025)。贯穿上述各领域的核心主旨在于:当前的研究瓶颈已不再是如何生成看似合理的未来情景,而是如何确保这些未来情景具备实际的决策可用性——即它们必须忠实地遵循既定的约束条件、能够对外部干预做出恰当响应,并能依据现实世界的实证数据进行准确标定。

依据问题最直接显现的能力层级,归纳整理十个具体的开放性难题。

表征与局部预测

- 超越视觉逼真度的物理真实性。当前的视频与三维世界模型虽然在感知层面已达到极高的逼真度,但在物理一致性测试中却表现乏力:PhyWorldBench 基准测试集(Gu et al., 2025a)的报告显示,在十二个前沿模型中,表现最优者的成功率仅为 0.262;该模型在针对物理守恒定律及“物体永存性”的探测试验中均未能达标,而“长期预测中的误差累积”被认定为其核心的结构性缺陷。若要弥合这一鸿沟,必须构建具备物理基础的表征体系——这种表征不仅要实现像素层面的保真,更要在进行反事实展开(counterfactual rollout)时能够强制执行各类物理约束。关于表征选择的探讨或许能为解决此问题提供一个可能的方向。此外,采用“空间引导式训练策略”——即在视觉-语言-动作(VLA)模型中注入几何学层面的监督信号(Ye et al., 2026a)——也被视为一条极具潜力的研究路径。

- 具备度量-觉察能力的视频世界建模。将基于几何学的编辑能力从图像对扩展至具有时间一致性的视频,需要四种相互耦合的能力:跨时间尺度的度量估计、短步长预测结果的时间合成、跨帧的主体身份与外观保持,以及将预测运动与语义规范对齐的指令接地能力(Ho et al., 2022; Xing et al., 2024)。相比于基于图像对的方法,转向视频领域能够提供更密集的时间监督信号和更强的主体身份约束。像 RealCustom++(Mao et al., 2026a)这类能够忠实还原主体特征且具备可控性的编辑方法,有望为相关应用提供有用的界面组件。在进行效果评估时,必须直接衡量其在几何度量上的可控性,而不仅仅是感知层面的视觉质量(Huang et al., 2024d; Ge et al., 2024)。

- 可编程的视觉表征。当前的视觉世界模型通常将状态表示为原始像素或潜嵌入(latent embeddings);但这两种表示方式既不具备组合性,也无法实现精确编辑。代码(Code)提供一种结构化的替代方案:VCode(Lin et al., 2025c)将图像重构为 SVG 程序,从而在一定程度上牺牲像素保真度以保留符号语义;Code2Video(Chen et et al., 2025e)证明,可执行的 Manim 脚本在处理结构化内容时,其表现优于基于像素生成的模型,因为它能让每一个空间和时间元素都变得可直接寻址;而 VIGA(Yin et al., 2026)则通过生成 Blender 代码来重构场景并模拟物理交互,从而将这一范式扩展到 3D 领域。目前尚待解决的开放性问题在于:如何将这些基于代码的表征统一整合到一个单一的世界模型接口中,从而同时支持 2D 和 3D 场景下的组合式编辑。

仿真保真度与干预能力

- 作为部分可观测马尔可夫决策过程(POMDP)的部分可观测软件系统。现有的任何基于代码的世界模型,都无法对隐藏的后端状态(包括服务器会话、数据库行、正在传输的请求以及后台进程等)维持信念分布(belief distributions),也无法对具有可变延迟的异步状态迁移过程进行推理。若在标准基准测试中注入逼真的异步故障情境,所有当前最先进(SOTA)的智体在任务成功率上都会出现显著下滑(Kara et al., 2025)。解决这一难题,需要构建一种具备“时间信念”的架构,该架构能够联合建模“已发生事件”、“正在进行中的事件”以及“智体当前尚无法观测的事件”。

- 并发的多用户状态管理。真实的软件系统往往是多租户(multi-tenant)架构;在分散式部分可观测马尔可夫决策过程(Dec-POMDP)框架下,世界模型必须能够预测系统状态,而在此类情境中,并发用户的行为是不可观测的(Wang et al., 2024g)。无冲突复制数据类型(Kleppmann and Beresford, 2017)为合并并发更新提供形式化的基础;然而,目前尚无任何世界模型能够将分布式系统的语义,与针对隐用户及待定写入操作的、基于学习的信念追踪机制相结合。这一难题恰好位于“数字世界”与“社会世界”两大领域交汇之处,因此要求必须对软件状态与多智能体意图进行联合推理。

- 规模化的人机行为对齐。大语言模型(LLM)智体表现出对“温和(moderation)”与“共识(consensus)”的系统性偏见(Taubenfeld et al., 2024; Chuang et al., 2024),从而导致两种失效模式:一是“模式坍缩”(mode collapse),即原本多样化的模拟群体最终趋同于同质化的行为;二是“标定不足”(calibration inadequacy),即在多轮交互的动态过程中,单轮交互层面的“角色设定对齐”失效。语言和文化先验知识虽然能为模拟注入多样性,但随着不同群体间文化距离的缩小,这种增效作用也会随之减弱。目前尚缺乏系统性的方法,来将模拟行为落地(grounding)于真实人类行为的分布之上。

基于证据的修正与自我演化。现有的自主科学旗舰项目(如 CAMEO [Kusne et al., 2020] 和 A-Lab [Szymanski et al., 2023])已证明,在高度仪器化的科研领域中,闭环式的模型修正机制是切实可行的;与此同时,由评估器引导的算法发现系统(如 FunSearch [Romera-Paredes et al., 2024] 和 AlphaEvolve [Novikov et al., 2025])也展示了具备强有力验证机制的局部 L3 循环。然而,若要实现 L3 循环的普适化应用,仍需解决若干悬而未决的关键问题。

- 社会演变函数的持续学习。尽管涉及数万个智体、历经数百万次交互的大规模模拟实验,已成功复现诸如“舆论极化”和“治理机制形成”等涌现现象(Piao et al., 2025; Dai et al., 2024),但这些模拟系统尚无法自主感知社会动态何时发生了转变。其核心挑战在于:如何识别出已过时的演变模型,获取用于修正的证据,并在修正过程中避免对既有稳定模式产生“灾难性遗忘”(catastrophic forgetting)(van de Ven et al., 2024)。这一难题与 L3 循环紧密相关——在 L3 循环中,模型的修正必须由数据分布层面的证据所触发,而非依赖于人工标注的监督标签。

- 弥合“代理(surrogate)- 现实(reality)”之间的鸿沟。那些仅基于模拟数据进行验证的科学代理模型(scientific surrogates),一旦应用于真实的测量数据时,其性能往往会发生显著退化;具体表现为:若仅依赖计算生成的数据,预测误差虽会遵循幂律曲线递减,但若缺乏基于真实数据的校准,误差下降趋势便会陷入停滞并趋于平稳——这一现象恰好映照机器人学领域中广为人知的“模拟-现实鸿沟”(sim-to-real gap)问题(Minami et al., 2025)。在科学研究领域,这种“代理-现实”的鸿沟,恰好对应于机器人学中的“仿真-现实迁移”(sim-to-real transfer)问题;因此,实施层面的缓解策略,提供一个有益的范本——尽管在测量瓶颈和证据预算方面,两者存在差异。值得注意的是,GraphCast、NeuralGCM和Aurora等L2级科学仿真器,为L3级修正工作提供预测基础;这些仿真器本身的保真度,决定下游“证据驱动型诊断(evidence-driven diagnosis)”所能达到的上限。OPAL-surrogate框架(Singh,2024)引入分层贝叶斯可信度门控机制,从而对“代理(surrogate)在何时是值得信赖的”这一问题进行了形式化界定。当前的核心开放性问题在于:如何将稀缺的真实实验观测数据,在“模型校准”与“科学发现”这两项任务之间进行最优分配。

- 对自身亦在演变的规律进行建模。在生物学、生态学和气候学领域,主导系统的动力学机制往往是非稳态的:病毒的适应度景观会发生漂移(Lassig,2017);气候强迫作用会改变大气动力学特征(Beucler,2024);而演化压力则可能引发临界点效应(Evangelou,2024)。因此,“世界模型”必须学会掌握一种“二阶元转移算子”,用以刻画规律本身是如何发生漂移的;与此同时,模型还需具备相应的“修正触发机制”,以便依据观测证据来识别规律是否发生改变。尽管非稳态环境下的因果发现研究(Huang,2020;Song,2023a)已在“可识别性”方面取得一定成果,但此类研究往往将规律的改变视为在既定“元模型”框架内的某种波动,而非视为一种本质性的“结构性规律更替”。

- 面向智体世界建模的“驾驭设计”(Harness Designs)。智体的性能演进历经了三个逐级深化的抽象阶段:首先是“提示工程”(Prompt Engineering),旨在优化模型所接收的指令内容;其次是“上下文工程”(Context Engineering,Anthropic, 2025),旨在跨轮次地精心维护和管理模型的信息状态;最后则是“驾驭工程”(Harness Engineering),旨在为模型构建并设计其周边的可执行环境——具体包括工具集、记忆模块、反馈回路,以及智体之间的拓扑交互结构(Rajasekaran, 2026;Pan,2026)。这一演进历程表明:智体的行为并非仅由其内部的模型所决定,而是主要受其“执行环境”的动态转移机制所支配;正因如此,对于软件智体而言,“驾驭设计”本身便构成一种特殊形式的“世界建模”。问题的关键在于,如何从交互数据中学习并综合出驾驭(harness),从而将执行环境本身视为建模对象,而非固定的工程假设。

跨机制的共同挑战。尽管各类“主导定律范式”千差万别,但在所有四个领域中,有三个悬而未决的问题反复出现,构成了智体AI(Agentic AI)进行“世界建模”时面临的最深层瓶颈。部署迁移(Deployment shift):那些利用离线数据或仿真环境进行训练的世界模型,一旦所处的环境发生漂移(drift),其性能便会系统性地下降。具体表现包括:用户界面布局发生变化、物理接触属性发生改变、社会规范随之演变,以及科学仪器需要重新校准。若要实现鲁棒的世界建模,就必须引入“在线机制”——即能够尽早检测出数据分布的漂移,并触发针对性的模型修正,而非坐视不理直至发生灾难性的系统故障。约束强制执行(Constraint enforcement): 上述所有四个范式都包含必须由有效轨迹(valid trajectories)加以满足的主导定律(例如:接触稳定性、状态机一致性、规范遵从性、证据链有效性);然而,现有的模型往往仅通过调整训练目标来“软性”地满足这些约束。如何在推理阶段实现“硬性”的约束强制执行——无论是通过符号层、受约束的轨迹展开(constrained rollout),还是通过验证门机制——至今仍是一个悬而未决的架构设计难题。持续更新治理(Persistent update governance):那些能够依据新证据进行自我修正的L3层系统,往往面临一个“三难困境”:即如何在稳定性(避免在修正过程中导致既往能力发生退化)、可塑性(快速整合新证据)与可审计性(能够追溯每一次更新所依据的证据来源)之间取得平衡。目前尚无任何系统能够完美解决这三方面的难题;此外,在大多数已发表的系统架构中,用于支撑更新过程的治理基础设施(包括版本控制、金丝雀发布、回展策略以及回归测试套件等)往往缺乏详尽的规范与设计。MREP框架,为标准化评估上述各类共同挑战提供一个切入点:该框架提供一系列“版本锁定且可复现”的评估软件包,从而使得跨范式之间的横向比较成为可能。

3 超越L3层级

L1-L2-L3这一层级体系预设一个前提:即现实世界是依据一套固定不变的主导定律在运行的。具体而言,L1层负责学习局部的规律性特征;L2层将这些局部规律整合、构建为符合约束条件的轨迹推演序列;而L3层则负责在既有证据与模型预测发生矛盾时,对模型本身进行修正。在L3层级上,系统虽然具备更新其“世界模型”所依据的主导定律的能力,但这些更新依然紧密地根植于对“单一且客观的底层现实”进行解释这一基本任务之上。

在此基础上,一个顺理成章的延伸方向便是元世界建模(Meta-world modeling):即构建这样一类系统——它们不仅能够针对某一个特定的“状态转移函数”进行推理,更能针对“所有可能的状态转移函数所构成的空间”本身进行推理。这类系统不再局限于对“所观测的现实世界”的模型进行精细化修正,而是转而探索那些能够定义出截然不同之环境的“替代性规则体系”;例如,它们可以通过调整、扩展,甚至重新构建各类假设、约束条件或管辖原则,来生成并探索全新的规则体系。在此情境下,能够显式地表征并操纵此类原理的能力变得愈发重要。具体而言,符号表征或许能为“元世界建模”(meta-world modeling)提供一种更为自然的接口,因为它允许人们直接对支配性规则进行修改、组合,乃至在不同的备选世界之间进行比较。

这种能力究竟会以何种形式呈现——无论是通过程序合成、开放式演化、程序化世界生成,抑或其他机制——目前仍是一个悬而未决的问题。从更宏观的角度来看,这引发一个深层思考:世界建模的终极目标,究竟在于构建针对特定世界的日益精确的模型,还是在于构建一套能够系统性地探索并推理多个世界的系统——而这些世界恰恰是由各不相同的支配性法则所定义的?预计不同的研究共同体将基于各自的研究侧重点(究竟是侧重于预测性能、科学理解,还是生成式建模),对这种能力提出各具特色的表述;至于究竟何为“终极的世界模型”,则将其作为一个开放性的议题,诚挚地留待更广泛的研究共同体共同探索与解答。

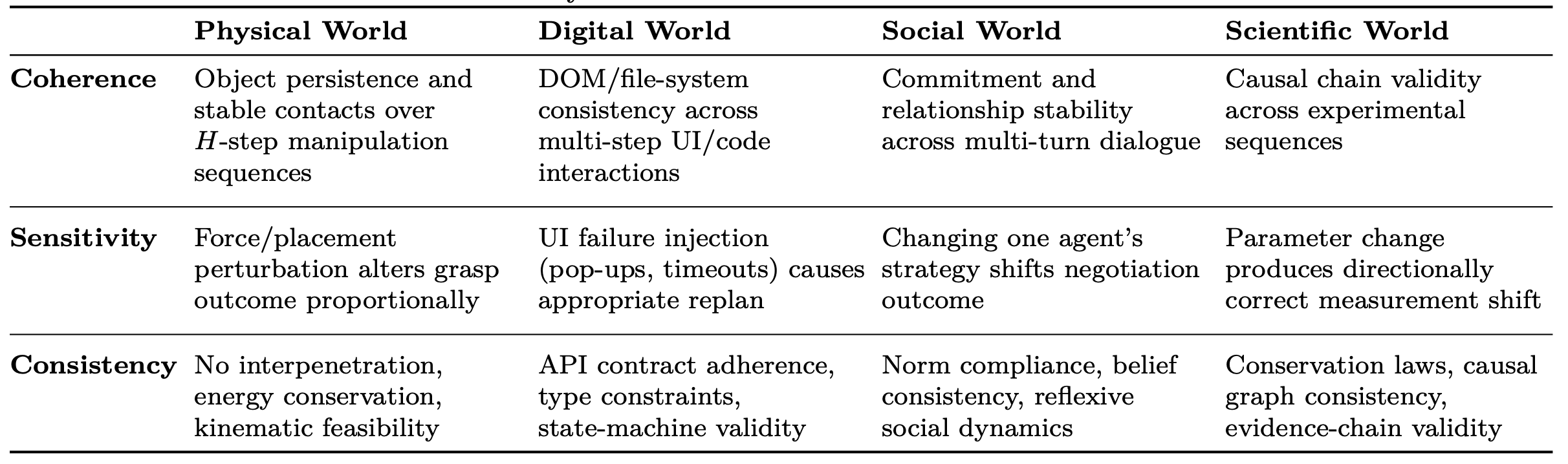

表4 展示由主导定律机制实例化的 L2 边界条件。每个单元具体指明该抽象条件在对应域内的具体含义。

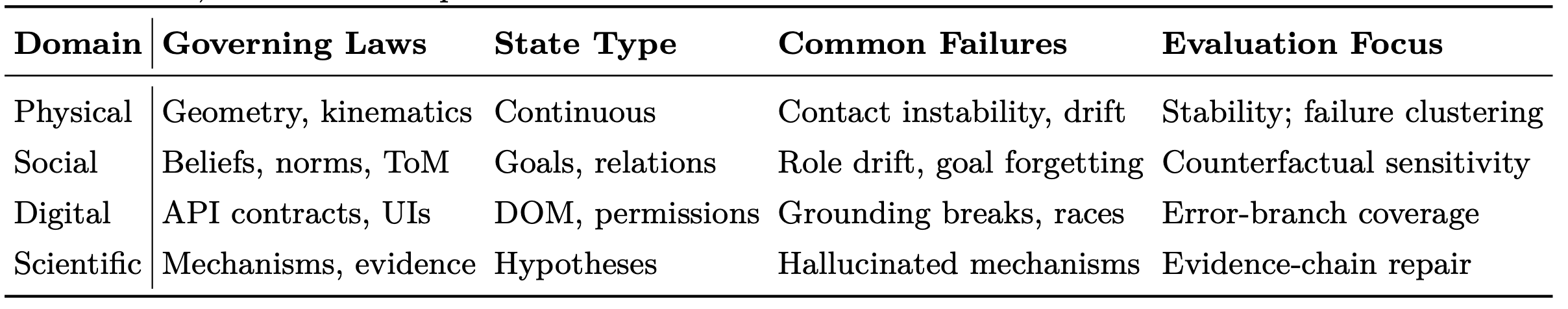

表7 所示L2 仿真器的跨领域比较。每一种主导律机制均施加不同的约束、失效模式及评估优先级。

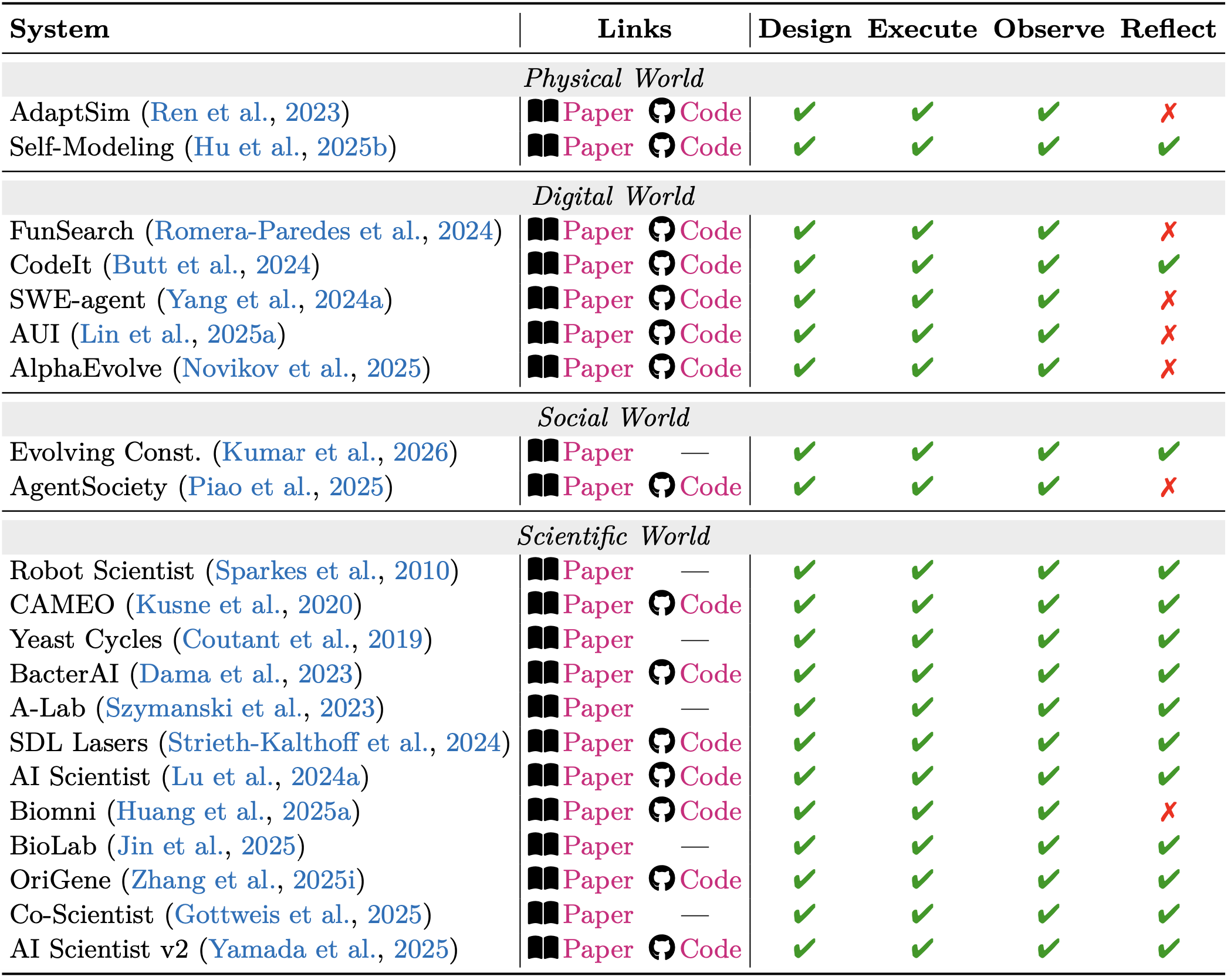

表 8 总结分属于四种“主导法则”范畴的代表性 L3 系统,并指出各系统分别实现“设计—执行—观察—反思”循环中的哪些阶段。

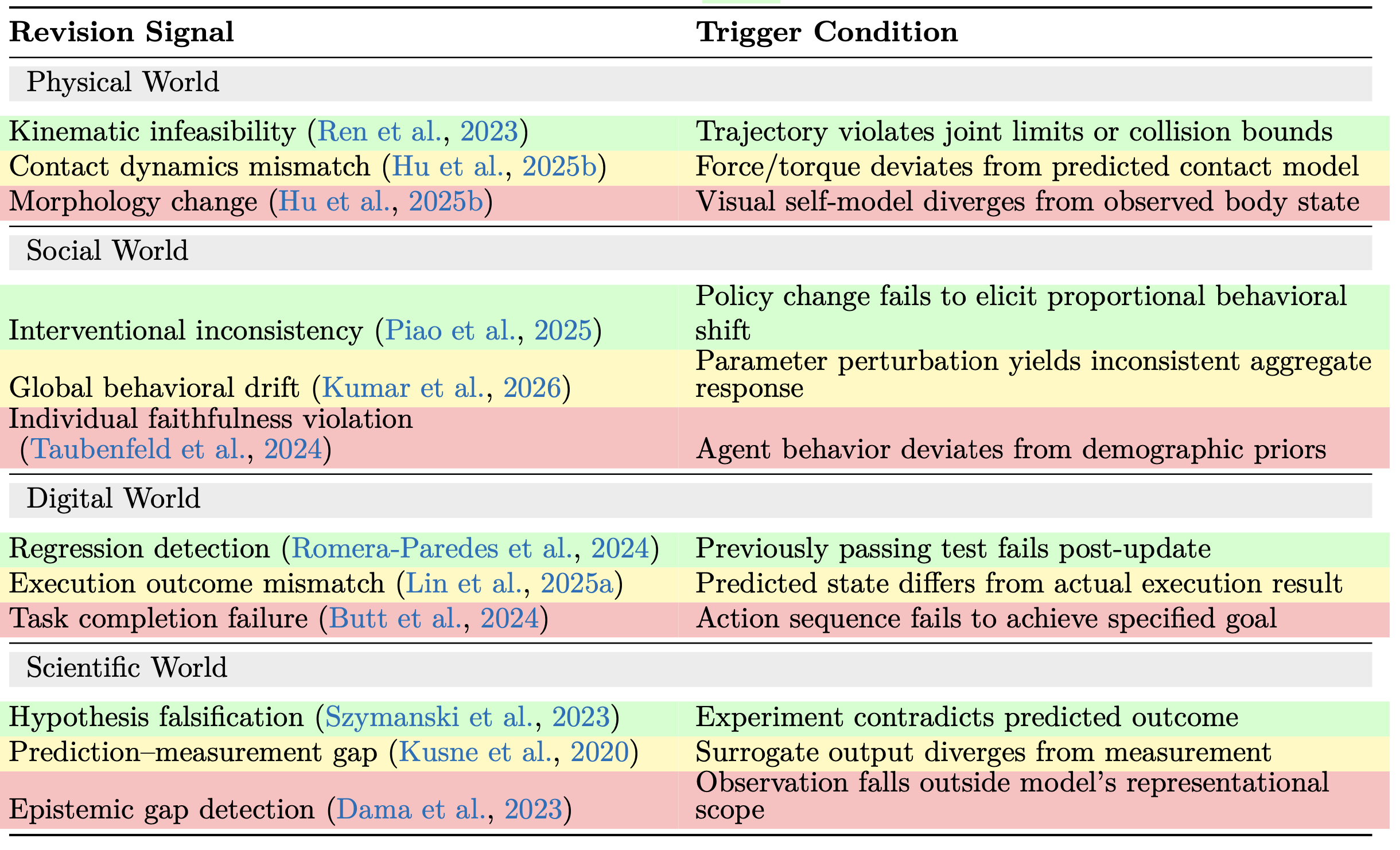

表 9 归纳在各类“主导法则”范畴下,能够触发 L3 模型更新的修正信号:具体包括智体检测到什么、为何该信号表明当前模型存在错误,以及该信号具有多强的可证伪性。一条行之有效的原则是:应优先采纳具有可证伪性的证据。其中行颜色编码域内可证伪性(不可在不同机制间进行横向比较):高=绿色、中=黄色、低=红色。

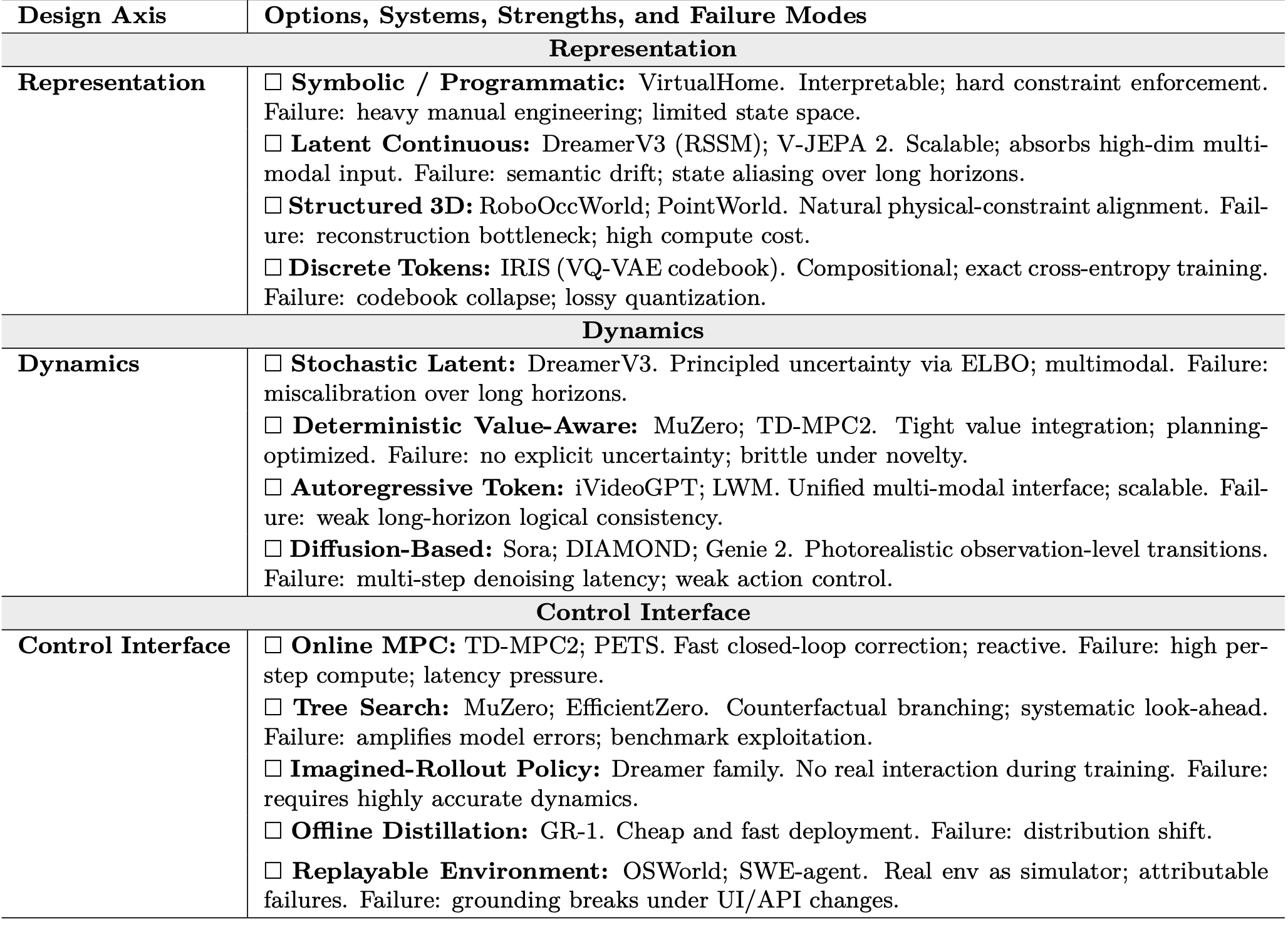

表11 所示构建世界模型的建筑基石。三个设计维度(表征、动力学、控制接口)与具体的选项、代表性系统、优势及主要失效模式进行交叉对照。

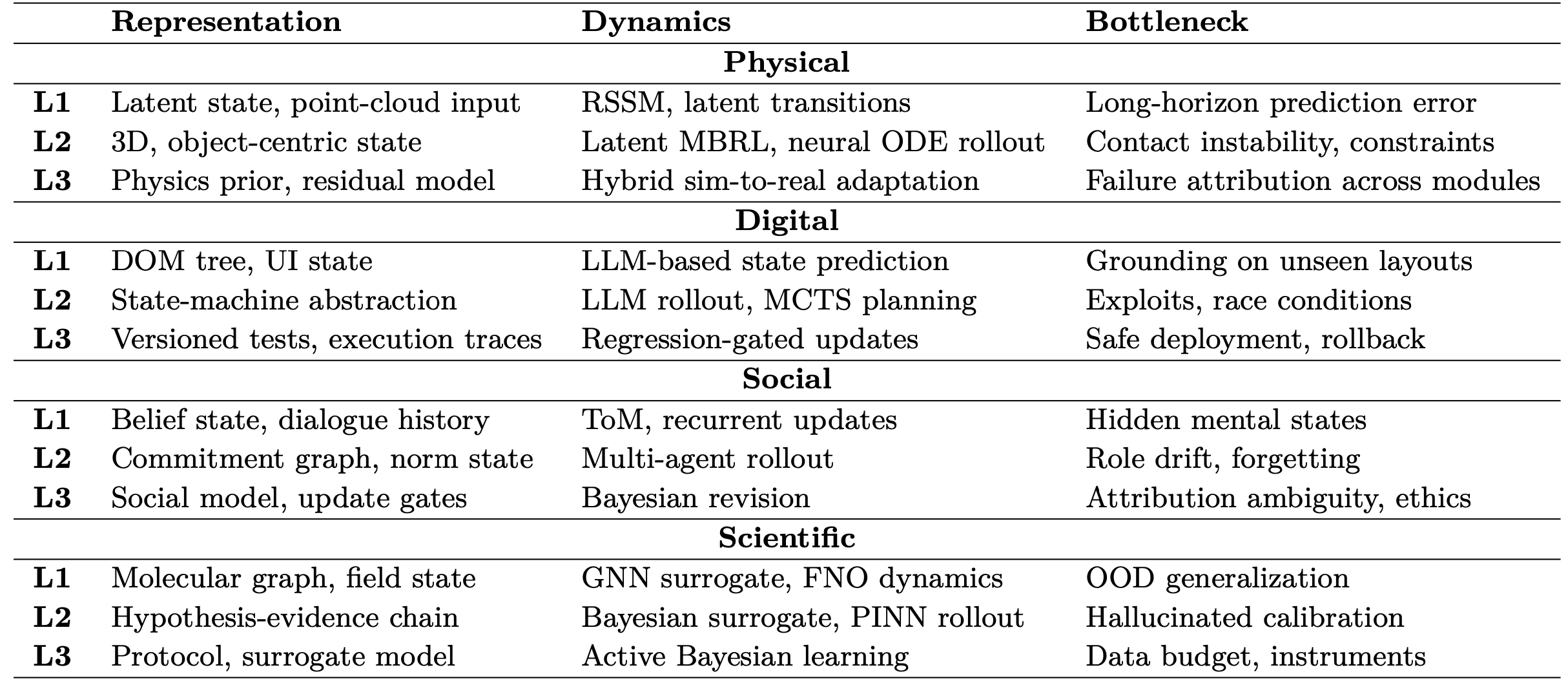

表13将前文各节中的架构指导提炼为一份简明扼要的路线图,并按能力层级和主导规律范畴进行编排。对于表中的每一个单元格,列出:最能保留该范畴内对规划器至关重要的结构特征的表征格式;在该能力层级下最具可处理性的动力学模型类别;以及为迈向下一层级而必须攻克的、最为关键的单一工程瓶颈。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)