简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

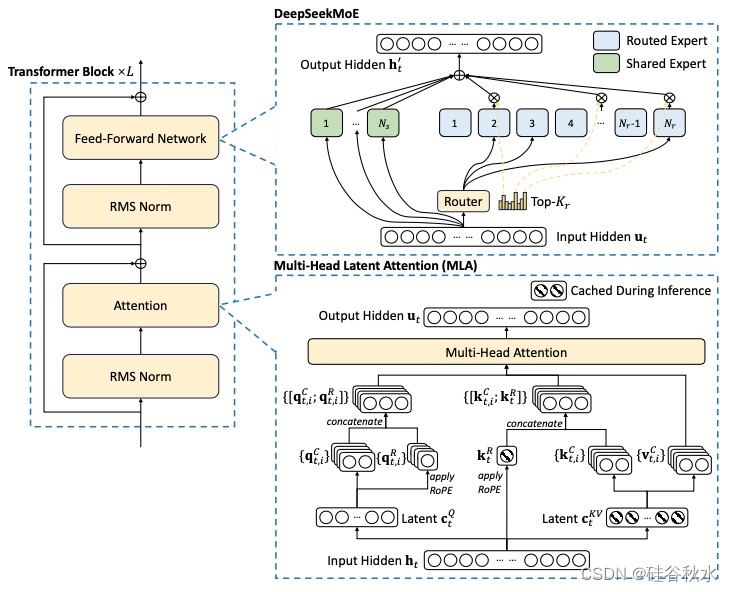

最近Deepseek团队(北大、清华和南京大学)刚刚公布开源MOE模型DeepSeek-V2,其技术细节见论文“DeepSeek-V2: A Strong, Economical, and Efficient Mixture-of-Experts Language Model”。

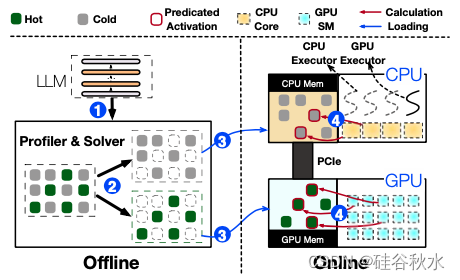

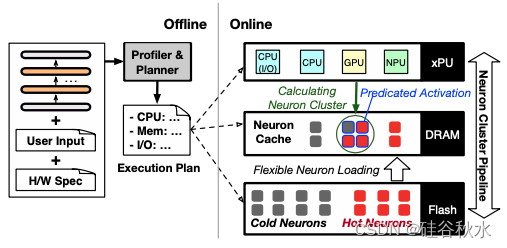

23年12月来自上交大的论文“PowerInfer: Fast Large Language Model Serving with a Consumer-grade GPU”。

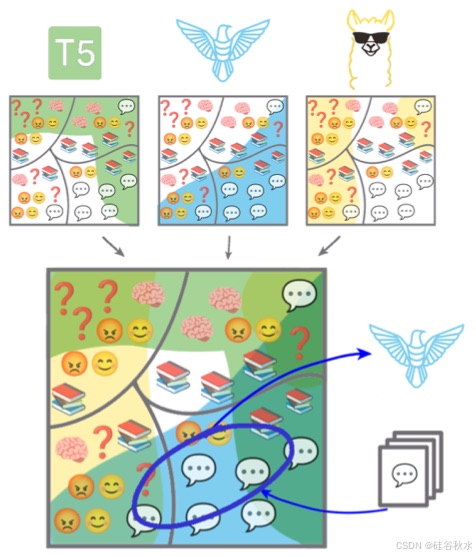

23年9月来自MIT和MIT-IBM实验室的论文“Large Language Model Routing with Benchmark Datasets”。

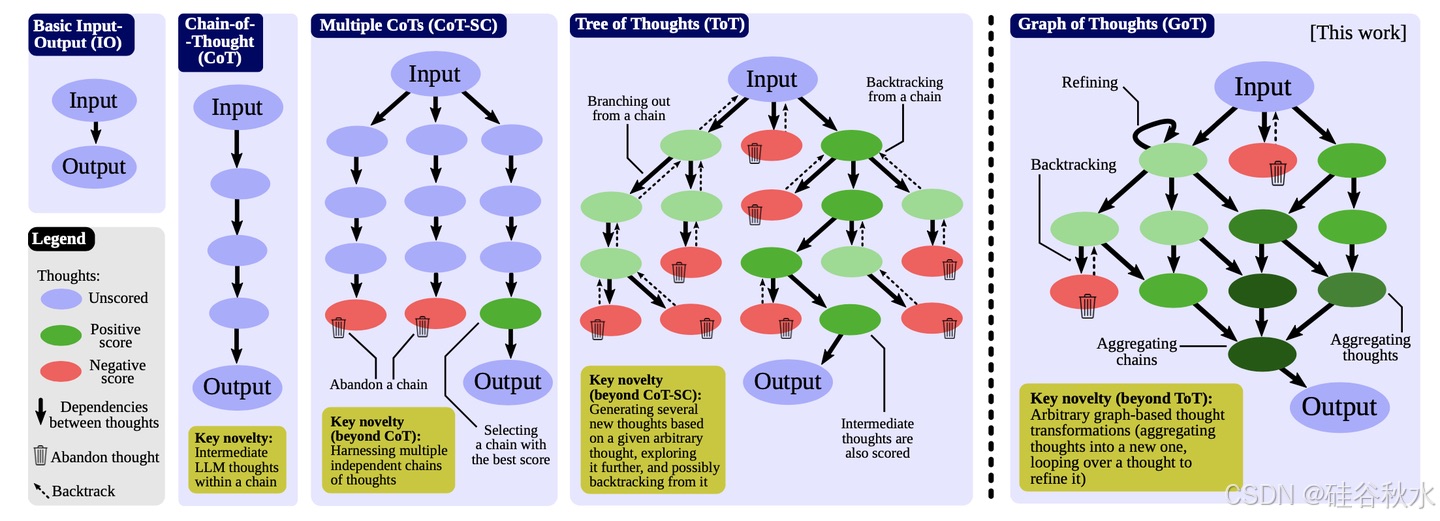

23年8月份来自瑞士和波兰的大学以及一个数据公司Cledar的大语言模型论文“ Graph of Thoughts: Solving Elaborate Problems with Large Language Models“。

24年6月来自上海交大的论文“PowerInfer-2: Fast Large Language Model Inference on a Smartphone”。

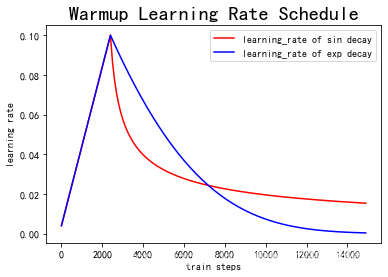

23年8月来自加拿大蒙特利尔大学的论文“Continual Pre-Training of Large Language Models: How to (re)warm your model?”。

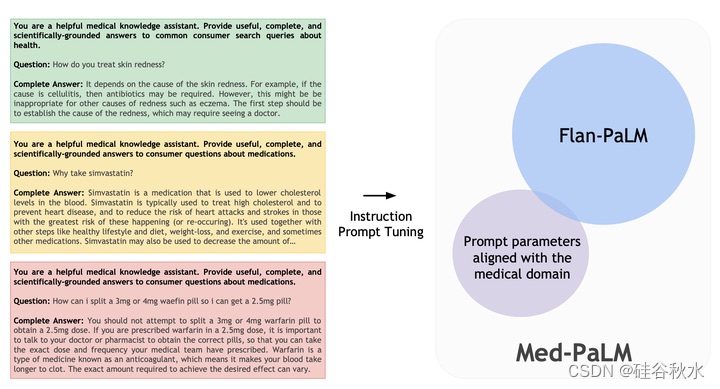

22年12月来自谷歌的论文“Large Language Models Encode Clinical Knowledge“。

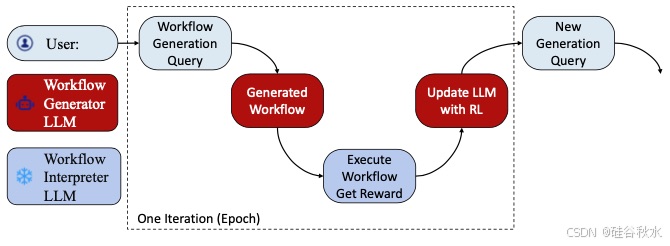

27年7月来自Rutgers大学的论文“AutoFlow: Automated Workflow Generation for Large Language Model Agents”。

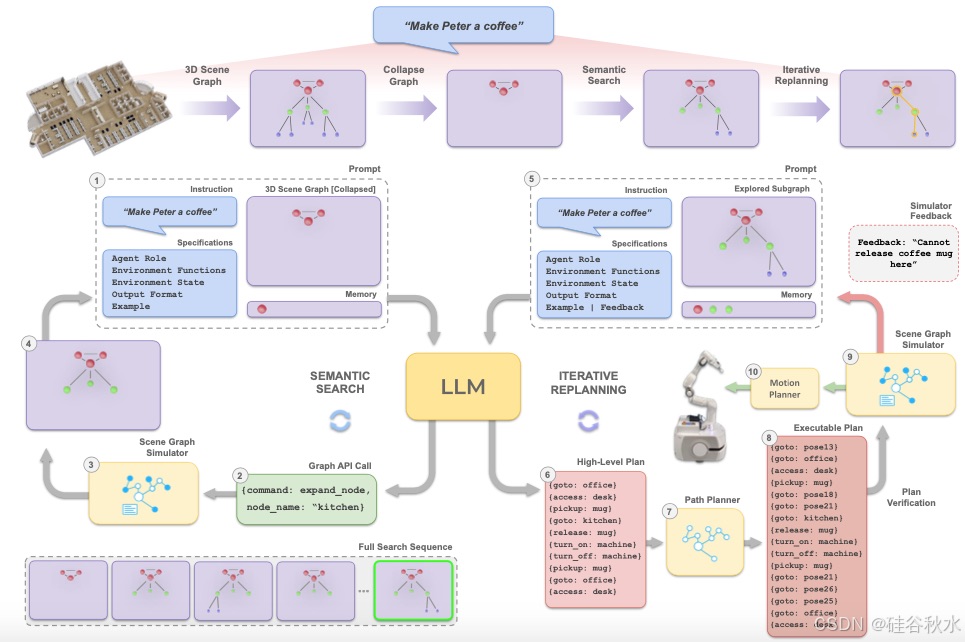

23年7月来自澳洲昆士兰科技大学和阿德莱德大学的论文“SayPlan: Grounding Large Language Models using 3D Scene Graphs for Scalable Robot Task Planning”。

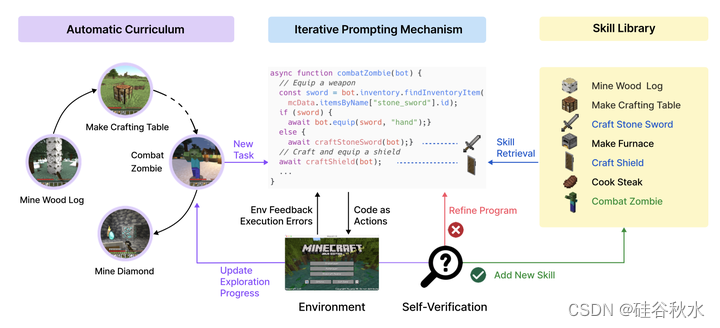

23年9月论文“VOYAGER: An Open-Ended Embodied Agent with Large Language Models“,来自英伟达和其他几所高校。