线性注意力(Linear Attention)

线性注意力是为解决标准Transformer固有算力缺陷而诞生的优化注意力架构,是高效注意力机制的重要分支。传统标准自注意力存在不可规避的平方级复杂度O(N²),而线性注意力通过数学变换、矩阵重排、核函数映射等手段,将时间复杂度与显存占用压缩至线性级别O(N)。该技术弱化冗余矩阵计算,以轻量化方式完成全局上下文建模,专门适配超长文本、超高分辨率图像、长时间时序信号等高密度序列任务。凭借低显存、低延

一、发展历程

线性注意力的诞生,本质是为了解决标准Transformer自注意力平方算力瓶颈,整体发展可划分为四个关键阶段,演进脉络清晰:

1.萌芽探索期(2018-2019):理论铺垫:研究者发现可通过核函数数学技巧规避Softmax指数运算,尝试降低注意力复杂度,但早期方案精度差、优化不成熟,行业主流仍依赖稀疏注意力。

2.正式诞生期(2020):概念确立:核心论文《Transformers are RNNs》问世,正式提出线性注意力范式,通过矩阵乘法结合律改写计算顺序,证明注意力可实现O(N)线性复杂度,奠定技术理论基础;同期Linformer等衍生模型落地验证可行性。

3.优化迭代期(2021-2022):缺陷修补:针对原生线性注意力远距离建模弱、精度下滑的问题,行业推出门控线性注意力、分块注意力等变体,增设门控机制、特征优化策略,缩小与标准自注意力的效果差距。

4.商用爆发期(2023-至今):产业落地:伴随长文本大模型、高清视频生成需求暴涨,线性注意力成为刚需技术;Delta Rule、Mamba、MiniMax混合注意力架构接连问世,广泛应用于Kimi、轻量化开源模型、长视频生成模型,成为工业界低成本实现超长上下文的核心方案。

二、核心定义

线性注意力是为解决标准Transformer固有算力缺陷而诞生的优化注意力架构,是高效注意力机制的重要分支。传统标准自注意力存在不可规避的平方级复杂度O(N²),而线性注意力通过数学变换、矩阵重排、核函数映射等手段,将时间复杂度与显存占用压缩至线性级别O(N)。该技术弱化冗余矩阵计算,以轻量化方式完成全局上下文建模,专门适配超长文本、超高分辨率图像、长时间时序信号等高密度序列任务。凭借低显存、低延时、高吞吐的特性,线性注意力现已成为端侧大模型、长上下文基座模型、视频生成模型不可或缺的底层核心技术。

三、传统自注意力痛点

标准Transformer架构依赖缩放点积自注意力机制,其核心运算逻辑为:针对输入序列中每一个Token,遍历全部Token计算相似度权重,最终生成N×N的全局注意力相似度矩阵。在短序列场景下,该结构可以精准捕捉词与词、像素与像素之间的关联,建模能力优异。但随着序列长度N不断增加,矩阵计算量、显存占用、读写带宽会呈平方级爆炸增长。在实际工程中,普通消费级显卡往往只能承载2048、4096长度的有限上下文;若处理十万级超长文档、4K高清图片、时长数十秒的视频序列,传统自注意力会因显存溢出、计算耗时过长而无法正常运行。因此,平方复杂度成为限制大模型上下文拓展、高清视觉生成、长时序建模的硬性瓶颈。

四、底层技术原理

线性注意力整体依托核函数映射+矩阵运算重排实现线性化简,全程不生成N×N稠密注意力矩阵,具体技术逻辑分为三点:

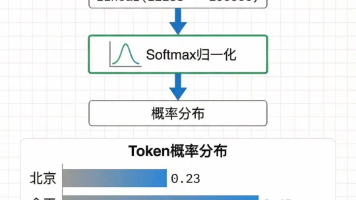

1.改写相似度计算方式:摒弃传统自注意力中非线性、计算成本极高的Softmax指数归一化函数。Softmax需要对全部Token进行指数运算与归一化,是平方算力的重要来源;线性注意力采用非负核函数对Q(查询向量)、K(键向量)进行特征映射,以简单线性运算替代指数运算,在数学层面简化相似度计算逻辑。

2.调换矩阵计算顺序:利用矩阵乘法结合律重构运算流程。标准自注意力计算顺序为 Attention = Softmax(QKᵀ)V,需先生成巨大的N×N矩阵;线性注意力改为优先运算KᵀV,提前聚合键值特征,生成固定维度的全局特征矩阵,再与Q相乘,彻底规避大规模稠密矩阵运算。

3.轻量化上下文聚合:模型将时序流动的K、V向量累积压缩为固定尺寸的全局状态缓存,不再单独存储每一组Token的注意力权重。在推理过程中持续迭代更新特征状态,以线性累加方式整合全局上下文信息,大幅降低内存读写开销,实现超长序列稳定推理。

五、核心优缺点

1.优点

•计算效率极高、算力成本低廉:去除稠密注意力矩阵后,计算量随序列长度线性平缓增长。尤其在超长序列场景下,相较于标准自注意力提速可达数十倍;同时减少显存占用与缓存读写压力,无需高额高端算力硬件,普通显卡、边缘芯片即可完成长序列推理,大幅降低工业落地成本。

•超长序列适配性强,上下文上限极高:不受平方复杂度约束,原生支持数万至百万级Token超长上下文。可完整载入整本书籍、海量行业文档、连续对话记录,无需滑动窗口截断文本,保障语义信息完整连贯,适配知识库问答、长篇文案生成、全文检索等业务。

•跨领域通用性广,适配多模态任务:不仅适用于自然语言处理,还可无缝迁移至计算机视觉、时序预测、生物建模、信号处理等领域。在图像任务中将像素视为序列,在视频任务中逐帧编码,统一简洁的计算逻辑,适配文本、图片、视频、传感数据等多类型输入。

2.缺点

•精细交互能力弱化,局部细节建模不足:舍弃Softmax归一化后,Token之间无法形成强弱差异化的精准权重分布。标准自注意力可以精准捕捉局部关键关联,例如专业术语、逻辑关联词、局部像素纹理;而线性注意力权重分布相对平滑,对细微、稀疏、强关联的局部特征捕捉能力偏弱。

•极端长距离依赖精度衰减:线性累加的特征模式会造成远距离信息稀释,在极长序列中,首尾相隔极远的Token关联强度下降。对于需要超长跨度逻辑推理、远距离因果关联分析的任务,原生线性注意力效果弱于标准自注意力,存在信息模糊、关联弱化的问题。

六、主流优化变体

针对原生线性注意力细节捕捉弱、远距离建模不足的固有缺陷,学术界与工业界持续迭代优化,衍生出多款高性能变体,在保留线性低算力优势的同时弥补精度短板。主流优化方案逻辑如下:

1.门控线性注意力:引入门控筛选机制,对重要特征加权强化、冗余特征抑制过滤,优化特征平滑问题,提升局部关键信息捕捉能力;

2.分块线性注意力:将超长序列切分为局部区块,块内高精度精细注意力计算,块间线性全局聚合,兼顾全局长度与局部细节;

3.Delta Rule:优化特征累积方式,剔除冗余重复特征,更新增量信息,缓解长序列信息稀释问题;

4.混合注意力架构:如Mamba、MiniMax架构,将线性注意力、稀疏注意力、标准自注意力相结合,短序列采用精准标准注意力,长序列切换为线性注意力,动态平衡计算效率与表达精度。

七、落地应用场景

•大语言模型(NLP):主打超长上下文业务,适配整本小说、学术论文、法律卷宗、海量知识库的无损解析与问答;支持上万轮连续对话、长代码文件编译分析,无需对文本进行截断分片,保持逻辑完整性。主流长文本模型如Kimi、开源轻量化LLM均大规模采用线性注意力及其变体。

•计算机视觉(CV):应用于超高分辨率图像修复、高清图像生成、4K及以上长时序视频生成。将图像像素、视频帧转为长序列编码,依靠线性复杂度突破分辨率限制,避免高分辨率下显存爆炸,保障画面纹理细腻、时序动作连贯。

•专业科学数据分析:适配超长连续结构化序列,包含DNA基因生物序列、股票期货金融长时序走势、工业传感器连续采样数据、气象水文监测信号。依托线性注意力稳定建模超长周期变化规律,用于趋势预测、异常检测、规律挖掘。

•端侧轻量化模型部署:线性注意力算力开销低、显存占用小,适配手机、嵌入式芯片、物联网终端等低算力设备。用于端侧离线AI问答、本地图像编辑、移动端实时视频处理,实现轻量化智能服务,降低终端硬件门槛。

八、行业定位

线性注意力是无Transformer架构、高效注意力机制的核心分支,区别于稀疏注意力,它以纯线性运算实现全局上下文建模,是突破大模型上下文长度限制、降低算力成本的关键前沿技术,广泛应用于轻量化开源模型、长视频生成模型、具身智能感知模型中。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)