智体AI的适应性:关于后训练、记忆与技能的综述(下)

26年3月来自如下UIUC等单位的论文“Adaptation of Agentic AI: A Survey of Post-Training, Memory, and Skills”。大语言模型(LLM)智体正迈向超越单纯“提示工程”的更高阶段。ChatGPT 标志着通用型 LLM 助手的崛起;DeepSeek 证明,结合可验证奖励的策略

26年3月来自如下UIUC等单位的论文“Adaptation of Agentic AI: A Survey of Post-Training, Memory, and Skills”。

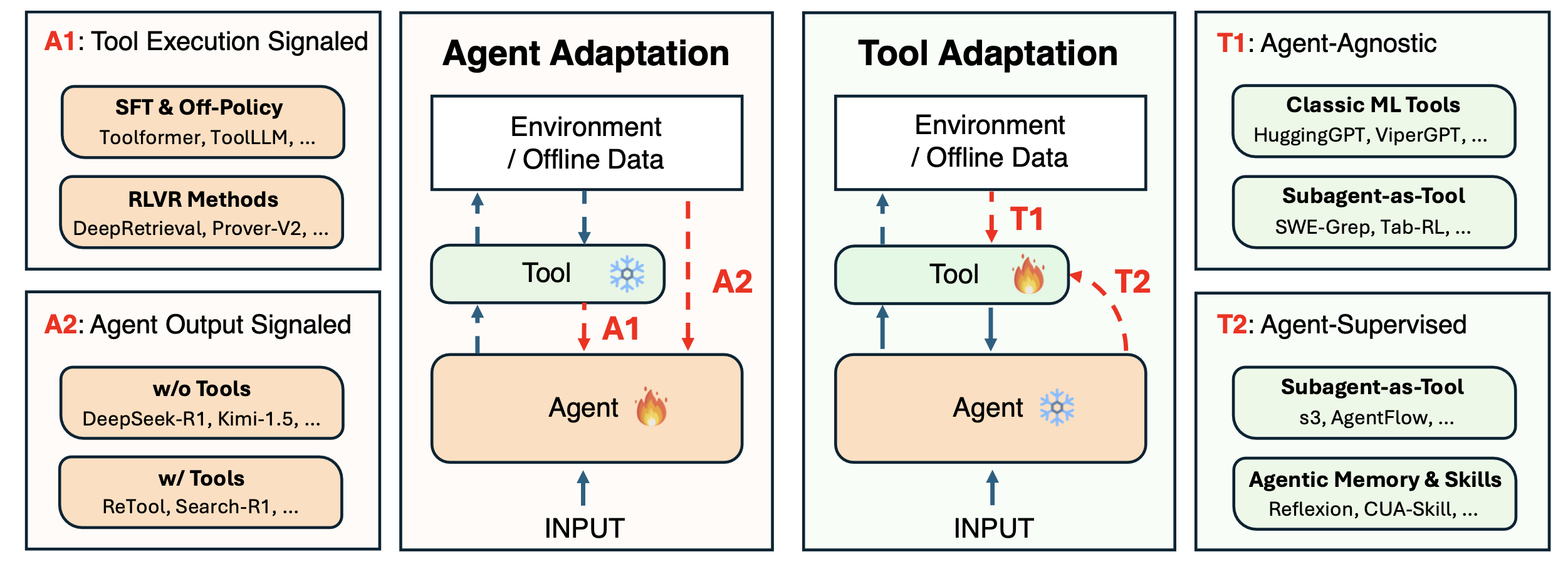

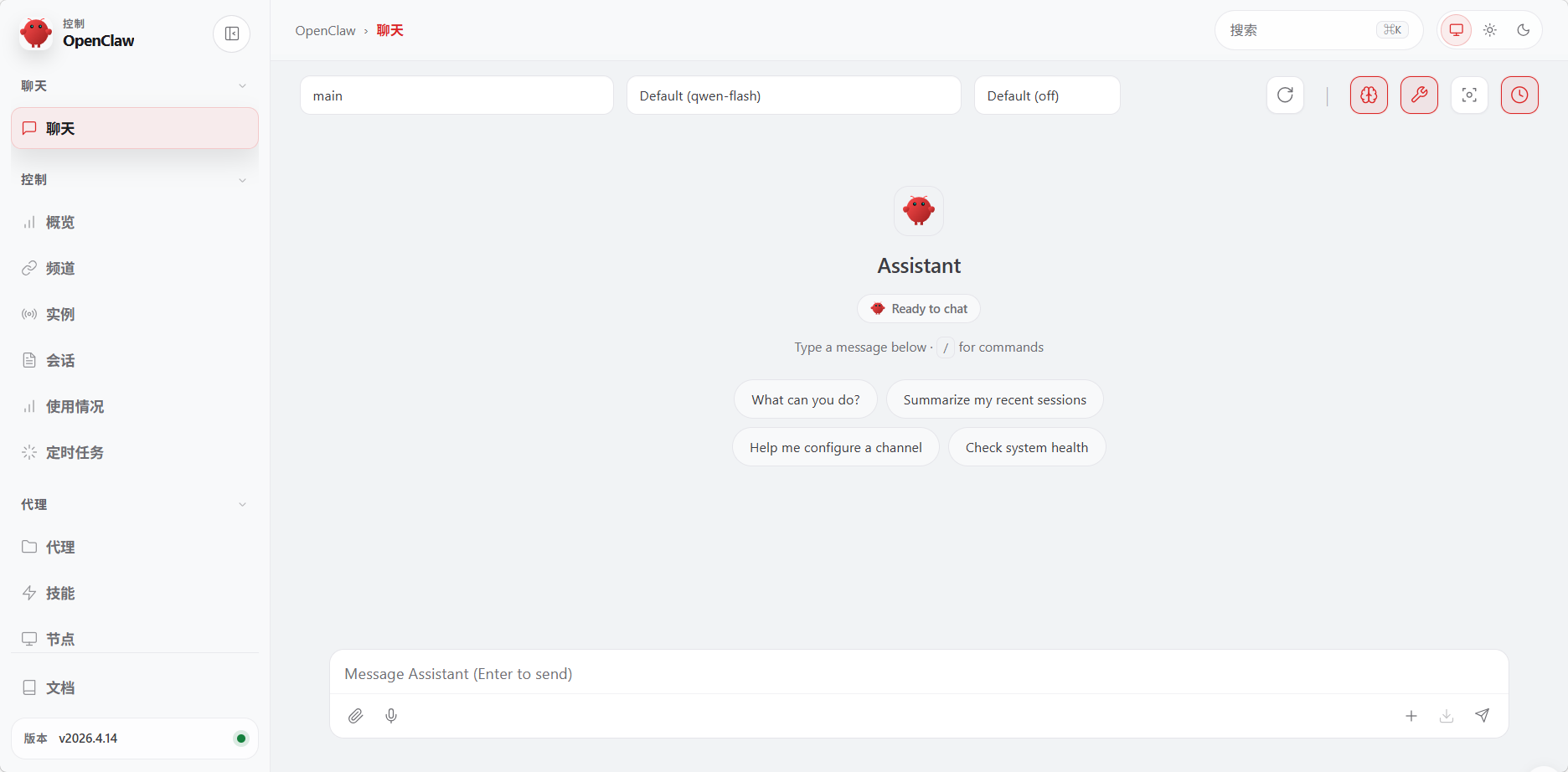

大语言模型(LLM)智体正迈向超越单纯“提示工程”的更高阶段。ChatGPT 标志着通用型 LLM 助手的崛起;DeepSeek 证明,结合可验证奖励的策略内强化学习能够提升模型的推理能力与工具使用效能;而 OpenClaw 则揭示一个新兴的研究方向:智体能够积累持久性记忆与可复用技能。然而,当前的研究格局在后训练、信息检索、记忆机制及技能系统等多个领域之间仍显分散。本综述将上述各类进展统一归纳于一个核心概念之下——即“适应”(Adaptation):指在预训练阶段结束之后,通过各种手段对智体本身、其所使用的工具,或二者之间的交互方式进行优化与提升。本文构建一个涵盖“智体适应”与“工具适应”两大维度的四范式框架,以此对该研究领域进行系统性梳理。在智体适应维度上,A1 范式(基于工具执行信号)与 A2 范式(基于智体输出信号)通过运用监督微调、偏好优化以及基于可验证奖励的强化学习等技术,实现对智体自身能力的提升。在工具适应维度上,T1 范式(智体无关型)提供一系列可复用的预训练模块,供任何智体调用;而 T2 范式(智体监督型)则利用智体的输出结果作为监督信号,用于训练记忆系统、技能库或轻量级子智体(subagent)。基于这一框架,其对后训练方法、自适应记忆架构以及智体技能进行全面回顾;对比分析各类方案在成本、灵活性与泛化能力方面的权衡取舍;并总结在深度科研、软件开发、计算机辅助操作及药物发现等应用场景中的评估实践。最后,对智体与工具的协同适应、持续学习、安全性保障以及高效部署等领域中尚待解决的开放性问题进行展望。

如图 1 概览这个适配:

。。。。。。继续。。。。。。

工具自适应将优化目标从智体本身转移到其生态系统上。这种范式不再通过微调或强化学习来修改智体的内部参数,而是针对智体通过语言或代码调用的外部组件(如预训练模型、检索器、规划器或执行器)进行优化。属于此类的方法主要包括两类:(1) 将预训练的机器学习模型用作“即插即用”的组件——其范围涵盖从简单的分类器到基于大语言模型(LLM)的复杂子智体;(2) 利用智体的输出作为监督信号或强化信号,进而对工具本身进行训练、对齐或精调。

形式化地,设 A 表示一个智体,其行为由内部配置或策略(包括提示模板或模型权重)所参数化;设 T 表示一个或一组工具,这些工具可基于任务反馈进行训练或优化。这一自适应过程可由两种互补的范式来刻画:

(T1) T ∗ = argmax_T O_tool(T),(T2) T ∗ = argmax_T O_agent(A,T),

其中,O_tool 用于量化那些独立于智体本身的、由具体任务或环境驱动的改进指标(例如检索准确率或规划效率);而 O_agent 则引入源自智体的监督信号,即利用智体的输出作为学习信号,来对工具进行精调或对齐。在此,T ∗ 表示经过优化后的工具配置,即能够使相应目标函数达到最大值的工具配置;这生动地展示在更广阔的“智体—工具”生态系统中,工具自适应是如何与智体层面的优化相辅相成的。

1. T1:与智体无关的工具适配

工具增强系统的基础架构采用预训练模型作为“即插即用”的工具,供固定的(即参数冻结的)智体使用。智体仅通过提示词(prompting)来编排工具的使用,其自身的参数从未更新;与此同时,它所依赖的工具均是在部署前利用多样化的数据源独立训练而成的。

尽管 T1 是最直接的范式(任何智体能够调用的预训练模型均符合此列),但它提供所有其他范式赖以构建的组合基础:A1/A2 智体调用 T1 工具,T2 子智体往往由 T1 组件初始化,而“毕业生命周期”(A1→T1)则持续丰富着 T1 的生态系统。因此,理解 T1 的设计空间对于整个框架而言至关重要。

基础系统与架构

早期的系统确立架构基础,规定固定的智体应如何编排外部模型。这些研究工作展示多种独特的机制(包括函数式、基于提示词、基于代码以及基于图的机制),共同塑造现代工具增强型 AI 系统的设计空间。

算子学习工具:神经算子(Neural Operators)[125] (JMLR)。在大规模基于大语言模型(LLM)的编排技术兴起之前,神经算子便已作为“与智体无关的工具学习”的一个早期范例而存在:这些模型经过训练,旨在近似无限维函数空间之间的映射关系,并可充当复杂模拟器的可微分替代品。

与受限于离散网格的传统神经网络不同,神经算子具有“离散化不变性”:它们学习的是底层的算子本身,而非其有限的离散化表示;因此,它们能够在不同的分辨率和几何结构之间实现泛化。傅里叶神经算子(FNO)通过谱卷积实现 O(J log J) 的推理复杂度,且在求解 Navier-Stokes 方程、Darcy 流方程以及弹性力学方程时,其速度较经典求解器快数个数量级。FNO 及其变体(如图神经算子、低秩神经算子、多极神经算子等)构成第一波“固定工具”的浪潮——智体无需重新训练,即可反复调用这些工具来进行推理、规划或控制。在现代智体工作流中,它们充当着“插件式替代品”的角色:即在决策或推理循环内部被调用的、高速且可微分的黑盒函数。 HuggingGPT [126] (NeurIPS 2023) 引入一种编排范式,允许 ChatGPT 无需任何微调即可指挥来自 HuggingFace Hub 的 1000 多个机器学习模型。该冻结的大语言模型(LLM)执行一个四阶段的工作流:任务规划(分解用户请求)、模型选择(基于工具描述进行选取)、任务执行(调用模型)以及响应生成(综合输出结果)。该架构表明,仅凭自然语言编写的工具描述,便足以让该冻结智体协调复杂的跨模态工作流。在复合型跨模态任务上,HuggingGPT 证明通过编排专门的视觉、语音和语言模型,能够有效弥合 GPT-3.5 与体量更为庞大的多模态模型之间的性能差距。其主要局限性在于:连续调用 LLM 所产生的延迟,以及工具描述受限于 Token 长度的约束。ViperGPT [127] (ICCV 2023) 则引入代码生成作为其编排机制。该冻结的 GPT-3 Codex 模型能够生成 Python 代码,将各类视觉模型(如用于目标检测的 GLIP、用于图像分割的 SAM 以及用于深度估计的 MiDaS)组合成可执行的程序。这种基于代码的方法在 GQA 视觉推理任务上取得优异的零样本(zero-shot)性能,在复合型任务上的表现较端到端模型提升 10% 至 15%。相较于固定的 API 调用模式,Python 函数提供更为灵活的工具组合方式。每个工具仅对外暴露诸如 find(image, object_name) 或 compute_depth(image) 之类的简单函数接口,而 Codex 则通过编程方式将这些函数串联起来,无需预先学习各工具特有的复杂接口规范。SciToolAgent [128] (Nature Computational Science 2025) 通过基于图结构的组织方式,将工具编排的应用范围拓展至科学研究领域。该冻结的 GPT-4o 模型通过 SciToolKG 访问 500 多个涵盖生物学、化学及材料科学领域的工具;SciToolKG 是一个知识图谱,其中编码了各类工具的元数据、依赖关系以及安全约束信息。在科学查询基准测试中,基于图结构的工具检索方法在工具选择环节取得高达 94% 的准确率,相较于未获工具访问权限的 GPT-4o 模型,其性能提升 15% 至 20%。该系统成功实现蛋白质工程工作流的自动化,通过串联 ESMFold(用于结构预测)、BLAST(用于序列比对)以及各类自定义分析工具,完成整套工作流程。事实证明,结构化的知识图谱能够有效解决基于提示词(prompt)进行工具描述所固有的可扩展性难题。

上述这些基础性系统,共同展示当前主流的集成范式。 HuggingGPT 堪称基于提示的编排模式的典范,在该模式下,智体(Agent)能够从文本中解析出工具调用指令。ViperGPT 则采用代码生成技术,将各类工具封装并暴露为 Python 函数。SciToolAgent 运用知识图谱检索机制,借助 RAG(检索增强生成)技术,从结构化的工具图谱中进行工具选取。第四种常见的模式是“多模态桥接”,其核心在于将非文本模态的信息转化为文本表征;例如,Visual ChatGPT [129] 的提示管理器便能将视觉操作序列化为文本形式的 API 调用。这些模式的可用性取决于清晰的接口设计,例如程序化的函数签名(如 find_object(image: PIL.Image, ...))、结构化的 JSON 模式(schemas),或简单的自然语言描述。其执行模式同样多种多样,涵盖从直接 API 调用、代码生成,到 HTTP 请求和命令行调用等多种方式。

模型上下文协议(MCP)与代码执行环境 [130]。随着大规模智体生态系统开始连接成千上万种异构工具,模型上下文协议(MCP)应运而生,成为一种统一智体与外部系统交互方式的开放标准。MCP 提供一个通用的 API 层,允许“冻结”状态的智体(即参数固定的智体)利用一致的模式跨领域发现、调用并协调各类工具,从而避免将冗长的工具定义直接嵌入到模型的上下文之中。Anthropic 提出的“基于 MCP 的代码执行”范式引入一种以执行为核心的设计理念:智体通过编写可执行代码来与 MCP 服务器进行交互,而非执行基于 Token 粒度的工具调用。借此,智体仅需加载必要的工具定义,即可在沙箱环境中对数据进行过滤或聚合,并将精简后的结果回传给模型;这一机制在保留工具组合能力的同时,大幅降低对模型上下文资源(Context)的占用。MCP 代表一种可扩展的 T1 级工具适配基础设施,实现执行过程与推理过程的解耦;而其所采用的代码执行模式,则通过在“冻结”智体架构下动态提升执行效率,为向 T2 级优化演进搭建桥梁。

类别与训练方法论

尽管前述系统定义智体调用工具的具体方式,但究竟选择部署何种模态的工具,将直接决定整个工具适配体系的形态与特征。

工具适配涵盖多种类别的预训练模型。依据模态对这些模型进行归类,并重点阐述其训练方法论如何决定其对 T2 级优化的适应程度:那些能够生成结构化、可评估输出(如代码、检索结果)的模型,最易于自然地升级至 T2 级,因为“冻结”状态的智能体能够自动对其输出结果进行评分;相比之下,那些生成感知特征(如视觉、语音特征)的模型则较难通过 T2 级机制进行监督与优化,目前主要仍作为 T1 级的插件工具发挥作用。

在 T1 级的部署场景中,视觉模型作为即插即用的工具占据主导地位。以 CLIP [131] 为例,该模型基于 4 亿对图像-文本数据对采用对比学习的方式进行训练,并通过其“冻结”状态的编码器,实现零样本分类(Zero-shot classification)与语义理解能力。 SAM [132] 经由“人机协作”(human-in-the-loop)数据引擎,利用 1100 万张图像及 10 亿个掩码进行训练,能够支持基于点、框或掩码输入的提示式图像分割。SAM-CLIP [133] 通过采用“冻结教师模型”的多任务蒸馏技术,将上述能力进行融合;该模型在 Pascal VOC 数据集上进行零样本语义分割任务时,mIoU(平均交并比)提升 6.8%,且同时保留两个父模型的优势。这些视觉工具无需进行针对特定任务的微调——“冻结智体”(frozen agents)可直接通过 API 调用它们,以执行图像理解、分割及分类等任务。

语音与音频工具依赖于大规模预训练,从而实现稳健的性能表现。Whisper [134] 利用 68 万小时的多语种音频数据(辅以弱监督信号)进行训练,能够作为一种“冻结 API”为多模态智体提供语音识别、翻译及语言识别等服务。其采用的编码器-解码器 Transformer 架构支持跨语言、跨领域的零样本转录任务,且对口音、背景噪声及专业术语具有极强的鲁棒性。智体只需将音频输入传递给已冻结的 Whisper 模型,随后即可直接处理其输出的文本结果,无需对模型本身进行任何适配调整。

代码执行工具涵盖那些能够通过编写及执行代码来学习如何组合并调用各类功能的模型。CodeAct [58] 的研究表明,若将工具的使用逻辑以可执行的 Python 代码而非静态 JSON 格式进行表征,将有助于提升模型的组合推理能力;在 API-Bank 基准测试中,该方法的任务成功率提升 20% 以上。代码所具备的动态特性,使得智体能够以灵活的方式构建、参数化并组合各类工具,而无需受限于预先定义的固定模式(schemas)。

搜索与检索工具主要包含一系列预训练的稠密检索模型,例如 DPR [135]、ColBERT [136]、Contriever [137] 以及 e5 [138] 等;这些模型通常作为“冻结组件”被部署于“检索增强生成”(RAG)流水线之中。作为一种双编码器模型,它们通过在段落排序任务上进行训练,从而具备在大规模语料库中执行语义搜索的能力。

科学工具则将人工智能的能力拓展至各类专业领域。AlphaFold2 [139] 与 ESMFold [140] 能够依据氨基酸序列预测蛋白质的三维结构。CGCNN [141] 等材料科学模型则可用于预测晶体的各类物理化学性质。此外,研究人员还开发一系列分子表征学习方法 [142–148],旨在实现对分子性质的精准预测;而另一些编码器-解码器框架 [149, 150] 则致力于预测由化学扰动所引发的细胞转录组变化特征。这些工具凝聚多年的特定领域模型开发成果,并被原封不动地部署,供“冻结智体”(frozen agents)用于处理科学查询。

除了这些静态模型之外,自适应智体(如用于搜索查询重写的 DeepRetrieval [22] 和用于代码生成的 Code-R1 [66])展示经过训练的推理智体本身如何充当动态工具。一旦被“冻结”(即参数固定),它们便通过重构查询、生成可执行代码或执行推理驱动的动作来扩展工具生态系统,从而弥合预训练模型与外部环境或离线数据之间的鸿沟。

2. T2:智体监督下的工具自适应

T2 范式颠覆传统的自适应问题:它不再询问“我们该如何修改智体,使其能更好地利用工具?”(即 A1/A2 范式所关注的问题),而是转而询问“我们该如何修改工具,使其能更好地服务于一个固定的智体?”这种视角转换将那些计算成本高昂且结构庞大的基础模型重新定位为稳定的监督信号来源,而非优化的目标对象。

训练或微调拥有数十亿参数的基础模型不仅计算成本极高,还面临着“灾难性遗忘”的风险。相比之下,外围工具(如检索器、规划器、记忆模块等)的规模要小上几个数量级,且训练成本也低得多。T2 范式正是充分利用这种不对称性:被冻结的智体基于其预训练知识提供监督信号,而各类工具则负责学习如何将信息重塑为智体最易于利用的形式。

T2 方法在 2023 至 2025 年间的发展演变,呈现出一条清晰的进阶路径:从最初利用内部智体信号(如困惑度、偏好反馈等)来训练被动的检索工具,逐步演进为利用可验证的最终结果信号(如任务成功率、准确率提升幅度等)来训练具备主动性且支持多轮交互的智能体辅助工具。

早期方法:从智体信号到结构化偏好

最早的 T2 方法脱胎于 RAG(检索增强生成)社区,该领域的科研人员致力于优化稠密检索器,以使其能更好地与大型语言模型(LLM)协同工作。这些早期研究确立一项基本原则:被冻结的语言模型其内部计算过程本身即可作为一种监督信号;但与此同时,这些研究也暴露出过度依赖智体指标所带来的局限性——这些智体指标往往无法与下游任务的最终目标完全对齐。

REPLUG [11](NAACL 2024)提出一种通用的框架,旨在通过“黑盒监督”的方式对已冻结的语言模型进行自适应调整;该框架利用“困惑度降低”作为训练信号,来指导检索器的优化过程。其核心逻辑在于:如果将检索的文档作为条件输入给语言模型后,该模型针对特定查询所表现出的困惑度有所下降,那么这篇文档便极有可能提供极具参考价值的上下文信息。形式上,检索器经过优化,旨在使其检索分布与由语言模型(LM)基于困惑度的偏好所诱导的分布相一致:

L_REPLUG = D_KL(P_retriever(d|q) || P_LM-perplexity(d|q)) ,

其中 P_LM-perplexity(d|q) 反映在给定查询 q 的条件下,每一篇文档在多大程度上降低语言模型的困惑度。因此,REPLUG 实现无需访问语言模型内部参数即可进行检索自适应的能力,从而确立一类“智体监督”(agent-supervised)方法家族,这类方法仅依据来自冻结智体的反馈来优化外部模块。BLADE [151] (AAAI 2025) 进一步扩展了这一范式,它用能够合成辅助知识的域特定模型取代传统的检索器:该方法将一个冻结的通用大语言模型(LLM)与一个通过“贝叶斯提示优化”(BPO)进行优化的、小型的域特定语言模型相结合。这个小型语言模型负责学习生成与该领域相关的知识及“软提示”(soft prompts),以此来改善黑盒大型语言模型的响应效果;这使得 REPLUG 的黑盒自适应原理得以从单纯的检索环节,扩展至生成式、域特定工具的协同自适应环节。BBox-Adapter [152] (ICML 2024) 将自适应问题重新构建为一种基于能量的模型构建问题,并引入一种基于排序的“噪声对比估计”(NCE)损失函数以及一套在线更新框架,旨在无需访问内部概率数据的前提下,实现与 GPT-3.5 等黑盒 API 输出结果的对齐。上述方法共同推动研究焦点的转移——即从基于似然度的对齐转向基于效用驱动的自适应,这也预示并铺垫随后涌现的、基于强化学习的搜索与推理框架。proxy-tuning [153] (COLM 2024) 将黑盒、智能体监督式的自适应技术进一步扩展至解码阶段:一个经过微调的小型“专家模型”及其未经微调的“反专家模型”共同提供 Logit 偏移量,以此在不修改权重参数的前提下引导一个冻结的大语言模型;这实质上是在一个冻结的智体(T2)之上,训练一个轻量级的引导工具。EVOR [154] (EMNLP 2024) 则将这一理念进一步延伸至代码生成领域,它将检索与知识演化过程构建为一个协同自适应过程,而这一过程的驱动力则源自冻结大型语言模型所提供的执行反馈。

偏好学习:迈向任务对齐尽管像 REPLUG 和 BBox-Adapter 这样的黑盒自适应方法依赖于困惑度或排序得分等间接代理信号,但随后的研究 [29, 155–158] 已转向基于显式偏好的监督机制,这种机制能更有效地反映任务效用。AAR [29](ACL 2023)引入“增强-觉察检索”(augmentation-aware retrieval)机制:在该机制中,一个参数冻结的源语言模型(Flan-T5-250M)通过对比那些能最大程度提升其自身似然度的文档与人工标注的参考文本,从而构建出偏好对。随后,检索器通过对比损失(contrastive loss)进行训练,以复现这些偏好;由此产生的信号直接编码语言模型(LM)对于“有用上下文”的内在认知。这些源自语言模型的偏好能够有效地跨架构和规模进行迁移,甚至能提升参数量高达1750亿的模型性能。RA-DIT [155](ICLR 2023)将这一理念形式化,把文档效用定义为生成正确答案时所带来的对数概率增益:

Utility(d, q, a) = log P_LM(a|q, d) − log P_LM(a|q),

并通过训练使检索器倾向于选择那些能带来更高预期增益的文档。这种基于偏好的方法将检索过程与下游推理目标更加直接地对齐,同时仅需对冻结的语言模型执行单次前向传播即可完成操作。综合来看,上述研究标志着一种概念上的转变:即从基于智体指标的监督方式,转向与具体任务直接对齐的监督方式;这为后续框架中引入类强化学习的反馈机制以及多轮优化奠定基础。

多阶段架构:提炼复杂偏好。LLM-R [24] (EACL 2024) 引入一种多阶段蒸馏流水线,旨在提升训练信号的保真度。LLM-R 并未直接利用冻结语言模型(LM)的输出去训练检索器,而是首先训练一个中间的交叉编码器式“奖励模型”,以此捕捉冻结 LM 在处理上下文示例时所体现的细微偏好。由于该奖励模型仅在训练阶段使用,因此可以容忍较高的计算开销并具备更强的表达能力;随后,该奖励模型被蒸馏(知识蒸馏)为一个高效的双编码器式检索器。其核心洞见在于:训练信号的复杂性无需受限于推理阶段的效率要求。通过将偏好建模过程与最终的检索工具解耦,LLM-R 实现高质量的监督信号与快速部署的兼顾。

UPRISE [159] (EMNLP 2023) 将这一范式从文档检索领域拓展至提示词(Prompt)检索领域,利用冻结大语言模型(LLM)在各类任务上的实际表现,训练出一个专门用于检索提示词的检索器。通过在多个任务上进行同步训练,UPRISE 学习一项具有泛化能力的元技能:即在零样本(Zero-shot)设置下,挑选出能够有效提升 LLM 性能的提示词。跨任务迁移实验结果(阅读理解任务性能提升 8.5%,释义检测任务性能提升 14.6%)表明,经跨任务训练(T2-trained)的工具能够内化“何种输入有助于语言模型工作”这一抽象原则,而非仅仅死记硬背针对特定任务的启发式规则。

步入 2024 年,业界达成一项共识:仅孤立地优化检索环节是远远不够的。即使是那些在传统信息检索(IR)指标(如 NDCG、MRR)上表现优异的检索器,其产生的检索结果也未必适合 LLM 进行推理。基于这一观察,研究人员开始着力开发各类“桥接工具”——包括重排序器、查询重写器以及文档选择器——旨在将检索系统的输出结果调整得更契合 LLM 的偏好与需求。

偏好转换架构。BGM [160] 旨在弥合一种系统性的“偏好鸿沟”:即传统检索器所优化的目标(如表面层面的相关性、词汇重叠度)与 LLM 进行推理时真正所需的要素(如上下文连贯性、推理支撑度)之间存在的差异。BGM 的解决方案是训练一个 T5-XXL 规模的“桥接模型”,将其置于冻结检索器与冻结生成器(PaLM2-S)之间,从而将检索器输出的原始结果转化为一种更利于 LLM 消费与利用的上下文信息。第一阶段利用合成生成的偏好数据(即有助于提升 LLM 任务表现的文档与无助文档的对比)进行监督学习;而第二阶段则采用强化学习,其中已冻结参数的 LLM 在最终任务上的成功与否将作为奖励信号。在 HotpotQA 数据集上,该桥接系统取得 35.6% 的精确匹配准确率(Exact-Match Accuracy),相比之下,此前表现最佳的检索器仅为 25.8%,实现 38% 的相对提升。

BGM 模型表明,专门设计的适配层往往比端到端的微调更为有效。BGM 并未强求单一的检索器同时满足信息检索(IR)指标与 LLM 的偏好,而是将这一问题进行拆解:由检索器负责实现广度召回,而桥接模型则负责处理偏好对齐。这种模块化的设计理念,同样体现在当前最为成功的 T2 系统之中。

综合分析:多工具生态系统。上述各项进展揭示一种特定的架构模式,即“级联式工具适配”。当前最先进的 T2 系统普遍采用一种由各类专用工具(包括查询重写器、检索器、选择器等)构成的流水线架构;其中,每一个工具均利用已冻结参数的 LLM 在不同层面的行为表现作为监督信号进行训练。这种任务拆解的设计带来多重优势:

• 关注点分离:每个工具均可专注于优化特定的子问题(例如,在召回率与精确率之间进行权衡,或在运行速度与结果质量之间寻求平衡)。

• 可组合性:各类工具之间可实现灵活的混搭与组合;例如,在无需对检索器进行重新训练的前提下,即可单独训练并替换新的重排序器。

• 高效性:计算开销巨大的操作(如 LLM 推理)被推迟至流水线的末端执行,从而允许位于前段的低成本工具预先对搜索空间进行过滤与缩减。

目前尚存的一个开放性问题是:在级联过程中,随着误差的逐级累积,该工具层级架构的深度究竟能延伸至何种程度,才不至于让累积误差的负面影响抵消掉其所带来的收益。现有的实证结果表明,包含 2 至 3 个工具适配阶段的架构(例如:查询重写器 → 检索器 → 重排序器)往往能够实现一种较为理想的平衡状态。

作为工具的子智体

2025年标志着T2研究领域发生一次转型:研究重心从训练反应式工具(即响应查询的检索器)转向训练主动式子智体(即能够跨多个轮次自主地进行探索、规划、编排及优化自身操作,同时服务于“冻结”状态的主智体的自主系统)。这一转变得益于RLVR技术的进步,其应用范围不仅局限于信息检索,还延伸至工作流编排和记忆管理等元认知过程。这一演进过程可归纳为四大类子智体家族:(i) 智体式搜索器,(ii) 记忆构建子智体,(iii) 元认知规划与编排子智体,以及 (iv) 自演化子智体。

智体式搜索器。s3 [28](EMNLP 2025)的研究表明,训练智体式工具在数据利用效率上,要远高于训练智体式大语言模型(LLM)。该系统训练一个轻量级的7B参数量“搜索器”,用于执行多轮迭代搜索任务:生成查询、检索文档、筛选证据,并决定是继续搜索,还是将上下文信息输入给处于“冻结”状态的生成器。该“冻结”生成器(即主智体,具体模型为Qwen2.5-14B或Claude)在训练过程中参数始终保持不变,但它通过一个名为“超越RAG的增益”(Gain Beyond RAG,简称GBR)的指标,提供最终的训练信号:

GBR = 准确率 (G_frozen(q, D_s3), a) − 准确率 (G_frozen(q, D_naive), a)

其中,D_s3 代表由经过训练的搜索器所检索的文档集;而 D_naive 则代表通过朴素的 Top-k 检索方法所获取的文档集。

这一奖励信号直接衡量该搜索工具所带来的增益价值,从而将训练重心聚焦于那些朴素检索方法失效的案例上。s3 仅凭2400个训练样本,便实现58.9%的平均生成准确率;这一数据量仅为 Search-R1(一种A2风格的智体,需17万个训练样本)所需数据量的七十分之一(1/70),且其实际训练耗时(Wall-clock time)也比后者快33倍。在针对特定领域的医学问答(QA)任务中,利用通用问答数据训练而成的 s3 取得76.6%的准确率,优于 Search-R1 的71.8%;这一结果表明,通过T2范式训练出的工具,其所学习的搜索技能具有更强的泛化能力,优于那些采用端到端方式训练的智体。这种效率优势之所以产生,是因为 A2 风格的智体训练必须同时学习 (1) 领域知识、(2) 工具使用技能以及 (3) 针对特定任务的推理能力,从而形成一个高维度的优化景观。而在 T2 架构中,冻结的生成器已然具备领域知识和推理能力,因此工具只需学习执行高效搜索所需的程序性技能即可。

与这一理念异曲同工的是,DynamicRAG [161](NeurIPS 2025)将重排序过程进行“智体化”处理:它摒弃静态的重排序方式,转而采用一种基于强化学习(RL)的策略,根据查询的难度和检索结果中的噪声水平,动态调整需要传递的文档数量及具体内容,从而在信息质量与上下文成本之间取得平衡。其训练过程融合两种技术:一是基于专家轨迹的模仿学习(旨在为智体提供合理的行为引导),二是策略梯度强化学习(其中奖励信号由生成器的输出结果提供)。经过训练后,该策略展现出一种涌现式的自适应行为:对于那些查询简单且初始检索质量较高的任务,它会选择呈现较少的文档;而对于那些查询复杂且检索结果噪声较大的任务,它则会扩大检索范围,并采取更为激进的重排序策略。

QAgent [162] 进一步阐明如何以稳健的方式训练此类搜索子智体。其第一阶段(Stage 1)采用端到端的方式训练一个拥有 30 亿参数的搜索智体,并根据该智体自身生成的答案是否正确来给予奖励;然而,这种做法容易诱发“奖励作弊”(reward hacking)现象——即智体倾向于选择那些浅显且易于直接复制的证据,而非那些真正具有丰富信息量的文档。其第二阶段(Stage 2)通过切换至由一个能力更强的“冻结生成器”所主导的评估机制,从而纠正上述弊端:

R_Stage2 = I[G_frozen(q, D_agent) = a_correct]

即仅当该冻结模型能够利用搜索智体所检索的文档正确回答问题时,才给予该搜索智体奖励。这种解耦设计迫使子智体必须致力于优化检索结果的质量,而非仅仅追求自身的短期利益或局部最优行为;这也进一步印证 T2 架构的一项核心原则:冻结生成器不仅应作为工具输出结果的消费者,更应作为工具学习过程的监督者。

作为子智体学习构建记忆。除了搜索功能之外,另一条互补的研究路径将“构建长期记忆”这一过程本身,视作一个典型的 T2 风格子智体问题来加以解决。Mem-α [163] 将记忆管理任务建模为一个基于显式记忆 API 的强化学习问题;它训练一个轻量级的 Qwen3-4B 控制器,使其能够为一个冻结的后端生成器操控一套由三部分构成的外部记忆系统(包括核心摘要、语义事实以及情景事件)。仅对记忆写入策略进行优化;用于下游问答任务的生成器与检索器则保持冻结状态。奖励信号源自可验证的成果(包括长期视域下的问答准确率、工具调用的正确性、记忆压缩的有效性,以及记忆条目的语义有效性),从而引导该子智体学会构建既紧凑又充分的记忆,以最大化冻结模型的效用。实验结果表明,Mem-α 的表现优于此前的各类记忆基线模型,且具备出色的泛化能力——能够将从约 3 万个 token 的训练序列中学习的经验,成功迁移并应用于超过 40 万个 token 的长文本语境中。这充分展示一个记忆构建子智体的具体实例:它能够自适应地筛选与编排信息流,从而为固定的推理核心提供高质量的“信息食粮”。

AutoGraph-R1 [164] 将这种共生原理应用于结构化知识图谱(KGs)的构建中。它不再依赖静态的提取启发式规则,而是通过优化一个基于大语言模型(LLM)的“构建子智体”,从原始文本中生成知识图谱。其监督信号直接源自“冻结智体”在使用所生成图谱执行下游推理任务(GraphRAG [165])时的表现。借此,该构建子智体学会一种策略:它优先考量功能实用性——即创建那些能专门辅助宿主智体进行检索与推理的连接和路径——而非诸如三元组密度之类的内在指标。

元认知与控制子智体。近期研究致力于训练一类子智体,它们的作用在于塑造冻结模型“思考”的方式(包括规划、引导及计算资源分配),而非决定它们检索或存储的具体内容。

AI-SearchPlanner [27] 引入一种多目标优化机制,旨在平衡任务的有效性与执行效率。该系统训练一个规划工具(基于 Qwen2.5-7B 模型),用于为冻结的生成模型制定多步搜索策略,其优化目标函数为:

J = E[R_outcome + λ·R_process −α·Cost],

其中,R_outcome 衡量最终任务的成功程度;R_process 评估搜索计划的合理性(由冻结的生成模型进行评判);而 Cost 则对过度规划所产生的开销进行惩罚。通过结合结果导向奖励与过程导向奖励 [166],冻结模型在此过程中既充当任务的执行者,又扮演规划者的“导师”角色;这使得规划子智体不仅能学习“何种做法有效”,更能领悟其背后的“有效原理”。通过调节参数 λ 的取值,系统能够描绘出一条介于成本与质量之间的帕累托(Pareto)前沿曲线,从而生成能够适配不同部署预算需求的定制化规划方案。

Advisor Models [167] 将这一理念进一步泛化,应用于针对具体实例的自然语言引导场景。一个小型“顾问模型”通过 GRPO 算法进行训练,学会在输入文本前预置针对特定情境的建议;这些建议能够引导冻结的基础模型向预期的行为模式(如风格、安全性、推理深度等)靠拢,且无需对基础模型的内部权重进行任何修改。在本文所构建的分类体系中,此类顾问模型充当着可训练的“控制接口”或“参数化记忆体”的角色,它们能够对特定环境及特定用户的潜在特征信息进行编码与存储。

作为从“建议引导”向“直接操控”过渡的桥梁,Matryoshka Pilot [168](NeurIPS 2025)正式确立一种“控制器-生成器”的循环交互机制:在该机制下,一个小型且内部结构透明(白盒)的 LLM 通过输出一系列中间分解步骤、行动规划及内容摘要,来对一个体量更大且内部结构不透明(黑盒)的 LLM 进行操控与引导。 M-Pilot 将黑盒模型视为一个环境,收集轨迹层面的成功信号,并利用迭代 DPO(Iterative DPO)对控制器进行优化。该方法在推理、规划和个性化基准测试中均取得约 3% 至 7% 的性能提升,且可在多个黑盒后端之间实现“即插即用”式的迁移,从而进一步印证将控制子智体视为一种可移植的 T2 工具的观点。

学习如何协调冻结的专家。专注于协调的子智体训练专门的策略来协调多个冻结的专家。

AgentFlow [52] 将智体分解为多个模块(规划器、工具执行器、验证器和解决方案生成器),这些模块主要以冻结的 Qwen2.5-7B-Instruct 模型实现。仅对规划器进行训练。使用 Flow-GRPO,每次展开中,所有决策都会收到一个轨迹级别的奖励(正确或错误,由 GPT-4o 判断),通过组归一化优势,即使奖励稀疏也能有效地分配权重。一个 7B 的 AgentFlow 规划器在搜索密集型任务上取得 57.3% 的准确率(比 AutoGen 高 14.9%),在数学推理任务上取得 51.5% 的准确率(比 ToRL 高 14.5%),在 GAIA 任务上取得 33.1% 的准确率,在多种设置下都优于规模更大的 GPT-4,这表明对冻结专家进行学习协调可以与单体模型相媲美甚至超越单体模型。

自演化(子)智体。子智体作为工具范式的一个更高级分支允许工具本身通过自生成的任务和奖励进行协同演化。R-Zero [169] 从同一个基础 LLM 实例化两个角色:求解器和挑战者。当求解器被冻结时,它的成功、失败和不确定性(通过自洽性)定义奖励,这些奖励训练挑战者提出接近求解器能力边界的任务。这些阶段交替进行形成一个双向循环,但每一步仍然遵循 T2 原则,即在更强大或暂时固定的核心信号下优化轻量级子智体。多智体演化 (MAE) [170] 将此设计扩展到一个包含提议者、求解器和评判者的三元架构。提议者和评判者作为自适应 T2 子智体运行:评判者学习评估系统生成的轨迹,而提议者学习生成多样化、高质量且对求解器具有挑战性的任务。MAE 不是调整主求解器,而是通过训练这些外围子智体来塑造数据、奖励和课程,从而提高性能。R-Zero 和 MAE 共同展示第二代子智体作为工具的方法:自演化的生态系统能够自主构建原本固定的推理核心的学习条件。

综合:T2 的成熟。子智体作为工具的范式逐步扩展T2的范围:检索、记忆构建、规划和协调,最终实现自我进化。智体搜索器(s3、DynamicRAG、QAgent)优化冻结生成器的信息获取;记忆构建子智体(Mem-α)管理长期状态;元认知控制器和协调器(AI-SearchPlanner、Advisor Models、Matryoshka Pilot、AgentFlow)决定如何部署工具和专家;而自我进化框架(R-Zero、Multi-Agent Evolve)自主生成课程和奖励信号。将工具训练与生成器训练解耦,同时允许工具相互适应,可以构建出比单体系统更高效、模块化和更通用的系统。

智体的记忆和技能

智体的记忆系统可以被视为一种自适应工具。范式标签取决于记忆的形式和更新机制:由冻结智体的输出更新外部非参数存储主要属于T2;预训练或插件模块属于T1;而参数化或混合架构则处于工具自适应和智体自适应之间的边界。以下大多数系统属于T2,其中冻结智体的下游任务表现或输出作为监督信号,用于调整记忆模块(其写入、检索、反思和遗忘的方式)。最近的一些综述从互补的角度探讨这一领域。Hu[171]提出一个统一的形式、功能和动态框架,该框架从三个正交维度组织智体记忆:形式(token级记忆、参数化记忆和潜记忆,区别在于信息的存储位置和方式)、功能(用于用户和环境知识的事实记忆、用于累积交互结果的经验记忆以及用于主动上下文管理的工作记忆)和动态(记忆形成、演化和检索的生命周期)。这种三元视角阐明记忆适应同时作用于存储基质、内容类型和更新策略。在经验功能层面,Hu进一步区分三个抽象层次:基于案例的记忆(原始轨迹存储)、基于策略的记忆(精炼的工作流和启发式方法)以及基于技能的记忆(可执行代码、API和MCP协议)。这种层级结构自然地映射到适应框架:基于案例和基于策略的记忆主要属于T2(冻结智体的成功或失败决定保留的内容),而基于技能的记忆则连接T2(由智体反馈整理的技能库)和T1(与智体无关的预训练工具API)。

Zhang[49]将可优化的机制归类为T2工具,其涵盖范围包括短期缓冲区、长期经验数据库以及结构化知识。Zhang[172]提供一篇补充性的综述,专门聚焦于基于大语言模型(LLM)的智体(Agent)的记忆机制;该综述依据记忆的形成(记忆如何被创建)、管理(记忆如何被更新与剪枝)以及利用(记忆如何指导未来的行动)这三个维度,对现有研究进行梳理。Huang[173]则提供一种更为宏观的探讨视角,将认知科学中的记忆模型(如互补学习系统、工作记忆)与基础智能体架构相连接;与此同时,Jiang[174]对评估方法及系统局限性进行实证分析,并指出基准测试饱和、评估指标有效性存在鸿沟以及对骨干模型过度依赖等尚待解决的问题。Jiang[175]提出,长期记忆是人工智能实现自我进化的基石;他们将持久性记忆视为一种基础载体,正是凭借这一载体,智体才得以在漫长的时间跨度内不断积累知识、优化策略并实现自主提升。在更为抽象的层面上,Sumers[176]提出“语言智体认知架构”(CoALA)框架;该框架将智体的记忆划分为工作记忆(即活跃的上下文窗口)、情景记忆(即过往交互的记录)、语义记忆(即通用知识)以及程序记忆(即习得的行动例程)。CoALA框架提供一种具有原则性的记忆分解方式,并能与T2设计空间直接对应:在“冻结智体”(即固定智体主体架构)的监督模式下,每一种记忆类型均可被独立地进行适配与优化;此外,该框架还能明确指出,针对特定的任务特征,究竟应当对哪一个记忆子系统进行重点优化。综合来看,上述综述共同确立这样一个观点:智体记忆并非单一的机制,而是一个包含多重维度的设计空间——这些维度包括:存储模态(参数化存储、显式存储或隐式存储)、时间跨度(瞬时、会话级或持久性)、内容类型(事实性、经验性或工作性)、抽象层级(具体案例、策略或技能),以及更新策略(仅追加、反思性更新或基于强化学习的优化更新)。

与上述概念紧密相关的是“智体技能”这一概念。Wu&Zhang[14]提出,若要透彻理解智体技能,最佳的视角莫过于将其视为一种“程序记忆”——即一种关于“如何执行任务”的、结构化且可复用的知识;这种分类方式恰好与认知科学领域中关于“陈述性知识”(即“知其然”)与“程序性知识”(即“知其所以然”)的区分相映成趣。在此框架下,技能遵循一个完整的生命周期,涵盖:获取(通过演示、探索或轨迹提炼进行学习)、表征(以可执行代码、API 规范、MCP 协议或文本化流程的形式呈现)、调用(在推理阶段进行检索与执行),以及优化(通过反思、强化学习或集体共享进行迭代改进)。Xu & Yan [177] 引入系统视角,对上述“程序性记忆”观进行补充:他们强调渐进式上下文加载的重要性,突显 SKILL.md 和 MCP 作为接口标准所发挥的作用,并指出当技能从被动的记忆片段转变为可执行、可共享的工件时,随之产生的安全与治理难题。Fang [178] 对大语言模型(LLM)智体中的程序性记忆进行实证研究,结果表明:所存储流程的格式与粒度对下游任务的执行效果具有显著影响;此外,智体若能根据任务复杂度的不同,自适应地在基于代码的流程表征与基于自然语言的流程表征之间进行切换,将有助于提升其整体性能。Cao [179] 提出一种动态程序性记忆框架,在该框架下,智体能够依据任务执行的反馈结果持续优化其内部存储的流程;研究证实,在涉及长周期规划的任务中,这种迭代式的记忆优化机制其表现优于单纯的静态记忆累积机制。技能的生命周期与 Hu [171] 所提出的“经验记忆层级结构”之间存在着紧密的对应关系:基于案例的记忆层负责存储原始的任务执行轨迹;基于策略的记忆层负责提炼出具有普适性的启发式规则与工作流;而基于技能的记忆层则负责将上述内容编译为可直接执行的能力模块。由此可见,记忆与技能实则是同一套适应性机制所呈现出的两个不同侧面。其中,记忆提供存储的载体与组织架构;而技能则提供可执行、可组合的内容实体,正是这些实体赋予记忆存储以实际的行动价值,使其能够有效地服务于未来的各项任务。

动态记忆存储机制。基础性的 T2 记忆架构(即第二类记忆架构)依据其对存储信息的组织方式不同,大致可归纳为三大设计流派 [180–185]:其一是以分层结构或操作系统(OS)理念为灵感的系统(如 MemGPT、Memory OS),这类系统设定明确的层级划分(例如工作记忆层与长期存储层),并辅以“页面置换”或“垃圾回收”等管理策略;其二是以反思机制为核心的系统(如 Generative Agents、A-MEM),这类系统赋予智体自主决策的权力,使其能够根据自身输出的内容来判断哪些信息值得固化保存,以及何时进行固化操作;其三是以图结构或结构化数据为基础的系统(如 HippoRAG、SHIMI),这类系统在对记忆进行索引与检索时,主要依据其内部的关系结构或语义结构,而非单纯地依据信息的时间新旧程度(即“近因效应”)。系统所选用的具体设计方案,将直接决定该系统在“记忆检索速度”与“记忆关联丰富度”这两项指标之间所呈现出的权衡取舍特性。MemGPT [181] 借鉴操作系统的理念,通过一种分层存储结构将这一思想形式化:有限的主上下文窗口充当“内存”(RAM),而无限的外部存储则充当“磁盘”。智体通过发出显式的读/写操作,在不同层级之间移动信息;同时,一种“页面置换策略”决定哪些信息应保留在当前活跃的上下文中。Generative Agents [180] 维护着一条由自然语言观察记录构成的“记忆流”,并利用智体自身的反思机制,定期将原始记录整合、抽象为更高层级的概念,从而构建出一种双层存储结构(包含观察记录与反思记录),以此支持跨越整日时间尺度的规划任务。近期,Gutiérrez [186] 将从静态的“检索增强生成”(RAG)向具备持久记忆能力的智体演进的过程,重新解读为一种“非参数持续学习”的形式;研究表明,此类记忆存储系统能够在吸收新信息的同时,避免对既有知识产生“灾难性遗忘”——这一特性恰恰是基于参数微调的方法难以保证的。Kang [187] 提出 Memory OS,这是一种分层架构,将记忆管理视为一种操作系统服务;它提供一套标准化的 API 接口,涵盖存储、索引、检索及垃圾回收等功能,从而将记忆管理逻辑与智体的推理循环彻底解耦。A-MEM [188] 采用一种“智体驱动”的记忆管理模式:大语言模型(LLM)本身负责决策如何组织其记忆存储,并根据内容的相关性与任务需求,动态地创建、关联及重构记忆条目,而非单纯依赖于固定的索引启发式规则。HippoRAG [189] 借鉴神经科学领域关于海马体(hippocampal)记忆索引机制的研究成果,将系统拆分为两个组件:一个负责新皮层功能的部分(即一个将文本段落编码为知识图谱的 LLM),以及一个负责海马体索引功能的部分(即一个能在图谱上执行模式补全任务的检索模块)。这一设计完美契合“互补学习系统理论”,使得系统能够对那些在词汇层面毫无重叠的文本段落进行关联性检索;在多跳问答(Multi-hop QA)基准测试中,该系统相较于标准的 RAG 基线模型取得显著的性能提升。SHIMI [190] 提出一种去中心化、基于语义层级的记忆索引架构,专为可扩展的多智体推理场景而设计;在该架构中,每个智体各自维护一个依据语义相似度进行组织的“本地记忆分片”,并通过一套协调协议实现跨智体之间的记忆检索,从而避免将所有信息集中存储于单一中心化仓库所带来的弊端。Liu[191] 的研究表明,专门针对“记忆增强型对话”(包括信息检索、内容摘要及角色设定维持)对小型大语言模型(LLM)进行微调,能够将基础模型转化为具备持久记忆能力的对话智体;这充分展示记忆管理流程本身也可以作为一个可训练的组件。

经验记忆与反思记忆。大量与 T2 范式(即基于文本的交互范式)相关的研究,都聚焦于那些能够从自身经验中进行学习的记忆模块。借助这些工具,一个参数被冻结(即权重固定不变)的智体能够存储、反思并从其自身的输出(例如完整的任务执行轨迹)中汲取经验;这一过程通常借助于“语言强化”或“自我纠正”机制来实现,从而构建出一套循序渐进的策略体系,既能避免重复犯错,又无需对核心 LLM 的模型权重进行任何更新 [35, 192, 193]。Reflexion [35] 率先提出“语言强化学习”的概念:在每一次尝试执行任务之后,该冻结智体都会生成一段自然语言形式的自我反思与批评,并将其追加至一个“情景记忆缓冲区”中;随后的任务尝试便会依据这些反思内容进行调整与决策。这种方法巧妙地将原本单一的标量奖励信号转化为丰富详实的文本反馈,且无需进行梯度更新;凭借这一机制,该方法在 HumanEval 基准测试中取得 91% 的 pass@1(即首次尝试即通过)成绩,并在 AlfWorld 和 HotPotQA 等任务中也展现出优异的性能。Retroformer [192] 进一步拓展这一理念:它专门训练一个独立的“回顾模型”,用于为冻结智体生成具有针对性的反馈意见,从而将“分析错误成因”(即‘哪里出了问题’)这一环节与“重新尝试执行”(即‘如何再次尝试’)这一环节在功能上彻底解耦。Think-in-Memory [193] 引入一种“先回忆、后反思”的流程机制:智体首先从记忆库中检索出与当前情境相关的历史思考片段,随后进行“后置反思”处理,将这些片段进行重组与适配,使其契合当前的具体语境;这一机制使得智体能够在无需扩充上下文窗口(Context Window)的前提下,依然保持长期的对话连贯性。Agent Workflow Memory (AWM) [194] 则采取一种互补性的策略:它从智体过往成功的任务执行轨迹中提取出可复用的“工作流”(即结构化的动作序列),并将其存储在一个专用的记忆模块之中。当智体面临新的任务时,它会检索出与当前任务关联度最高的工作流,并将其作为执行任务的行动模板;相比于未配备工作流记忆模块的智体,采用 AWM 机制的智体在网页导航类基准测试中的规划错误率降低 24%。AWM 的研究成果表明,经验记忆的存储单元并非必须局限于原始的任务执行轨迹或纯文本形式的语言反思;事实上,那些经过结构化抽象处理的“程序性知识”(即操作流程)往往能够作为一种更为高效的记忆检索对象。Pan[195]专门针对个性化对话智体,深入研究记忆的构建与检索机制;研究表明,记忆粒度的选择(是采用离散的个体事实,还是采用用户层面的摘要)以及检索策略的选择(是偏重时效性,还是偏重相关性),都会显著影响智体在数百轮对话中维持连贯且个性化对话的能力。当这些累积的经验被提炼为可复用、可组合的能力时,便形成“技能库”。

结构化记忆(图、树与数据库)。为了突破线性文本的局限,部分T2类记忆工具将信息组织为更为丰富的结构形式,例如知识图谱、树状结构或符号数据库。处于“冻结”状态(即参数固定)的智体所产生的输出,被用作一种信号来对这些结构化工具进行“调优”——具体操作包括添加新节点、更新实体间的关系,或向数据库写入数据等。AriGraph[196]在交互过程中动态构建一个“情景知识图谱”:智体输出的观察信息被解析为“实体-关系”三元组,随后并入一个持久化的图谱中;智体后续便可对该图谱进行查询,以支持多跳推理。ChatDB[197]将记忆外化至关系型数据库中,把智体的自然语言输出转化为SQL操作指令(如INSERT、SELECT、UPDATE),从而在跨越多个对话轮次的过程中维护结构化的记忆记录。Rezazadeh[198]提出一种分层树状记忆结构,将对话内容组织为层层嵌套的主题簇,从而实现在不同粒度层级上的高效记忆检索。Zep[199]引入一种专用于智体记忆的“时序知识图谱”架构,该架构明确将“时间”建模为一种核心维度;这使得智体能够针对事实的学习时间、其随时间发生的变化,以及当前事实的最新状态进行推理——而这种能力正是扁平化的向量存储方案所欠缺的。通过采用这些结构化的记忆表征,处于“冻结”状态的智体能够以更高的效率进行记忆查询与推理,从而有效地将复杂的记忆管理任务外化并委托给专门化、自适应的外部工具来处理[200]。

参数化与混合式记忆架构。另一条平行的研究路径,则致力于探索那些能够与显式外部存储机制相辅相成的“参数化记忆”机制。Memory3[201]针对语言模型提出一种三层级的记忆层级体系:(1) 模型权重本身,作为一种隐式的长期记忆;(2) 一个由可检索文本片段构成的显式记忆池,作为一种“半参数化”记忆;(3) 对话上下文窗口,作为一种工作记忆。一种轻量级的“记忆电路”学会在不同层级之间路由信息,使模型能够将事实性知识卸载到显式存储池中,从而为推理任务保留参数容量。在语言建模基准测试中,配备24亿参数模型及外部记忆池的 Memory 模型,其困惑度(perplexity)表现与未配备外部记忆的64亿参数模型相当,这证明显式记忆能够替代单纯的参数数量。Titans [202] 将一个可微分的长期记忆模块直接整合到注意机制中,从而维持一种持久的记忆状态;该状态在推理过程中通过基于梯度的学习方式进行更新。与仅依赖固定上下文窗口的标准 Transformer 模型不同,Titans 能够跨越任意长度的序列,有选择地存储和检索信息。这些基于参数的方法通过证明记忆适应过程也能在模型的计算图中实现,从而对外部存储范式(如 MemGPT 和 Generative Agents)形成补充;这也模糊 T1 层级(预训练记忆模块)与 T2 层级(由智体监督的记忆适应过程)之间的界限。

作为可训练模块的情景记忆(episodic memory)。Memento [23] 演示智体的记忆系统可以作为一个外部工具进行优化,且无需对作为规划器的 LLM(大语言模型)进行任何修改。该系统将一个参数冻结的 GPT-4.1 高层规划器,与一个可训练的情景案例记忆模块相结合。该记忆模块存储过往的问题解决轨迹;而作为训练对象的工具,则是一个用于学习“案例检索策略”的神经 Q 函数——即当面临新问题时,应向参数冻结的规划器提供哪些过往案例作为参考。

其训练信号是二元的任务成功或失败反馈:这种稀疏的、轨迹层级的奖励信号会被广播至该轨迹中所有的案例选择决策点上,随后通过一种软 Q 学习算法来更新检索策略。参数冻结的 LLM 无法感知 Q 值或策略内部的运作细节;它仅接收作为上下文输入的检索案例,并据此生成相应的规划。Memento 取得顶尖的性能表现:在 GAIA 验证集上得分 87.88%(排名第一),在 GAIA 测试集上得分 79.40%(排名第三),在 SimpleQA 数据集上得分 95.0%。消融实验结果显示,基于案例的记忆机制在处理“分布外”(out-of-distribution)任务时,能够带来 4.7% 至 9.6% 的绝对性能提升。值得注意的是,在该系统中,仅有记忆模块接受训练;那同一款“冻结”的 LLM——此前在缺乏记忆时表现不佳——如今却表现卓越,原因在于其“信息摄入”已被优化。

将记忆操作视为一种可学习的技能。最近的一项研究重新定义记忆管理问题本身:不再是手动设计固定的操作(追加、检索、汇总),而是使操作本身变得可学习和可演化。MemSkill [203] 引入一个控制器-执行器-设计器循环,其中控制器选择要应用的记忆技能(例如,提取关键事实、合并相关条目、清理过时信息),LLM 执行器生成技能引导的记忆内容,设计器模块分析失败案例,从而随时间演化技能集。技能库从一个小的种子集开始,随着设计器识别出现有技能无法解决的重复性失败模式而不断增长。在 LongMemEval [204]、LoCoMo、HotpotQA 和 ALFWorld 数据集上,MemSkill 通过学习适合任务的记忆粒度,例如,为 QA 任务提取细粒度的实体属性,同时为规划任务保留较粗粒度的事件摘要,从而优于静态记忆基线。该方法表明,记忆适应不必局限于存储的内容;在冻结智体的监督下,存储操作本身的执行方式也可以得到优化。

测试-时记忆管理。另一个在推理时进行 T2 内存自适应的突出例子是动态速查表 (dynamic cheatsheet,DC) [205],这是一个轻量级框架,为黑盒语言模型提供“持久的、不断演化的记忆”。该系统“无需修改其底层参数”即可运行,并且不需要基于梯度的更新。该框架由两个核心模块组成:解决方案生成器和记忆管理器。记忆管理器是自适应的 T2 工具:它无需访问真实标签即可运行,在冻结生成器生成解决方案后,自主评估解决方案的正确性和效率。基于这种自我评估,管理器通过存储简洁、可迁移的片段(例如“可重用的策略、代码片段snippets和一般问题解决思路”)来更新记忆,而不是存储完整的、未经整理的文本记录。 ReasoningBank [206] 通过创建一个记忆框架扩展这种测试时策略整理的概念,该框架能够从成功和自我判断的失败经验中明确提炼出可泛化的推理策略。与存储原始轨迹或仅存储成功例程的方法不同,ReasoningBank 分析失败案例以提取“关键的预防性经验教训”。然后,系统会检索整理好的推理策略库,以指导智体完成未来的任务。该框架还引入记忆-觉察的测试时缩放,利用整理好的记忆来指导缩放探索,其中缩放过程中积累的各种经验有助于构建更强大、更具泛化的记忆。ReasoningBank 在 WebArena [207] 和 SWE-Bench [208] 等复杂基准测试中展现其有效性。

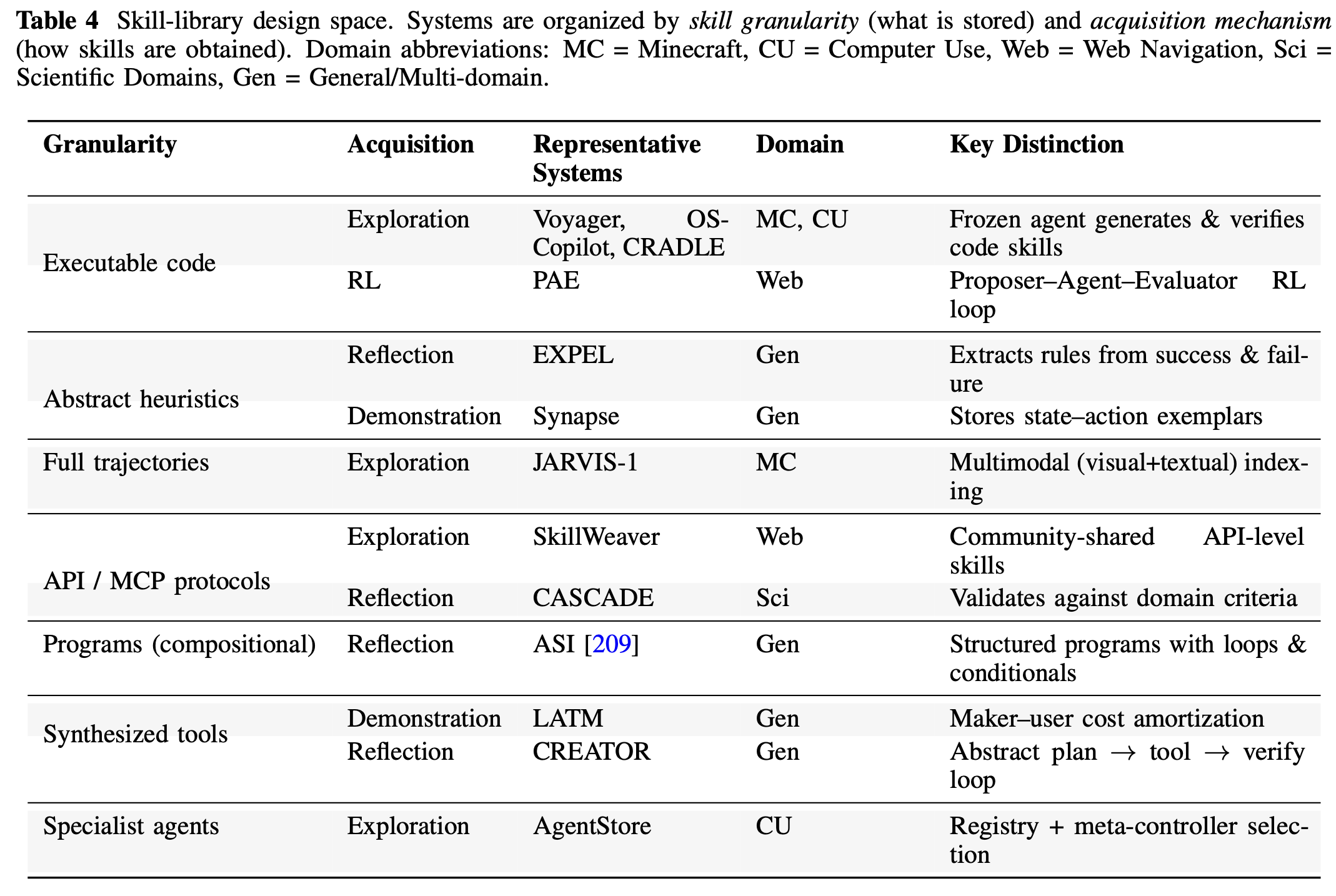

技能库作为自适应工具。T2 记忆自适应的一个特别重要的形式是构建可重用的技能库,这些技能库实例化基于技能的经验记忆 [171]。这些系统并非存储原始轨迹(基于案例)或抽象启发式(基于策略),而是将成功经验提炼成模块化、可组合且可执行的能力,供冻结智体在未来的任务中调用。技能表示涵盖从细粒度代码片段到标准化API和MCP协议的连续体[14]。

表4所示从两个维度组织具有代表性的技能库系统:技能粒度(存储的内容——代码、启发式、轨迹、专业智体或合成工具)和获取机制(技能的获取方式——演示、探索、反思或强化学习)。下文将讨论每个单元格中的代表性系统;表格为其余部分提供简要参考。

Voyager[210]在Minecraft中率先采用这种方法:冻结的GPT-4智体为每个新任务生成可执行代码,成功的程序存储在不断增长的技能库中,并以自然语言描述进行索引。当智体遇到相关任务时,它会检索并组合先前验证过的技能,而不是从头开始推理。因此,技能库就像一个T2工具,其内容完全由冻结智体的成功或失败信号进行管理。Voyager在Minecraft中发现63个独特的物品(比基线多3.3倍),并展示持续的技能积累,而不会出现灾难性的遗忘,因为新技能会被添加到技能库中,而不会修改现有技能。相关的Minecraft智体采用互补的策略:GITM [211](Minecraft中的幽灵)为冻结的LLM配备基于文本的知识和记忆模块,可以将目标分解为可执行的子目标序列;而DEPS [212]使用交互式的描述-解释-规划-选择循环,使智体能够根据环境反馈重规划,从而从失败中恢复。这两个系统都保留过去交互的持久记忆,但它们都没有构建可重用的技能库,这凸显Voyager在可组合的、代码级技能积累方面的贡献。

JARVIS-1 [213] 通过将多模态记忆与预训练的动作规划器相结合,将“技能库”范式扩展到开放世界的多任务场景中。该系统维护着一个多模态记忆库,用于以 (观察、规划、动作) 元组的形式存储成功的任务完成轨迹。当面临新任务时,JARVIS-1 会从记忆库中检索出相关度最高的历史轨迹,并将其作为规划器的“上下文示例”(in-context examples)加以利用。该记忆库通过视觉相似度(利用游戏帧的 CLIP 嵌入向量)和文本相似度(利用任务目标的描述)进行双重索引,从而实现跨模态检索功能。在涵盖合成、战斗和探索等领域的 200 多个 Minecraft 任务中,JARVIS-1 取得远高于 Voyager 及其他基准模型的成功率;特别是在需要连续完成 10 个以上子目标的“长程任务”中,这种由记忆引导的规划策略显著减少累积误差。

EXPEL [214] 将这一原理推广到游戏环境之外的更广泛领域:它利用一个参数固定的语言大模型(frozen LLM),从成功的轨迹和失败的轨迹中提取可复用的“洞察”(即抽象规则与启发式策略),并将其存储在一个持久化的经验池中。在 ALFWorld 和 WebShop 这两个基准测试中,EXPEL 的任务成功率分别比非自适应的基准模型提高18% 和 12%,这充分证明这种基于经验的技能提取能力具有跨任务实例的泛化迁移性。

Synapse [215] 将轨迹层面的记忆与“状态-动作”示例相结合,使一个参数固定的智体(agent)能够在每一个决策步骤中,从预先演示构建的技能库中进行选择。

OS-Copilot [216] 将“技能库”范式进一步扩展到通用的计算机操作场景中。该系统维护着一个具备自我改进能力的技能库,库中的每一项技能均表现为一个带有自然语言文档字符串(docstring)的 Python 函数。当智体遭遇新任务时,它首先会在技能库中搜索相关的既有技能;若未找到匹配项,它便会生成一项新技能并加以执行,一旦执行成功,该新技能即会被存储入库以供日后复用。这一自我改进的循环过程无需任何人工标注的介入:智体自身的执行结果(成功或失败)将直接决定哪些技能最终会被纳入技能库中。在 GAIA 基准测试中,搭载累积技能库的 OS-Copilot 表现优于那些缺乏持久化技能存储机制的基准模型,从而有力地证实“跨会话的技能复用”正是 T2(Text-to-Task)类方法所具备的一项关键优势。 CRADLE [217] 将以技能为中心的设计理念应用于通用的计算机控制领域,并维护一个“技能策展模块”,用于存储、检索并组合针对 GUI 交互的可复用动作序列。该系统将复杂的计算机任务拆解为一系列子目标,针对每个子目标在技能库中进行匹配,随后执行检索的既有技能,或生成全新的技能。成功的技能会随着反复使用而不断得到优化与精进,从而构建出一个能够伴随实际部署经验增长而持续自我完善的技能库。

AppAgent [218] 演示针对智能手机使用场景的自主技能发现能力。该智体(Agent)通过与移动应用程序进行交互,利用“试错法”来探索并发现 UI 元素的具体功能;随后,它会将学习的交互模式作为可复用的程序性知识,存储在一份外部文档中。当面临全新的应用程序或任务时,该智体便会从这份文档中检索出相关的既有技能,以此来指导自身的后续操作。这种基于探索的技能发现机制无需任何人工演示作为先导,且能够跨越具有相似 UI 模式的不同应用程序实现知识迁移。

Agent S [219] 引入一种针对计算机使用场景的“经验增强型分层规划”机制;在该机制下,智体维护着一个由成功的任务完成策略所构成的“经验库”。该系统采用典型的“管理者-执行者”(Manager-Worker)架构:其中,“管理者”负责依据检索的既有经验将复杂任务拆解为具体的子目标;而“执行者”则负责逐一执行这些细化的动作指令。其经验检索机制综合运用“语义相似度匹配”与“任务图结构匹配”这两种手段,将新的子目标与经验库进行比对,从而使得智体能够将此前学习的策略迁移并应用于那些在结构上相似、但此前从未遭遇过的全新任务之中。

AgentStore [220] 致力于解决技能管理问题中的另一个独特侧面:即如何将各类异构的“专业化智体”整合进一个统一的系统框架内,并将其作为可复用的技能资源加以利用。AgentStore 并未采用构建单一巨型智体的传统模式,而是维护着一个专门的“专业化智体注册表”(其中每一个智体均针对特定领域或工具进行专门训练);与此同时,系统中还设有一个“元控制器”,该控制器能够自主学习如何针对新出现的任务,从注册表中挑选并组合这些各有所长的专业化智体。该系统支持对新的专业化智体进行动态注册,这意味着其技能库能够实现持续的扩充与增长,而无需对作为核心的“元控制器”进行反复的重训练。

ExACT [221] 将反思蒙特卡洛树搜索(MCTS)与探索性学习相结合,旨在教会智体系统地探索陌生的环境。智体通过探索构建出一棵技能树,其中每个节点代表一种已发现的交互模式。成功的探索轨迹会被存储为可复用的技能,而由 MCTS 引导的探索过程则确保对动作空间的广泛覆盖。该方法弥合“试错式技能发现”(如 AppAgent 所采用)与更具结构化的“基于规划的方法”之间的鸿沟。Zhao [222] 对智体技能发现问题进行形式化定义,并提出一种框架:在该框架下,大语言模型(LLM)智体能够自主地从其交互历史中识别、抽象并归档可复用的行为模式,从而为上文所述的那些基于经验构建的技能库系统提供理论基础。

SkillWeaver [223] 证明 Web 智体能够通过探索,自主地发现、创建并优化可复用的 API 级技能。该智体能够在网站上进行导航,识别出反复出现的交互模式,并将其编码为可调用的 API 函数,供不同的智体及任务之间共享。通过一种社区协作机制,这一集体技能库得以不断壮大——众多智体将各自发现的技能贡献其中,从而实现在无需集中式监管的情况下,快速覆盖各类不同的 Web 领域。PAE [224](即“提议者-智体-评估者”模型)将自主技能发现过程形式化为一个由三个组件构成的循环:提议者(Proposer)负责生成候选任务;智体(Agent)负责尝试执行这些任务;而评估者(Evaluator)则对执行结果进行评分,从而为强化学习过程生成奖励信号。这种解耦式的设计使得每个组件均可独立进行优化;同时,基于强化学习(RL)的训练机制赋予智体学习各类技能的能力——而这些技能若仅凭演示(Demonstration)来指定,往往是难以学习的。在 Web 导航基准测试中,PAE 所发现的技能不仅能在不同的网站和任务类型之间实现迁移,而且在所需的人工监管量远少于基于模仿学习基线模型的情况下,依然取得极具竞争力的性能表现。SAGE [225] 进一步深化这一基于强化学习的研究方向,它将技能库本身也纳入学习循环之中:在跨越一系列相关任务的连续执行过程中,新生成的技能会不断汇入技能库中,并可即刻供后续任务调用;与此同时,一种融入技能考量的奖励机制被引入其中,旨在同时激励智体去创建有用的新技能,并有效地复用既有的技能。这堪称一种尤为精妙且纯粹的“T2 风格”自我提升机制的具现化——在该机制下,智体未来的能力提升并非仅仅依赖于对整个模型进行整体性的重训练(Monolithic Retraining),而是主要通过其不断演进与丰富的“技能基底”来实现的。Wang [209] 采取一种互补的程序化方法:ASI 不将技能存储为自然语言描述或原始代码,而是归纳出结构化的程序(包含条件语句、循环和子程序调用),从而捕捉智体任务的组合结构。这种程序化的表示形式使得系统能够有效地泛化至更长的时间跨度任务以及新颖的任务组合,而扁平化的技能库往往难以应对此类挑战。CASCADE [226] 将技能创建能力扩展至科学领域,在该系统中,一个大语言模型(LLM)智体通过累积式的自我改进,自主开发并演化出一套计算化学技能库(例如,分子性质预测、反应路径搜索)。每项技能在被纳入技能库之前,均需依据特定领域的正确性标准进行验证;此外,该系统还会追踪技能间的依赖关系,从而实现在多步骤科学工作流中的组合式复用。

另一种相关但截然不同的技能构建形式是“工具创建”:智体不存储成功的动作轨迹,而是合成可复用的新工具(通常表现为可执行函数),将针对反复出现之子问题的解决方案封装其中。LATM [227](“Large Language Models as Tool Makers”,ICLR 2024)确立一套规范化的两阶段协议:其中,“Tool Makers”LLM 负责根据任务演示创建 Python 函数,而轻量级的“Tool Users”LLM 则将这些函数应用于新的任务实例。工具一旦创建完成,便可在数百个任务实例中反复使用而无需重新生成,从而摊销昂贵的“制造者”模型所产生的成本。在推理基准测试(GSM8K、MATH、TabMWP)中,LATM 的表现与单一的大型模型不相上下,但每个任务实例的成本却降低高达 79%;究其原因,在于“Tool Makers”只需调用预先构建好的函数,而无需重新推导解决方案的策略。CREATOR [228](EMNLP 2023 Findings)将抽象推理与具体实现解耦:当面临问题时,智体首先制定抽象的解决方案规划,随后创建用于实现该规划的工具(即代码函数),最后应用该工具来解决问题。通过将“做什么”(目标)与“如何做”(实现)相分离,CREATOR 使得智体能够通过“验证-优化”循环来修正工具的具体实现,而无需重新推导抽象的策略规划。在 Creation Challenge 和 MATH 基准测试中,CREATOR 的表现均优于“思维链”(Chain-of-Thought)和“直接代码生成”这两种基线方法;此外,其所创建的工具还具备良好的泛化能力,能够迁移并应用于新的问题变体。LATM 和 CREATOR 两项工作均表明,技能构建过程可以在“工具创建”这一层级上进行:智体(Agent)不仅仅是简单地检索过往经验,而是能够合成出全新的、可复用的抽象概念,将反复出现的推理模式压缩并封装为可调用的函数。

这些系统拥有一套共同的架构:一个“冻结”状态的智体负责生成经验数据;一套筛选机制(如代码验证、自我反思或成功案例过滤)负责甄选出值得保留的经验;最后,通过一个检索接口,这些累积的技能便可供未来的推理任务调用。这一架构设计与 T2 范式(T2 paradigm)直接契合:在该范式下,智体本身保持固定不变,而其背后的技能库则在智体所产生的监督信号指引下不断演化。这些系统之间的一个关键差异在于所存储技能的“粒度”:Voyager 和 OS-Copilot 存储的是可执行代码;EXPEL 存储的是抽象的启发式规则;JARVIS-1 存储的是完整的任务执行轨迹;AgentStore 存储的是完整“专家型”智体;LATM 和 CREATOR 存储的是合成的工具函数;而 SkillWeaver 存储的则是 API 级别的可调用函数。在选择技能粒度时,需要在“可组合性”与“迁移广度”之间进行权衡:粒度较细的代码技能在组合使用时更为灵活;而粒度较粗的启发式规则则能在更广泛的任务分布范围内实现更强的泛化能力。这些系统的另一个变化维度在于其“获取机制”:主要分为基于演示学习(如 Synapse)、基于探索学习(如 AppAgent、ExACT、PAE)、基于反思学习(如 EXPEL、Reflexion)以及基于强化学习(如 PAE、Memento)等类型。近期关于多智体“程序性记忆”的研究,则为这一领域引入第三个变化维度。LEGOMem [229] 针对多智体系统引入一种模块化的程序性记忆机制:每个智体各自维护一套存储已学习工作流的本地记忆库;同时,通过一个专门的协调层,各智体能够在团队内部实现程序性知识的共享、组合与针对性特化。这种模块化的设计使得单个智体既能独立地对其技能集进行优化与完善,又能同时受益于整个团队所积累的集体经验;这一模式成功地将原本局限于单智体场景的技能库概念,拓展并应用到多智体协作的语境之中。在更宏观的“元层面”上,ADAS [230](全称为“智体系统自动化设计”)项目实现对智体架构本身的自动化设计:它利用大语言模型(LLM)作为核心驱动力,通过迭代的方式对智体系统的各类构建模块(如提示词、工具配置、控制流逻辑等)进行方案提出、效果评估及优化完善。ADAS 可被视为一种“二阶”的技能管理流程:它所积累的并非针对具体任务的技能,而是那些能够跨越多种基准测试场景、从而全面提升系统整体性能的“可复用架构模式”。

具身智能与机器人领域的技能应用技能库范式自然地延伸到具身智体领域,在此语境下,技能对应于植根于感觉运动经验的物理动作序列。SayCan [231] 引入一种理念:将大语言模型(LLM)生成的规划与机器人的“功能可用性”(affordances)相结合。具体而言,LLM 以自然语言形式提出候选技能,而一个基于真实机器人数据训练的价值函数则根据当前状态下各技能的成功执行概率为其打分。通过将 LLM 提供的语义评分与功能可用性评分相乘,系统选定下一个待执行的技能,从而确保所制定的规划既在语义上合情合理,又在物理上切实可行。ProgPrompt [232] 采用一种程序化的方法,通过提示 LLM 生成类似 Python 代码的程序,将抓取、放置、导航等基础机器人动作组合成多步骤的任务规划。尽管基础技能单元是预先定义的,但其组合逻辑却是动态生成的,这使得该系统能够以“零样本”(zero-shot)的方式迁移至 VirtualHome 环境中的各类全新家庭任务。Eureka [233] 致力于解决具身技能学习过程中的另一个瓶颈问题——即奖励函数的设计。该系统利用 LLM 以代码形式生成候选奖励函数,并通过物理仿真环境对这些函数进行评估,随后依据训练过程中的统计数据对奖励函数进行迭代优化。在 IsaacGym 平台所涵盖的 29 项机器人操纵与运动任务中,Eureka 自动生成的奖励函数在 83% 的案例中其表现均达到或超越人类专家设计的奖励函数,甚至成功实现此前一直未能攻克的精巧“转笔”动作。RoboGen [234] 将基于 LLM 的任务生成能力与自动化技能学习机制巧妙地结合在一起:LLM 负责构思新任务、构建仿真环境并设计奖励函数,而强化学习智体则负责学习与之相对应的运动技能。这种自监督式的循环机制使得智体能够在无需人类预先指定任务细节的前提下,实现技能库的持续、开放式积累与扩充。上述具身智体系统充分表明,智体的技能并非仅局限于数字虚拟环境之中;当技能涉及那些植根于感觉运动反馈的物理动作时,同样适用那条经典的 T2 原则(即:保持高层级规划器冻结不变,同时允许技能库进行自适应调整)。

记忆导航与交互式阅读。作为一种互补性的研究路径,另一种方法将长篇文档或历史对话记录视为一种“环境”,并允许智体通过模拟记忆检索的动作在其中进行探索与导航。MemWalker [235] 针对长篇文档构建一套树状层级的摘要结构,并训练智体通过迭代式地选择待展开的分支,在这棵“摘要树”中进行逐层“漫游”;这一设计巧妙地将原本属于记忆检索范畴的问题,转化为一个序列决策任务。 ReadAgent [236] 采用一种受人类启发的方法:该智体(Agent)首先执行一次“摘要提取”(gisting)过程,将长文档的每一页压缩成简短的摘要,并将这些摘要记忆存储起来;随后,当需要详细信息时,它会选择性地重新阅读原始页面。在 QuALITY 和 NarrativeQA 数据集上,配备摘要记忆的 ReadAgent 取得与处理完整上下文的系统相媲美的性能,同时所消耗的 token 数量却减少 3 到 5 倍。CoRAG [237](Chain-of-Retrieval Augmented Generation,检索链增强生成)将复杂的查询分解为一系列中间检索步骤,其中每一个步骤都以前一步骤的检索结果为条件。通过一种“拒绝采样”(rejection-sampling)的训练流程,该检索器学会生成能够最大化下游回答质量的检索链。在多跳问答(multi-hop QA)基准测试中,CoRAG 通过学习针对每个查询推理结构量身定制的检索策略,其表现超越单步检索和迭代检索的基线模型。Adaptive-RAG [238] 能够学习对查询的复杂程度进行分类,并将每个查询路由至相应的检索策略(包括不进行检索、单步检索或多步检索);这种机制既避免针对简单查询进行不必要的检索,又确保针对复杂查询能够执行彻底的多跳检索。用于路由分类的分类器是基于“银标签”(silver labels)进行训练的,这些标签依据不同检索策略所产生的回答正确性而生成,从而使得检索深度本身也成为一个具有自适应特性的可学习参数。上述方法表明,记忆的自适应能力不仅仅局限于信息的存储本身,更延伸至自适应的检索策略层面——即决定何时以及以何种深度去访问已存储的信息。

自适应嵌入空间。ToolkenGPT [30] 是一种旨在提升工具可扩展性的方法;该方法将各类工具表示为可学习的 token 嵌入(token embeddings),并将其纳入到已冻结的大语言模型(LLM)的词汇表中。整个 LLaMA-13B/33B 模型保持冻结状态,仅需训练一个小型嵌入矩阵 Wτ(其中 |T| 表示工具的数量,d 表示嵌入维度)。这些被称为“toolkens”(工具 token)的嵌入被拼接至模型的标准词汇表之后,而冻结状态下的 LLM 则学会像预测其他任何常规 token 一样去预测这些工具 token。

模型的训练过程采用监督学习范式,利用包含并行序列的数据进行训练;在这些序列中,作为“真值”(ground-truth)的真实工具调用指令被替换为相应的工具 token 占位符。在计算损失函数时采用掩码(masking)机制,确保仅有针对工具 token 的预测结果(以及紧随其后的参数 token 预测结果)能够为嵌入矩阵 Wτ 提供梯度更新信号。这种方法在参数效率上表现出色:添加234个工具仅需训练约100万个参数(基于LLaMA的4096维嵌入),相比之下,完整模型的参数量高达130亿以上。ToolkenGPT在FuncQA数据集上实现73%的单跳准确率(而ReAct仅为57%);在包含234种关系的KAMEL数据集上,其监督准确率达到75%;而在包含58种动作/对象工具的VirtualHome环境中,其任务成功率达到68%。若需添加新工具,只需扩展权重矩阵Wτ并继续训练即可,无需对整个模型进行重新训练。

ToolkenGPT的研究表明,模型适应过程可以在“接口层”(即嵌入空间)而非“参数层”(即大语言模型的权重)发生,从而在完全冻结的T1类系统与完全微调的A1/A2类系统之间提供一种折衷方案。

除了上述范式之外,近期涌现的多种方法进一步拓展工具适应框架的边界。这些方法引入全新的训练目标、模态处理方式以及架构创新,从而极大地拓宽工具适应技术的应用范围。

UniMuR [239] 训练出一种统一的多模态嵌入表示,使其与已冻结的大语言模型(LLM)的语义表示相校准,从而在MMDialog数据集上实现6.5%的R@1指标提升。DIFO [240] 采用互信息最大化原理,通过针对特定任务的提示学习(Prompt Learning)来对已冻结的CLIP模型进行适应性调整,以此实现无源域适应(Source-free Domain Adaptation)。V2L Tokenizer [241] 训练一种编码器-解码器结构,能够将图像信息映射至已冻结LLM的Token空间;该方法利用已冻结模型的词汇表作为量化码本,从而使已冻结的纯文本LLM也能胜任低层级的视觉任务。Sysformer [242] 训练一个轻量级的Transformer模型,该模型能够根据每一条用户提示动态调整“系统提示”(System Prompt)的嵌入表示,同时保持底层的LLM处于冻结状态。其监督信号完全源自已冻结模型自身对“拒绝执行”与“遵从指令”这两类目标所计算出的似然值,并辅以重构损失(Reconstruction Loss)以及可选的分类器损失进行强化训练。

纵观各类T2类方法,其中呈现出若干共同的模式:即对小型模块(仅包含数百万参数)进行轻量级训练,同时保持作为主体的LLM(包含数十亿参数)处于冻结状态;充分挖掘并利用丰富的语义表示信息(包括隐状态、token空间及词汇表);在视觉、检索、工具调用等模态与已冻结的纯文本LLM之间搭建桥梁;以及在零样本(Zero-shot)或未曾见过的全新场景中展现出强大的泛化能力。

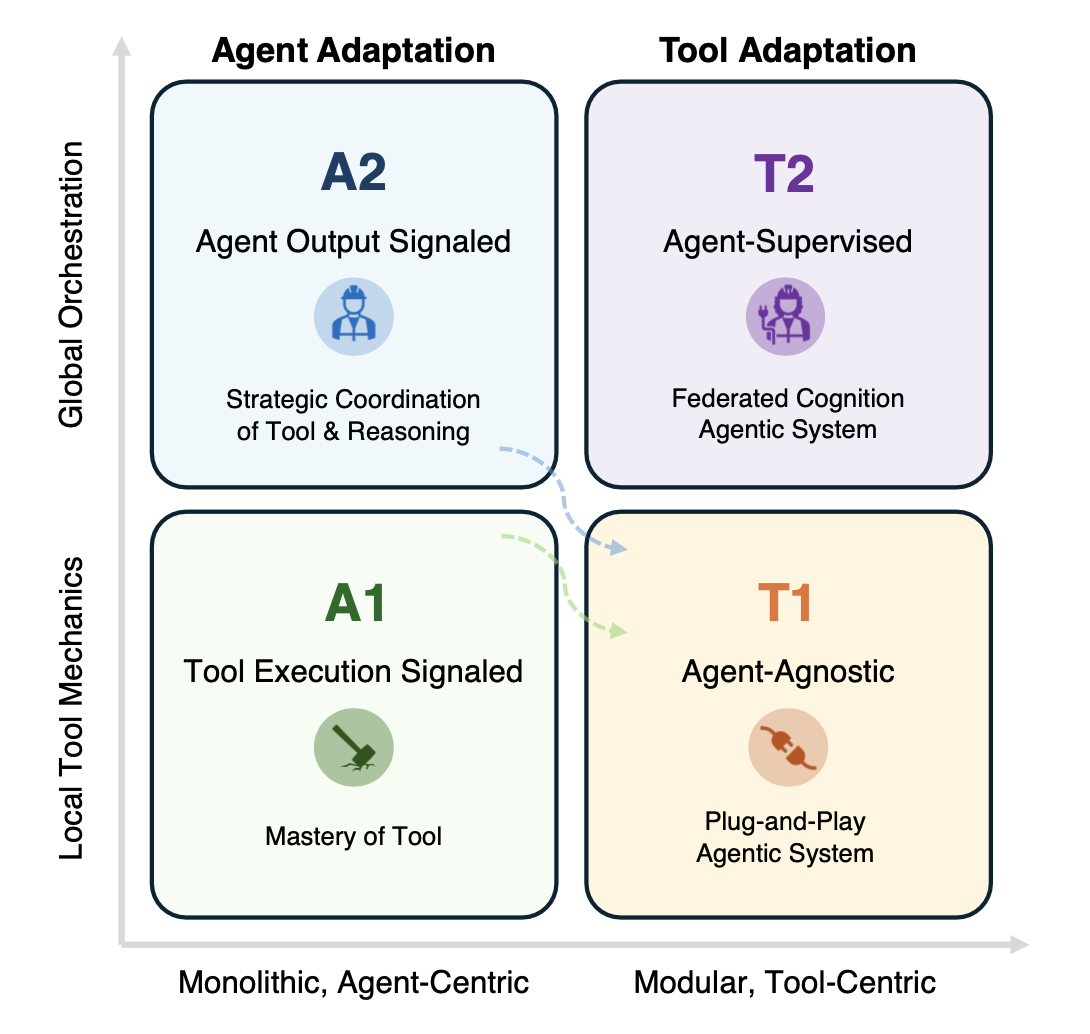

现在,对四种适应范式进行比较:(A1) 基于工具执行信号的智体适应,(A2) 基于智体输出信号的智体适应,(T1) 智体无关的工具适应,以及 (T2) 智体监督的工具适应。

1 比较框架

将从四个主要维度对这四种范式进行比较。

• 成本与灵活性:将“成本”定义为进行适应所需的计算资源和工程投入;将“灵活性”定义为系统行为的可重配置难易程度。A1/A2 范式提供高度的参数灵活性(整个智体策略均可变更),而 T1/T2 范式则提供高度的系统级灵活性(可通过工具添加、替换或组合各项能力),但其能力仍受限于作为基底的“冻结”智体所固有的推理能力。

• 数据效率:除了纯粹的计算资源消耗外,不同范式所需的训练数据量也存在显著差异。近期研究表明,T2 类方法仅需围绕一个“冻结”的核心骨干模型训练少量子智体,便能以远少于 A2 类端到端智体训练方法的数据量,达到甚至超越后者的性能水平。

• 泛化能力:该维度衡量的是适应策略在面对新任务、新智体或新环境时的迁移表现。基于广泛数据分布进行训练的 T1 类工具,往往能在不同的智体和任务之间实现泛化;而 T2 类工具则常能从其所依赖并进行监督的“冻结”基础模型中,继承跨领域的鲁棒性。相比之下,A1/A2 范式(尤其是其中的“同策略”变体)若缺乏明确的正则化手段,则存在过拟合特定环境的风险。

• 模块化与系统演进:该维度侧重于工程层面的考量,即系统在长期演进过程中,其扩展与维护的难易程度。以工具为中心的范式(T1/T2)支持模块化的演进模式,并允许对组件进行“热插拔”式的替换;而以智体为中心的范式(A1/A2)往往呈现出“单体式”的结构特征,且在经历反复适应性训练时,容易遭受“灾难性遗忘”问题的困扰。综上所述,智体适应(A1/A2)通过重写单个模型中的整个策略来实现,虽然提供高度的参数灵活性,但代价是昂贵的重训练成本以及对无关行为产生潜在副作用的风险。工具适应(T1/T2)则通过挂载专用工具来实现,这些工具可以随时添加或替换,且不会破坏基础智体的稳定性;不过,这种方法的局限在于它受限于被冻结(即保持不变)的智体所能理解和使用的范围。在数据效率和泛化能力方面,以工具为中心的适应方法均表现出优势;而在实际应用中,模块化——即无需重训练核心模型即可替换工具的能力——往往比单纯的原始性能更为关键。

2 智体适应范式:A1 与 A2

这两种以智体为中心的范式都涉及修改智体的核心参数,但在训练信号和优化目标上存在差异。

A1:通过因果反馈优化工具运作机制

A1 范式下的在线策略(on-policy)方法依赖于具有因果关系、即时且细粒度的奖励信号。其监督信号的来源并非下游任务的整体指标,而是工具执行本身所产生的、可验证的直接结果。例如,DeepRetrieval [22] 将查询重构问题形式化为一个马尔可夫决策过程(MDP),其中奖励直接源自 Recall@K 或 NDCG 等检索指标;而 RLEF [21] 则将代码合成任务构建为一个强化学习问题,其奖励信号源自测试用例的执行结果。这种方法与 A2 范式所采用的信号形成鲜明对比——A2 范式仅对最终答案进行评估。

从概念上讲,A1 范式下的在线强化学习(RL)旨在优化工具使用的运作机制:它教会智体如何正确地驾驭工具,使其行为紧密契合环境的“物理法则”(即“这段语法确实能够执行”、“这个查询确实能够检索到结果”)。通过与“真值”反馈进行直接交互,该方法在那些具有可验证且确定性结果的领域中展现出卓越的性能。

定量证据。在 A1 范式下进行的机制优化,在特定领域中取得显著成效:

• 检索任务:DeepRetrieval 在文献检索任务中,将召回率提升约 3 倍(从 24.7% 提升至 65.1%)[22]。

• 代码推理:R1-Code-Interpreter 通过多阶段强化学习,在 37 项测试任务中达到 72.4% 的准确率 [67]。

然而,这种基于试错机制的学习方式也带来一些实际挑战:为了确保训练过程能够稳定收敛,往往需要精心设计奖励函数,并结合使用 KL 散度正则化的 PPO 或 GRPO 算法、课程学习(curriculum learning)策略以及动态采样技术。

A2:通过整体奖励优化工具策略

A2 类方法转而采用基于智体输出质量(通常指最终答案的正确性)的整体性、稀疏且高层级的奖励信号;这类奖励虽然依赖于工具的使用,但并不直接对单次工具调用进行监督。ReSearch [109] 针对多跳问答任务进行训练,旨在优化何时以及如何执行搜索。其奖励机制所提出的问题并非“此次具体的搜索操作是否出色?”,而是“整个思考、搜索与推理的流程最终是否导向了正确的答案?”

因此,A2 优化工具使用策略与协作方式。它并非学习搜索的具体机制(假设这一任务由 T1 类型的检索器负责),而是学习一套认知策略——即何时进行搜索、搜索什么内容,以及如何整合搜索结果。这种对策略的聚焦,解释为何 ReSearch 在强化学习(RL)训练过程中,会展现出涌现式的反思与自我纠正行为 [109]。

定量证据。事实证明,A2 框架下的策略优化对于复杂的、多步骤的推理任务行之有效:

• 检索增强问答(Retrieval-augmented QA):相比于性能强劲的迭代式 RAG 基线模型,ReSearch 取得 9% 至 22% 的绝对性能提升 [109]。

• 事实准确性:R1-Searcher 相比于强 RAG 基线模型实现高达 24% 的性能提升;通过学习的检索策略,该模型不仅提高事实准确性,还有效减少“幻觉”(即虚构信息)现象 [108]。

在灵活性方面,A2 提供最为丰富的参数化灵活性:智体(Agent)能够调整其用于编排工具与推理过程的整套全局策略;然而,每一次此类策略调整都需要耗费高昂的成本进行重新训练,且最终形成的策略会被固化并内嵌于单一的大型模型之中。

A1 与 A2:作为可靠性维度的“信号源”。除了作为一种分类归纳之外,A1 与 A2 之间的区分还决定适应性信号的粒度与作用范围。

• 工具执行信号(A1):这类信号具有坚实的基础(grounded)、因果关联性强,且侧重于过程。其反馈信息由外部环境或工具生成,这些环境或工具的语义独立于智体自身的内部信念(例如:代码执行结果、检索指标、形式化证明验证器等)。这种基于外部环境的反馈机制,使得学习过程能够与中间步骤的正确性以及对工具的掌握程度紧密耦合;但也往往伴随着较高的交互成本以及对外部环境的强依赖性。

• 智体输出信号(A2):这类信号具有整体性、灵活性,且侧重于最终结果。奖励信号被赋予智体的最终输出结果,其依据可以是可验证的“真值”事实(例如:标准答案、数学题解),也可以是基于主观偏好的评估(例如:通过奖励模型进行评估)。尽管这种机制能够实现任务的端到端优化,但若仅依赖于这种终端信号,智体相比于 A1 框架下那种“密集型”信号,将更容易陷入“捷径学习”(即因错误的原因而恰好得到正确答案)的陷阱,同时也更容易面临反馈信号稀疏所带来的学习难题。

3 工具适应范式:T1 与 T2

以工具为中心的范式(Tool-centric paradigms)将优化的重心从成本高昂的智体本身,转移到成本相对低廉的外部工具之上。这些范式牺牲一定的参数灵活性(即智体策略保持固定),但换来系统层面的灵活性:无需触动主智体,即可对工具生态系统进行扩展、特化及重新编排。

T1:作为“工具化子智体”的“毕业智体”

T1 范式的核心特征在于其组件具有与具体智体无关(agent-agnostic)、预训练完成且即插即用的特性。T1 中的一个核心概念是“工具化子智体”(subagent-as-tool),它遵循一套特定的开发生命周期。

在一个极端上,拥有静态的基础性工具,例如 SAM [132] 或 AlphaFold2 [139];它们基于海量数据集进行一次性训练,并以固定的 API 形式进行部署。这些工具主要封装学习的表征或模拟器,可供任何智体调用。

而在另一个极端上,则是动态的“毕业”工具:自适应智体可以在 A1 或 A2 范式下进行训练,随后将其参数冻结,并作为 T1 工具进行复用。这一“毕业生命周期”(A1 → T1)的具体流程如下:

- 训练(A1/A2):利用在线策略强化学习(on-policy RL)或基于结果的强化学习(outcome-based RL)方法,针对特定任务训练一个智体(例如,将 DeepRetrieval 训练为搜索查询重写工具,或将 Code-R1 训练为代码生成工具)。

- 冻结:一旦该智体达到专家级性能水平,即将其参数冻结。

- 部署(T1):这一被冻结的专家级智体随即转化为 T1 范畴下的“工具化子智体”,可供任何更高层级的智体进行调用。

目前已有具体的案例遵循这一模式。DeepRetrieval 最初是通过同策略 A1 强化学习训练而成的一个查询重构智体 [22];但在其参数被冻结之后,它便可在众多不同的工作流中,作为一种可互换的 T1 检索增强工具加以使用。同样地,SWE-Grep [243] 作为一个专用的强化学习子智体被训练出来,旨在实现快速、多轮且高度并行的代码上下文检索;随后,它被封装并开放为一种工具,供软件工程智体(例如 SWE-Agent 或 Cursor 风格的 IDE 智体)调用,以实现高质量的代码仓库搜索功能。在这两个案例中,这些“毕业”后的子智体不仅封装学习的表征,更封装完整的学习策略;它们能够无缝嵌入到新系统中,且无需进行二次训练。从灵活性角度来看,T1 提供极高的系统级灵活性:不同的 T1 工具可以组装成多种配置,或者在不触及智体(Agent)主体的情况下,替换掉其中的某一个工具(例如检索器)。增加一项功能所需的成本,仅与相应工具的规模成正比,而与作为核心的智体主体无关。这种设计权衡所带来的代价是:这些工具并非专为特定智体量身定制;因此,智体必须调整其提示词或编排逻辑,以适应该工具所暴露的接口。

T2:反转优化目标

T2 反转传统的适应方向。T2 并非通过适应智体(Agent)来使其更好地使用工具,而是通过适应工具来使其更好地服务于一个固定的智体。这一做法将基础模型(Foundation Model)的角色从“优化目标”重构为了“监督源”。

在实践中,被冻结(即参数固定)的主智体(例如 GPT、Claude)负责提供推理能力和奖励信号,而轻量级的子智体(例如 7B 规模的模型)则负责学习如何重塑信息,以便主智体能够有效地加以利用。这种架构的核心优势在于实现“技能”与“知识”的解耦。像 Search-R1 这样的传统 A2 智体必须同时学习 (1) 领域知识、(2) 工具使用技能以及 (3) 任务推理能力,这导致其优化空间变得极其复杂。而在 T2 架构中,被冻结的生成器已然具备上述的 (1) 和 (3) 两项能力;因此,T2 子智体仅需专注于学习程序性的操作技能即可。

T2 子智体家族还体现一种特定的架构策略:将智体原本单一、整体化的认知循环(即“感知-规划-行动-反思”循环)拆解为一系列专门化且可独立训练的子模块:

• 优化“感知”环节(智体化搜索器):像 s3、DynamicRAG 和 QAgent 这样的系统,通过训练搜索子智体来决策“查询什么”、“去哪里搜索”以及“何时停止搜索”[28]。

• 优化“反思”环节(记忆构建器):像 Mem-α 这样的子智体,利用强化学习(RL)来学习记忆写入策略;其获得的奖励取决于所存储的过往经验能否有效提升被冻结生成器在未来的任务表现。

• 优化“规划”环节(元认知规划器):像 AI-Search Planner 和 AgentFlow 这样的子智体,负责决策如何调配工具及各类专业化模块。其中,AgentFlow [52] 仅需训练一个轻量级的规划器,通过接收轨迹层面的奖励信号来统筹调度那些参数固定的专业化模块;凭借这一架构,它在 GAIA 评测集上取得 33.1% 的得分,甚至超越规模远比它庞大的 GPT-4 模型。

综上所述,T2 架构实现极高的系统级灵活性:用户可以增量式地训练并接入全新的 T2 子智体(例如,接入一个更优秀的规划器、一个针对特定领域的搜索器,或是一个全新的记忆模块),而无需对作为主体的智体进行重新训练。与 T1 相比,T2 以牺牲部分“智体无关性”(agent-agnosticity)为代价,换取更紧密的兼容性:其工具是针对特定的、已冻结的智体进行特化的,这使得在相同的骨干模型(backbone)下,能够实现更高的数据效率和更优越的端到端性能。

4 综合分析:数据效率与模块化(A2 与 T2)

A2 与 T2 之间呈现了最鲜明的实证对比。两者均旨在构建具备强大工具使用能力的系统,但在承担学习任务的主体上,两者的侧重点截然不同。A2 采取的是“适应智体”的策略,让智体自身去内化工具使用的策略;而 T2 采取的则是“适应工具”的策略,让工具去学习如何为特定的、已固定的智体提供支持。

“检索增强生成”(RAG)领域提供一个极具启发性的案例研究。对比 Search-R1(属于 A2 范式)与 s3(属于 T2 范式):

• A2 范式(Search-R1):对完整的 Qwen2.5 智体进行端到端训练,需要约 17 万个训练样本,以协同调整其内部知识、推理能力以及工具使用策略 [50]。

• T2 范式(s3):仅训练一个轻量级的 7B 参数量级“搜索”子智体,并利用来自已冻结生成器(frozen-generator)的反馈信号(即 GBR 机制)进行优化;仅需 2400 个训练样本,便能达到与之相媲美的性能水平(平均准确率 58.9%)[28]。

注意事项:尽管这一对比具有一定的启发意义,但它并非一项严格受控的实验。Search-R1 针对完整的 Qwen2.5 智体进行端到端的整体训练;而 s3 仅训练一个 7B 规模的搜索子智体,并将其与一个已冻结的生成器(该生成器本身可能是 Qwen2.5-7B、14B 或 Claude-3-Haiku 模型)进行搭配使用。因此,这两个系统在优化目标、骨干模型构成以及系统架构等多个维度上均存在差异;效率差距,并不能简单地归因于某单一因素。如何设计受控的跨范式对比实验,从而将“范式选择”本身所带来的影响,从那些具有混淆作用的“架构差异”中剥离出来,目前仍是一个亟待解决的重要开放性问题。

尽管存在上述局限性,但这一案例研究依然揭示一项更为宏大的架构设计原则。T2 范式通过预设骨干模型已然承担绝大部分的知识存储与推理运算任务,从而极大地简化学习问题;它仅需在一个小型的子智体中,去学习并掌握一项特定的、狭义的程序性技能。相比之下,A2 范式所面临的优化空间(optimization landscape)则处于更高的维度:智体必须在同一时间轴上,同步调整其内部知识、推理风格以及工具使用的策略。在专业医疗问答任务上,经 T2 训练的 s3 模型准确率达到 76.6%,相比之下,经 A2 训练的 Search-R1 模型仅为 71.8% [28]。这一结果与“优化目标越聚焦,泛化能力越稳健”的假设相吻合,尽管目前尚不能完全排除其他解释(例如训练数据分布差异)的可能性。

从工程学的角度来看,T2 架构具有模块化的优势。若要更新 A2 智体,往往需要对整个单体模型进行重新训练,这极易引发“灾难性遗忘”问题。而在 T2 架构中,新工具的训练与热插拔操作均可独立完成,无需触及核心智体;这使得外围生态系统能够持续演进,而核心系统则得以保持稳定。

5. 战略建议

选择适应策略需要在计算成本、数据效率和系统模块化之间进行权衡。以下准则将上文提出的实证和架构证据提炼为针对从业者的具体建议。

A1 最适合用于在检索、代码执行和 SQL 等稳定领域中,对可验证工具进行局部、机制性的精通。通过直接针对可执行结果进行优化,A1 能够建立强大的底层能力和因果基础,使从业者能够精确控制工具的行为,并实现与可验证信号的稳健对齐。其代价是高昂的:每一次训练运行都需要消耗大量的计算资源,且由此产生的专业化能力往往在跨任务或跨工具接口时的泛化效果较差。

当单个智体(Agent)必须协调多个工具并执行整体推理时,A2 是恰当的选择。A2 能够内化何时、如何以及为何调用工具的逻辑,从而为复杂的工作流生成深度集成、端到端的策略。这种集成的代价是昂贵的整体重训练成本,以及在智体随后适应新领域时容易遭受“灾难性遗忘”的风险。

T1 提供横向的可扩展性和可重用性。该类别涵盖静态的基础模型(例如 SAM、AlphaFold2)以及“已毕业”的子智体——即那些经过 A1/A2 训练后被冻结并重新部署为可重用模块的专家(例如 DeepRetrieval、SWE-Grep [243])。这些“作为工具的子智体”封装学习的程序性专业知识,同时保持与任何特定宿主智体(Host Agent)的解耦,从而实现即插即用的模块化特性和广泛的组合灵活性。由于 T1 工具的训练过程未参照特定的智体,因此它们可能无法针对任何特定的宿主智体的推理风格实现最优化的适配。

T2 颠覆适应性问题的视角:它不再是让智体去适应以更好地使用工具,而是在冻结的智体(宿主)的监督下,训练轻量级的工具和子智体,以更好地服务于固定的核心骨干(例如 s3 风格的搜索器、规划器、顾问和记忆构建器)。宿主智体提供高层级的推理能力和奖励信号,而 T2 子智体则学习狭窄的程序性技能;这些技能可以在不触及核心骨干的前提下进行添加、替换或组合。T2 通过模块化更新实现针对新技能的高数据效率,并缓解灾难性遗忘的问题;但其子智体的能力受限于监督智体的质量,且多子智体管道的引入会增加编排的复杂性,并可能导致潜在的错误累积。综合来看,这四种范式可以投射到一个互补的 2×2 设计空间视图上(如图 7 所示)。请注意,这种投射是一种解释性的比较,而非定义性轴线;后者是根据“被适配的对象”以及“信号的获取方式”来对方法进行分类的,而这里的轴线则捕捉更广泛的架构趋势:(i) 从局部到系统的谱系(y 轴),涵盖从对特定工具的低层级控制(A1/T1)到对多工具推理进行整体编排(A2/T2)的范围;以及 (ii) 从单体到模块化的谱系(x 轴),涵盖从对单一智体进行端到端重训练(A1/A2)到通过分布式子智体和工具进行组合式适配(T1/T2)的范围。若以此视角审视,A1 和 A2 占据该图景中以智体为中心的一半区域:它们直接重塑核心智体的策略参数,虽然提供丰富的参数灵活性,但也带来高昂的计算、数据和稳定性成本。

相比之下,T1 和 T2 占据以工具为中心的一半区域:它们将学习过程向外转移至一个模块化的生态系统中,从而实现增量演化、专业化分工以及组合式复用。这两条轴线之间存在非线性交互:A1 → T1 反映“进阶路径”(即固化的专家模型演变为可复用的子智体),而 A2 → T2 则遵循“联邦路径”(即固化的主干网络负责统筹管理日益壮大的自适应专家智体群)。在实践中,成熟的智体架构正日益向右上象限(T2)靠拢:即实现高模块化与高编排度的结合,在此架构下,基础智体充当稳定的认知核心,而外围的子智体则持续演化以拓展其能力边界。

由此呈现的图景清晰地揭示智体 AI 研究领域中正在浮现的劳动分工格局。A1 和 A2 范式对于生成新的推理能力或重新校准模型的内部认知而言依然不可或缺——这些任务往往要求对智体的核心部分进行修改。然而,在系统构建层面,T1 和 T2 范式占据主导地位:它们为系统的持续增长、细粒度的专业化分工以及安全的并行实验提供有力支撑。因此,当前的主流设计趋势指向混合系统:以“冻结”的基础模型为核心,辅以一套模块化的 T1/T2 子智体——这些子智体经过专门训练,负责特定的程序性职能;此外,周期性的 A1/A2 更新则标志着该智体内部推理能力的演进式跃升。

基准

略

应用

略

机会

略

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)