万物皆可协同:深度解构 AI Agent Swarm 的架构演进、工程暗礁与未来

当单体 Agent 的 Prompt 膨胀到逼近模型推理极限,且系统鲁棒性在复杂长程任务中不可避免地呈现指数级衰减时,工程界的共识正在发生偏移:与其期盼一个无所不能却极易崩溃的“超级单体”,不如构建一张基于标准协议的“协同网络”。

当单体 Agent 的 Prompt 膨胀到逼近模型推理极限,且系统鲁棒性在复杂长程任务中不可避免地呈现指数级衰减时,工程界的共识正在发生偏移:与其期盼一个无所不能却极易崩溃的“超级单体”,不如构建一张基于标准协议的“协同网络”。Agent Swarm 模式正成为打破大模型复杂度瓶颈的破局之刃。

Swarm 的底层逻辑清晰而直接——通过“专职分工+动态交接”,将极高复杂度的非确定性任务,降维解耦为高确定性的局部状态流转。然而,从理想化的概念 Demo 走向高并发、高可用的工业级生产环境,多智能体协同的繁荣表象背后暗礁险恶。

本文将褪去 MAS(多智能体系统)的炒作光环,以纯粹的工程视角对 Swarm 架构进行深度解剖。我们将下探至底层通信协议与上下文流转机制,直击横亘在工业落地前的三大工程鸿沟:状态路由失控、通信雪崩与系统可测性缺失,并最终推演 Agent Swarm 走向确定性演进的终局路线。这不仅是一次对多智能体底层架构的硬核拆解,更是为深水区探索者准备的实战避坑指南。

1. 从“全能单体”到“群体涌现”:Swarm 模式的底层逻辑与破局点

想象一个极其常见的工程灾难现场:为了打造一个“全能”的智能客服 Agent,开发者在它的 System Prompt 中塞入了业务规则、语气要求、近百种 Edge Case 处理逻辑,并挂载了查订单、退款、修改积分、甚至调用外部物流 API 等 30 多个工具(Tools)。结果不出所料——这个看似全能的庞然大物开始频繁把退款请求路由给技术支持,在调用简单的查询接口时编造不存在的参数,甚至在上下文稍长时彻底遗忘最初的用户指令。

这并非个别开发者遇到的偶然 Bug,而是单体 Agent(Single-Agent)架构发展到深水区后必然遭遇的物理瓶颈。在基座模型能力日益强悍的今天,为什么我们必须将目光投向多智能体协作(Multi-Agent System, MAS)的 Swarm 架构?答案隐藏在工程极限与系统解耦的底层逻辑之中。

单体架构的物理法则与坍塌点

单体 Agent 的核心困境,在于将无限开放的业务复杂度强加于有限的模型注意力机制之上。这种架构的坍塌通常由两个致命的因素引爆:

首先是系统提示词过载导致的“注意力失焦”(Attention Defocus)。 当开发者试图用一个超长的 Prompt 来覆盖所有职责边界和防御性指令时,LLM 会遭遇经典的“Lost in the Middle”现象。指令间的相互覆盖与冲突,导致模型在处理复杂请求时如同一个认知过载的接线员,无法在广阔的 Context Window 中保持对核心任务的绝对聚焦。

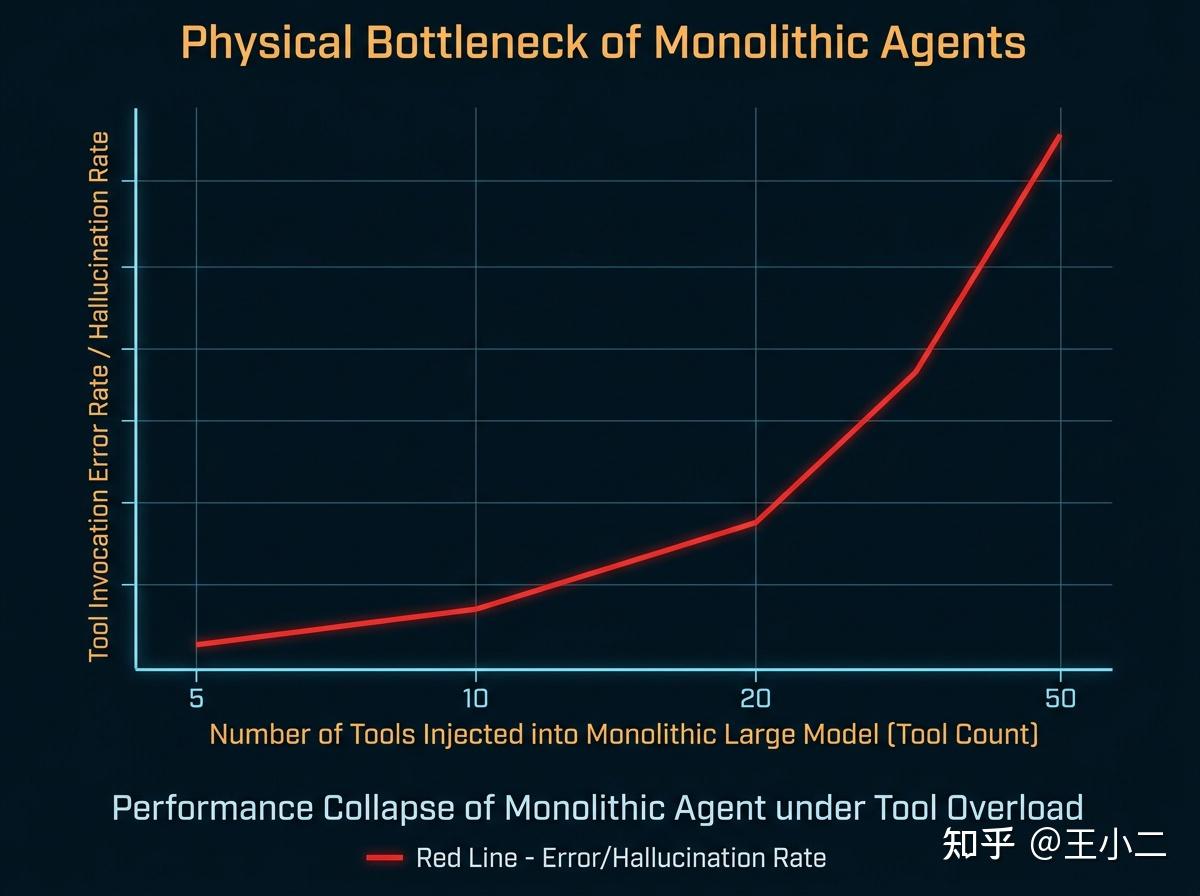

其次,工具调用(Tool Calling)数量的增加,直接导致大模型幻觉率呈指数级上升。 工程实践表明,当一个单体大模型被挂载的 API 或工具数量超过某个临界值(通常在 10-15 个左右)时,其工具选择的准确率会发生断崖式下跌。模型需要在海量工具的 Schema 中进行复杂的意图匹配与参数提取,搜索空间的爆炸使得幻觉和类型错误难以避免。

单体 Agent 工具数量与错误率关系示意图

打破中心化:Swarm 的微服务仿生学

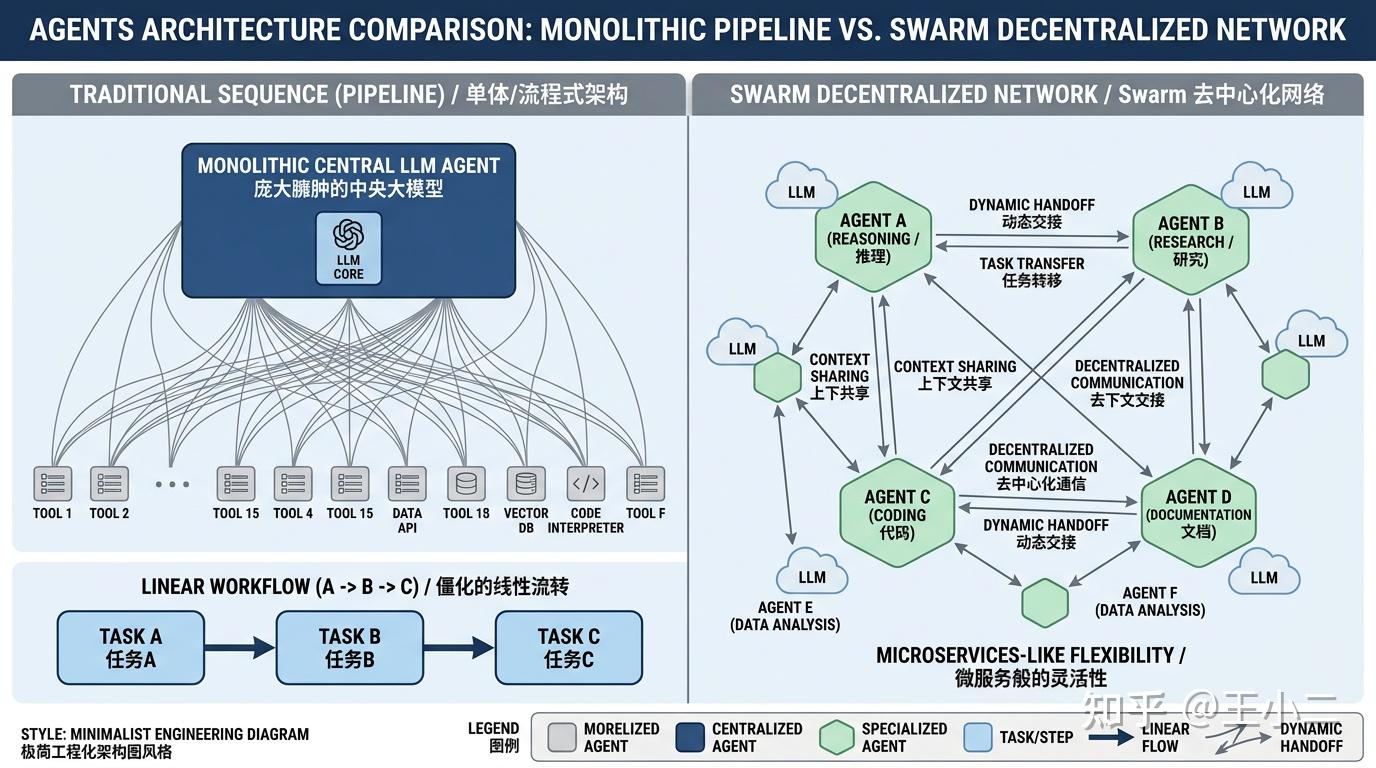

为了解决单体的脆弱性,早期的工程方案倾向于构建流水线式的 Agent(Pipeline)。这种模式通过静态的 DAG(有向无环图)将任务切分为 A -> B -> C 的顺序执行链路。然而,真实世界的复杂业务问题往往是“非标”的,僵化的预设流水线一旦遭遇偏离既定流程的用户输入,整个系统便会立刻宕机。

Agent Swarm 的出现,本质上是一场从“中央集权”到“去中心化网络”的仿生学演进。

在 Swarm 架构下,系统不再依赖一个无所不知的“超级大脑”或刻板的流水线,而是被拆解为数十个轻量级、专职化的智能体。这犹如软件工程从单体架构(Monolith)向微服务(Microservices)的跃迁:

- 专职分工:每个 Agent 只有极简的 System Prompt 和少数几个高度相关的工具(例如,退款 Agent 只能看到退款相关的指令和 2 个 API)。这彻底消除了单一节点的认知过载。

- 动态交接(Handoff):系统不需要静态预编排,Agent 可以根据当前上下文自主判断任务归属。如果“前台 Agent”发现用户在询问退货规则,它会直接将对话状态和控制权路由给“退换货 Agent”。

传统流程式架构与 Swarm 动态拓扑对比图

核心范式转移:从“炼丹”走向“系统架构”

理解了 Swarm 的底层机制,我们也就触及了当前 AI 工程界最重要的一次范式转移:开发者解决问题的核心路径,正从“如何写一个完美无缺的 Prompt”转化为“如何设计一个高效的智能体协作网络”。

在单体时代,开发者如同炼丹师,不断通过调整提示词的措辞、顺序、甚至标点符号来玄学般地压榨模型能力;而在 Swarm 时代,开发者重新回到了严谨的架构师角色。通过定义清晰的边界、设计专职化的节点、以及建立高效的拓扑网络,复杂大问题被降维成多个简单小问题,系统整体的鲁棒性与可扩展性(Scalability)得以涌现。

然而,将大而全的单体打碎为多智能体网络,只是迈出了破局的第一步。当成百上千个微小的“大脑”开始在系统中互相交谈、接力与推诿时,我们不可避免地会撞上另一堵高墙:多节点之间究竟应该如何高效、精准地握手通信?一旦状态流转失控,又该如何防止整个 Swarm 陷入死循环的无底洞?

2. 解剖 Swarm 架构:通信协议、路由机制与上下文流转

当我们将目光从单体大模型(LLM)的算力暴力美学移开,投向微服务化的多智能体网络时,工程视角的焦点也随之转移:决定一个 Swarm 系统能否跑通并具备工业级可靠性的,不再是单一模型参数量的大小,而是节点之间的连接方式。

如同微服务架构依赖于 HTTP/REST 或 gRPC,Agent Swarm 的运作也建立在隐形的底层网络之上。智能体如何对话?如何决定由谁来处理特定子任务?上下文记忆如何在转移中保持纯净?解剖这些底层机制,是我们跨越概念炒作、走向真正工程落地的必经之路。

从双向广播到轻量级 Handoff:核心通信机制的演进

在早期多智能体框架(如 AutoGen)中,最直观的通信范式是对话式广播(Conversational Broadcasting)。系统将不同设定的 Agent 放入一个虚拟的“聊天室”中,依靠大模型自身的文本生成能力互相触发响应。这种基于自然语言的 P2P(点对点)通信在演示写贪吃蛇代码等 Demo 时极具观赏性,但在真实业务流中却是一个工程灾难——它的控制流是极其非确定性的,开发者很难预测下一个发言的究竟是“代码生成员”还是“代码审核员”。

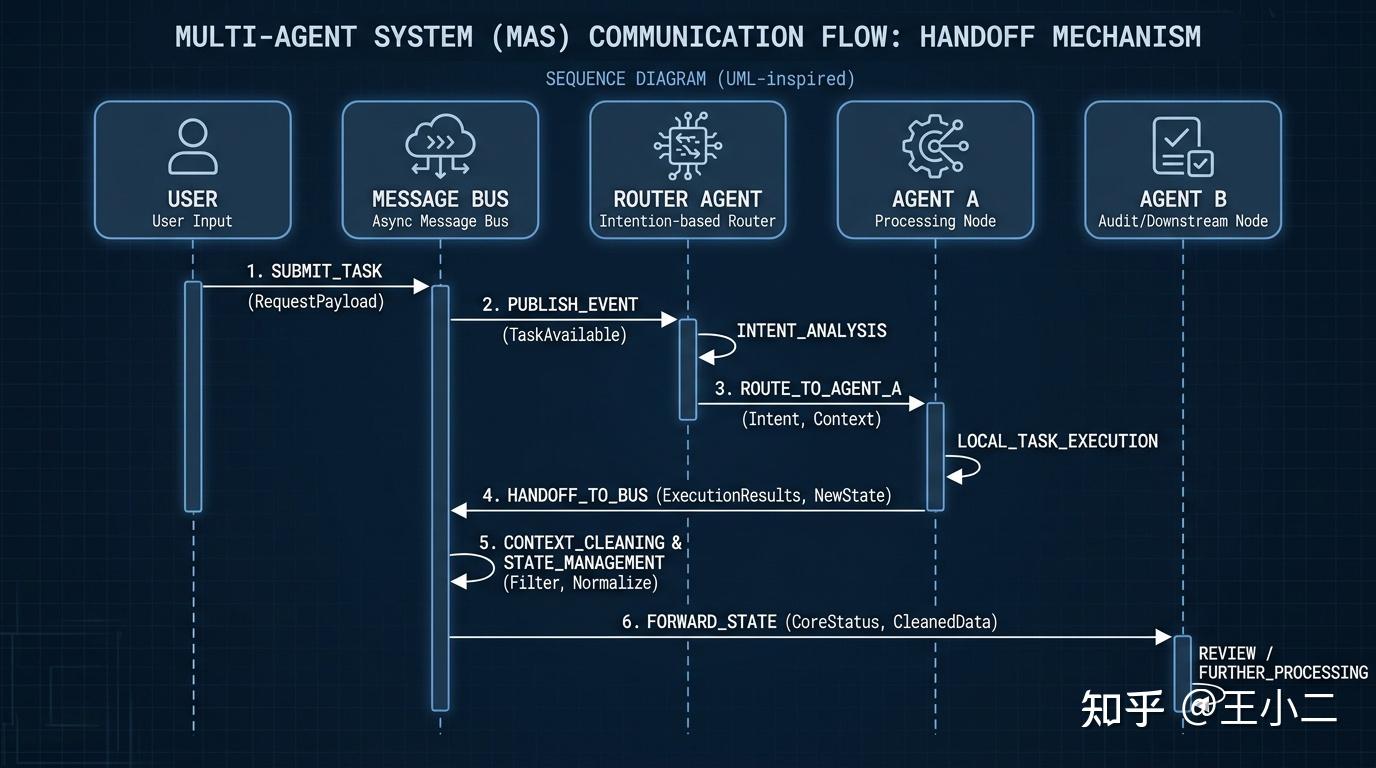

为了收敛这种不可控性,OpenAI 在其概念验证框架 Swarm 中提出了一种更符合现代软件工程直觉的机制:交接(Handoff)。

在 Handoff 机制下,Agent 不再是随心所欲聊天的拟人化实体,而是一个包含指令(System Prompt)和可用工具(Functions)的状态机节点。当当前 Agent 认为某一任务超出自身处理边界时,它不会用自然语言去“呼叫”另一个 Agent,而是直接返回另一个 Agent 的实例对象。这种机制将智能体间的通信降维成了标准的函数调用(Function Calling)。

我们可以通过一段伪代码来直观理解这种优雅的交接逻辑:

# Handoff 交接机制的核心抽象

refund_agent = Agent(

name="Refund Agent",

instructions="你是退款专员,负责处理用户的退款请求。"

)

def transfer_to_refund_agent():

"""当识别到用户的真实意图是处理退款时,调用此函数"""

# 将执行权交接给下游的 Refund Agent

return refund_agent

sales_agent = Agent(

name="Sales Agent",

instructions="你是销售专员,负责介绍产品。如果用户要退款,请转移控制权。",

functions=[transfer_to_refund_agent] # 核心:将交接动作封装为工具

)

# 执行引擎捕获到 function call 返回了一个 Agent 实例,自动发生上下文切换在这种设计中,控制权的转移是显式且强类型的。执行引擎(Engine)在后台充当了调度中心,其底层架构本质上是一条消息总线(Message Bus),将 Agent 间的状态移交转化为标准的异步事件流传递。当发现 Agent A 的工具调用结果是 Agent B 时,引擎就会立刻挂起 A 的状态,将上下文无缝注入 B 中并激活 B 的主循环。这不仅大幅降低了不可控的对话发散,还为系统引入了可追踪的审计日志。

基于消息总线的多 Agent 通信时序图

动态路由:在意图重叠区确立边界

Handoff 机制解决了“怎么转移”的问题,而动态路由(Dynamic Routing) 则需要回答“何时转移”以及“转移给谁”。

在传统软件中,路由是基于静态规则(IF-ELSE)或正则表达式的。但在复杂的自然语言交互中,用户的意图往往是模糊且复合的。工业级 Swarm 架构通常采用基于语义边界的意图路由算法。

智能体判断自身任务边界并非依赖外部中心节点的硬编码分配,而是基于“内省”。每一个专职 Agent 都在其 Prompt 中被划定了严格的“职责隔离带”。例如,当一个“数据分析 Agent”面对用户“生成图表并撰写公关新闻稿”的请求时,它会首先生成数据图表,随后在意图识别模块(通常是一个轻量级的 LLM 判别器)的干预下,意识到“撰写新闻稿”超出了自身能力域,从而主动拉起路由挂载点,将半成品数据移交给“文案 Agent”。

这种动态路由的精妙之处在于延迟决断——系统不需要在用户刚输入提示词时就规划好完整的执行路径,而是允许网络在运行过程中,根据子任务的完成情况和涌现出的新状态,动态规划下一跳的目标。这使得 Swarm 具备了极强的容错与适应复杂业务逻辑的能力。

记忆与遗忘的艺术:上下文管理与状态隔离

随着任务在多个 Agent 之间不断击鼓传花,另一个致命的工程问题浮出水面:在传递信息时,到底该带走什么,又该丢弃什么?

如果将历史对话不加甄别地全量传递,会导致 Context Window 迅速被垃圾信息填满。比如,Agent A 在尝试调用 API 时经历了 5 次失败的试错(Thought/Action/Observation 循环),当它把最终结果交接给 Agent B 时,Agent B 并不需要知道 A 试错了 5 次,它只需要确切的最终数据。如果不进行隔离,下游 Agent 极易受到上游无效中间步骤的干扰,引发“Token 污染”,进而导致幻觉率飙升。

为此,成熟的 Swarm 架构引入了全局共享记忆(Shared Memory)与私有草稿本(Scratchpad)的读写分离设计。

- 私有草稿本(Scratchpad):每个 Agent 拥有独立的临时工作区。在处理任务期间,所有的中间思考过程(Chain of Thought)、工具调用日志、自我纠错尝试,均被限制在 Scratchpad 内,对系统中的其他节点严格不可见。

- 全局共享记忆(Shared Memory):作为不同 Agent 间的信息契约。当发生 Handoff 时,交接发起方必须调用特定的

Summarize & Commit工具,将冗杂的草稿本提炼为结构化的核心状态(如:“订单状态已验证为有效,退款金额为 50 元”),并写入 Shared Memory。

下游接收接力棒的 Agent,其 Prompt 组装逻辑是:系统指令 + 全局 Shared Memory + 下游自身的空 Scratchpad。通过这种严格的状态隔离与“强迫遗忘”,Swarm 系统巧妙地在维持业务连贯性与控制 Token 噪声之间找到了平衡。

这种极简而严密的通信、路由与上下文隔离协议,构成了多智能体系统的“骨架”。然而,哪怕架构设计得再优雅,一旦将其投入真实的、高并发的业务洪流中,那些深藏于异步通信与去中心化决策底层的幽暗角落,依然会催生出单体时代闻所未闻的工程噩梦。系统的不可控性,正潜伏在下一次智能体之间的对话之中。

3. 繁荣背后的工程暗礁:当前 Swarm 落地的三大技术困境

前面我们在拆解 Handoff 与共享记忆机制时,看到了构建可控 Swarm 的理论路径。这些精妙的架构设计在概念验证(PoC)阶段往往表现出令人惊艳的“涌现”能力。然而,工业界从来不为实验室里的 Demo 买单。当把这套由大模型驱动的去中心化协作网络置于真实业务的高并发、长链路与非标准意图的淬炼中时,单体大模型的物理瓶颈虽然被绕过,但分布式系统的工程梦魇却随之而来。

当前,横亘在 Swarm 架构从“玩具”走向“生产级应用”面前的,是三座难以逾越的工程暗礁。

通信雪崩与成本黑洞

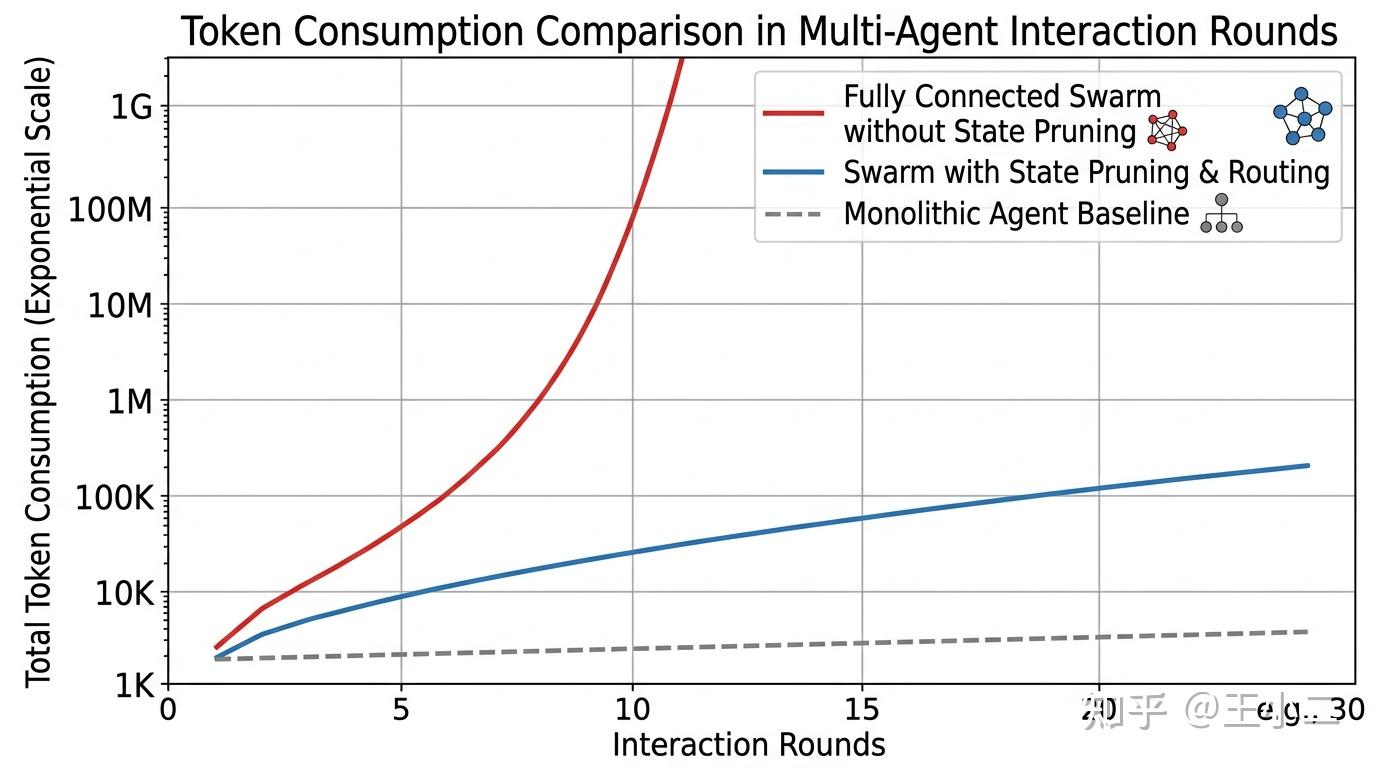

单体 Agent 的主要成本在于单次长上下文的生成,而 Agent Swarm 的成本结构则演变成了复杂的网络通信消耗。在多智能体协作中,为了让下游节点“接得住”上游抛出的任务,必须传递历史上下文。如果系统缺乏极其严格的状态裁剪与路由约束,多轮相互对话会导致 Context 迅速膨胀。

在早期的全连接通信网络(即所有 Agent 均可相互对话)或非确定性多轮 Handoff 场景中,随着 Agent 参与者数量和协作轮次的增加,每次交互都需要将累积的对话历史与多个 Agent 的 System Prompt 重新输入给大模型。这种计算冗余不仅会带来不可控的延迟飙升,更会导致极其高昂的 Token 消耗。

多智能体协作网络 Token 消耗曲线对比

观察多 Agent 在缺乏收敛机制时的 Token 消耗指数增长曲线可以发现:在无状态剪枝的全连接 Swarm 中(红色曲线),系统仿佛陷入了“通信雪崩”。比如 A 和 B 两个 Agent 为打磨一段代码往复交互 5 个回合,第 5 回合携带的 Token 量将包含前 4 回合的所有试错细节,导致总消耗呈现 级别的飙升。要打破这个成本黑洞,开发者必须在工程链路上引入强制总结(Summarization Node)与私有状态截断机制,将指数级的消耗拉平至对数级或线性(蓝色曲线)。

死锁与无限循环(Infinite Loop)的黑盒

如果说 Token 消耗是显性的账单刺客,那么运行时的状态崩溃则是隐性的定时炸弹。在传统软件的微服务架构中,服务间的循环调用和级联故障是经典难题。如今,这一难题在 LLM 身上不仅重演,而且因为大模型输出的“非确定性”变得极其难以调试。

当去中心化智能体基于自然语言或不完美的结构化输出进行决策时,由于 LLM 偶尔的“自信幻觉”或“甩锅倾向”,极易发生智能体相互等待或相互推诿的现象,最终形成无限循环(Infinite Loop)。

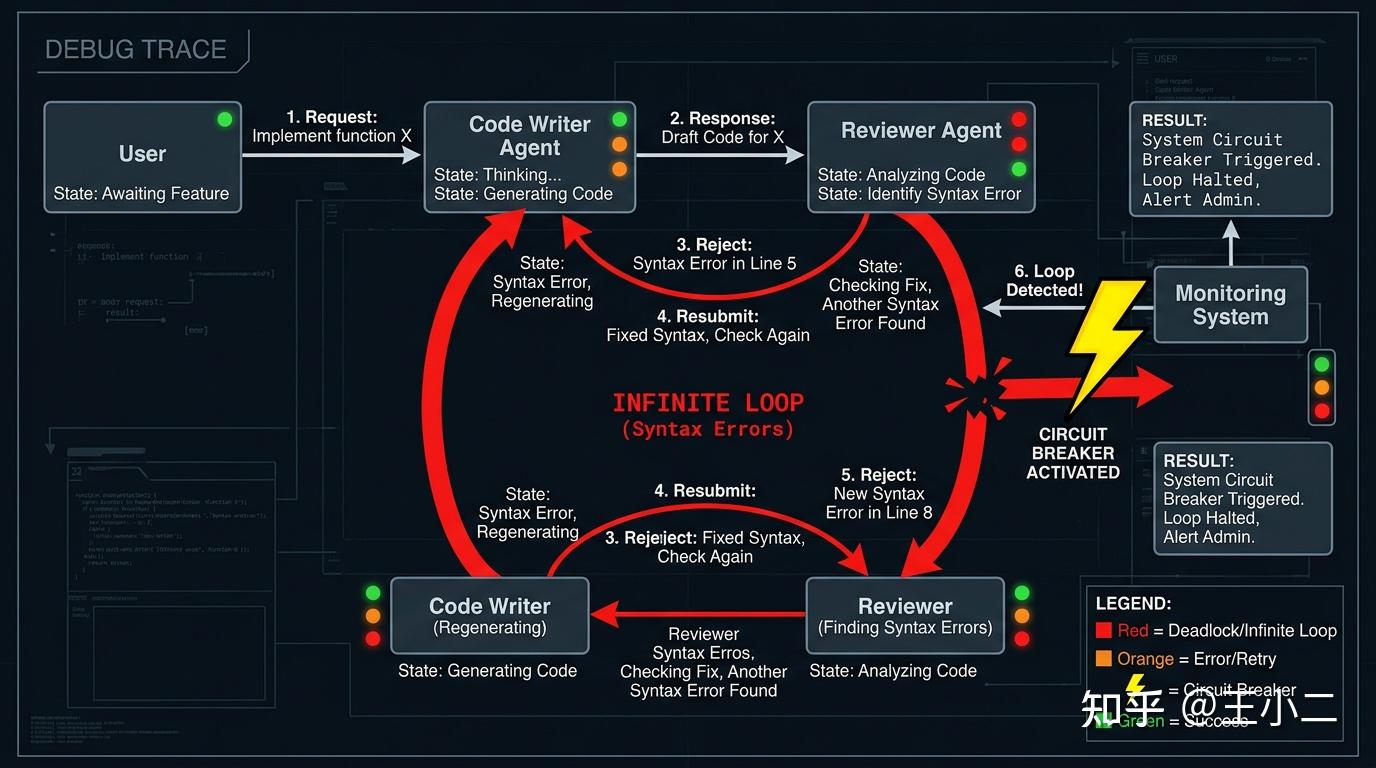

真实的 Swarm 死锁调试 (Debug Trace) 链路解析

在真实的 Swarm 死锁调试(Debug Trace)案例解析中,我们经常能观测到这种微观灾难:例如一个负责编写代码的 Coder Agent 调用本地编译器失败,抛出了一个晦涩的语法错误给 Reviewer Agent;Reviewer 认为代码逻辑没问题,只是参数缺失,于是将任务抛回并要求 Coder 重写;Coder 由于自身上下文窗口的限制或固有的模型缺陷,再次生成了一模一样的错误代码。在没有任何干预的情况下,这两个智能体能在几十秒内完成数十次毫无意义的互相 Handoff,直到耗尽平台的并发限额。

面对这种黑盒死锁,纯依赖 Prompt 的“软约束”是极其脆弱的。在工业级落地中,必须在基础架构层引入熔断机制(Circuit Breaker)。工程团队需要为每个流转链路设定最大跳数(Max Hops)、设定任务生存时间(TTL),甚至建立一个独立于业务逻辑之外的“监控 Agent”或“规则引擎”,在检测到重复推诿特征时强制终止循环,执行降级策略或呼叫人类接管。

评估危机(Evaluation Crisis)

解决了成本与运行时的稳定性,系统最终要面临的是工程化迭代的终极拷问:如何证明你的修改让 Swarm 变得更好了?这引发了当前多智能体领域最严峻的痛点——评估危机。

在单体大模型时代,我们的评估(Eval)逻辑是线性的:给定输入,校验输出是否符合预期。现有的 Eval 框架(如 RAGAS 或单一的 LLM-as-a-judge)很大程度上都是基于这种“点对点”的快照式评估。然而,一旦引入多智能体架构,非确定性交互使得整个系统呈现出高度的混沌状态。

哪怕我们固定了模型的 Temperature,外部 API 的微小延迟波动、并发调用的时序差异,都可能导致大模型的注意力发生偏移,进而使得 Agent 之间的路由轨迹完全分岔。这种极难复现 Bug 的特性让传统的单元测试和回归测试彻底失效。最终输出的结果如果是正确的,它可能是经过了错误的中间环节偶然得出的(“大力出奇迹”);而如果最终结果是灾难性的,我们也很难归因到底是哪个具体的 Agent 在哪一次 Handoff 中做出了致命的错误决策。

因此,当前的 Swarm 落地亟需针对“多节点系统动态轨迹(Trajectory)”的全新评估标准。开发者必须建立能够捕获微观状态跃迁的 Trace 机制,将评估重点从“只看最终结果”转向“校验流转路径的合理性与边界安全性”。

状态路由的脆弱、通信成本的黑洞以及可测性的缺失,是阻碍当前 Swarm 架构大规模商业化的三大暗礁。而要跨越这片暗礁,纯粹依赖基础模型的智力涌现已经不切实际,我们需要一场架构范式的再升级。

4. 走向工业级落地:Agent Swarm 的演进趋势与终局推演

当我们在前文审视了状态通信的非线性膨胀、去中心化路由带来的死锁,以及动态轨迹评估的全面失效后,不难发现:当前绝大多数基于 Agent Swarm 的系统,依然停留在极度脆弱的“作坊式 PoC(概念验证)”阶段。要跨越从演示 Demo 到工业级基建的鸿沟,仅仅修补现有的 Prompt 模板或增加几个重试逻辑是徒劳的。多智能体架构必然要经历一次底层的范式重构。基于工程痛点与算力演进趋势,我们推演 Agent Swarm 走向工业化落地的终局将围绕以下三个核心轴线展开。

异构网络演进:从算力均质化走向 Heterogeneous Swarm

当前主流的 Swarm 实践中,往往存在一个隐性误区——算力均质化配置,即网络中的每一个 Agent 节点都被默认挂载了顶级大模型(如 GPT-5.4 或 Claude 4.6 Sonnet)。这种架构在应对高频交互时,会导致两个致命的工程瓶颈:不可控的延迟预算(Latency Budget)与指数级攀升的 API 成本。

在真实的工业级流水线中,并非所有任务都需要“博士级”的智力。下一代架构将向异构 Swarm 网络(Heterogeneous Swarm) 演进。系统将根据任务所需的“认知复杂度(Cognitive Complexity)”进行算力分层调度:由顶级大模型充当“中央大脑”,负责模糊意图的拆解、全局战略规划与长程反思(Reflection);而将大量的轻量级路由、状态流转解析与高频工具执行下放给端侧小模型(SLM, Small Language Models)。由于 SLM 在特定领域(如基于 Schema 的函数调用)经过蒸馏与微调,其 TTFT(首字延迟)极低且成本近乎忽略不计,能够在数十毫秒级完成节点间的 Handoff。

云端协作异构 Swarm 拓扑概念图

这种架构在物理拓扑上类似于现代计算机系统的主 CPU 与各类协处理器(如 DSP、NPU)的协同关系。当边缘 Agent(由 SLM 驱动)遇到置信度过低的 Edge Case 时,再将上下文以 Fallback(回退)的形式打包上抛给中央大脑进行重新规划,从而在成本、延迟与智能上限之间达成纳什均衡。

信任边界重构:Human-in-the-Loop 2.0 机制

在早期的单体 Agent 时代,人类通常扮演的是系统外部的“提示词输入者”或最终结果的“被动接收者”。但在极其强调安全性与可控性的工业场景(如金融核心链路清结算、核心数据库 DDL 变更)中,全自治的 Swarm 网络依然面临无法逾越的伦理与风险兜底障碍。

这催生了人机混合编排(Human-in-the-Loop 2.0)的必然演进。在未来的 Swarm 架构中,人类不再是游离于框架之外的旁观者,而是被抽象为拥有系统最高读写权与一票否决权的“特殊 Agent”,被无缝编排进拓扑网络中。

从机制实现上看,开发者可以定义一个特殊的 Human_Agent 节点。当业务流转触发了预设的硬性约束规则(如涉及资金流出金额大于 1 万),或者前置 Agent 在执行复杂推理时输出的置信度评分跌破系统设定的安全阈值,路由机制将立即挂起当前控制流,将执行权 Handoff 给 Human_Agent。人类通过审批、补充上下文指令或直接干预变量状态后,再将控制流交接回机器子网络。这种将人类决策逻辑微服务化的设计,彻底解决了强监管领域内 AI 无法独立闭环的死局。

跨越孤岛:寻找 Agentic 时代的 TCP/IP 协议

当前的 Agent 框架生态正处于严重的“巴尔干化(Balkanization)”阶段。各个框架虽然都在探索多智能体协作,但由于缺乏统一标准,导致不同系统间的节点完全无法互相通信。为了清晰展现这一生态割裂的现状,我们对当前主流多智能体框架的底层设计与演进路线图进行了横向对比推演:

| 框架阵营 | 核心设计哲学与机制特征 | 当前工业落地局限性 | 路线图推演与演进趋势 |

|---|---|---|---|

| OpenAI Swarm | 极简主义,将复杂的控制转移降维为无状态的 Handoff 函数调用 | 缺乏持久化状态机与工程级容错编排,仅作为前沿 PoC | 将剥离业务逻辑,下沉为多智能体系统的底层运行时(Runtime)原语 |

| AutoGen | 泛用性多节点对话模式,强调双向广播与非确定性群体涌现 | 极易引发通信雪崩,状态流转的非确定性让 Bug 难以复现 | 引入严格的 FSM(有限状态机)控制层,加强异构网络中的节点编排稳定性 |

| CrewAI | 基于角色扮演(Role-playing)与职能化流水线编排,开发者心智负担低 | 任务流向过于固定,难以应对需要动态规划的高复杂度模糊任务 | 强化与现有企业 IT 生态(如 ERP、CRM)的工具集成,走向确定性的企业 RPA 替代品 |

| LangGraph | 将图论与状态机深度结合,构建全状态接管的图遍历引擎 | 图状态对象过于庞大与中心化,导致内存开销极大 | 拆解单体图状态,向分布式事件驱动架构及多节点可观测性评估平台演进 |

透过上述矩阵可以看出,各大框架虽然切入点各异,但都在试图定义多智能体的边界。然而,真正的工业化基建不可能建立在孤岛之上。未来的终局一定是走向标准化——诞生类似于互联网 TCP/IP 的跨框架智能体互操作协议(Agentic Interoperability Protocols)。

该协议将在架构层面上定义一套标准:如何对一个 Handoff 载荷进行封装?如何在跨域传输中校验 Agent 的身份鉴权(Identity & Auth)?如何在不发生 Token 污染的情况下传递标准化的“共享记忆”结构?只有当标准的底层通信协议确立,开发者才能用 AutoGen 编写一个精于深度思考的战略节点,然后通过网络无缝路由给用 CrewAI 搭建的、擅长调用外部 API 的执行节点。多智能体协作的终极价值,正是来自于这种跨栈、跨边界的微服务级解耦。

结语

Agent Swarm 并不是某种魔法般的智能涌现,其本质是一种用工程手段对抗复杂度的系统级范式。它承认了大模型单点能力的边界,转而用“专职分工与动态路由”的系统架构设计来换取更稳定的任务执行率。从死磕单体的 Prompt Engineering,到精细化构建节点的 System Engineering,这是每一位 AI 开发者必须跨越的思维分水岭。未来的软件工程,注定是碳基工程师与无数专职硅基 Agent 共同编织的动态协作网络。当我们正视通信雪崩、引入异构计算、确立标准协议之后,Agent Swarm 必将褪去炒作的浮华,真正融入到工业级系统的每一行流转脉络之中。

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?

别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明:AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献32条内容

已为社区贡献32条内容

所有评论(0)