简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

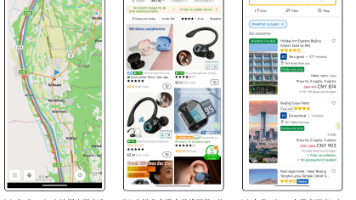

以上相关技术汇聚就是目前比较火的“GUI Agent”,顺藤摸瓜的翻到了一篇关于移动端GUI Agent训练框架-(也是用于Agent Auto GLM训练的框架)。下面来看看都解决了什么问题。视觉语言模型(VLM)(如 Qwen2.5-VL、GLM-4.1V)让 “零样本交互网页 / 移动界面” 的 GUI Agent成为研究热点。这类Agent可通过感知屏幕截图 + 解析 UI 结构,自主执行

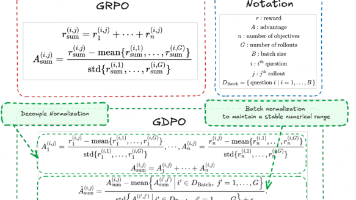

正如上期文章介绍的《》:GRPO的奖励信号坍缩(Reward Collapse)当GRPO应用于多奖励场景时,会导致:如下图左边例子,例如两个二元奖励(0/1)的场景中,GRPO会将(0,1)、(0,2)、(1,2)等不同奖励组合,统一映射为(-0.7071, 0.7071)的优势值,无法区分“满足1个奖励”和“满足2个奖励”的差异。:降低训练信号的分辨率,导致策略更新不准确、收敛次优,甚至早期训

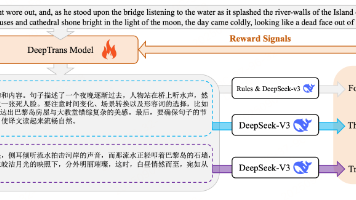

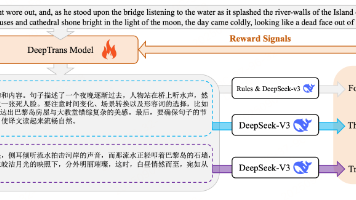

本文主要看一下翻译模型的GRPO奖励函数设计。

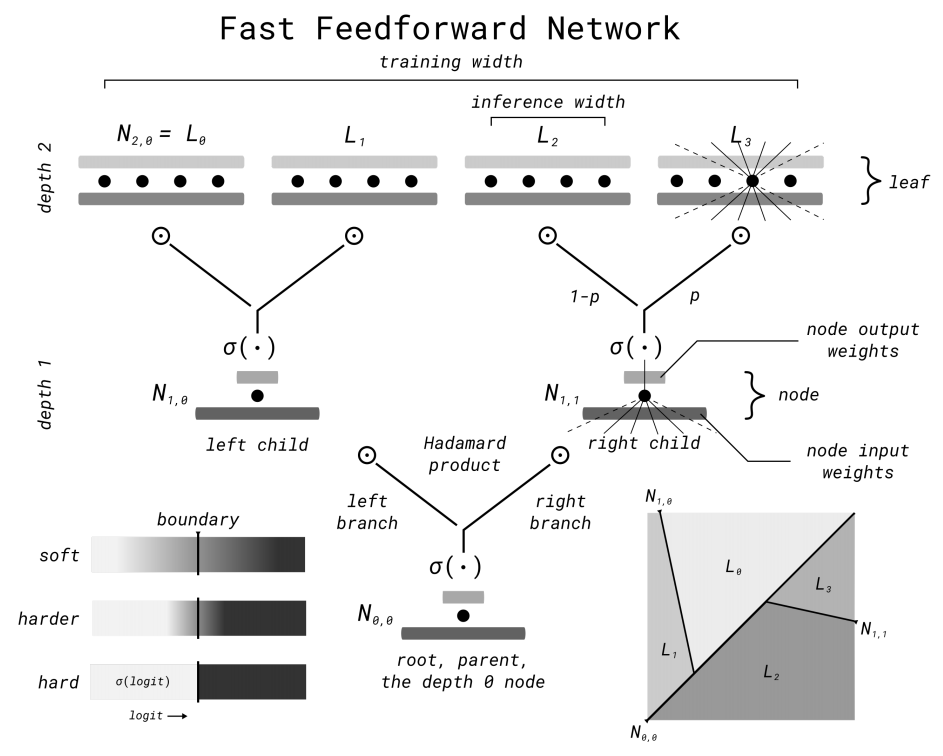

随着大模型的发展,模型参数量暴涨,以Transformer的为组成成分的隐藏神经元数量增长的越来越多。因此,降低前馈层的推理成本逐渐进入视野。前段时间看到本文介绍的相关工作还是MNIST数据集上的实验,现在这个工作推进到BERT上面来了,再次引起兴趣记录一下。该工作将前馈神经基于二叉树结构进行改装,加速前向传播的速度,称为:快速前馈网络(FFF),然后应用FFF,取代BERT中的前馈网络(FF),

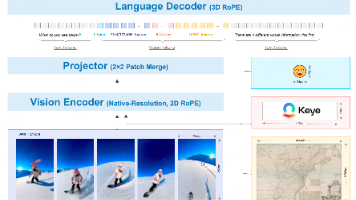

其更偏向于训练模型对于密集文本的感知能力。本文看一看英伟达出品的多模态大模型NVLM-1.0系列,虽然暂未开源,但该文章给出了NVLM的详细细节,值得一读。

前期《》专栏详细中介绍了文档智能解析详细pipline链路技术方案,如下图:现在来看一个新思路,指出pipline链路依赖大量标注数据、并且会出现错误传播问题,导致解析效果不佳,故提出一个基于布局强化学习(layoutRL)的多模态大模型的端到端的解析框架,通过强化学习(GRPO)的方式训练模型的布局感知能力。(ps:笔者看来,在通用场景下解析效果也能并不会有文中评价的那么好,但这个数据合成思路及

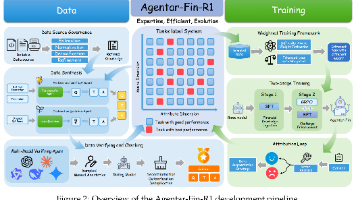

Agentar-Fin-R1 的开发pipline可概括为五个闭环阶段,每一阶段都有明确输入、处理逻辑和输出。

在大模型的生成过程中,部分原生的大语言模型未经过特殊的对齐训练,往往会“胡说八道”的生成一些敏感词语等用户不想生成的词语,最简单粗暴的方式就是在大模型生成的文本之后,添加敏感词库等规则手段进行敏感词过滤,但是在生成过程中,生成敏感词仍然耗费了时间和算力成本。本文以chatglm2-6B为例,通过自定义,实践大模型在生成过程中控制一些词语的生成。回到正题,如何自定义LogitsProcessor控制

本文主要看一下翻译模型的GRPO奖励函数设计。

快速看一下Kwai Keye-VL的技术报告,