简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

OpenCoWork是一款基于 Electron + .NET 10 AOT 打造的高性能 Agent 产品。在产品初期,我们参考了 Claude CoWork 的部分交互和功能设计,完成了第一版 UI 布局与核心流程;底层则采用自研 Agent Loop 实现,并没有依赖任何 Agent SDK。它到底能做什么?左边是我的项目列表。每个项目下可以包含多个会话,而每一个会话,本质上就是一个独立的

WebSocket 是传输协议,Responses events 是应用层协议。OpenAI Responses WebSocket 复用了现有 Responses 的事件模型,只是把请求/续跑方式改成了长连接事件流。它最大的价值不在于“流式文本更丝滑”,而在于Agent 多轮工具回路的 continuation 更轻、更快。20+ tool calls 的 rollout 最多约 40% 端到端

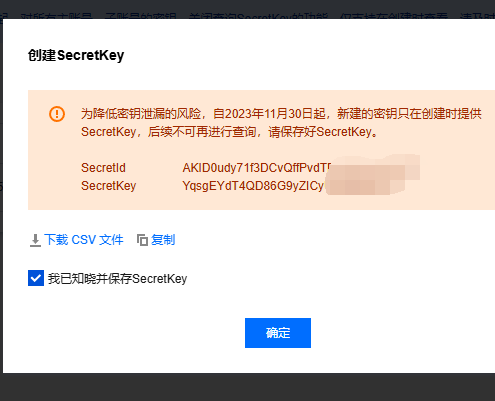

OpenDeepWiki 是一个允许用户部署私有知识库的工具,通过 MCP 实现内容检索和智能指引。用户可以通过注册企业账号并完成实名认证,获得 500 代金券。部署过程需要一台安装了 Docker 和 Docker-Compose 的服务器,以及 API Key。通过创建 docker-compose.yml 文件和配置 Nginx,用户可以启动 OpenDeepWiki 服务,并通过浏览器访问

所有工具最终都要通过注入到 AI Agent 里。支持三种后端:OpenAI Chat、OpenAI Responses、Anthropic。??// 先解析配置:合并传入参数、环境变量、默认值?// 注意:OpenAI 分支同样注入了自定义 HttpClient(用于日志拦截等)?// Responses 分支结构与 Chat 分支类似,但走 GetResponsesClient???会依次从传

如果你也想无成本、低门槛地体验OpenClaw,那么现在就是一个非常合适的时机。通过RoutinAI,你可以更轻松地完成部署,快速进入实际使用阶段,把更多时间放在体验与探索本身,而不是浪费在复杂的搭建过程中。无论你是想尝鲜体验、测试效果,还是想拥有一个属于自己的“小龙虾”入口,RoutinAI都能帮助你更高效地完成第一步。

作为一个开源爱好者,真的特别喜欢这种踏踏实实做工具的项目,没有花里胡哨的营销,没有套路满满的付费订阅,就是不断迭代功能,还照顾到各个平台的用户,太良心了。如果你也觉得这款工具好用,别忘了去GitHub给项目点个Star,也欢迎大家提交PR一起参与开发,让工具变得更好用~👉 项目仓库地址:https://github.com/AIDotNet/OpenCowork#开源 #AI工具 #Mac软件

OpenCowork是一个开源的桌面 AI Agent 工作站。桌面端对话入口Agent 循环与工具调用本地文件和命令行工作流定时任务消息平台插件Agent 团队协作MCP 扩展能力多模型统一接入而且它是完全开源的,采用Apache 2.0协议,当前版本已经到v0.4.1。说白了,OpenCowork想做的不是“另一个 AI 聊天窗口”,而是一个真正能干活的 AI 工作台。

下面我们讲解从0开始搭建我们的免费大模型管理平台,接入其他的免费大模型,然后加入到我们自己的平台当中,然后进行监控和管理。

FastWikiFastWiki是一个高性能、基于最新技术栈的知识库系统,旨在为大规模信息检索和智能搜索提供解决方案。它采用微软Semantic Kernel进行深度学习和自然语言处理,在后端使用,前端采用MasaBlazor框架,实现了一个高效、易用、可扩展的智能向量搜索平台。其目标是帮助用户快速准确地获取所需信息,具有智能搜索、高性能、现代化前端、强大的后端等特点。除此之外,FastWiki是

我们通过上面的代码实现了一个搜索引擎插件,这个插件可以根据用户提出的问题搜索相关信息,然后返回给用户。