简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

参考:https://llamafactory.readthedocs.io/zh-cn/latest/getting_started/data_preparation.html。

以上会议涵盖学术研究(如EI/Scopus收录会议)、产业应用(如深圳AGIC博览会)、区域合作(如东盟大会)及垂直领域(如教育、艺术)。• 亮点:全球规模最大的AI展会之一,覆盖具身智能、大模型、AI芯片等,设八大行业场景展区,华为、腾讯等巨头参展。• 亮点:聚焦中国与东盟AI合作,涵盖智能制造、跨境电商等六大主题,设政企闭门对接和低空经济分论坛。• 亮点:学术导向,EI和Scopus收录,聚焦

项目:https://github.com/timeseriesAI/tsai简介:用于处理时间序列的工具库,包含TCN、Rockert等众多时间序列处理算法。

1.创建新的conda环境,避免把原有的环境给搞坏。在CMD中执行,而不是在anaconda的命令行中执行:conda create -n 环境名 --offline python=3.82.在pycharm中配置conda环境:setting->Project Interpreter->齿轮->add->conda 环境->已存在的->新环境下的python.

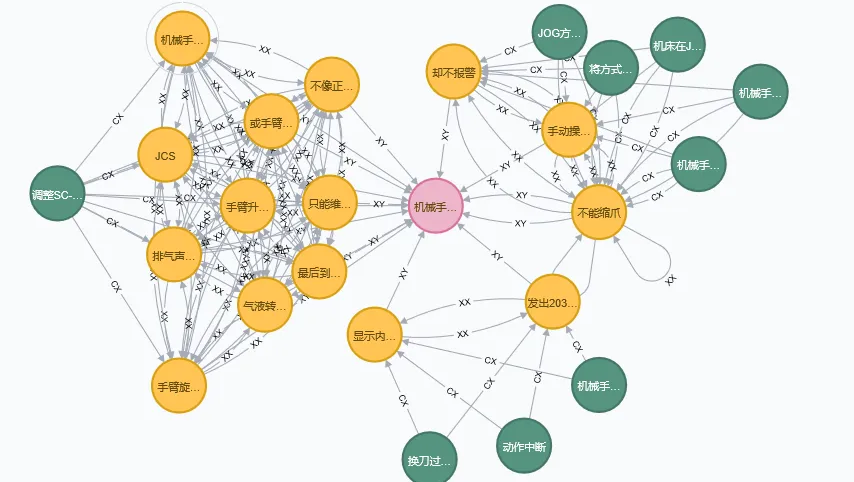

知识图谱是一种结构化的语义知识库,能够描述物理世界的实体、概念及其相互关系,本质是用于表示知识,给机器提供先验知识。换句话说,还有其它用于知识表示的方法,知识图谱只是其中的一种。知识是经过剪裁、塑造、解释、选择和转换了的信息如:“奥巴马是美国的前总统”,对机器而言就是一句话,不知道在讲什么;处理一下,如变成三元组:(美国,前总统,奥巴马),这就是一条知识了。这个转换的过程,就是知识表示将人类知识形

为什么CUDA装好了,Tensorflow-GPU不能用?当我们把CUDA、cudnn、tensorflow-GPU都装好,但在tensorflow GPU测试tf.test.is_gpu_avaiable()却始终返回false,怎么办?import tensorflow as tftf.test.is_gpu_available()FALSE可能的原因如下:——————————————————

以上会议涵盖学术研究(如EI/Scopus收录会议)、产业应用(如深圳AGIC博览会)、区域合作(如东盟大会)及垂直领域(如教育、艺术)。• 亮点:全球规模最大的AI展会之一,覆盖具身智能、大模型、AI芯片等,设八大行业场景展区,华为、腾讯等巨头参展。• 亮点:聚焦中国与东盟AI合作,涵盖智能制造、跨境电商等六大主题,设政企闭门对接和低空经济分论坛。• 亮点:学术导向,EI和Scopus收录,聚焦

教程基于《无人驾驶原理与实践》2.6.4,先指出书中有3点错误:1.创建的包名为husky_highlevel_controller,但后文和程序中中多次变成husky_high_level_controller,统一用一个名称即可,本文用的husky_highlevel_controller,涉及修改的地方有include/husky_high_level_controller目录,CmakeL

2024.11.13阶段性总结方案挑选从简单到复杂,简单方案有简单方案的优点,有时候杀鸡不需要牛刀。面对一个场景,不知道怎么选方案或模型时,可以优先用Glove或者Fasttext完成词向量训练,使用词向量平均的方式来获得句向量,成本非常低,快速在应用中构建出一个基准模型,后期若发现应用中存在着多义词、或者或句子中词的顺序敏感的场景,则可以考虑换用bert类的方法进行微调或者直接使用专门的嵌入模型

1.英文通常以单词为单位,中文以字为单位;2.目前SOTA级别的模型:BERT+CRF3.基于实体词典和深度学习方法的区别?实体词典很好用,每在词典中增加一个词条都能立竿见影的增加可以识别的实体。但此方法最大的问题在于:一,词典的扩充是一个比较费时费力的事情;二,未登录词OOV无法识别;三,无法识别多义词,如苹果。深度学习方法,如BERT+CRF能处理多义词的问题,通过一个词的上下文来确定其语义。