简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

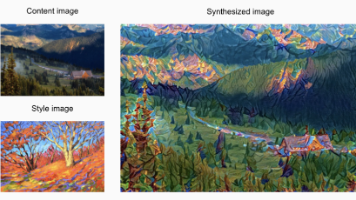

本文介绍基于卷积神经网络的图像风格迁移方法。该方法通过预训练的VGG-19网络提取内容图像和风格图像的特征,使用内容损失、风格损失和全变分损失定义优化目标,通过迭代更新合成图像。具体实现包括:预处理图像、定义特征提取网络、计算Gram矩阵表达风格特征,以及训练过程中优化损失函数。实验结果表明,该方法能有效保留内容图像的主体结构,同时迁移风格图像的艺术风格特征(如色彩分布和笔触纹理),最终生成具有艺

目标检测算法主要分为两类:两阶段(Two-Stage)和单阶段(One-Stage)。两阶段算法如R-CNN系列,先提取候选区域再进行分类和回归,精度高但速度慢。R-CNN对每个候选区域单独处理;Fast R-CNN通过共享特征图提高效率;Faster R-CNN引入RPN实现端到端训练。单阶段算法如SSD和YOLO,直接在网络中预测目标的类别和位置,速度快但精度略低。SSD利用多尺度特征图检测不

在深度学习的发展历程中,卷积神经网络(CNN)不断推陈出新,ResNet(Residual Network)作为其中的杰出代表,以其独特的残差学习机制在图像识别领域取得了显著的成果,并推动了 CNN 的进一步发展。

网络结构是卷积神经网络(CNN)发展的关键。其中,网络结构的改进至关重要。本文将介绍一种具有创新意义的卷积神经网络——NIN(Network in Network)。AlexNet和VGG对LeNet的改进主要在于如何扩大和加深这两个模块。或者,可以想象在这个过程的早期使用全连接层。然而,在每个NIN的核心创新在于引入了“微网络”(Network in Network)的概念。具体来说,每个卷积层

在深度学习的发展历程中,卷积神经网络(CNN)扮演着举足轻重的角色,而 AlexNet 作为 CNN 发展史上的一个里程碑式模型,具有重大的意义和影响力。2012年,AlexNet横空出世。它首次证明了。AlexNet 由 Alex Krizhevsky、Ilya Sutskever 和 Geoffrey Hinton 提出,并在当年的 ImageNet 大规模视觉识别挑战赛(ILSVRC)中以显

计算机视觉的神经网络架构:平移不变性(translation invariance):不管检测对象出现在图像中的哪个位置,神经网络的前面几层应该对相同的图像区域具有相似的反应,即为“平移不变性”。局部性(locality):神经网络的前面几层应该只探索输入图像中的局部区域,而不过度在意图像中相隔较远区域的关系,这就是“局部性”原则。最终,可以聚合这些局部特征,以在整个图像级别进行预测。图像的平移不

基于李沐课程、吴恩达课程和我自己的学习经验整理而成的笔记。

以 batch-0 为例: 把 3×2×2 = 12 个数拉成一条向量: {1, 3, 5, 7, 2, 4, 6, 8, 0, 2, 4, 6}以 R 通道为例: 共有 2×2×2 = 8 个像素值:{1, 3, 5, 7, 2, 4, 6, 8}输入:手写数字灰度图,只保留 2 个像素 → 输入 x 形状 (batch, 2)。归一化维度:在 (B, H, W) 三个维度上求均值/方差,每个通

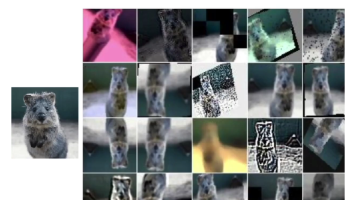

摘要:数据增广是提升深度学习模型泛化能力的关键技术,通过多种图像变换方法增加训练数据多样性。常用方法包括几何变换(翻转、裁剪)、色彩调整(亮度、色调)等,需根据任务特点选择合适策略。代码示例展示了使用PyTorch实现随机翻转、裁剪和颜色变换的方法,以及如何组合多种增广方式。数据增广可有效解决数据稀缺问题,但需注意避免过度增广导致数据失真。该技术在AlexNet等模型成功中发挥了重要作用。

每个图像有多个通道和多层卷积层。例如彩色图像具有标准的RGB通道来代表红、绿和蓝。但是到目前为止(详细见前面几章知识点),我们仅展示了单个输入和单个输出通道的简化例子。这使得我们可以将输入、卷积核和输出看作二维张量。当我们添加通道时,我们的输入和隐藏的表示都变成了三维张量。例如,每个RGB输入图像具有 3*h*w 的形状。我们将这个大小为的轴称为。本节将更深入地研究具有多输入和多输出通道的卷积核。