简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

需要具备产品设计和开发的经验,能够理解用户需求和体验设计原则,第一点是未来必定是 AI 的时代,ChatGPT 开启了 AI 时代纪元,最近二三个。业余的怎么比得过专业的,而且专业的也不一定能挣到钱。现,AI 产品经理岗位一定会迎来爆发性的需求,而且现在从事 AI 产品经理的人。结合这三点考虑,我决定转行 AI 产品经理,随着未来 AI 场景需求大量的涌。第二点,长期主义的考虑,当下很多人都在讨论

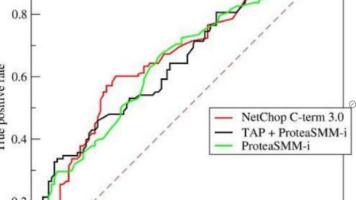

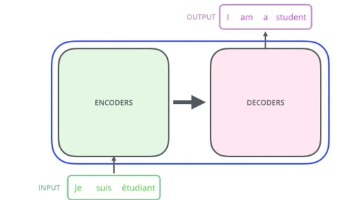

摘要:本文介绍了六种重要的AI模型与技术:1)大模型(LLM)是基于深度学习的自然语言处理模型;2)ROC曲线是评估二分类模型性能的工具;3)AUC是ROC曲线下面积,用于量化模型性能;4)Transformer是基于自注意力机制的序列处理模型;5)ChatGPT是OpenAI开发的生成式预训练Transformer模型;6)Diffusion模型是通过噪声添加和去除实现图像生成的深度生成模型。这

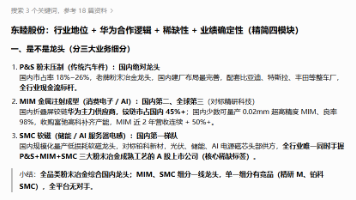

【摘要】东睦股份(600114)凭借三大粉末冶金技术平台(P&S、MIM、SMC)构建核心壁垒,形成"传统业务稳现金流+新赛道高增长"的梯次发展模式。短期(1-2年)受益华为折叠屏铰链放量(MIM业务占比近50%),中期(2-3年)依托SMC软磁材料抢占光储/AI服务器赛道,长期(3年+)布局人形机器人精密件。公司通过哈勃投资与华为深度绑定,成为其终端、汽车、储能全产业

【摘要】东睦股份(600114)凭借三大粉末冶金技术平台(P&S、MIM、SMC)构建核心壁垒,形成"传统业务稳现金流+新赛道高增长"的梯次发展模式。短期(1-2年)受益华为折叠屏铰链放量(MIM业务占比近50%),中期(2-3年)依托SMC软磁材料抢占光储/AI服务器赛道,长期(3年+)布局人形机器人精密件。公司通过哈勃投资与华为深度绑定,成为其终端、汽车、储能全产业

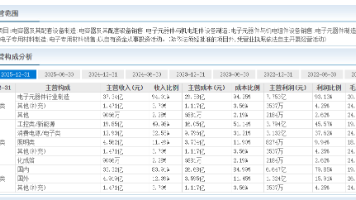

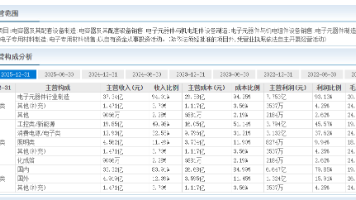

艾华集团2025年实现营收39.72亿元(+1.26%),归母净利润2.65亿元(+36.92%),毛利率提升1.84个百分点至20.96%,工控/新能源业务占比首超50%成为主要增长点。2026年Q1受原材料涨价和研发投入增加影响,扣非净利润下滑13.88%。公司积极布局AI服务器电容、MLPC和薄膜电容器等新业务,但当前占比仍小。作为国内铝电解电容龙头,公司正从传统照明/消费电子向工控/新能源

艾华集团2025年实现营收39.72亿元(+1.26%),归母净利润2.65亿元(+36.92%),毛利率提升1.84个百分点至20.96%,工控/新能源业务占比首超50%成为主要增长点。2026年Q1受原材料涨价和研发投入增加影响,扣非净利润下滑13.88%。公司积极布局AI服务器电容、MLPC和薄膜电容器等新业务,但当前占比仍小。作为国内铝电解电容龙头,公司正从传统照明/消费电子向工控/新能源

截至2026年5月1日,国家电网《2026年具身智能发展规划》(网传68亿具身机器人规划)尚未公开发布全文,仅为内部印发文件,核心内容由界面新闻等媒体独家披露。2. 2027年:智能体普及率超80%,覆盖80%以上高危场景。- 单设备年省人工:50–80万元,投资回收期2–3年。- 核心场景:电力巡检、带电作业、应急救援、仓储物流。- 印发时间:2026年4月22日(内部印发)- 年度总投资:68

Transformer是一种基于自注意力机制的神经网络架构,彻底改变了深度学习领域。它通过并行处理整个序列并捕获长距离依赖关系,取代了传统的RNN和CNN结构。核心组件包括编码器-解码器结构、多头注意力和位置编码等,使其能广泛应用于NLP、CV和多模态任务。Transformer的高效并行处理、强大的长距离建模能力和通用性,使其成为GPT、BERT等大模型的基础。其创新性的自注意力机制通过计算查询

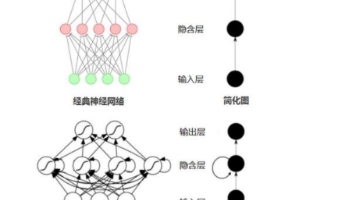

本文系统介绍了三种主流神经网络模型:1. 传统神经网络(NN):通过模拟神经元连接实现信息处理,具有自适应性和并行处理能力,广泛应用于机器学习和模式识别。2. 卷积神经网络(CNN):专为图像处理设计,通过权值共享和池化操作提高效率,在图像识别、语音识别等领域表现突出。3. 循环神经网络(RNN):擅长处理序列数据,在自然语言处理、语音识别和时间序列预测中具有独特优势。文章还详细阐述了生成对抗网络

中国健康与养老追踪调查数据库(CHARLS)是由北京大学国家发展研究院主持、北京大学中国社会科学调查中心与北京大学团委共同执行的一项大型跨学科调查项目。该项目旨在收集一套代表中国45岁及以上中老年人家庭和个人的高质量微观数据,用以分析我国人口老龄化问题,推动老龄化问题的跨学科研究,并为制定和完善相关政策提供科学基础。以下是对CHARLS数据库的详细介绍: