简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

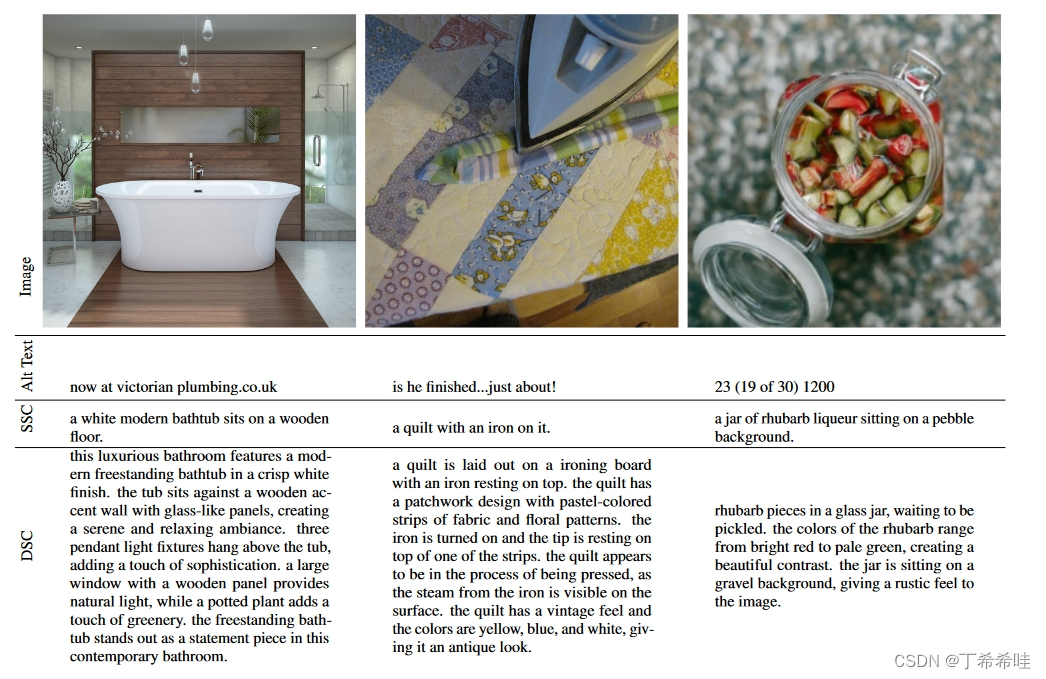

由于用户在实际应用过程中,可能不会发出长的、高度描述性的标注的分布,因此可以借助大型语言模型帮助用户直接扩写,具体来说,可以使用 LLM进行“上采样”,将短的prompt转换成长的prompt,这样不仅可以添加缺失的细节,还可以消除复杂关系的歧义。实验进行到一半时,评估显示 65% 的混合物在所有评估中都远远落后于其他混合物,因此作者放弃了它。作者使用95%的合成标注和5%的真实标注对DALLE3

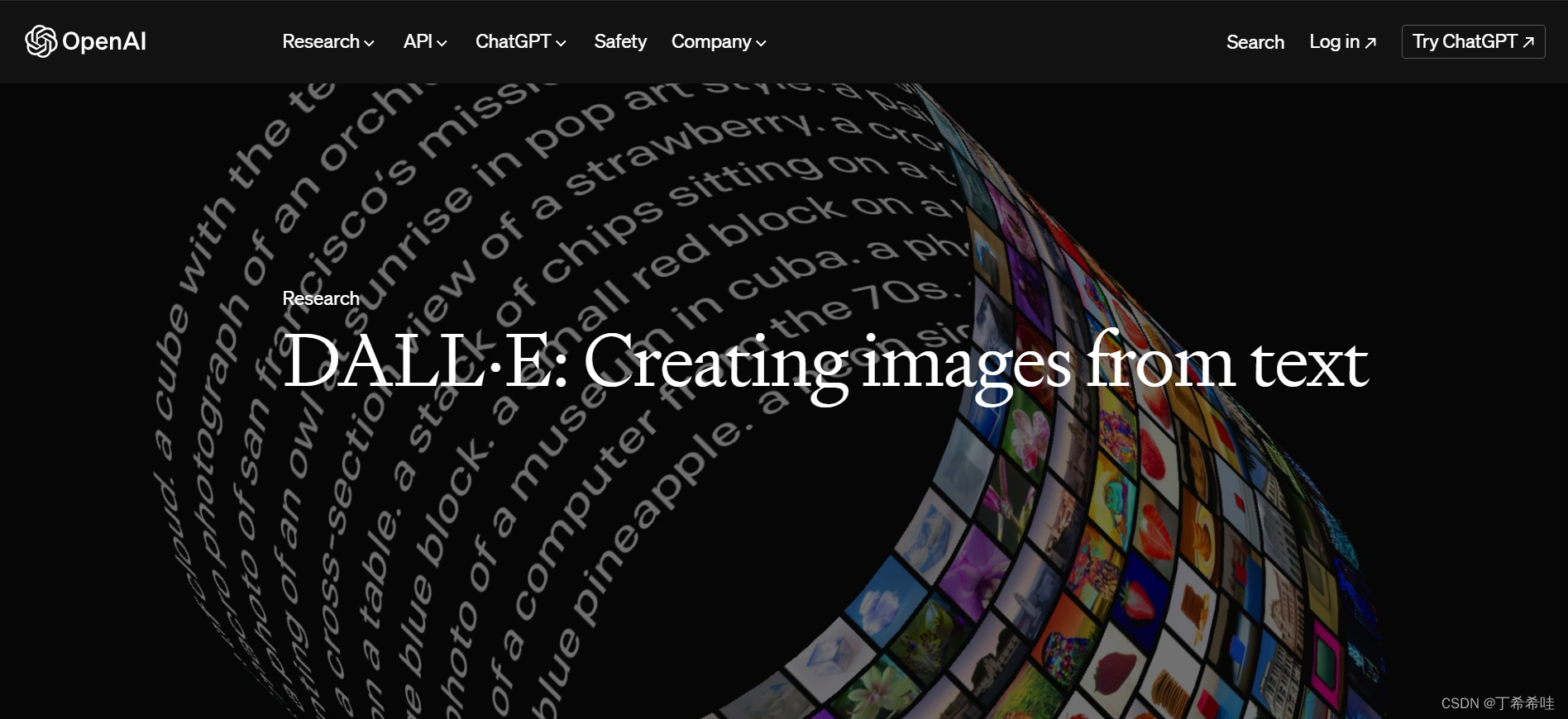

DALL·E 是GPT-3的 120 亿参数版本,经过训练,可以使用文本-图像对的数据集从文本描述生成图像。我们发现它具有多种功能,包括创建动物和物体的拟人化版本、以合理的方式组合不相关的概念、渲染文本以及对现有图像应用转换。DALL·E 2可以生成更逼真、更准确的图像,分辨率提高 4 倍。文本到图像生成传统上专注于寻找更好的建模假设以在固定数据集上进行训练,而这些假设会涉及到复杂的架构、辅助

ImageNet数据集可以直接从ImageNet官方网站获取数据,但通常需要注册并遵守使用协议。另外,由于数据集较大,往往下载需要花费大量的时间空间,而通过huggingface下载数据集的方法不仅速度相对较快,而且能够直接从服务器远程进行下载。。

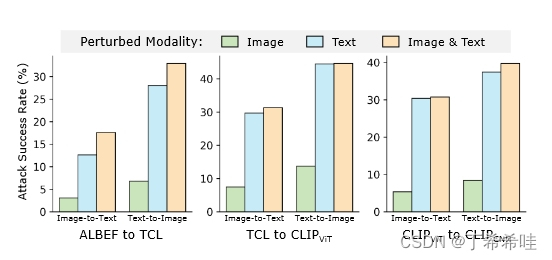

标题:集合级指导攻击:提高视觉语言预训练模型的对抗性可迁移性。

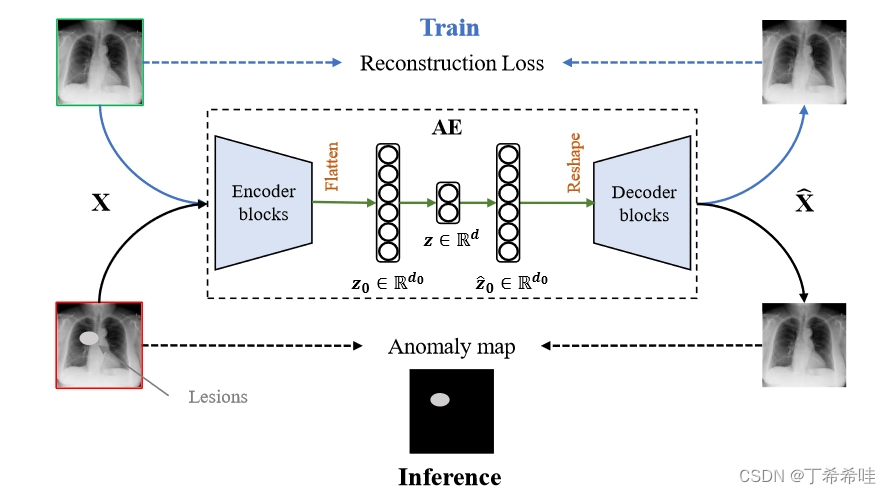

检测出偏离了预期正常模式的异常样本。假设大量具有相似模式的正常样本是容易获得的,而具有多样化和位置模式的异常样本很难全面收集。因此AD方法一般只需要正常数据即可进行训练,不需要异常样本,因此在医学领域的罕见病识别和健康筛查中发挥着重要作用。相关研究众多,但是缺乏公正、全面的评价,导致一些结论模糊不清,阻碍了该领域的发展:现有工作中使用不同的数据集或分区会妨碍再现性和可比性,从而破坏研究结果的可靠性

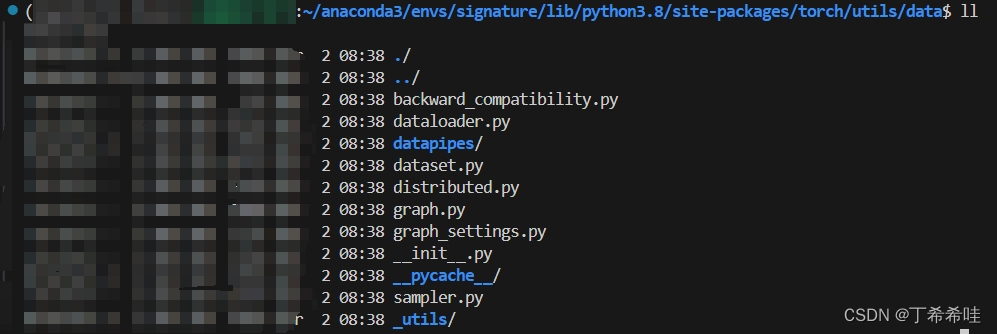

构建自定义的Dataset类,需要继承TensorFlow的官方dataset类自定义Dataset类必须实现三个函数:__init__,__len__和__getitem__pytorch中的dataset类是在pytorch的torch下的utils之下的data文件夹里有一个dataset.py。

可以先根据错误提示找到diffusers库包中attention_processor.py所在的位置,然后用assets文件夹下attention_processor.py进行替换即可解决问题。这个错误是因为安装的diffusers包里有个文件需要用官网提供的新文件进行替换。先将flash-attention模型仓库克隆下来。然后安装对应的软件包。

定义多头自注意力机制中的线性变换操作(在自注意力机制中,需要将输入的特征向量通过线性变换映射到不同的空间中,以便进行多头注意力的计算。将向量拆分为给定数量的头部,以获得多头注意。'''d_model:模型输入的特征维度;heads:注意力机制中的头数;d_k:每个头部中以向量表示的维度数;bias:是否使用偏置项'''#线性变换的线性层,输入为d_model,输出为heads*d_k'''

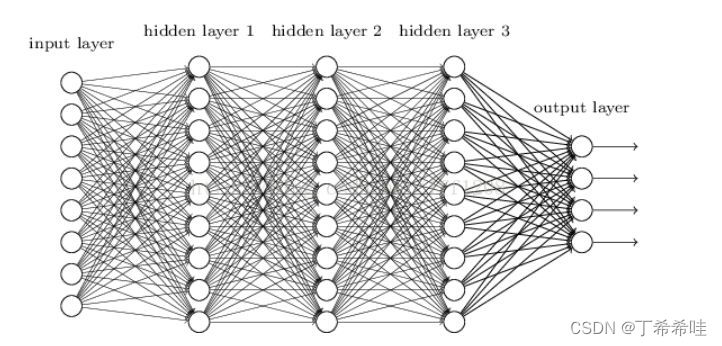

具体做法是,在局部连接中隐藏层的每一个神经元连接的是一个10 × 10的局部图像,因此有10 × 10个权值参数,将这10 × 10个权值参数共享给剩下的神经元,也就是说隐藏层中10^6个神经元的权值参数相同,那么此时不管隐藏层神经元的数目是多少,需要训练的参数就是这 10 × 10个权值参数(也就是卷积核(也称滤波器)的大小),如下图。而在RNN中,神经元的输出可以在下一个时间段直接作用到自身,

梯度消失是指在深度学习训练的过程中,梯度随着 BP 算法中的链式求导逐层传递逐层减小,最后趋近于0,导致对某些层的训练失效;梯度爆炸与梯度消失相反,梯度随着 BP 算法中的链式求导逐层传递逐层增大,最后趋于无穷,导致某些层无法收敛;