简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

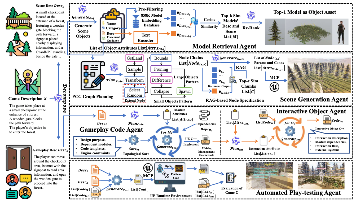

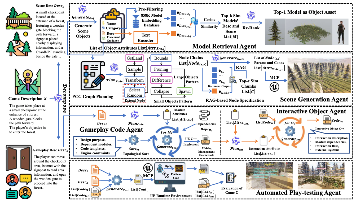

本文提出AutoUE,一种基于多智能体的系统,用于在虚幻引擎中自动化生成3D游戏。该系统通过协同模型检索、场景生成、游戏玩法代码、交互对象和自动化试玩五大智能体,实现端到端游戏生成。创新性地引入检索增强生成机制缓解大语言模型的工具使用幻觉问题,并融入游戏设计模式确保代码质量。实验表明,AutoUE能有效生成连贯3D场景和可执行游戏玩法代码,并通过自动化测试评估动态行为。该研究为3D游戏自动化生成提

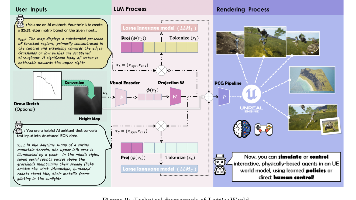

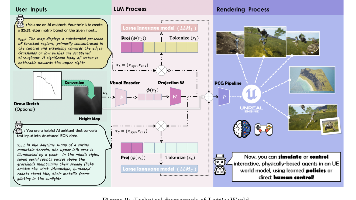

本文提出LatticeWorld框架,一种基于多模态大语言模型(LLM)的交互式三维世界生成方法。该框架将轻量级LLaMA-2-7B模型与虚幻引擎5结合,支持文本和视觉指令输入,自动生成包含动态智能体的高保真虚拟环境。相比传统手动建模,LatticeWorld提升生产效率90倍以上,同时保持高质量物理仿真和实时渲染能力。实验表明,该方法在场景布局精度和视觉保真度上均优于现有技术,为AI训练和内容创

本文提出LatticeWorld框架,一种基于多模态大语言模型(LLM)的交互式三维世界生成方法。该框架将轻量级LLaMA-2-7B模型与虚幻引擎5结合,支持文本和视觉指令输入,自动生成包含动态智能体的高保真虚拟环境。相比传统手动建模,LatticeWorld提升生产效率90倍以上,同时保持高质量物理仿真和实时渲染能力。实验表明,该方法在场景布局精度和视觉保真度上均优于现有技术,为AI训练和内容创

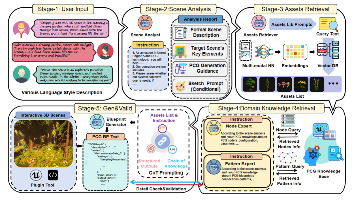

本文提出UnrealLLM框架,通过大语言模型驱动程序化内容生成实现高可控、可交互的3D场景自动创建。该框架构建了多智能体系统,将自然语言描述转换为虚幻引擎5可执行的程序化生成蓝图,包含场景分析、资源检索、节点配置等模块。创新性地提出基于文本的蓝图表示方法,并建立多模态资源库支持上下文感知检索。实验表明,UnrealLLM在生成质量、规模控制和交互性方面具有优势,为自动化3D内容创作提供了新思路。

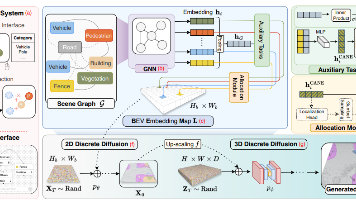

本文提出了一种基于场景图的可控三维室外场景生成方法,通过结构化场景图作为用户友好的控制载体,实现了高质量城市场景的生成。该方法采用图神经网络将稀疏场景图转换为稠密鸟瞰图嵌入特征,并作为条件输入三维扩散模型生成场景。研究构建了包含场景图与三维场景配对的大规模数据集,并开发了交互式系统支持用户便捷编辑场景图。实验表明,该方法能稳定生成与输入场景图高度匹配的三维场景,是首个实现基于场景图的大规模室外场景

本文提出AutoUE,一种基于多智能体的系统,用于在虚幻引擎中自动化生成3D游戏。该系统通过协同模型检索、场景生成、游戏玩法代码、交互对象和自动化试玩五大智能体,实现端到端游戏生成。创新性地引入检索增强生成机制缓解大语言模型的工具使用幻觉问题,并融入游戏设计模式确保代码质量。实验表明,AutoUE能有效生成连贯3D场景和可执行游戏玩法代码,并通过自动化测试评估动态行为。该研究为3D游戏自动化生成提

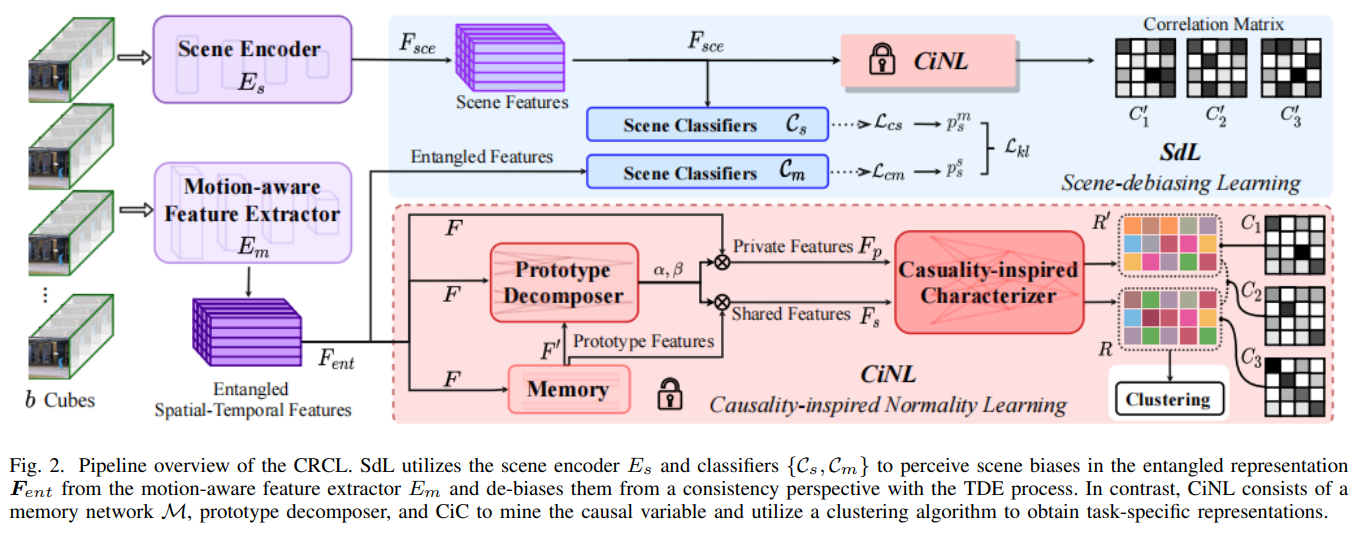

视频异常检测(VAD)在视频理解领域仍然是一项基础且具有挑战性的任务,在信息取证和公共安全保护等领域有着广阔的应用前景。由于异常情况的罕见性和多样性,现有方法仅利用容易收集的正常事件,以无监督的方式对正常时空模式的内在常态进行建模。尽管这些方法受益于深度学习的发展取得了显著进展,但它们试图对可观测视频和语义标签之间的统计依赖关系进行建模,这是对常态的粗略描述,缺乏对其潜在因果关系的系统探索。

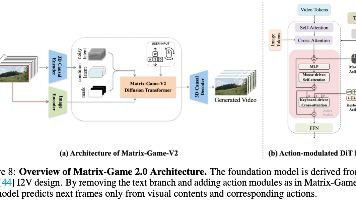

Matrix-Game 2.0是一个开源的实时流式交互世界模型,通过少步自回归扩散实现分钟级高质量视频生成。针对现有交互世界模型实时性差的问题,该框架提出三大创新:(1)基于虚幻引擎和GTA5的可扩展数据生成管道,支持1200小时带精确交互标注的视频采集;(2)动作注入模块,将键盘鼠标输入作为帧级条件;(3)基于因果架构的少步蒸馏方法,实现25FPS的实时生成。实验表明,该系统能在多种场景下保持长

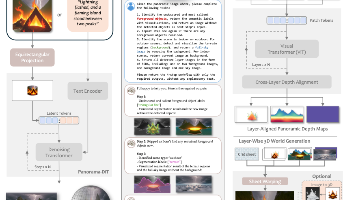

HunyuanWorld 1.0提出了一种融合2D与3D生成优势的创新框架,能够从文本或图像输入创建沉浸式、可交互的3D世界。该方法通过全景图作为世界代理实现360°场景覆盖,采用语义分层网格表示支持高效渲染与对象级交互,并兼容现有图形学流水线。实验表明,该方法在生成质量、3D一致性和交互性方面达到SOTA水平,适用于VR、游戏开发等应用场景。项目代码和演示已开源。

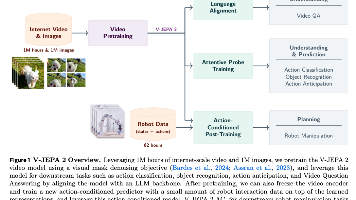

Meta提出V-JEPA 2自监督视频模型,通过100万小时互联网视频预训练实现世界理解与预测。该模型在动作分类(Something-Something v2达77.3%准确率)和动作预测(Epic-Kitchens-100召回率@5达39.7%)任务中表现优异。结合语言模型后,在视频问答任务中达到SOTA(如PerceptionTest 84.0分)。更重要的是,仅用62小时机器人数据微调后,V