简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

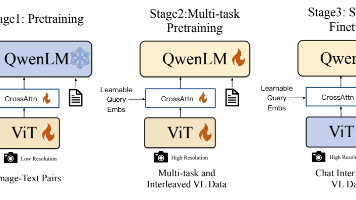

它用简洁的架构、精心设计的训练流程和高质量的数据集,在同规模模型中取得了最好的性能,同时具备了多语言支持、多图输入、精准物体定位和超强文字识别等多种能力。Qwen-VL-Chat:图中的人物是比尔·盖茨,他穿着一件深色的西装外套,里面搭配了一件白色的衬衫,打着一条深色的领带。:这就像给模型装了一个"激光笔",你可以用文字描述让它指出图片里的某个物体,它也可以用坐标告诉你它看到的东西在哪里。:这就像

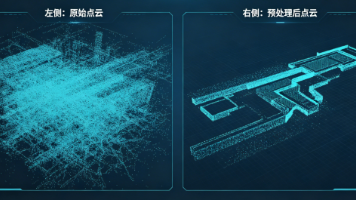

三维重建核心:从视差图生成三维点云,再通过配准和表面重建得到完整的三维模型视差转点云公式XYZWTQuvd1TXYZWTQuvd1T,Q是重投影矩阵点云预处理:无效点去除、离群点去除(统计滤波、半径滤波)、下采样(体素滤波)点云配准:ICP算法是经典,NDT+ICP是工业界标准流程(粗配准+精配准)表面重建:泊松重建效果最好,适合大多数场景工业级标准流程:视差生成 → 点云转换 → 预处理 → 配

Gemini代表了多模态AI发展的一个重要里程碑。多模态原生架构:从一开始就联合训练文本、图像、音频和视频,实现了真正的跨模态推理超越人类专家的性能:在MMLU基准上首次超越人类专家,在大多数其他基准上也取得了最先进的结果高效的训练基础设施:使用TPU和Pathways框架,解决了大规模训练的可靠性问题负责任的部署:进行了全面的安全评估,确保模型的安全性和可靠性未来,Gemini将继续提升性能,扩

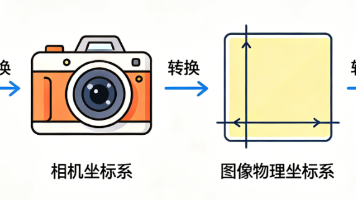

四大坐标系:世界→相机→图像物理→像素针孔模型:内参K × 外参[R|T]畸变5参数三大算法DLT:快但糙Tsai:高精度工业张氏:最实用、最通用预标定+光心优化:精度提升关键合格标准:重投影误差 < 0.5 像素,工业 < 0.2 像素掌握这一章,你就掌握了双目视觉精度的根。

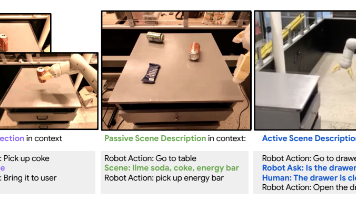

Inner Monologue是机器人领域的一个重要突破。它证明了用自然语言作为机器人的“内心独白”,可以让大语言模型成为一个强大的闭环规划器。通过引入简单的自然语言反馈,Inner Monologue解决了之前开环规划方法的鲁棒性问题,让机器人能够在复杂动态的真实环境中灵活应对各种情况。更重要的是,它不需要任何额外的训练,只需要用少量的提示词就能让LLM具备这种能力。这篇论文向我们展示了通用基础

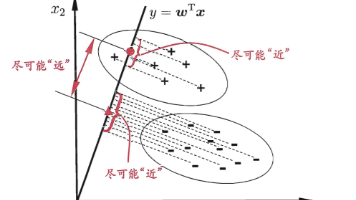

可解释性强:每个特征的权重直接反映了它对结果的影响程度,这在医疗、金融等需要解释性的领域至关重要计算效率高:训练和预测都非常快,适合处理大规模数据扩展性好:很多复杂模型都是线性模型的扩展,比如神经网络的每一层都是线性变换加激活函数,支持向量机是线性模型在核空间的扩展当然,线性模型也有局限性:它只能处理线性关系,对于非线性数据效果不好。但这并不影响它的地位——就像数学中的加减乘除,虽然简单,但却是所

前三篇我们分别学习了如何管理自己的注意力、调节自己的情绪、与他人高效协作。当你的地位受到挑战时,如何保持冷静并化危机为转机当别人陷入困境时,如何真正帮助他而不是让他产生抵触当团队需要改变时,如何推动大家一起前进而不是遭到反对这一篇将揭晓全书的终极框架——SCARF模型,它能解释99%的职场冲突和协作问题。同时,我们还会学习推动个人和组织改变的神经科学方法,这是从"优秀的执行者"成长为"卓越的领导者

这本书最独特的地方在于:它没有讲任何"成功学鸡汤",而是用**“戏剧+科学”**的双轨叙事,把抽象的大脑运作机制变成了能直接用的工作指南。真实职场场景:一个你每天都会遇到的困境脑科学解密:用fMRI实验数据告诉你"为什么会这样"重演时刻:用科学方法重新解决同一个问题,对比效果差异第一幕"问题与决策"是全书的基础,它用一个核心隐喻——“大脑舞台”,解释了90%脑力工作者效率低下的根源。前额叶皮层能量

第一幕我们了解了"大脑舞台"模型,知道了如何管理注意力和工作记忆。老板突然在会议上批评你的方案,你瞬间大脑空白,一句话都说不出来项目突然延期,一堆不确定的事情涌来,你感到焦虑不安,无法专注你对一个项目期待很高,结果却不尽如人意,你感到非常沮丧这些都是边缘系统在作祟。边缘系统是大脑的"情绪中枢",它比前额叶皮层进化得更早,反应速度也快得多。当它被激活时,会瞬间"劫持"你的大脑,让你失去理性思考的能力

在上一篇文章中,我们跟随李飞飞的脚步,走过了她从移民少女到找到人生"北极星"的前半段旅程。如果我们给计算机提供足够多、足够丰富的数据,它就能像人类一样学会"看见"世界。今天,我们将继续解读这本书的后6章,看看李飞飞是如何用ImageNet验证这个假设,如何引爆了席卷全球的深度学习革命,以及她在功成名就之后,如何面对科技与伦理的冲突,最终找到自己的"下一颗北极星"的。这6章不仅是一部技术发展史,更是