简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

2024 年,一部 90 分钟的 4K 动画电影平均需要 50~80 万核时渲染,按主流云算力 0.3 元/核时计算,仅渲染费就高达 15~24 万元。• 抢占式调度:GPU 节点支持 Checkpoint / Resume,Redshift 渲染 95% 进度被高优任务抢占,可在 15 秒内恢复。• 数据分层:只上传加密后的 .ifd / .ass 场景文件,回传 EXR 序列,节省 90% 公

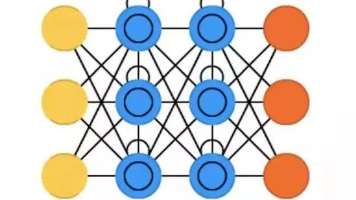

深度学习训练流程的核心在于 "工程化 + 算法优化" 的结合。随着大模型时代的到来,训练效率、资源利用率和部署轻量化将成为新的技术焦点。自动混合精度训练的进阶应用分布式训练的梯度压缩技术模型量化与剪枝的工程实现欢迎在评论区分享你的训练经验,或提出技术疑问,共同探讨 AI 工程化实践。

在当今数字化时代,AI 计算正以前所未有的速度改变着我们的生活和工作方式。从智能语音助手到自动驾驶汽车,从医疗诊断到金融风险预测,AI 技术的应用无处不在。而支撑这些 AI 应用的核心要素 —— 算力,其分布模式也在不断演进。2025 年,我们正见证着 AI 计算从传统的集中式云端向更为分布式的 “云端 + 边缘” 模式转变,这种转变不仅重塑着计算架构,还将开启新的应用场景和商业机会。

Stable Diffusion 与 Midjourney 分别代表了 AIGC 领域的 “开源极客” 与 “商业服务” 两种范式。前者适合追求极致控制、数据安全和长期成本优化的企业,后者则是快速验证创意、降低技术门槛的首选。随着技术迭代,两者在算力需求和应用场景上的界限正逐渐模糊,企业需结合自身业务特点,动态调整工具组合策略,方能在 AIGC 浪潮中抢占先机。

在当今 AI 驱动的时代,模型训练已成为众多领域创新的核心动力。然而,随着模型规模的不断扩大和训练复杂度的提升,算力成本也随之水涨船高,成为了许多企业和开发者面临的一大挑战。如何在保证训练效果的前提下,有效降低 AI 训练费用,实现降本增效,已成为亟待解决的关键问题。本文将为您详细介绍 10 个实用技巧,助您在 AI 训练的征程中优化算力成本。

GPU 虚拟化通过资源池化、灵活分配和智能调度,将算力利用率从传统模式的 30%-40% 提升至 80% 以上,同时降低了硬件采购和运维成本。未来,随着 AI 算力需求的爆发,GPU 虚拟化将向更细粒度的资源划分(如按核分配)、异构计算融合(GPU 与 FPGA、ASIC 协同虚拟化)和云边端一体化调度方向演进,成为算力基础设施的核心技术支撑。

深度学习训练流程的核心在于 "工程化 + 算法优化" 的结合。随着大模型时代的到来,训练效率、资源利用率和部署轻量化将成为新的技术焦点。自动混合精度训练的进阶应用分布式训练的梯度压缩技术模型量化与剪枝的工程实现欢迎在评论区分享你的训练经验,或提出技术疑问,共同探讨 AI 工程化实践。

在当今 AI 驱动的时代,模型训练已成为众多领域创新的核心动力。然而,随着模型规模的不断扩大和训练复杂度的提升,算力成本也随之水涨船高,成为了许多企业和开发者面临的一大挑战。如何在保证训练效果的前提下,有效降低 AI 训练费用,实现降本增效,已成为亟待解决的关键问题。本文将为您详细介绍 10 个实用技巧,助您在 AI 训练的征程中优化算力成本。

GPU 虚拟化通过资源池化、灵活分配和智能调度,将算力利用率从传统模式的 30%-40% 提升至 80% 以上,同时降低了硬件采购和运维成本。未来,随着 AI 算力需求的爆发,GPU 虚拟化将向更细粒度的资源划分(如按核分配)、异构计算融合(GPU 与 FPGA、ASIC 协同虚拟化)和云边端一体化调度方向演进,成为算力基础设施的核心技术支撑。