简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

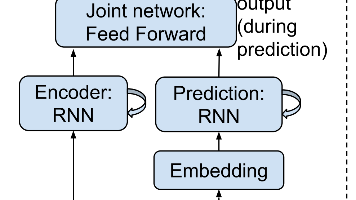

Sequence Transduction with Recurrent Neural Networks(RNN-T) 论文笔记

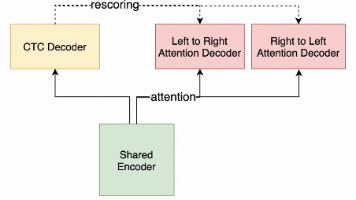

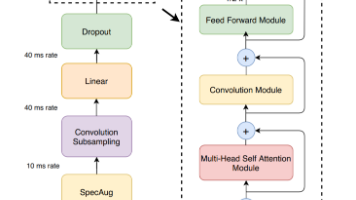

WeNet工具包采用U2++架构统一流式与非流式语音识别,通过同一模型参数支持实时低延迟和高精度两种场景。其处理流程包括:数据下载与准备、特征计算与BPE分词、词表构建、数据格式转换及模型训练。关键点包括:使用LibriSpeech数据集,计算全局CMVN统计量,训练5000个subword的BPE模型,构建包含特殊符号的字典,生成JSON格式的训练数据列表,并支持多GPU分布式训练。该方案显著降

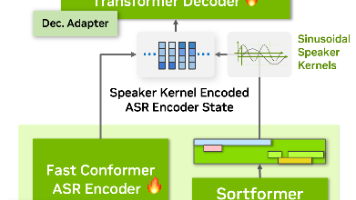

英伟达团队在ICML 2025提出Sortformer模型,创新性地将说话人日志(SD)任务融入多说话人语音识别(ASR)系统。该方法通过引入基于首次说话时间的Sort Loss,结合传统的排列不变损失(PIL),实现了说话人顺序的稳定监督。模型采用正弦说话人核将说话人信息注入ASR编码器表示,使ASR解码器无需额外排列匹配即可生成有序文本。实验使用7180小时混合真实与模拟数据,验证了该框架在联

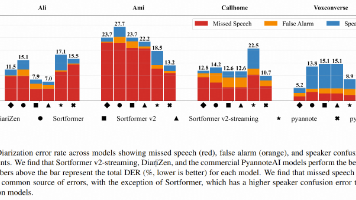

本文评测了当前主流的说话人分离模型性能,重点对比了pyannoteAI、DiariZen和Sortformer系列在不同场景下的表现。结果表明:pyannoteAI综合表现最佳(平均DER=11.2%),DiariZen是最强开源方案(DER=13.3%),而Sortformer v2在速度和流式处理上优势明显(RTF=214.3x)。研究发现当前模型的主要问题不是说话人混淆,而是语音漏检(占比约

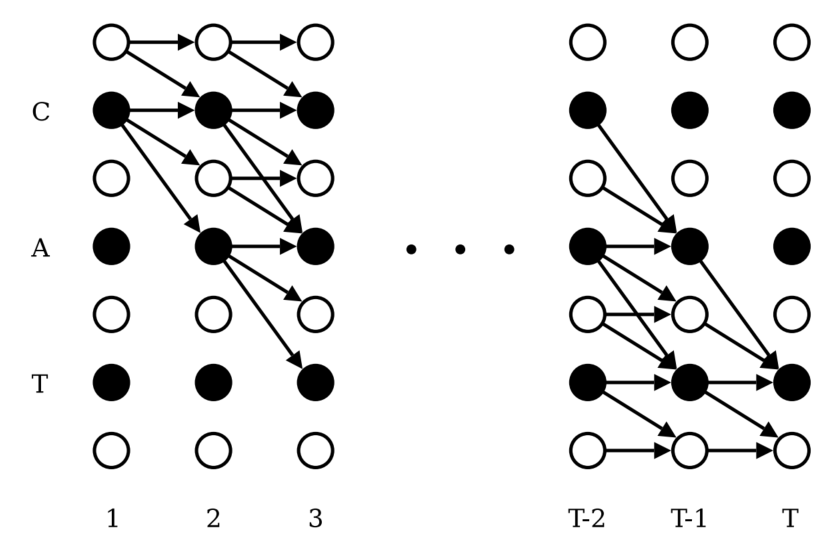

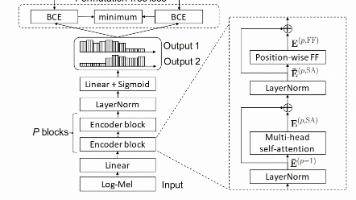

摘要: 论文《End-to-End Neural Speaker Diarization with Self-Attention》(SA-EEND)提出将原始EEND模型中的BLSTM编码器替换为自注意力机制,以更好地建模说话人分割任务中的全局和局部信息。SA-EEND通过逐帧多标签分类和置换不变损失进行训练,实验表明其在模拟和真实数据集上均显著优于BLSTM-EEND,尤其在重叠语音场景下表现更

手机端多说话人语音识别方案摘要 针对移动端及端云协同场景(会议/访谈等),推荐分层选型: 快速上线:pyannote.audio 作基线,结合现有ASR; 实时流式:评估 NVIDIA NeMo 的 Sortformer; 纯端侧部署:优先 sherpa-onnx(支持int8及多端API); 中文生态:选用 WeSpeaker + VBx 或 FunASR; 前沿研究:关注 DiariZen 及

本文分析了WeNet语音识别工具包中U2++模型的训练流程。重点阐述了动态分块训练技术,该技术通过随机采样不同大小的分块(chunk)进行训练,使同一套模型参数既能支持非流式(全句)又能支持流式(有限延时)场景。文章详细说明了如何通过配置参数控制训练模式,并深入解析了add_optional_chunk_mask函数的实现逻辑,包括随机采样chunk大小、限制左右上下文范围等关键步骤。这种训练方法