简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

Transformer——Sequence-to-sequence的理解

Transformer其实就是一个Sequence-to-sequence(Seq2seq)的模型。该模型输出是由机器自己决定。

树莓派4B使用python配置USB转RS485模块读取传感器数值

是更底层的工作方式。在使用一个引脚时,需要查找信道号和物理引脚编号之间的对应规则。不同的树莓派版本,编写的脚本文件可能是无法通用。如果输入引脚处于悬空状态,引脚的值将是漂动的。读取到的值是未知的,因为它并没有被连接到任何的信号上,直到按下一个按钮或开关。使用这种编号的好处是,硬件一直可以使用,树莓派的版本问题不会有影响(兼容)。GPIO.cleanup()只会释放掉脚本中使用的GPIO引脚,并会清

高效办公|用一套键鼠控制两台电脑解决方案

提高办公效率

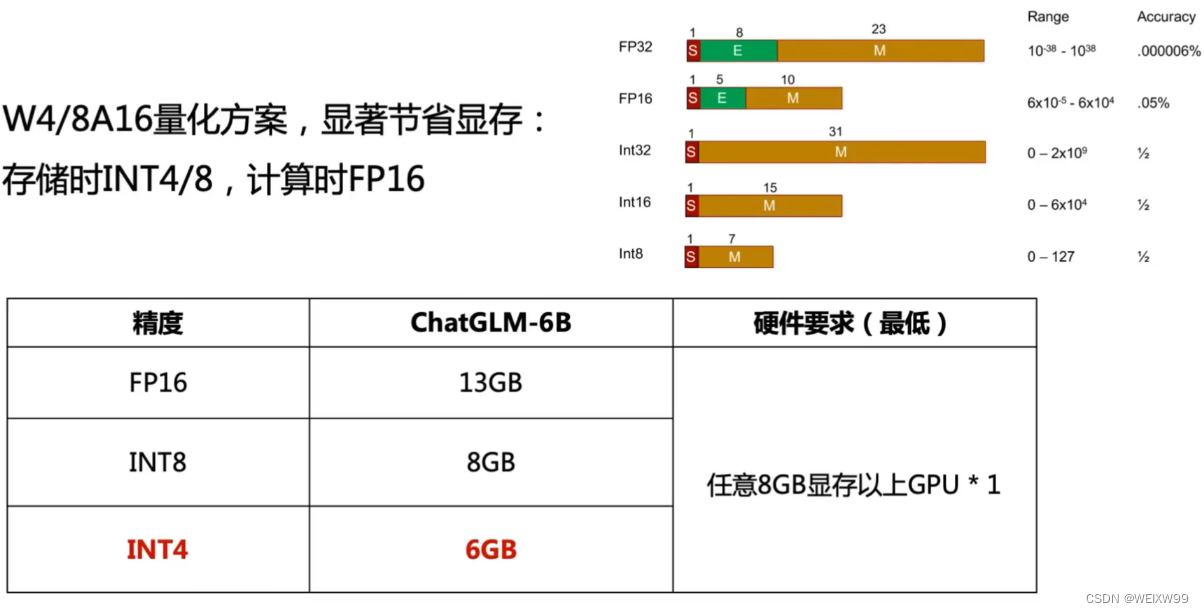

ChatGLM2-6B本地部署或云端部署配置过程

如果要是用CPU运行的话,要保证有32G内存才可以。从Hugging Face Hub上下载模型。模型下载后放入源代码项目文件夹内。从github上下载源代码。

关于python中子类继承父类init的三种方法

python

到底了