简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

vLLM是大模型本地部署的性能利器,通过PagedAttention算法和连续批处理技术,能显著提升推理速度与并发能力。相比ollama,vLLM吞吐量提升4.6倍,延迟降低57%,但需要更高配置(推荐RTX3090+16GB显存)。文章详细介绍了Docker和源码两种部署方式,以及性能优化技巧,并分享了网络运维助手的实战案例。vLLM适合生产环境高并发场景,而ollama更适合个人低配使用。文末

这篇文章详细介绍了作者如何重构Obsidian知识库,使其从杂乱无章变得系统可用。核心思路是:首先建立清晰的层级结构(总览/收件箱/领域/资源库/归档/模板),明确区分领域、专题和系列三种内容类型;其次规范命名规则和元数据标准,确保文件可检索;最后精简工具链,主要依靠Dataview插件实现自动化管理。作者特别强调,知识库的价值不在于收集内容的数量,而在于能否持续找到、理解和扩展知识。通过Code

这篇文章完整记录了我如何把 Hermes、Codex 和 Obsidian 串成一条自动化知识库流水线:从服务器每日生成内容,到 SSH 同步、本地暂存、待确认收件箱,再到正式入库与知识地图更新,整个过程都可复现。

这篇文章完整记录了我如何把 Hermes、Codex 和 Obsidian 串成一条自动化知识库流水线:从服务器每日生成内容,到 SSH 同步、本地暂存、待确认收件箱,再到正式入库与知识地图更新,整个过程都可复现。

摘要:在CentOS8服务器部署Ollama时,模型qwen3.5:9b意外运行在CPU而非RTX3060 GPU上。通过系统化排查(驱动验证、服务日志分析、环境变量检查、权限确认等),发现根因是Ollama运行库目录/usr/local/lib/ollama为空,导致CUDA后端加载失败。通过软链接修复库路径后问题解决。本文强调排障的核心并非单一命令,而是建立"先定性后缩圈"

本文详细介绍了使用Ollama+Llama3在本地部署大模型的完整教程。主要内容包括:Ollama的优势分析(一键安装、自动模型管理、内置API)、Llama3模型下载方法、命令行交互与API调用示例(含Python代码)、性能优化技巧(模型选择、参数调整等)以及常见问题解决方案。文章重点演示了如何搭建网络运维助手应用,并提供了代码实现。Ollama以其简便性成为本地开发首选工具,支持多种硬件配置

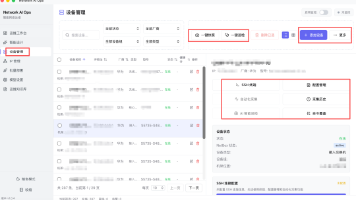

一套真正面向网络工程师、网络管理员、网络架构师的 本地优先、一体化、能落到实际业务里的网络运维桌面应用