简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

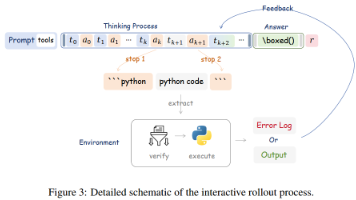

Search-o1 框架为 LRM 引入了一种智能、动态的知识获取和利用机制。通过赋予 LRM "何时搜索"、"搜索什么" 的自主权,并通过一个独立的模块来 "提炼和消化" 搜索结果,该方法有效地解决了 LRM 在面对复杂推理任务时的知识瓶颈问题。这不仅提升了模型的准确性,也增强了其推理过程的连贯性和可靠性。

QwenLong-L1 框架是长上下文大型推理模型发展的一个重要进展。它**首次系统地提出并验证了一套完整的、从短上下文到长上下文的RL适配方案**,有效解决了长上下文RL训练中的效率和稳定性两大核心痛点。

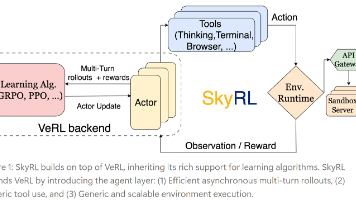

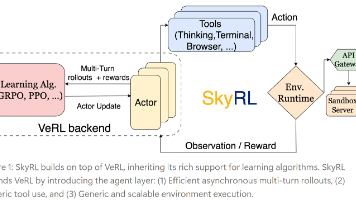

SkyRL-v0 是一个非常务实且有价值的工作。它没有把重点放在提出全新的强化学习算法上,而是通过引入**远程沙箱服务器**来解决环境扩展性问题,并通过**异步 Rollouts 和精巧的三阶段生产者-消费者流水线**来大幅提升 Rollout 效率,SkyRL 为在诸如 SWE-Bench 这样的“硬核”真实世界基准上训练 LLM 智能体铺平了道路。其核心贡献在于提供了一个**高效、可扩展的 R

这篇论文完成了一次扎实的探索。它清晰地证明了,LLM 智能体可以通过纯粹的结果导向强化学习,自发地掌握复杂工具的使用,并且这个学习过程遵循可预测的缩放法则。它最大的贡献在于,将“智能体学习使用工具”这个话题从“工程调优”的层面,提升到了一个更接近“科学规律”探索的层面。通过展示工具使用频率、响应长度和任务准确率之间可量化的关系,为我们理解和预测未来更强大智能体的能力涌现提供了坚实的基础。

SkyRL-v0 是一个非常务实且有价值的工作。它没有把重点放在提出全新的强化学习算法上,而是通过引入**远程沙箱服务器**来解决环境扩展性问题,并通过**异步 Rollouts 和精巧的三阶段生产者-消费者流水线**来大幅提升 Rollout 效率,SkyRL 为在诸如 SWE-Bench 这样的“硬核”真实世界基准上训练 LLM 智能体铺平了道路。其核心贡献在于提供了一个**高效、可扩展的 R

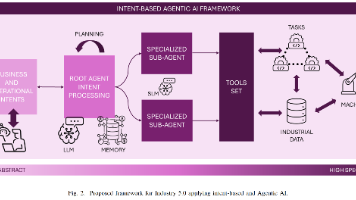

这篇论文为工业自动化领域如何利用 Agentic AI 的强大能力指明了一个有前景的方向。通过将高层意图分解为可执行的任务,并由专业化的智能体和工具协作完成,有望在人机交互、系统灵活性和自主性方面带来显著提升。

人工智能的发展正进入一个新的阶段。Gartner在其对2025年顶级科技趋势的分析中,将代理式AI(Agentic AI)置于首位,并预测到2028年,日常工作决策中或将有15%由其自主完成。这一趋势背后,反映了AI能力构建的重点,正从"生成内容"向"执行任务"迁移。本文旨在以技术演进的视角,对该范式转移进行梳理与分析。文章将回溯深度学习与生成式AI的发展,并论证当前的技术路径,正从依赖大规模预训

在人工智能的历史长河中,有几个里程碑式的成就彻底改变了我们对机器智能的认知。如果说 2016 年 AlphaGo 击败人类围棋冠军是划时代的事件,那么早在 20 多年前,1995 年诞生的TD-Gammon在西洋双陆棋(Backgammon)上的惊艳表现,同样在人工智能领域,尤其是强化学习(Reinforcement Learning, RL)的发展中,埋下了深远的影响种子,堪称是那个年代的“Al

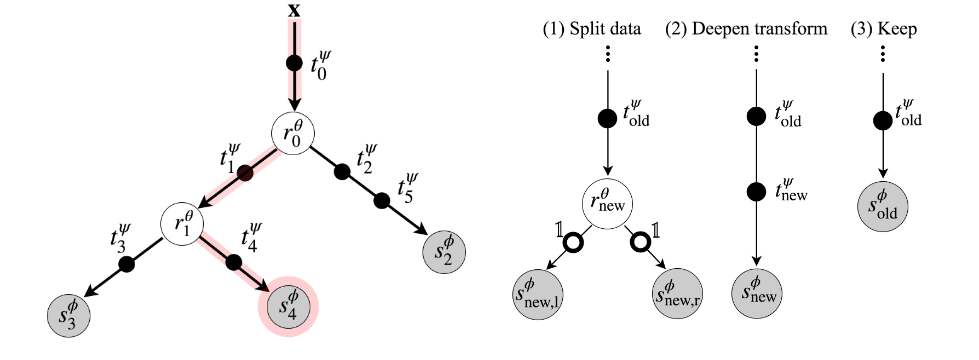

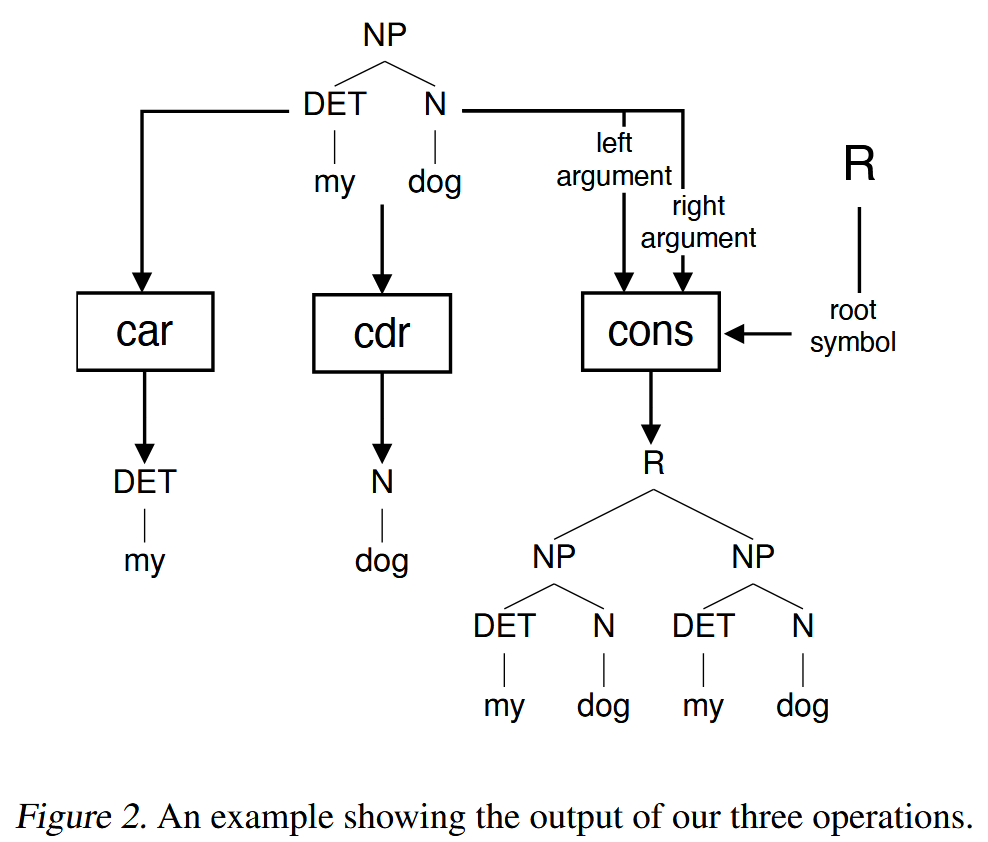

Soulos 等人提出的 DTM 架构是神经符号结合领域一次优雅的探索。它没有简单地堆砌神经网络和符号规则,而是从数学本质出发,利用 TPR 在向量空间中定义了可微的结构操作,并将操作的学习与执行解耦。这种设计带来了出色的组合泛化能力和良好的可解释性。尽管存在一些尚待解决的局限性,DTM 为构建能够理解和操作复杂结构、并具备强大泛化能力的下一代机器学习模型提供了宝贵的启示。

ANTs 引入了一种基于反向传播的自适应架构生长算法。这意味着树的结构并非预先设定,而是能够根据数据的特性进行动态生长和调整。