简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

工业4.0,也被称为第四次工业革命,是制造业和生产流程向全面数字化、智能化转型的一个新时代。这一概念最早由德国联邦教育研究部于2011年提出,其核心在于通过物联网(IoT)、云计算、人工智能(AI)、大数据、机器学习、高级机器人技术、增材制造(3D打印)、虚拟现实(VR)和增强现实(AR)等先进技术的融合,实现生产过程的优化和自动化。国务院《加快数字人才培育支撑数字经济发展行动方案(2024—20

在人工智能的广泛应用领域中,文本审查无疑是最为成熟且应用广泛的方向之一。以招投标业务中的招标文件合规性审查为例,此环节对于维护营商环境公正透明、确保招标活动高效规范至关重要。

MaxKB是一款基于大语言模型和检索增强生成(RAG)技术的开源知识库问答系统。MaxKB 是由飞致云旗下的 1Panel 团队开发的。github地址: https://github.com/1Panel-dev/MaxKB。

FastGPT是一个基于LLM大语言模型的知识库问答系统。

EmotiVoice 是网易有道开源的情感智能语音合成系统,通过深度学习技术实现文本到情感语音的自然转换。其核心目标是为开发者提供零门槛、高可控、多场景适配的语音合成解决方案,特别适合需要情感表达的内容创作、智能客服、教育培训等场景。项目以“情感赋予声音灵魂”为核心理念,重新定义了语音合成的技术边界。

EduChat由华东师范大学计算机科学与技术学院的EduNLP团队开发的一个面向教育领域的大规模语言模型对话系统,目标是为教师、学生和家长提供个性化、公平和富有同理心的智能教育服务。具备开放问答、情感支持、作文批改、启发式教学、自动出题、课程辅导和高考咨询等丰富功能。基于大规模语言模型,融合了多样化的教育领域数据,并通过指令微调和价值观对齐等方法进行优化。开源地址:https://github.c

Qwen3是阿里巴巴达摩院于2025年4月29日发布的新一代开源大语言模型,属于通义千问系列的最新成员。其核心突破在于首创混合推理架构,将人类认知科学中的“快思考”与“慢思考”机制融入模型设计,实现了复杂任务处理与高效响应的平衡。

BentSao开源了经过中文医学指令微调的大语言模型集,包括 Llama、AlpacaChinese、Bloom、活字模型等。基于医学知识图谱以及医学文献,结合 ChatGPT API 构建了中文医学指令微调数据集,并以此对各种基模型进行了指令微调,提高了基模型在医疗领域的问答效果。

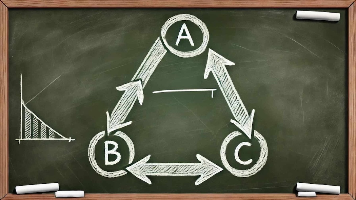

18世纪法国启蒙思想家康多塞,提出了一个颠覆大众认知的悖论,也就是康多塞循环悖论,直白打破了人们对“最优选择”的固有幻想。悖论最核心的模型十分简单:存在A、B、C三个选项,在两两对比的规则下,会形成闭环式的碾压关系:A优于B,B优于C,C反过来优于A。不同于常规的优劣排序A>B>C,这个环形偏好不存在层级高低。无论你选择哪一个选项,都会有另一个选项比它更好;我们永远无法筛选出全局最优解,陷入无限循

电商衡量广告、促销的核心痛点:你看到的转化,不全是它带来的——平台只会给高价值用户投广告、给爆款做促销,用户本身就想买,不是营销驱动;传统「投了vs没投」「发券vs不发券」的对比,全是选择偏差+混淆变量撑起来的虚假效果。因果方法的价值:剥离自然转化、用户禀赋、环境干扰,只算营销带来的「净新增转化」,直接指导预算、选品、投放。