简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

图来自B站某个视频,发现找不到原视频了!我们先来看下LLM是怎么结合到vllm中的。这是模型的入口,model_path路径指向下载的。可以看到通过from_engine_args来加载,继续往下看from_engine_args输入参数如下:cls(…, 这在本章开头的结构图中也能清晰看到。tokenizer比较简单,这里略过,schedule在第二篇文章中已经讲过。

vlllm官方代码更新频发,每个版本都有极大变动, 很难说哪个版本好用.第一次阅读vllm源码是0.4.0版本,对这版圈复杂度极高的调度代码印象深刻0.4.1对调度逻辑进行重构,完全大变样, 读代码速度快赶不上迭代的速度了。现在已经更新到0.5.4, 经过长时间观察,发现主要的调度逻辑基本也稳定了下来, 应该可以作为一个固话的版本去阅读。本文解读依据vllm 0.5.4版本. 没有修改任何代码,大

想在服务器上用vllm部署qwen2.5-vl, 然后使用gradio页面在本地调试,官方代码给了两条命令,列出的request body体结构, 不过要与gradio连用, 还需要重新组织代码。

self.model_executor.execute_model,调用与vllm耦合后的LLM模型进行推理。这是本篇要讲解内容,我们先来看下模型输入长什么样,execute_model_req:从调度系统中获得,可以用于做推理的seq_groups, 对seq_groups及可用到的各种属性做了封装,暂时不必管都是什么意思,用到时再现场分析。8.1中完成了资源调度工作,接下来该送入初始化好的模型

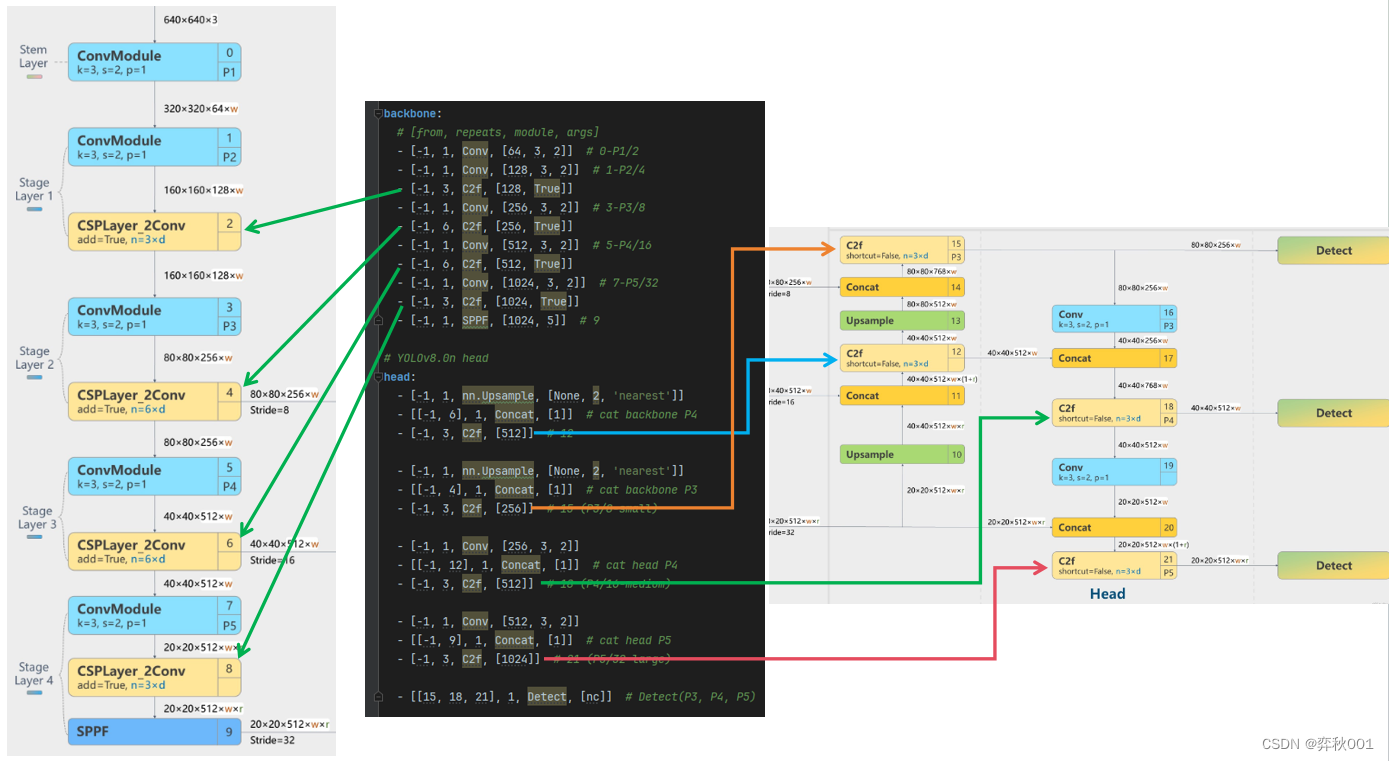

根据模块类型,将其添加到对应位置,清晰明了。通过此方法可以快速搭建新模型架构。接下来只需填充配置文件及对应参数就好。具体实施过程,参考下一篇将gold引入yolov8的文章。

self.model_executor.execute_model,调用与vllm耦合后的LLM模型进行推理。这是本篇要讲解内容,我们先来看下模型输入长什么样,execute_model_req:从调度系统中获得,可以用于做推理的seq_groups, 对seq_groups及可用到的各种属性做了封装,暂时不必管都是什么意思,用到时再现场分析。8.1中完成了资源调度工作,接下来该送入初始化好的模型

tvm易用性是不是限制它推广的主要因素?我觉得是的!踩了无数的坑,在树莓派上部署有无数bug,官方教程,民间教程通通不靠谱。tvm git仓库频繁更新,却没有出一个完善的使用文档,太奇怪了。在英特尔cpu上还很慢,瞬间不想在树莓派上玩了,可能优化参数没配置好吧。记得某位tvm使用者说的话,使用tvm项目周期不可控,对这句话有了更深刻理解,现在只想说,NCNN真香~!出了三篇文章想在树莓派上玩tvm

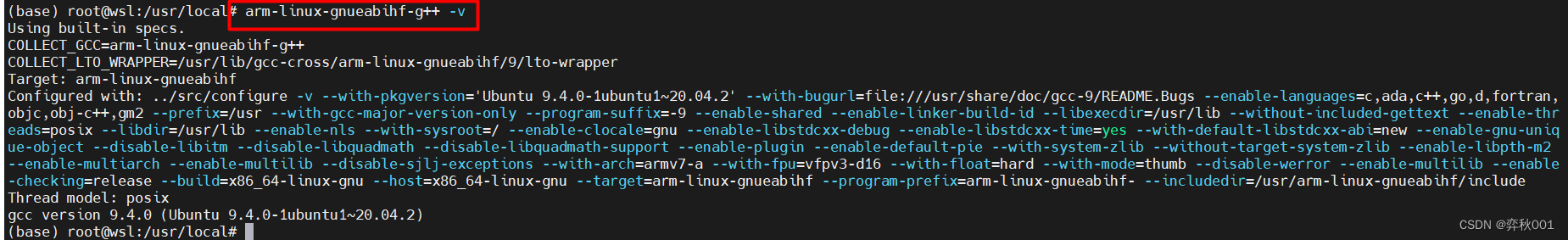

这部分主要记录部署环境的搭建。在电脑或服务器上编译,需要搭建完整的TVM工具链;树莓派上仅负责运行,因此只编译runtime即可。

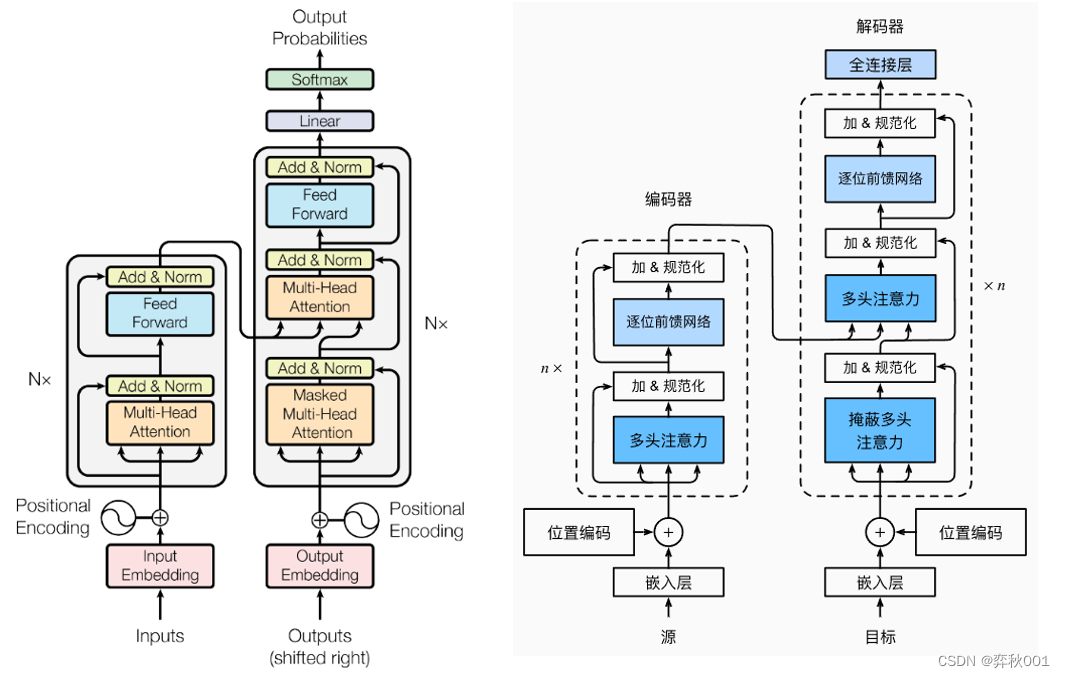

transformer是nlp领域重要创新,被应用到cv领域后更是迅速火爆,在Python包pyitcast已经实现好了transformer模型,为了深刻理解模型各个细节,这里重新手动实现一遍。重要参考:12345关于理论部分,上面列举参考讲的非常好,我写不出更好的文字解读,就直接推荐别人的吧。

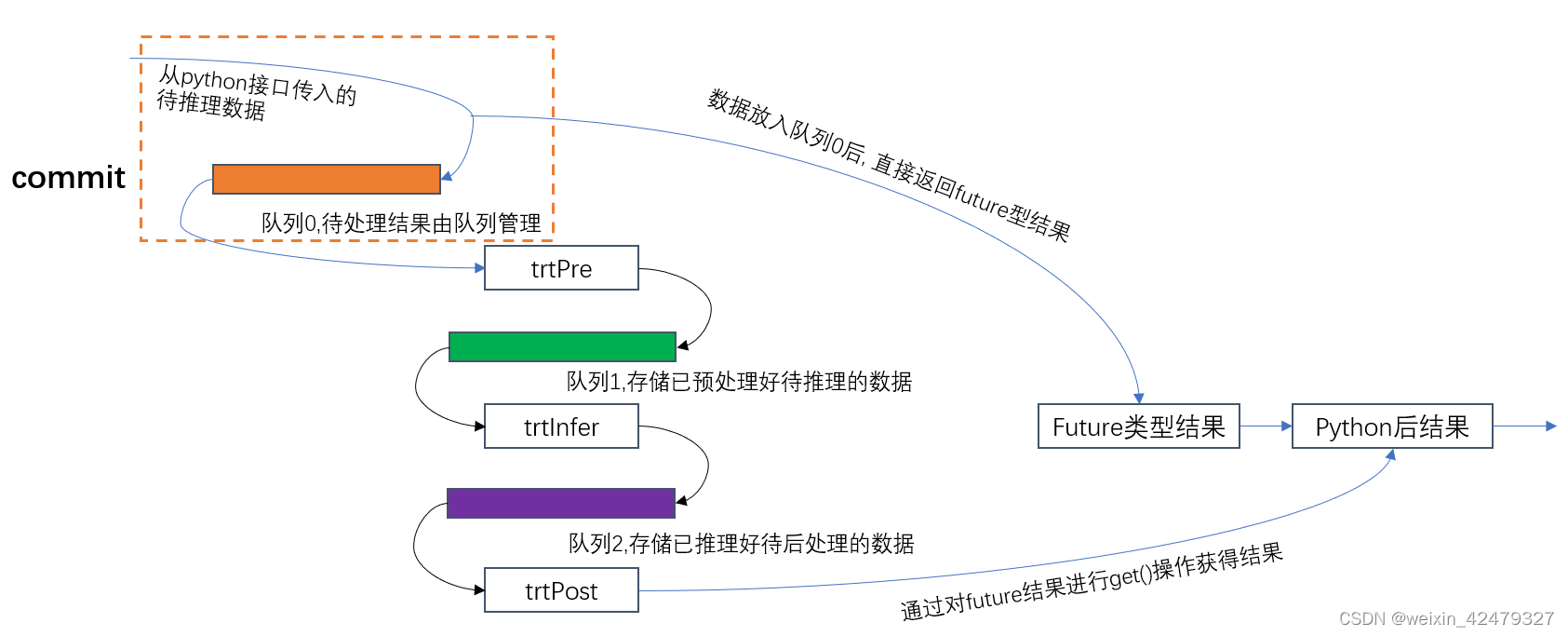

比如当模型执行到后处理阶段, 预处理和推理都是停止状态. 为提升效率,这里引入多线程方法. 即预处理,推理,后处理各是一个独立线程. 每个线程只处理从前一个步骤接收的数据,处理后放入共享队列, 等下一个节点去取用. 没有数据处理则进入等待状态. 三个线程同时工作, 效率会高很多.该实现类中最主要方法是commit,trtPre,trtInfer,trtPost和startThread, 属性中各种