简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

这节课中,我们要学习计算机视觉中最重要的任务之一——目标检测任务。我们会先认识目标定位和关键点检测这两个比较简单的任务,慢慢过度到目标检测任务。之后,我们会详细学习目标检测的经典算法YOLO。最后,我们会稍微认识一下语义分割任务及适用于此问题的U-Net架构。如上图所示,在神经网络风格迁移中,输入一张表示内容的图(C)和一张表示画家风格的图(S),我们可以借助神经网络生成一幅融合内容与风格的图片(

我们知道深度神经网络可以表达出更加复杂的非线性函数,这就可以实现从输入中提取更多不同的特征。但是随着网络层数的加多,梯度消失(vanishing gradient)的效应将被放大,这将导致算法在反向传播时从最后一层传播到第一层的过程中,算法乘了每一层的权重矩阵,因此梯度会很快地下降到接近0(或者很快地增加到一个很大的值)。

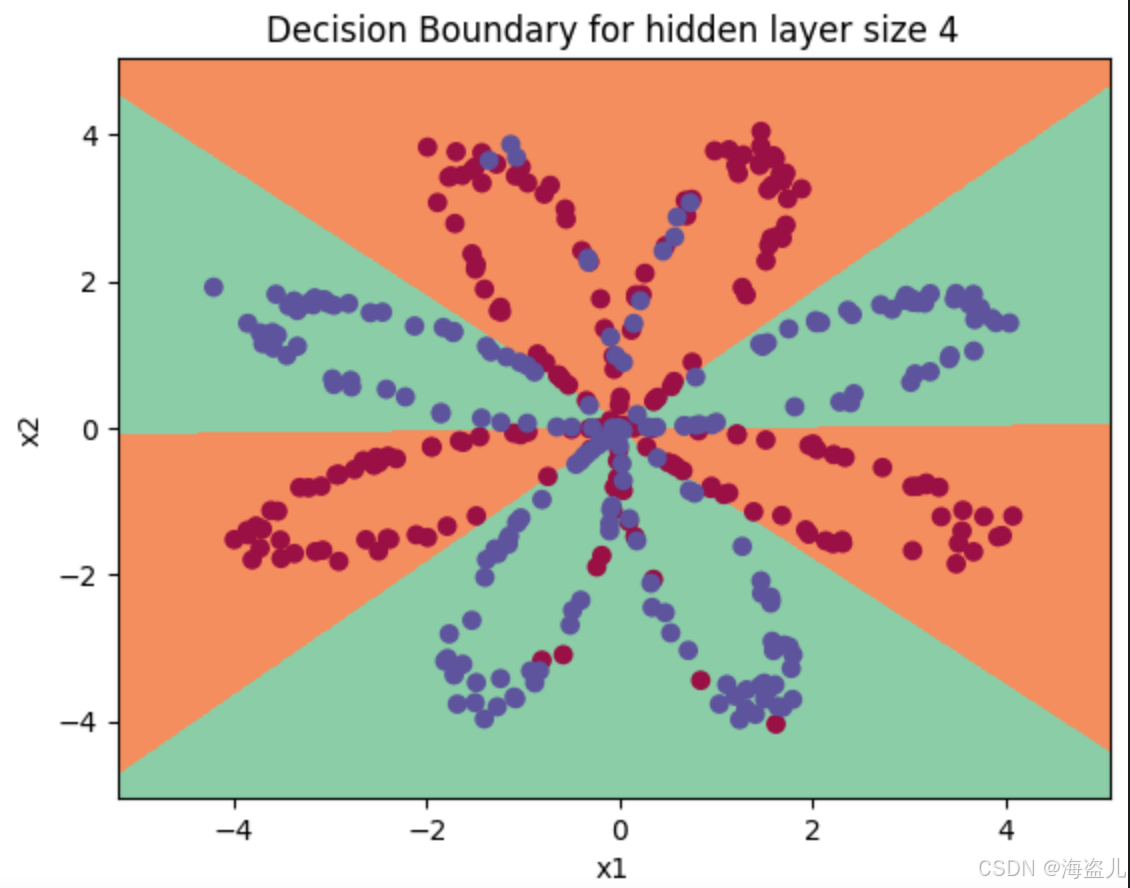

花瓣数据的极坐标方程通常为 r(θ)=acos(kθ)r(θ)=acos(kθ) 或 r(θ)=asin(kθ)r(θ)=asin(kθ)。其中,kk是整数,决定了花瓣的数量。当 k 为奇数时,曲线将有 kk 个花瓣;当 k为偶数时,曲线将有 2k个花瓣。本版本就是根据吴恩达作业提供的指导思路完成的。8. 隐藏层不同size导致的结果影响。4.向前传播->代价函数->向后传播。9.其他dat

我们把一个有输入和输出的计算单元叫做“神经元”。最简单的神经元就是一个线性函数。比如预测房价和房屋面积的关系时,我们会用一个线性函数去拟合。这个线性函数就是一个神经元。事实上,一个神经元不仅包含一个线性函数,还包括一个激活函数。这里提到了激活函数 ReLU 的概念,其具体内容应该会在后面的课程里介绍。如图所示举例,不同的X变量如房子大小/房间数量/邮编地段 最后会得到一个房价的预测,省去了中间的自

就是参考吴老师指导一步一步写的。

训练集开发集测试集用于优化参数是否否训练时可见?是是否最终测试时可见?是是是训练集就是令模型去拟合的数据。对于神经网络来说,我们把某类数据集输入进网络,之后用反向传播来优化网络的参数。这个过程中用的数据集就是训练营。开发集是我们在训练时调整超参数时用到的数据集。我们会测试不同的超参数,看看模型在开发集上的性能,并选择令模型开发集上最优的一组超参数。测试集是我们最终用来评估模型的数据集,当模型在测试

用户请求└─► BatchManager(内部)└─► CapacityScheduler(KV Cache 维度筛选)└─► MicroBatchScheduler(batch 维度分组)├─► KVCacheManager(分配 Block Table)├─► RuntimeBuffers(准备输入 Tensor)│└─► GPU Kernels(异步执行)└─► Next Token → 通

我们知道深度神经网络可以表达出更加复杂的非线性函数,这就可以实现从输入中提取更多不同的特征。但是随着网络层数的加多,梯度消失(vanishing gradient)的效应将被放大,这将导致算法在反向传播时从最后一层传播到第一层的过程中,算法乘了每一层的权重矩阵,因此梯度会很快地下降到接近0(或者很快地增加到一个很大的值)。

就是参考吴老师指导一步一步写的。

我们把一个有输入和输出的计算单元叫做“神经元”。最简单的神经元就是一个线性函数。比如预测房价和房屋面积的关系时,我们会用一个线性函数去拟合。这个线性函数就是一个神经元。事实上,一个神经元不仅包含一个线性函数,还包括一个激活函数。这里提到了激活函数 ReLU 的概念,其具体内容应该会在后面的课程里介绍。如图所示举例,不同的X变量如房子大小/房间数量/邮编地段 最后会得到一个房价的预测,省去了中间的自