简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Google Gemma 4 26B-A4B-it 和 DeepSeek V4 系列都在解决长上下文推理里的同一个核心问题:Attention / KV cache 太贵。但它们选择的路线并不一样。本文不做厂商拉踩,只从工程视角讲清:它们各自省了什么,又把代价转移到了哪里。

本文介绍 PYTORCH_CUDA_ALLOC_CONF 环境变量的配置方法,帮助你在显存紧张时最大化利用 GPU 资源,减少 OOM(Out of Memory)错误。

当所有人都在卷 RAG 的 Embedding 质量和向量数据库选型时,阿里 ModelScope 团队另辟蹊径——直接在原始文件上做搜索,用蒙特卡洛采样替代文档切片,让知识自己"进化"。本文深度解析 Sirchmunk 的技术架构与设计哲学。

在使用 Dify 的 Custom Tool(自定义工具)功能调用外部 API 时,你是否遇到过这样的问题:- 工具调用反复重试,日志中出现多次相同请求- API 明明执行成功了,但 Dify 显示超时失败- 复杂的 AI 处理流程总是在中途断开如果你正在被这些问题困扰,这篇文章将帮你彻底解决!

大模型推理进入 decode 阶段后,很多人会发现 GPU 利用率不高、显存占用很高、tokens/s 上不去。但问题到底出在读模型权重,还是读 KV cache?这篇文章给出一个非常实用的判断方法:固定模型和输出长度,只做两组小实验,分别拉长上下文和拉高并发,就能快速判断瓶颈更偏权重读取、KV cache,还是两者混合。

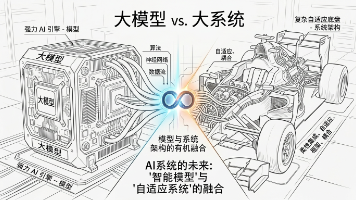

未来的 AI 系统,将是“足够智能的 Model”与“足够自适应的 Harness”的有机融合体。最顶尖的 AI 产品,必然是一辆法拉利:你需要一颗最强的发动机(Big Model),但也必须拥有一套顶级的空气动力学套件和底盘调校(Big Harness),否则,你的车根本跑不快,或者转个弯就翻了。

OpenClaw是一个开源、可扩展的个人AI助手框架将AI助手深度集成到你的数字生活通过插件连接各种服务(微信、Telegram、邮件、日历等)创建自定义技能,让AI帮你完成特定任务在本地或云端部署,完全掌控你的数据# 生成技能模板 openclaw skill create my-stock-tracker。

GPT-5.5 System Card 如果只被读成“OpenAI 又把模型做强了”,其实会错过更关键的变化。GPT-5.5 的核心增量,不只是回答质量继续上移,而是复杂真实任务中的完成能力更强了:更早理解任务、更少依赖手把手提示、更会调用工具、更会自检并持续推进。与此同时,安全治理也从“模型会不会乱答”升级成“Agent 在真实环境里会不会乱做事”的体系化治理。对行业来说,这意味着竞争焦点正在从

Gemma 4 和 gpt-oss-20b 都是 2026 年最热的开源模型,但"能不能跑"和"跑得怎么样"是两回事。本文基于同一台服务器、同系列 48GB 显卡的真实测试数据,从部署踩坑、显存占用、长上下文并发吞吐、冷热启动差异等维度做了一次完整的横向对比。所有数据均来自实测,不依赖官方 benchmark 推断。

当所有人都在卷 RAG 的 Embedding 质量和向量数据库选型时,阿里 ModelScope 团队另辟蹊径——直接在原始文件上做搜索,用蒙特卡洛采样替代文档切片,让知识自己"进化"。本文深度解析 Sirchmunk 的技术架构与设计哲学。