简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

回顾: 【零基础】AI神经元解析(含实例代码) 【零基础】浅层神经网络解析一、序言 前面我们已经完成了单神经元、浅层神经网络(2层)的解析,其中有很多没有讲透的地方我们就暂时不要理会了,比如反向传播的原理我也没看明白呢。这里我们继续下一步,解析深层的神经网络(N层),也就是真的要“深度学习”了。 注:本文内容主要是对“床长”的系列教程进行总结,强烈推荐“床长”的人...

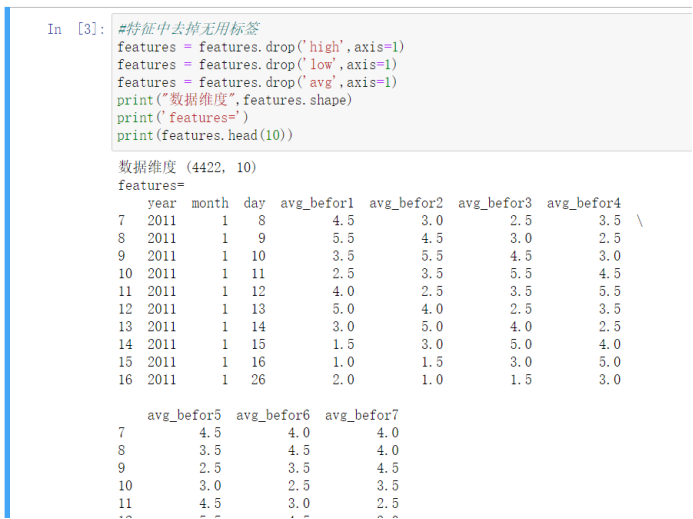

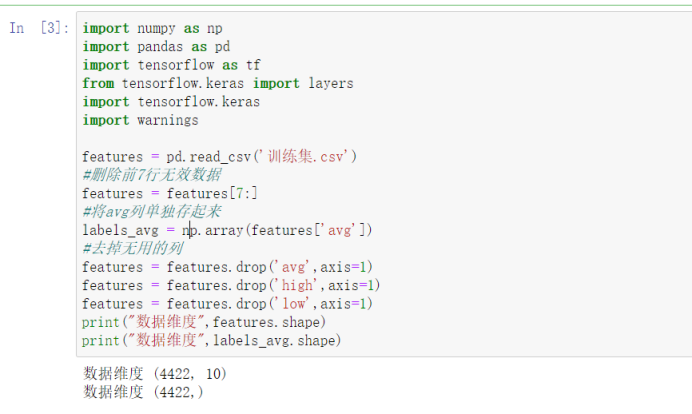

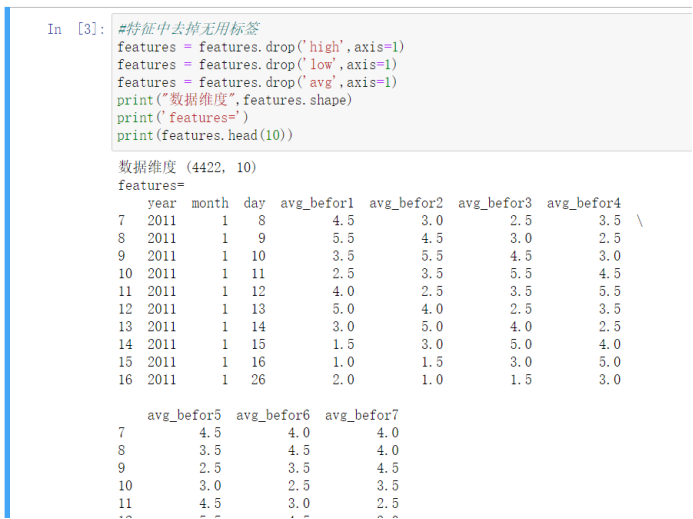

这里我们构建了一个16>32>1的神经网络模型,其中16、32、1指的是每一层的神经元数量,第一层与第二层的神经元数量无所谓可以随便写,第三层的1与预测的结果相对应,也就是我们使用前7天的平均温度,预测的是今天这“一个”平均温度。Val_loss是模型验证的“损失”,也就是前面我们设置的那10%,这个值越小说明你的模型验证的结果也不错。各字段的意思看名字就知道了,其中avg指的是当日平均温度,av

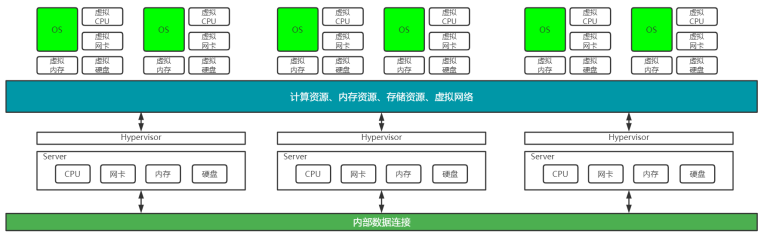

一、概述 近期研究了一下超融合的内容,简单做了下学习总结。 虚拟化是一种基本思想,是云计算、超融合的基础,在信息系统的各层都有不同的应用,举例来说: 存储虚拟化,存储阵列就是将若干集中部署的磁盘先汇总,再划分成不同的逻辑磁盘分配给不同的服务器使用。 网络虚拟化,网络我们一般分为接入层和汇聚层,使用网络虚拟化后,对于单个宿主机到交换机的部分可以认为是汇聚层,对于宿主机中虚拟出的OS,可以在内

一、前言 开始研究API了,远期目标是实现极星量化(python)运行策略,但下单通过API(C++)下单,在API上做一些简单的功能,比如条件单、止盈止损、套利等,极星量化跑策略向API下指令交易。这样做似乎有点脱了裤子放屁的感觉,但不失为一种新的尝试。 本篇就先搞定开发环境的问题,由于一个很奇葩的原因,这里就只研究linux下的开发环境,我使用的是centos6.7。 (因为...

最后的最后,我突然想到3年前,第一次接触神经网络时,当时的教程说,如果要做“概率”预测,最好就将待训练的数据进行归一化,也就是将10、20、30,这样的数据,按正态分布转换成0.1、0.2、0.3这样介于0-1之间的数。正常应该是2、5、6,实际是2.3、4.3、6.3。为了解决这个问题,我构建了一个极简的问题和模型,从最简单的问题来入手,排查问题产生的原因,功夫不负有心人,还真给我排查到了。所以

回顾: 【零基础】AI神经元解析(含实例代码) 【零基础】浅层神经网络解析一、序言 前面我们已经完成了单神经元、浅层神经网络(2层)的解析,其中有很多没有讲透的地方我们就暂时不要理会了,比如反向传播的原理我也没看明白呢。这里我们继续下一步,解析深层的神经网络(N层),也就是真的要“深度学习”了。 注:本文内容主要是对“床长”的系列教程进行总结,强烈推荐“床长”的人...

一、序言 前面的文章中,我们逐步从单神经元、浅层网络到深层网络,并且大概搞懂了“向前传播”和“反向传播”的原理,比较而言深层网络做“手写数字”识别已经游刃有余了,但神经网络还存在很多问题,比如最常见的两个问题:“过拟合”和“欠拟合”,下图中从左到右依次是“欠拟合”、“刚刚好”、“过拟合”。 简单点说,欠拟合是我们学习到的w没能很好地“满足”训练数据的特征,一般是因为训练数据...

这里我们构建了一个16>32>1的神经网络模型,其中16、32、1指的是每一层的神经元数量,第一层与第二层的神经元数量无所谓可以随便写,第三层的1与预测的结果相对应,也就是我们使用前7天的平均温度,预测的是今天这“一个”平均温度。Val_loss是模型验证的“损失”,也就是前面我们设置的那10%,这个值越小说明你的模型验证的结果也不错。各字段的意思看名字就知道了,其中avg指的是当日平均温度,av

这里我存了两个格式csv和excel,我们实际需要的是csv格式,比较方便后续的处理,那为啥还需要excel呢,因为我们提取持仓信息后还得校验一下,如果靠人工眼睛去核对,那眼睛看瞎了2000个文档不知道能不能比对的过来。所以最终我是借助AI的能力将需求进行拆解,最终我再来组装一下。跑代码比如下载、识别、提取什么的都还好,人工比对真的太耗精神了,我目前做了50个pdf的提取和比对,花了约60分钟,一

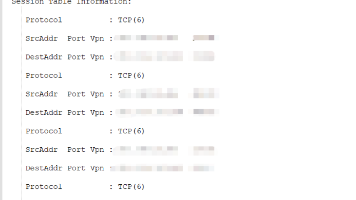

摘要:办公室网络间歇性断网一周,网页无法打开但即时通讯软件仍可使用。通过路由器日志发现"会话资源过载"提示,但低端路由器功能有限无法直接排查。借助AI助手编写telnet脚本,在断网时自动捕获异常会话数据,发现两个公网IP创建了超3000个异常会话。最终通过添加ACL策略封禁问题IP解决。整个排查过程耗时3天,充分展现了AI技术对非专业人员的辅助价值,实现了"懂一点但