简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

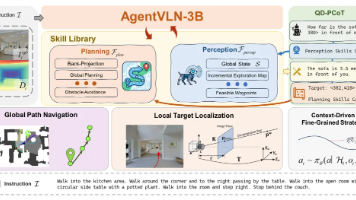

在RxR-CE验证集上的对比显示,AgentVLN以仅3B的微小参数量,在成功率(SR)上全面碾压了参数量高达7B甚至8B以上的现有最先进模型(如InternVLA-N1、DualVLN等),真正实现了轻量化与高性能的完美结合。在这个框架中,视觉语言模型(VLM)被彻底“升维”成了只负责高层调度的“大脑”,它不再死磕底层的空间几何计算,而是像一个成熟的Agent一样,根据当前的环境主动去调用底层的

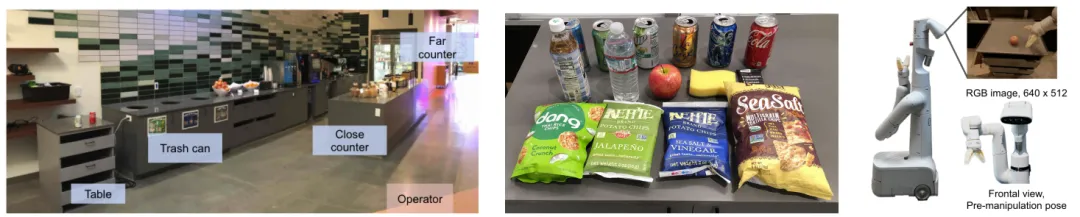

依托RoboTwin平台,统一仿真环境合成、轨迹生成、模型训练评估三大核心操作,实现从自然语言指令到端到端开发流程的自动转化,支持跨平台、多模型的无缝适配与步骤级验证回退。研究构建了基于OpenClaw运行时、适配ROS 2的模型无关执行层,通过能力发现、观测归一化、执行前验证、审计日志四大核心契约,实现任意基础模型与异构机器人的标准化连接。,依赖实用的反向重置行为构建可用环境,仅在室内桌面整理等

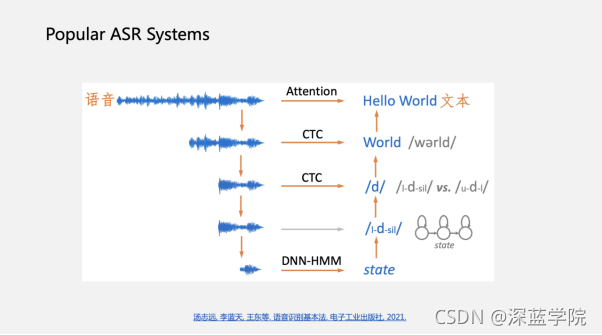

本文总结于2021年10月30日汤志远博士在深蓝学院关于[口音与方言语音识别研究进展]的公开课,更多详细内容可以参见公开课。见文末~汤博士和大家一起分享了关于口音与方言语音识别的研究进展,并介绍了口音或方言语音识别相关的数据、基准和竞赛,以及一些可行的研究方向。口音和方言问题回顾所谓的语音识别就是实现从语音到文本的转换,建模方式从过去常用的DNN-HMM结构转变到最近流行的端对端结构。这些模型的区

SayCan的诞生,标志着LLM在机器人操作规划领域的应用迈出了关键一步。通过深度融合语言理解与物理执行能力,SayCan不仅提升了任务执行的准确性和效率,更为机器人技术的未来发展描绘了更加广阔的蓝图。随着技术的不断进步和完善,SayCan有望在更多复杂场景中发挥重要作用,持续推动机器人技术的创新与飞跃。©️【深蓝AI】撰文|Sienna审核|Los本文首发于微信公众号【深蓝AI】,移步公众号【深

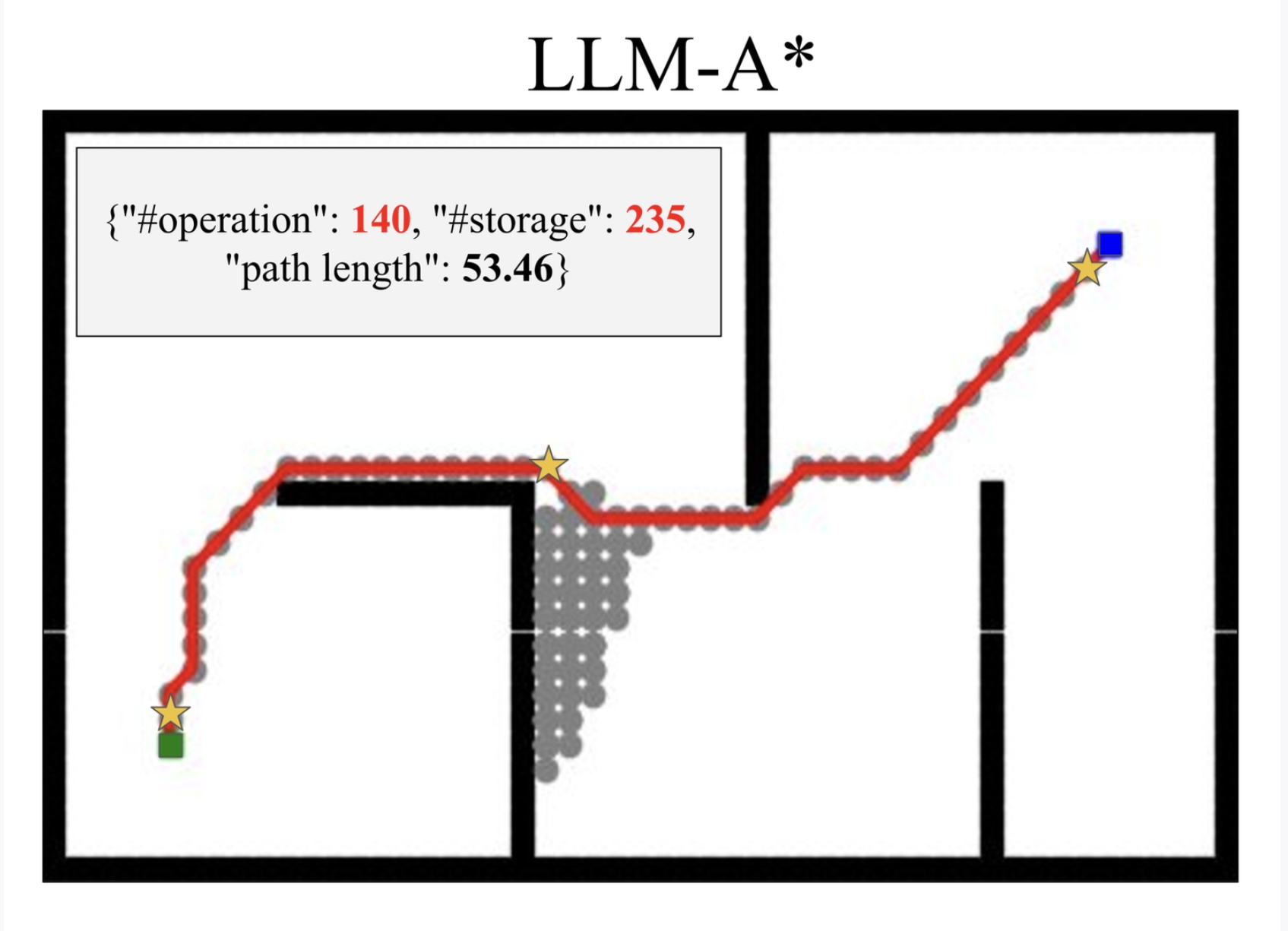

LLM-A*算法在计算效率和内存使用效率方面都显著优于传统的A*算法,同时相比纯LLM方法,在路径的稳健性和最优性方面也表现更好。

英伟达研究团队提出了一份全面报告,详细介绍了如何使用剪枝和蒸馏技术将Llama 3.1 8B和Mistral NeMo 12B模型分别压缩至4B和8B参数。他们探索了两种不同的剪枝策略:深度剪枝和联合隐藏/注意力/MLP(宽度)剪枝。研究人员使用LM Evaluation Harness中的常用基准测试对压缩结果进行了评估。这些模型通过NeMo Aligner进行对齐,并在指令调优版本中进行了测试

在每个数据样本的结构化文本中,我们根据物体类别随机选择一个推理模板,然后附加上真实抓取姿势的文本,这个过程可能比较难理解,笔者认为可以将其简单的转述为:本文方法是以文本的形式获得机器人抓取时的各种抓取策略以及环境的观测信息,而根据机器人抓取的常见场景,能够将这些观测信息与抓取策略大致的归为几类(属于是机器学习中常见的无监督归类问题,LLM非常擅长),随后针对每个类型,提供对应的模版,这样可以促进机

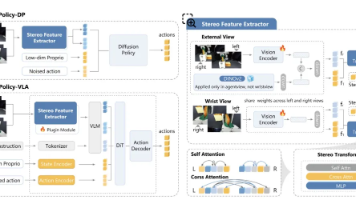

该方法无需复杂相机标定、不用重建深度图或点云,仅通过双目特征融合,就能让机器人获得精准空间感知,在仿真与真实场景中全面超越单目、RGB-D、点云等基线,为机器人3D感知提供了低成本、高适配的新范式。自注意力捕捉单目图像内像素级关联,交叉注意力聚焦左右目间空间对应关系,同时引入2D旋转位置编码(2D RoPE),强化跨视角位置推理,让模型隐式学习视差与空间几何,无需显式计算深度。基线过大(10cm)

框架的设计形态,让潜在推理模式不再需要牺牲任务表现换取低时延,拉近了潜在推理与显式推理的效果差距,同时增添视觉场景推演的解释维度,丰富了模型决策的可追溯性。,既可以输出自然语言形式的决策推理描述,也可以生成未来短时场景的推演画面,相比只提供单一语言解释的模型,可参考的信息维度更为丰富,便于研发人员做场景调试、问题定位与效果验证,双模态可解释能力的实现逻辑在项目主页技术介绍中有完整说明。所有潜在令牌

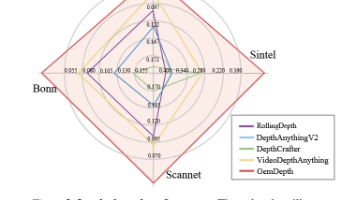

能交出这么亮眼的成绩单,全靠模型自带的“3D 视野”——在几何线索的牵引下,时空特征在交替交互中死死咬住像素点的运动轨迹,让空间的高清画质和时间的丝滑流畅同时拉满。这种 沿着运动轨迹提取特征的做法,能有效屏蔽掉杂乱背景的干扰,专心捕捉纯粹的运动信息,从而保证了画面结构的稳定,让闪烁问题无处遁形。不可否认, 如今的单帧深度估计大模型已经非常强大,无论是走判别式路线的 VideoDepthAnythi