简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

近年来,知识蒸馏已被证明是模型压缩的有效解决方案。这种方法可以使轻量级学生模型获取从繁琐的教师模型中提取的知识。然而,以前的蒸馏检测方法对不同检测框架的泛化性较弱,并且严重依赖地面实况(GT),忽略了实例之间的有价值的关系信息。因此,我们提出了一种基于判别实例的检测任务的新蒸馏方法,而不考虑GT区分的正负,称为通用实例蒸馏(GID)。我们的方法包含一个通用实例选择模块(GISM),以充分利用基于特

在过去的几年里,深度神经网络取得了显著的成就。然而,神经网络精度的突破总是伴随着计算和参数的爆炸式增长,这导致了模型部署的严重限制。在本文中,我们提出了一种名为自蒸馏的新型知识蒸馏技术来解决这个问题。自蒸馏在神经网络的不同深度附加了几个注意力模块和浅层分类器,并将知识从最深的分类器提炼到较浅的分类器。与传统的知识蒸馏方法不同,教师模型的知识转移到另一个学生模型中,自我蒸馏可以被视为同一模型中的知识

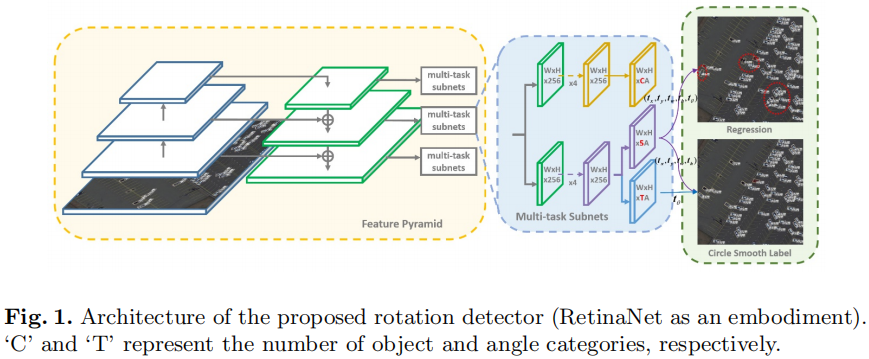

定向目标检测因其在航空图像、场景文本和面部识别等方面的重要性,近年来受到越来越多的关注。在本文中,我们证明了现有的基于回归的旋转检测器存在不连续边界问题,这是直接由角周期性或角排序引起的。通过仔细的研究,我们发现其根本原因是理想的预测超出了所定义的范围。我们设计了一种新的旋转检测baseline,通过将角度预测从回归问题转化为精度损失小的分类任务来解决边界问题,从而设计了基于粗粒度的高精度角度分类

在过去的几年里,深度神经网络取得了显著的成就。然而,神经网络精度的突破总是伴随着计算和参数的爆炸式增长,这导致了模型部署的严重限制。在本文中,我们提出了一种名为自蒸馏的新型知识蒸馏技术来解决这个问题。自蒸馏在神经网络的不同深度附加了几个注意力模块和浅层分类器,并将知识从最深的分类器提炼到较浅的分类器。与传统的知识蒸馏方法不同,教师模型的知识转移到另一个学生模型中,自我蒸馏可以被视为同一模型中的知识

近年来,知识蒸馏已被证明是模型压缩的有效解决方案。这种方法可以使轻量级学生模型获取从繁琐的教师模型中提取的知识。然而,以前的蒸馏检测方法对不同检测框架的泛化性较弱,并且严重依赖地面实况(GT),忽略了实例之间的有价值的关系信息。因此,我们提出了一种基于判别实例的检测任务的新蒸馏方法,而不考虑GT区分的正负,称为通用实例蒸馏(GID)。我们的方法包含一个通用实例选择模块(GISM),以充分利用基于特

知识蒸馏(KD)是一种有效的模型压缩技术,是教授紧凑的学生网络来模仿复杂且训练有素的教师网络的行为。相比之下,相互学习(ML)提供了一种替代策略,即使没有强大但静态的教师网络,也可以从共享知识中使多个简单的学生网络受益。在这些发现的激励下,我们提出了一个单教师、多学生的框架,该框架利用 KD 和 ML 来实现更好的表现。此外,我们还利用在线蒸馏策略同时培训教师和学生。为了评估所提出的方法的性能,我

知识蒸馏是一种将知识从预训练的复杂教师模型转移到学生模型的方法,因此较小的网络可以在部署阶段取代大型教师网络。为了减少训练大型教师模型的必要性,最近的文献引入了自我知识蒸馏,该算法逐步训练学生网络,以便在没有预先训练的教师网络的情况下提炼自己的知识。虽然自我知识蒸馏主要分为基于数据增强的方法和基于辅助网络的方法,但数据增强方法在增强过程中会丢失其局部信息,这阻碍了其对各种视觉任务(如语义分割)的适

知识蒸馏是通过设计的损失函数将教师网络学到的有效知识转移到学生网络中,帮助学生网络以更低的计算成本获得更好的性能。但是,当学生网络和教师网络在结构和计算量上存在很大差异时,以前的知识蒸馏方法很难有效提高学生网络性能。为了改善这种情况,本文提出了轻量级网络的结构化注意力蒸馏。结构化注意力蒸馏对模型中的特征进行通道分组,通过细化空间注意力图,帮助学生网络学习教师网络的特征提取能力。我们提出的方法是在C

最近在做旋转目标检测,看到论文里说很多工作都是致力于提取旋转不变特征,特此记录两个术语的定义。