简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

让业务人员也能用上机器学习——这是我开源MLquick的初衷。一款零代码的桌面工具,背后是我坚信的一个简单道理:技术应该赋能普通人,而不是筑起新的门槛。现在,业务人员完全可以自己动手,不必等技术排期,不用靠程序员支援。从萌生想法到拿到结果,常常只要一杯咖啡的时间。如果你也觉得这样的工具值得被更多人看见,不妨给项目点个Star,让它在开源世界里走得更远。Fork到你的仓库,或许哪天你想亲手为它添砖加

让业务人员也能用上机器学习——这是我开源MLquick的初衷。一款零代码的桌面工具,背后是我坚信的一个简单道理:技术应该赋能普通人,而不是筑起新的门槛。现在,业务人员完全可以自己动手,不必等技术排期,不用靠程序员支援。从萌生想法到拿到结果,常常只要一杯咖啡的时间。如果你也觉得这样的工具值得被更多人看见,不妨给项目点个Star,让它在开源世界里走得更远。Fork到你的仓库,或许哪天你想亲手为它添砖加

做产品经理这么多年,我明白一个道理:好的工具不是替代专业能力,而是把专业能力从繁琐的“体力活”中解放出来。FactorHub的定位很明确:做量化因子研究的“全流程工作站”。

一位产品经理父亲为两岁女儿开发了开源AI故事生成工具StoryCraft。该项目旨在解决父母"故事荒"痛点,只需输入创意点子,AI就能自动生成情节连贯、插图一致的个性化双语故事。不同于市面上的内容分发产品,StoryCraft专注于打造"内容生产工具",强调低门槛、高质量和流程极简。作者选择开源模式,希望汇聚社区力量持续优化,用技术传递温度,守护童心。该项目

摘要:2017年谷歌提出的Transformer架构彻底革新了自然语言处理领域。其核心创新在于完全基于注意力机制,解决了传统RNN的并行计算缺陷和长距离依赖问题,通过多头自注意力和编解码器结构实现高效语义建模。Transformer的并行处理能力使训练速度提升10-100倍,且能精准捕捉长文本关联。该架构催生了BERT、GPT等里程碑模型,推动AI进入预训练时代。尽管存在计算成本高、可解释性弱等局

为实现策略手册的动态演进,ACE框架设计了三大核心组件——生成器(Generator)、反思器(Reflector)、整合器(Curator),分别对应人类“动手实践-分析总结-知识沉淀”的学习流程。ACE论文强调,这种模块化分工不仅解耦了复杂任务,还提升了每个环节的专业性:“让每个组件专注于自己的职责,比让单一LLM承担所有任务更高效,也更符合人类的学习逻辑。生成器(Generator)是LLM

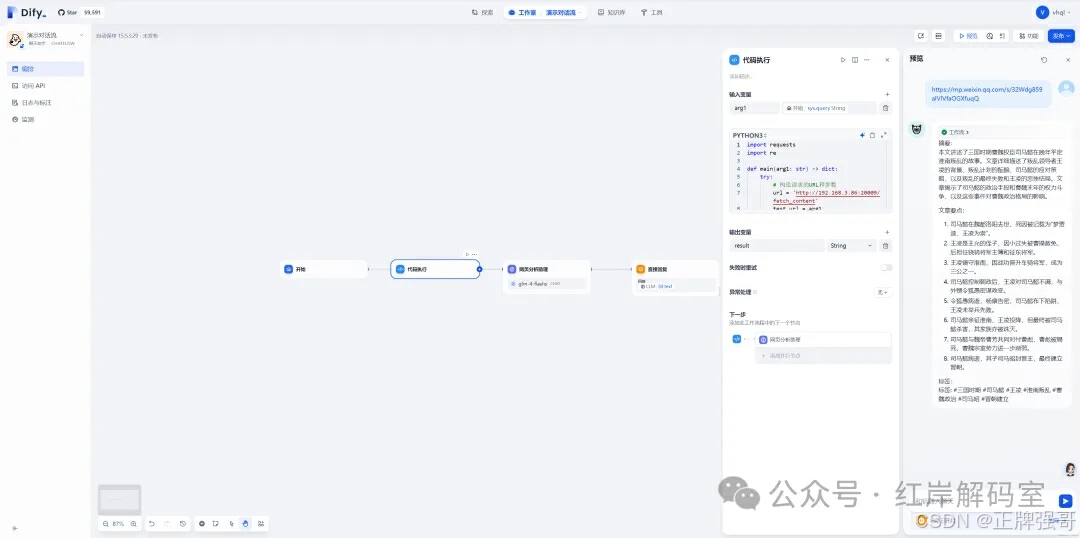

环境:dify 14.2 docker版本;模型:glm-4-flash;工具:bing,http,jina;

环境:dify 14.2 docker 版本;工具:craw4ai模型:glm-4-flash。

用户仅需输入一个标题,随后通过搜索引擎查找与之相关的素材。接着,利用大模型对标题和素材进行深入分析与整理,并以 Marp 格式进行输出。通过自定义接口服务 md_pdf,将 Marp 格式的内容保存为 Markdown 文件。在该接口中调用 marp-cli 工具,将 Markdown 文件转换为 PPT 格式进行展示,同时返回预览链接和下载链接,大功告成!

摘要:因子投资从华尔街专业工具发展为大众可及的量化方法,其核心是将投资逻辑转化为可验证的数学因子。开源平台FactorHub通过整合数据获取、因子计算、回测分析等全流程,大幅降低了量化投资门槛。该平台采用模块化设计和并行计算技术,提供200多个预置因子和可视化分析工具,支持个人投资者和机构快速验证投资策略。FactorHub的兴起反映了量化投资民主化趋势,通过开源生态推动投资决策的科学化,使专业级