简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

分割、pose等条件+文本引导图像生成,ControlNet使用教程

def precision(y_true, y_pred):# Calculates the precisiontrue_positives = K.sum(K.round(K.clip(y_true * y_pred, 0, 1)))predicted_positives = K.sum(K.round(K.clip(y_pred, 0, 1)))pre...

Gradient boosting是一种广泛被用于回归、分类和排序任务的集成方法,于2001年被Friedman提出 该类算法通过以上一轮基学习器的误差的负梯度为训练目标训练本轮的基学习器,不断降低集成模型在训练集上的偏差实现高精度的集成 基于Gradient Boosting算法的学习器被称为Gradient Boosting Machine(GBM),如果说AdaBoost是boosting方

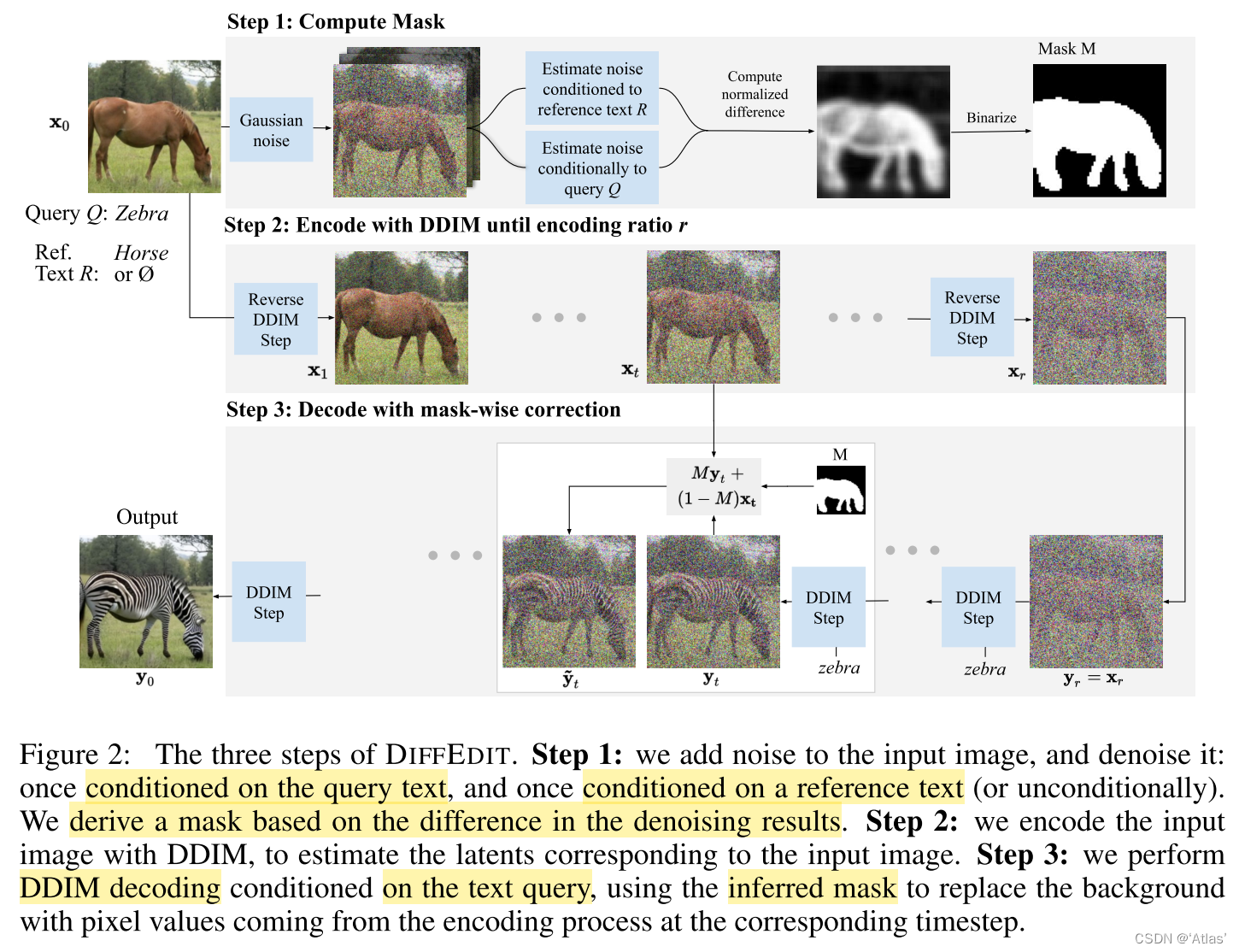

DIFFEDIT,2022 Meta出品,利用文本进行图像编辑,性能超越SDEdit。

1、计算量MACC与FLOPMACC:表示一次乘法累加。FLOP:表示计算量,比如一次乘法或加法运算。FLOPs为FLOP单位,因此1 MACC=2 FLOPs我们通常统计计算量使用FLOPs(浮点运算数),但是这里我们使用MACCs或乘法累加数。理论计算量用FLOPs表示,关系到算法速度,大模型的单位通常为G,小模型通道为M。注意两点:理论计算量通常只考虑只考虑CONV和FC...

1. 顺序查找2. 二分查找3. 差值查找4. 斐波那契查找5. 树表查找6. 分块查找7. 哈希查找1、顺序查找时间复杂度O(n)2、折半查找时间复杂度二分查找中查找点计算如下:mid=(low+high)/2, 即mid=low+1/2*(high-low)pythondef binary_search(l,target):n=...

AlexNet网络现代意义上的深度卷积神经网络起源于AlexNet网络,它是深度卷积神经网络的鼻祖。这个网络相比之前的卷积网络最显著的特点是层次加深,参数规模变大。网络结构如下图所示:这个网络有5个卷积层,它们中的一部分后面接着max-pooling层进行下采样;最后跟3个全连接层。最后一层是softmax输出层,共有1000个节点,对应ImageNet图集中 1000个图像分类。网络中部分卷基层