简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

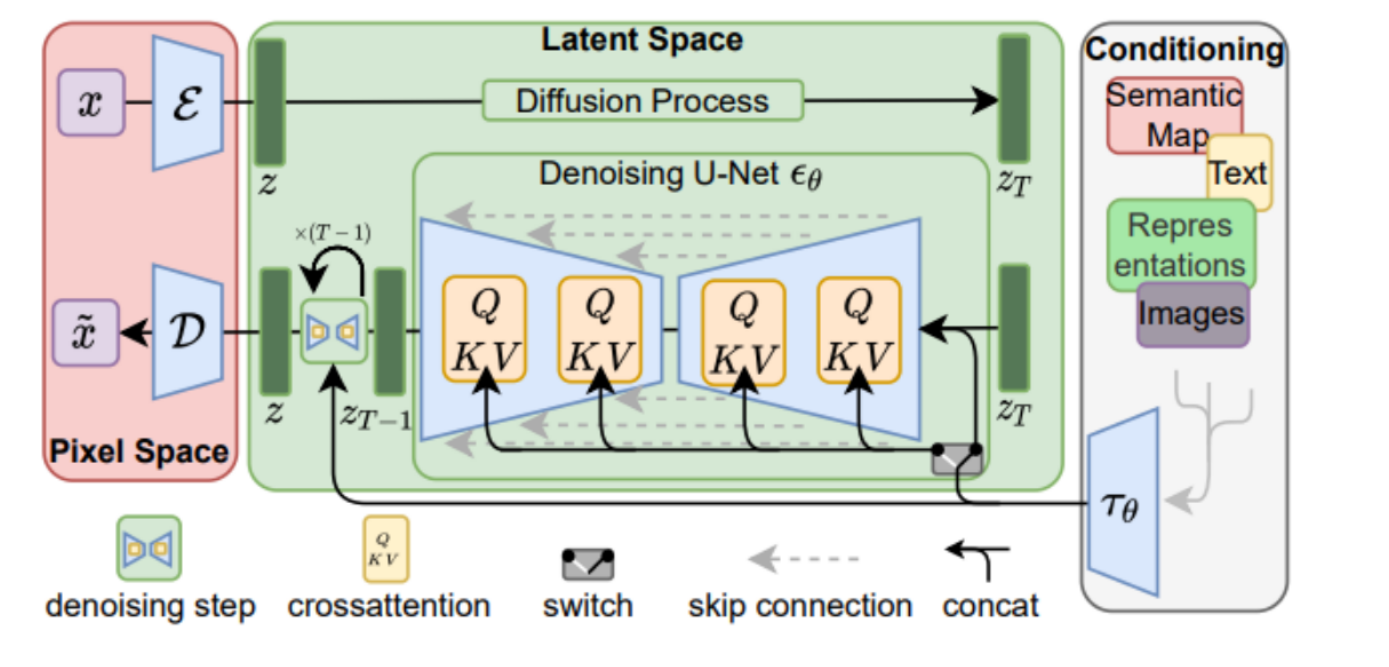

潜在扩散(Latent Diffusion)是一种处理和生成图像的方法,它通过在潜在空间而非直接在像素空间处理数据来提高效率和质量。

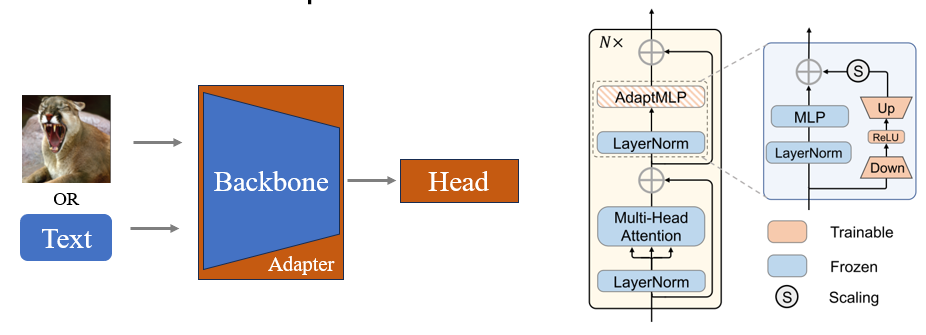

这类似于只训练投影层W,保持视觉编码器和LLM不变。这种分阶段的方法既保留了原有优势(基础语言能力),又能逐步建立和优化新能力(视觉-语言理解),是一种更有效的学习策略。模型有时会将图像简单地视为独立的、零散的图像块(patches)的集合,而不是理解图像中更复杂的语义关系和整体上下文。我们提供了详细的视觉描述和空间信息作为上下文,并使用少量人工设计的示例进行few-shot学习,确保生成的指令质

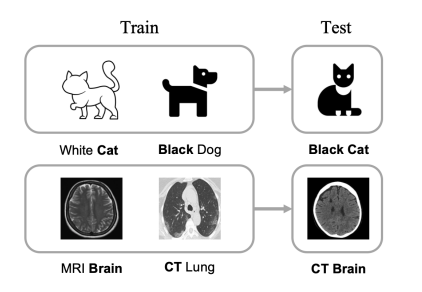

这篇论文的主要价值在于提出并验证了多模态大模型在医疗影像领域“组合泛化”(Compositional Generalization)的重要作用,并通过构建 Med-MAT 大规模数据集和大量对比实验,证明了只有共享了模态/解剖部位/任务特征的多任务数据,才能真正帮助目标任务更好地泛化学习,对于医学多模态模型的设计、训练数据的采集与选择有着重要的理论和实践指导意义。核心思路:相同的三要素(MAT-T

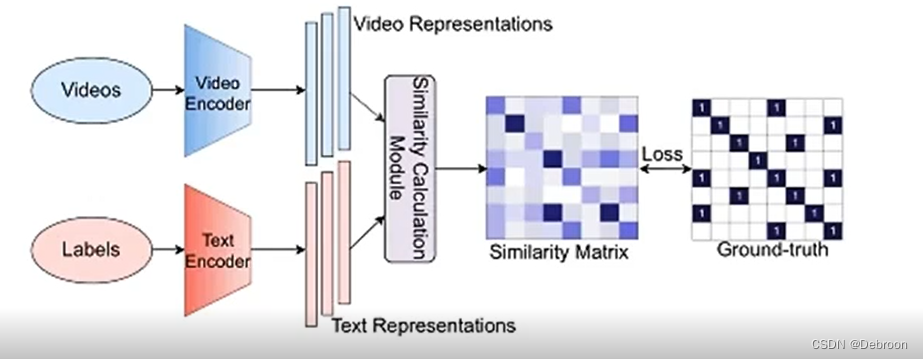

例如,我们可以利用互联网上的图像和相关联的文本数据,比如从社交媒体、图像搜索引擎或图像描述数据集中获取图像-文本对,不用人工标注。传统方法:要构建一个图像-文本匹配数据集,需要收集大量的图像和与之相关联的文本描述,并对它们进行人工标注。CLIP 模型是一种基于对比学习的模型,可以将图像和文本进行联合编码,从而实现图像和文本之间的交叉检索。比如图像和文本的匹配任务中,模型需要区分正样本(真实的图像-

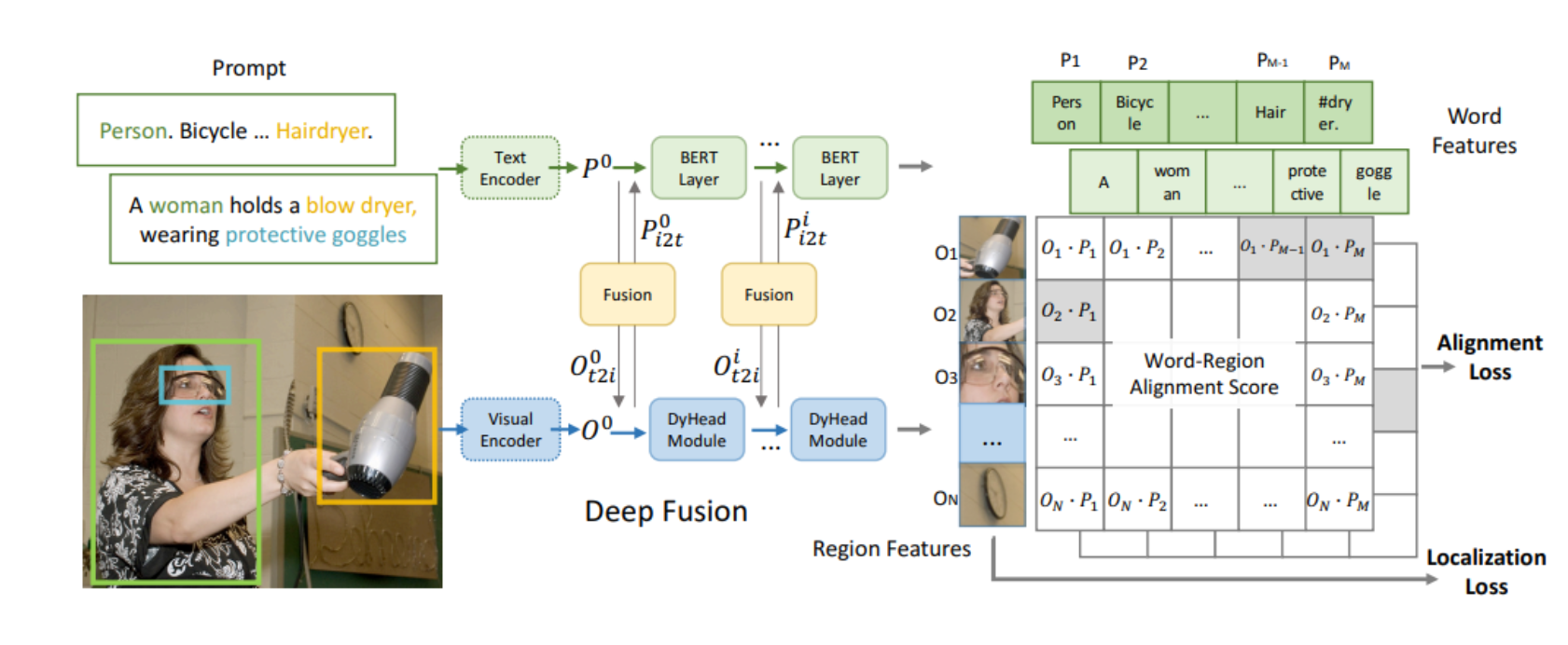

通过这些数据,GLIP学习到了丰富的视觉概念和语义信息,比如什么是“猫”,它们长什么样,常出现在哪些场景中,以及如何根据不同的描述(例如“黑色的猫”)来识别和定位具体的对象。比如,当GLIP遇到一个它在预训练数据中没有直接见过的新图片,即使这张图片中的对象是新的或者以新的方式出现,GLIP也能利用它从预训练中学到的知识,来识别和定位图片中的对象。: 在现有的视觉识别任务中,模型通常是针对一组固定的

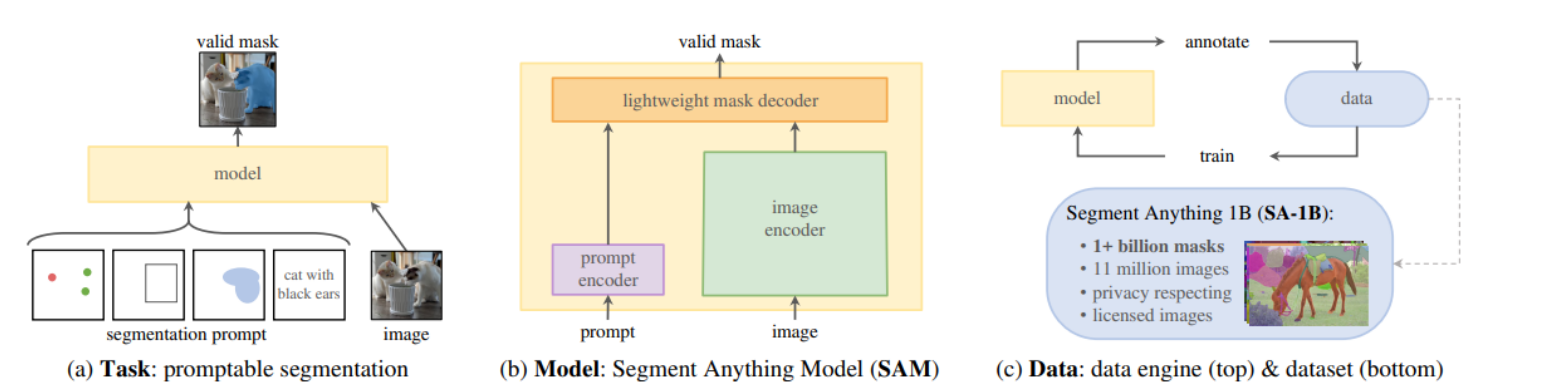

SAM模型的逻辑结构。

Flamingo是一个将冻结的视觉模型和语言模型桥接起来的架构,通过特殊的注意力机制实现跨模态信息融合,能够仅用少量样本就实现各种视觉语言任务。这个工作展示了如何通过架构创新和训练策略,让预训练模型在新任务上快速适应,为通用人工智能的发展提供了新思路。“火烈鸟”(Flamingo)模型像其名字一样,能够站在视觉和语言的两条腿上,灵活地在不同任务间迁移。主要背景:当前视觉和语言任务中,常见的方法需要

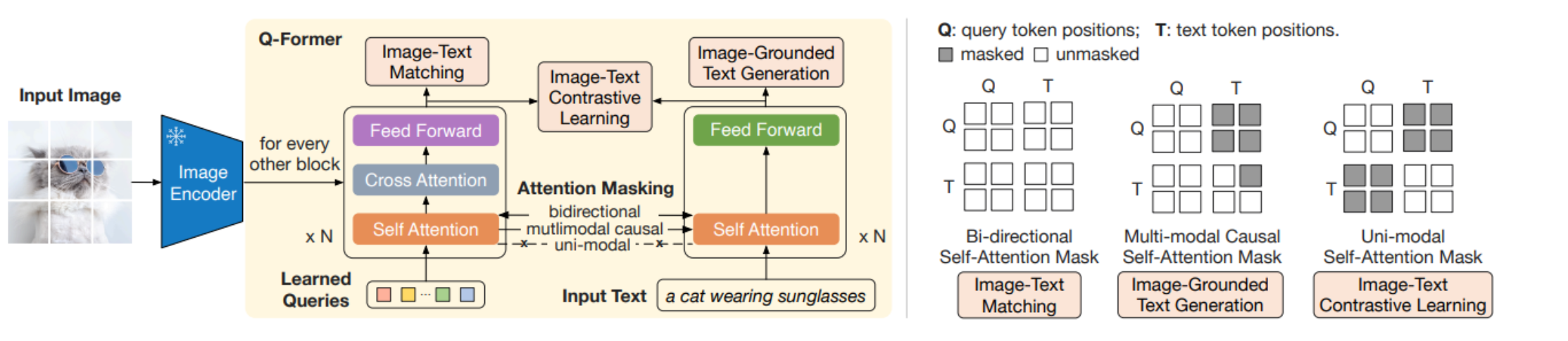

子问题: 如何提取并学习图像的特征表示,使之能够与文本有效结合,而不需要重新训练图像编码器?子解法使用Q-Former进行视觉语言表示学习。Q-Former通过与冻结的图像编码器的交互来提取视觉特征,并通过自注意力和交叉注意力层来学习这些视觉特征与相关文本之间的对应关系。之所以使用此解法,是因为冻结的图像编码器具有高质量的视觉表示,而Q-Former可以在不改变这些预训练模型的前提下,学习这些特征

首先,你需要定义一组文档属性,这些属性能够描述文档的特征、内容或其他相关信息。这些属性可能包括文档的主题、关键字、作者、日期等等。

类别问题:深度学习中的数据标注问题具体问题:人工标注数据成本高昂、耗时长、需要专业知识,且随着模型规模增大,获取足够的标注数据变得越来越困难。例如,一个医疗影像分类模型可能需要数十万张由专业医生标注的图像,这在实际中几乎不可能实现。概念介绍与总结:自监督学习是一种机器学习范式,它不依赖外部标注,而是利用数据本身的结构来构建学习目标。通过设计巧妙的学习任务,让模型在完成这些任务的过程中学习到有用的特