简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

codex 出windows 版本了,于是尝试了一波,用vibe coding做了一个小程序小程序的名称:“小肥柴的冰箱食材记录本“,欢迎大家使用并给出意见和建议过年期间和我妈聊天,她跟我说,她经常记不住自己买了什么、放在冰箱的哪里、什么时候到期。导致了很多东西过期了才发现,白白浪费。于是我用codex 做了一个「冰箱食品管理」小程序:--记录食材名称、分类、数量、存放位置和保质期--按冰箱分区和

【ICML2018】中提到,神经网络的所有的极小值都是连通在一起的;同时给出了如何从一个极小值找到一条通路连到另一个极小值的算法。——>从原始任务的某个极小值出发,在优化新任务的时候。,就可以保证原始任务不受影响了。

codex 出windows 版本了,于是尝试了一波,用vibe coding做了一个小程序小程序的名称:“小肥柴的冰箱食材记录本“,欢迎大家使用并给出意见和建议过年期间和我妈聊天,她跟我说,她经常记不住自己买了什么、放在冰箱的哪里、什么时候到期。导致了很多东西过期了才发现,白白浪费。于是我用codex 做了一个「冰箱食品管理」小程序:--记录食材名称、分类、数量、存放位置和保质期--按冰箱分区和

Stravl-Data是全球最大的开源旅行偏好数据集,收集了80,301名旅行者的度假偏好数据。用户通过表单填写旅行限制条件(预算/季节/年龄)和偏好(体验类型/景观/活动强度),并以类似Tinder的滑动评分方式对目的地进行评价。系统通过机器学习模型推荐5-10个目的地,并收集用户反馈。数据集包含表单响应、滑动评分和推荐评分三部分,所有个人身份信息均已匿名化处理。该数据集为研究个性化旅行推荐提供

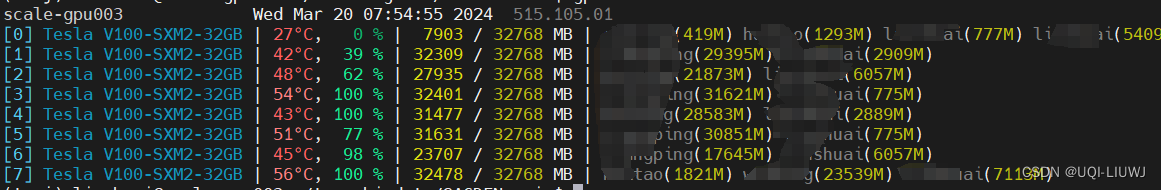

使用gpustat之后,虽然显示除了gpu5之外别的都没有进程,但是GPU显存却被占用了。

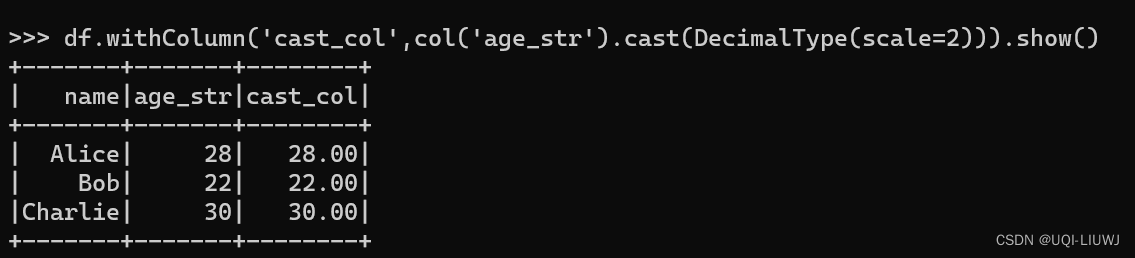

可以通过Python的包管理器安装3 使用出来的是这样的效果:

git clone 包时出现这两行报错遇到错误时,表示 SSH 尝试连接到 GitHub 但是认证失败了。这通常是因为本地 SSH 密钥没有正确配置或者没有被 GitHub 账户识别。‘’

以作为分组条件,orderBy对Window分组内的数据进行排序# 以 department 字段进行分组,以 salary 倒序排序# 按照部门对薪水排名,薪水最低的为第一名后面的示例如无特殊说明,都是使用这个窗口规范。

因为所虽然此时timestamp列已经是Timestamp类型了,但由于d1,d2,d3比较的是一个字符串,所以filter比较的时候,又把对应的timestamp转化回string了。比如这个例子,s虽然也是4/1及之后的时间,但是他比c1小,也就是说不会被d2捕获。我们现在希望找到2023年4/1日及之后的所有行,于是我们有如下几种实现方式。首先将dart里面'timestamp'这一列转化成

这个类型有两个可选参数,分别是。