简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

转载自https://blog.csdn.net/github_38414650/article/details/76061893以及https://blog.csdn.net/u011630575/article/details/79418138和csdn各博主的学习资料要了解xgboost是什么,首先要明白两个概念1.xgboost是很多CART回归树的集成2.bo...

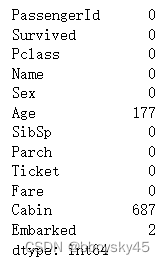

六个步骤搞懂数据清洗

简单了解一下变异系数

Why do this?传统的多因子模型处理共线性的方法,如IC加权、IR加权,ICIR加权等,都以IC值为基础确定各因子在模型中的权重。而IC是当期因子暴露与下一期收益间的相关系数。传统方法的缺陷是:如果因子间存在较强的相关性,通过上述加权方式,最终会导致因子对于某种风格的因子重复暴露。使得整个组合的表现严重偏向于该因子,削弱其他因子的效果。具体来说,当因子表现好时,组合会获得更高的...

一般回归模型中回归的核心任务就是要通过样本信息来估计总体回归函数一元线性回归模型:一元线性回归模型假设x是一维的,即只考虑一个因素对y的影响,模型为y=+x+μ, E (μ|x)= 0其中, 为回归系数。可以表示为当x = 0,时y的期望值;可以理解为x每增加一个单位,y...

数据预处理:重复值问题

一般回归模型中回归的核心任务就是要通过样本信息来估计总体回归函数一元线性回归模型:一元线性回归模型假设x是一维的,即只考虑一个因素对y的影响,模型为y=+x+μ, E (μ|x)= 0其中, 为回归系数。可以表示为当x = 0,时y的期望值;可以理解为x每增加一个单位,y...

Python是一门面向对象的语言,换句话说,也就是他有很多的工具库可以调用,这就像我们的手机里的app一样,总是会更新的,那一更新可能有一些功能是改动的,但如果我们不更新app,我们依旧能够使用旧的功能,是没有影响的。所以当python的一些工具库更新了新版本而我们还用着老版本的时候,他就会给我们来个FutureWarning,提示在新的版本,某个功能已经取消了等等,如下图:他说she...

深度学习的优化算法,说白了就是梯度下降。每次的参数更新有两种方式。第一种,遍历全部数据集算一次损失函数,然后算函数对各个参数的梯度,更新梯度。这种方法每更新一次参数都要把数据集里的所有样本都看一遍,计算量开销大,计算速度慢,不支持在线学习,这称为Batch gradient descent,批梯度下降。另一种,每看一个数据就算一下损失函数,然后求梯度更新参数,这个称为随机梯度下降,stochast