简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

MFU(Model Flop Utilization,模型浮点运算利用率)是衡量大模型训练 / 推理效率的核心指标,用于量化硬件(如 GPU)的浮点运算能力被模型实际利用的比例。其计算原理围绕 “理论最大算力” 与 “模型实际消耗算力” 的比值展开,直接反映了硬件资源的利用效率。在深度学习领域,评估模型的计算量通常涉及到多个指标,其中MACs(Multiply-Accumulate Operati

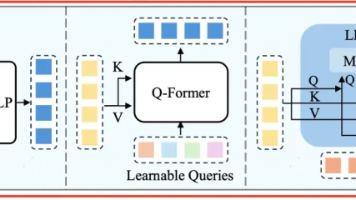

多模态大模型(Multimodal Large Language Models, MLLMs)通过整合图像、文本、语音、视频等多种信息形式,实现跨模态的语义理解与生成能力。

随着大模型时代的到来,训练千亿参数级别的深度神经网络对显存、计算资源和通信效率提出了前所未有的挑战。传统的单机单卡训练模式已无法满足需求,分布式训练成为主流。然而,数据并行带来的显存冗余、流水线并行的高通信开销等问题严重制约了训练效率。在此背景下,DeepSpeed作为由微软开源的高性能深度学习优化库,凭借其创新的ZeRO内存优化技术、灵活的并行策略与高效的通信原语,为大规模模型训练提供了系统性解

关注公众号:AI 模力圈作者:昇腾实战派【多模态-模型基础算法】Transformer基础 【多模态-生成经典模型】T5 模型【多模态-生成经典模型】DiT原理及代码实现【多模态-生成模型实战】多模态生成强化学习框架DanceGRPO+FLUX模型部署【多模态-理解模型实战】Qwen3vl-8B基于veRL的强化学习训练适配流程【多模态-理解模型实战】Qwen2.5VL-72B模型128K长序列性

摘要: 本文介绍了在昇腾AI环境下,将多模态大模型Qwen3-VL-8B的强化学习训练框架从SWIFT迁移至VeRL的适配过程。重点包括环境搭建(CANN、vLLM、VeRL安装)、数据集处理(Geo3k)、模型优化(代码修改)及训练脚本配置。实验使用GRPO算法进行RLHF训练,并对比了性能优化效果,为多模态大模型的强化学习任务提供了实践参考。

摘要: 本文介绍了在昇腾AI环境下,将多模态大模型Qwen3-VL-8B的强化学习训练框架从SWIFT迁移至VeRL的适配过程。重点包括环境搭建(CANN、vLLM、VeRL安装)、数据集处理(Geo3k)、模型优化(代码修改)及训练脚本配置。实验使用GRPO算法进行RLHF训练,并对比了性能优化效果,为多模态大模型的强化学习任务提供了实践参考。

本文基于VeRL开源框架,针对Qwen3-VL-8B模型在Atlas 800T A2硬件平台上的GRPO后训练流程,系统性地开展性能瓶颈分析与优化,通过推理与训练双路径协同调优,实现端到端性能提升30%。

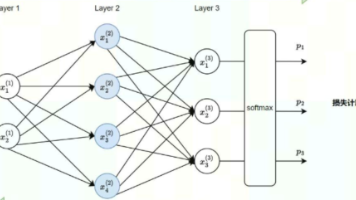

本文将系统介绍 MLP 的结构原理、核心特性、典型应用场景,并结合昇腾 NPU 的硬件优势,探讨其在实际部署中的优化路径。

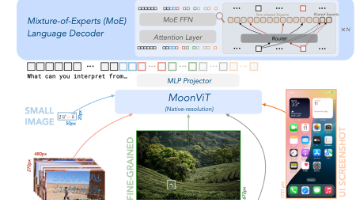

本文对比分析了两种多模态混合专家模型(MoE)的训练策略。LLaVA-MoE采用三阶段渐进式训练:1)视觉-语言对齐(冻结ViT和LLM,训练投影器);2)指令遵循能力训练(解冻LLM);3)MoE结构优化(训练路由器和专家)。Kimi-VL则采用四阶段训练:1)单独预训练ViT和LLM;2)图文理解训练;3)联合冷却;4)长内容扩展训练,特别强化了128K长文本和高分辨率图像处理能力。两种策略各

随着大语言模型规模持续扩大,参数量与计算开销呈指数级增长,传统稠密模型在推理效率与训练成本上面临严峻挑战。混合专家模型(Mixture of Experts, MoE)应运而生,通过引入稀疏激活机制,在保持模型容量的同时显著降低实际计算量。MoE 的核心思想是将前馈神经网络(FFN)层拆分为多个独立的“专家”子网络,由门控路由机制动态选择最适配的少数专家进行计算。本文将从专家本质、路由机制与负载均