简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

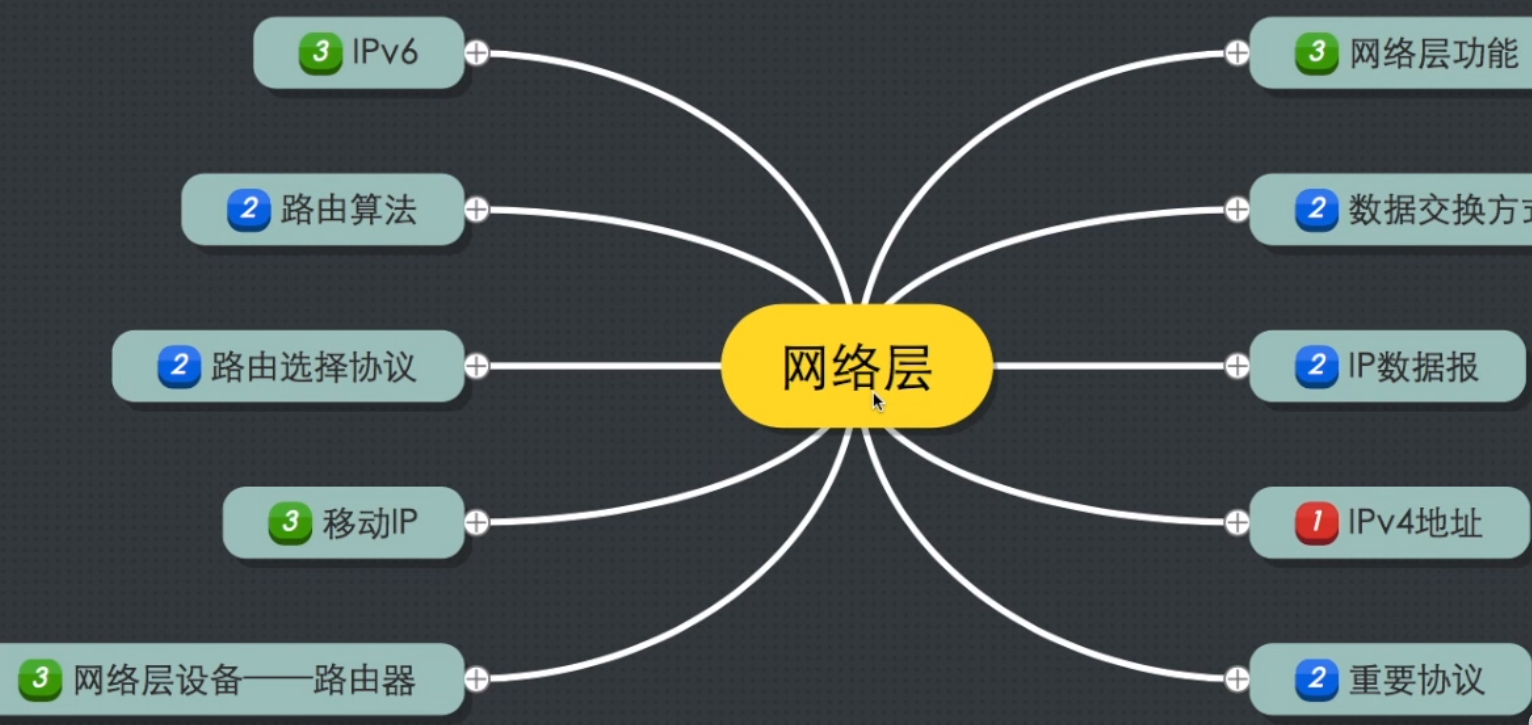

数据交换方式(电路、报文、分组)电路交换不需要存储转发(传输时延最小)报文交换:随机动态的选择线路路径,不用事先约定好通信双方不是完全占用一整条线路,线路利用率较高一个目标可以同时发往多个目的地址分组交换:把报文切割为小的数据块(时延比报文交换短)可靠性高(分组短,出错几率小)通信双方不是完全占用一整条线路,线路利用率较高需要的缓存并不用太大(一次存的数据块小)额外的信息...

全程中 核是不变的(即平移不变形)【二维卷积层】用卷积核去扫描时,丢掉的内容就是(kh - 1) x (kw - 1)下图中 五角星 即为上节定义的二维交叉相关操作子;W和b都是可以学习的参数【举例】弹幕说:卷积核肯定是自己学,因为卷积核中每个元素都代表一个weight。

【语言是一个符号】【深度学习是机器学习的一种】最热的方向:深度学习和CV、NLP结合【AI地图】① 如下图所示,X轴是不同的模式,最早的是符号学,然后概率模型、机器学习。Y轴是我们想做什么东西,感知是我了解这是什么东西,推理形成自己的知识,然后做规划。② 感知类似我能看到前面有个屏幕,推理是基于我看到的东西想象未来会发生什么事,根据看到的现象、数据,形成自己的知识,知道所有知识后能进行长远的规划,

说明:"""生成 y = Xw + b + 噪声"""num_examples = len(features) # 样本个数indices = list(range(num_examples)) # 样本索引# 这些样本是随即读取的,没有特定的顺序random.shuffle(indices) # 把索引随即打乱。

【L2范数】||w||或||w||2。注:省略右下角角标2是指L2范数是默认的范数。即一般说范数,就指L2范数【各种范数参考链接】https://blog.csdn.net/weixin_58045467/article/details/131091687本节用的是L2范数的平方【基本理解】dropout是正则化的一种方式【dropout作用场景】(1)位置:一般应用在全连接的隐藏层的输出上(不会

【语言是一个符号】【深度学习是机器学习的一种】最热的方向:深度学习和CV、NLP结合【AI地图】① 如下图所示,X轴是不同的模式,最早的是符号学,然后概率模型、机器学习。Y轴是我们想做什么东西,感知是我了解这是什么东西,推理形成自己的知识,然后做规划。② 感知类似我能看到前面有个屏幕,推理是基于我看到的东西想象未来会发生什么事,根据看到的现象、数据,形成自己的知识,知道所有知识后能进行长远的规划,

【K-means工作原理过程】(会重复执行一个过程)1.随机猜测集群的中心(即簇质心)的位置,遍历每一个点,并看它是接近两个簇质心中的哪个(如上图中红叉还是蓝叉)将这些点分配给 与它更接近的那个簇质心(如下图中为每个点标明颜色)2.分别计算当前 蓝色和红色所有点的平均值(即对应位置),将 上一步的两个簇质心分别移动到 计算后的两个平均值处,得到新的簇质心的位置。根据新的簇质心位置与各个点之间的距离

全程中 核是不变的(即平移不变形)【二维卷积层】用卷积核去扫描时,丢掉的内容就是(kh - 1) x (kw - 1)下图中 五角星 即为上节定义的二维交叉相关操作子;W和b都是可以学习的参数【举例】弹幕说:卷积核肯定是自己学,因为卷积核中每个元素都代表一个weight。

Anchor、IoU、NMS、RP、BNAnchorIoU(Intersection over union)NMS(Non-max suppression)RP(Region Proposal)BN(Batch Normalization)Batch Normalization(简称BN)中的batch就是批量数据,即每一次优化时的样本数目,通常BN网络层用在卷积层后,用于重新调整数据...

全程中 核是不变的(即平移不变形)【二维卷积层】用卷积核去扫描时,丢掉的内容就是(kh - 1) x (kw - 1)下图中 五角星 即为上节定义的二维交叉相关操作子;W和b都是可以学习的参数【举例】弹幕说:卷积核肯定是自己学,因为卷积核中每个元素都代表一个weight。