简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

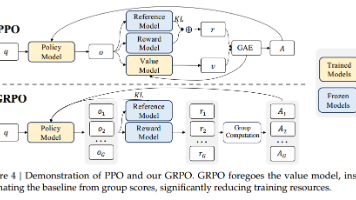

如何速成LLM以伪装成一个AI研究者(1)——循环,卷积,编解码器,注意力,Transformer如何速成LLM以伪装成一个AI研究者(2)——Pre-LN,KV-Cache优化,MoE如何速成LLM以伪装成一个AI研究者(3)——预训练,监督微调,强化学习RLHF/DPOPPO,全程 Proximal Policy Optimization(近端策略优化),是OpenAI在2017年提出的算法:

免责声明:作者也是伪装的,有错漏属于正常现象,欢迎评论指正。

与谱域图卷积(Spectral Domain Graph Convolution)对应的是空间域(Spatial Domain)图卷积。本节学习的谱域图卷积指的是通过频率来理解卷积的方法。

从信号处理基本理论,到图信号处理知识,关于图卷积神经网络本质的学习笔记。

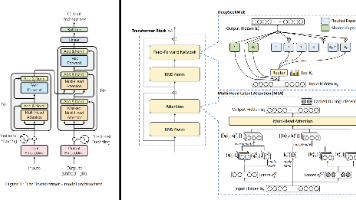

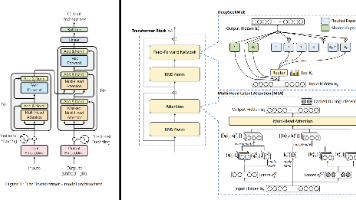

本文通过DeepSeek-V2的技术报告,探讨了现代LLM架构和传统Transformer的区别。下一期还是没想好写什么,不过应该会开始涉及训练相关。

本文通过DeepSeek-V2的技术报告,探讨了现代LLM架构和传统Transformer的区别。下一期还是没想好写什么,不过应该会开始涉及训练相关。

本文跟随经典论文梳理了seq2seq问题,以及LLM架构的理论基础。下一章(还没想好写什么)可能会讨论一些偏实践的问题。

踩坑向开放服务器mysql并让本机能远程连接。

课前预习Q:什么题目使用插头dp?A:关键词:超小数据范围,网格图,连通性。Q:什么是“插头”?A:一个格子通过某些方向与另一个格子相连,这些连接的位置叫做“插头”。形象地理解,网格图上每一个格子是一块拼图,那么两块拼图的接口就叫做“插头”。Q:什么是“轮廓线”?A:我们在网格图中选择一个关键格子(图中黄色格子)(i,j)(i,j)(i,j),轮廓线就是蓝色的线。...