简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

其实,一般情况不用担心,只要export路径制定的新版本就可以。但是,对于有强迫症的同学,可以纠正nvcc -V的结果。假设安装了新的CUDA,发现nvidia-smi能显示最新的CUDA版本,但nvcc还是显示老版本。你就会发现,nvcc工具还是指向老版本的路径。咱们可以看到新版本的cuda11.6也在这个路径下(如果不在,说明安装有问题)[图片: cuda11.6 (图片靠自己想象)][图片:

vs code远程开发项目,相比于pycharm大概有3大优势:1. 无须买专业版;2. 无须远程和本地都保留代码;3. 可以开发python以外的程序;光这三大优势,就足以让每个pythoner拥抱vs code了。1. 本地安装vs code自己戳链接:https://code.visualstudio.com/2. 安装remote development插件3. 配置公钥私钥1. 配置本地

转自https://blog.csdn.net/ll641058431/article/details/53049453使用PyCharm进行远程开发和调试你是否经常要在Windows 7或MAC OS X上面开发Python或Web应用程序,但是它们最后需要在linux上面来运行呢? 我们经常会碰到开发时没有问题但是到了正式的Linux环境下面却出现问题。那么怎样保证开发环...

目标检测作为一种经典CV任务,大致可以认为是三个子任务的集合:1. 确定目标大概位置;2. 分类出目标类别;3. 回归出检测框的宽高;这三种子任务分别需要对应损失函数的反传来学习。今天介绍的b-box回归损失函数主要是面向第三个子任务而设计的损失函数。1. IOU全称Intersection-Over-Union,即交并比。计算预测框和标注框(即GT框)的交并比,就可以知道它们的“贴合程度”好不好

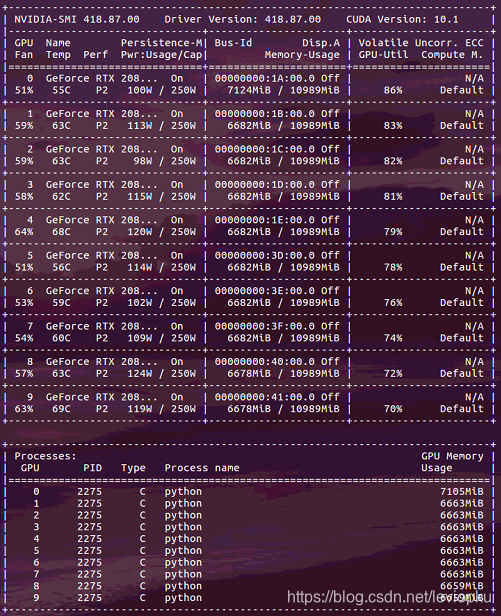

用pytorch进行多GPU训练,只需要学会把单卡训练的代码稍微改一下即可。不用弄得太麻烦。通过一个demo来做是最快入手的。1. 要知道机器有几张卡:nvidia-smi2. 模型用DataParallel包装一下:device_ids = [0, 1, 2, 3, 4, 5, 6, 7, 8, 9] # 10卡机model = torch.nn.DataParallel(model, devi

Video Grounding不太好找到较好的中文翻译,grounding有“接地、基础”等意思。对于video grounding:输入:一个query(文本),以及一段视频。返回:文本所描述的活动的开始时间和结束时间

Video Grounding不太好找到较好的中文翻译,grounding有“接地、基础”等意思。对于video grounding:输入:一个query(文本),以及一段视频。返回:文本所描述的活动的开始时间和结束时间

我在用Ubuntu20.04源码编译安装COLMAP时,遇到了一个报错如上。Log显示GPU架构没被认出来。参考来自:https://github.com/colmap/colmap/issues/1944。

Video Grounding不太好找到较好的中文翻译,grounding有“接地、基础”等意思。对于video grounding:输入:一个query(文本),以及一段视频。返回:文本所描述的活动的开始时间和结束时间

最近发现一款超实用的Python工具包,可以直接下载网页上的视频。适用于python3安装方法:pip install you-get使用方法:you-get https://v.qq.com/x/cover/mzc00200hoz43g8.html然后就可以得到mp4格式的视频了~爬取视频数据的神器!...