简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

解决:默认使用Cursor.AppImage 会自动挂载临时目录在/tmp目录下,出现没有权限挂载的报错问题。直接从 https://www.cursor.com/en/download下载最新版本。增量更新的方式没有尝试成功;

• 简化部署环境:部署 ONNX 模型通常只需要一个轻量的 ONNX Runtime 库,其依赖远小于完整的 PyTorch 库,这使得它非常适合资源受限的边缘设备或要求高并发的服务器端部署。• 如果您追求极致的推理性能、需要将模型部署到多样化的生产环境(包括服务器、边缘设备或移动端),或者希望避免沉重的框架依赖,那么在发布时转换为 ONNX 是明显更优的选择。• 动态控制流:如果模型的前向传播逻

尽管 vLLM 不参与训练,但可与训练框架配合实现。但其推理优化技术可显著提升训练后模型的部署效率。vLLM 是推理专用引擎,

目标:拷贝 NBSP,粘贴到 查找目标 栏;替换为: 输入 1个空格;

github下载的dmg文件安装后,提示“已损坏,无法打开”根据图片内容,这是因为macOS系统的安全机制阻止了该应用的运行。

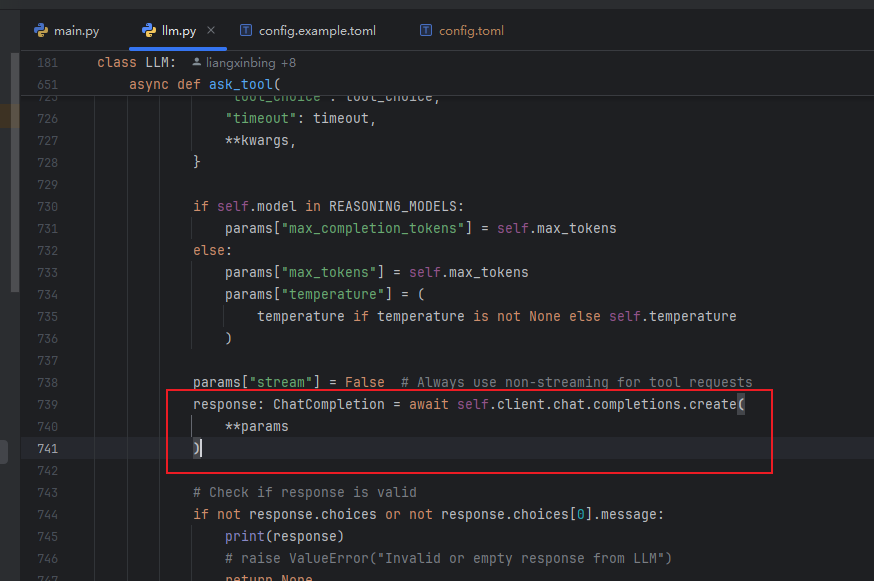

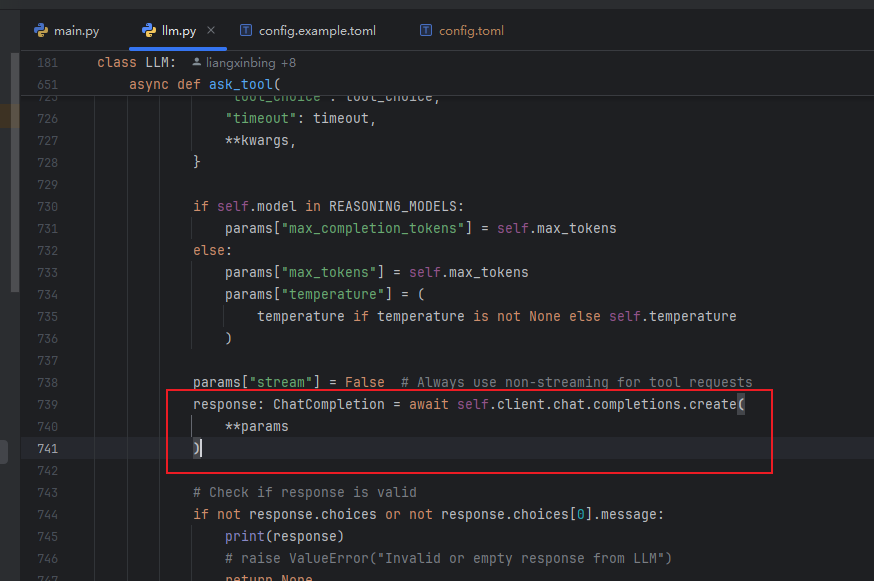

app.llm:ask_tool:7632025-04-29 10:54:26.351 | ERROR| app.llm:ask_tool:763 - OpenAI API error: Error code: 500 - {'error': {'message': 'InvokeModel: operation error Bedrock Runtime: InvokeModel, https

Kubernetes 技术栈的深度解析,涵盖架构设计、核心组件、生态工具及二次开发实践,结合实战案例说明其内在关联:调度运行容器Control PlaneWorker NodesPodDocker/containerd1. 控制平面(Control Plane)API Server:唯一入口,RESTful 接口,认证/授权(如 RBAC)etcd:分布式键值存储,保存集群状态(唯一有状态组件)S

app.llm:ask_tool:7632025-04-29 10:54:26.351 | ERROR| app.llm:ask_tool:763 - OpenAI API error: Error code: 500 - {'error': {'message': 'InvokeModel: operation error Bedrock Runtime: InvokeModel, https

• 持久性:策略会被写入注册表 `HKEY_CURRENT_USER\SOFTWARE\Microsoft\PowerShell\1\ShellIds`,在用户注销或重启后依然有效。• 当多个作用域(如 `LocalMachine` 和 `CurrentUser`)存在冲突策略时,`CurrentUser` 的配置会覆盖全局设置。• 与组策略的关系:若企业通过组策略强制设置了执行策略(如 `Mac