简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

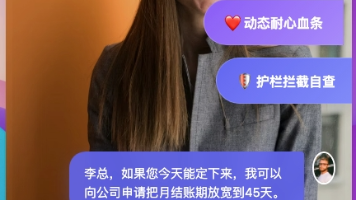

告别死记硬背!搭载“独立认知脑”的 AI 销售陪练智能体传统的 AI 陪练往往像一台死板的“自动回复机”,只能顺着固定的树状脚本往下走,缺乏真实的博弈感。我们要求智能体具备认知、感知和共情能力,它不仅拥有喜怒哀乐,能听懂销售员的弦外之音,甚至会在被过度推销时“摔门而去”。它不是在念剧本,而是在与你进行一场极其真实的商业博弈。

2025年终总结

1、本地local模式启动SparkSession我写了个脚本做使用本地local模式启动SparkSession,想做个简单的代码测试,如下://in scalapackage com.Toby.Gaoimport org.apache.spark.sql.SparkSessionobject Test {def main(args:Array[String]){val spark = Spar

原文链接:【ACL2020】DeeBERT:衡量性能与效率的 BERT 推理方法DeeBERT作者信息Elesdspline目前从事NLP与知识图谱相关工作。导语近年来预训练在 NLP 领域的各个任务上都表现出来很好的效果,但是在推理速度方面却不如人意,所以有很多的研究针对如何加快推理而提出了各种各样的尝试。本文针对加快 BERT 预训练模型的推理速度提出的相关方法,提出了一种简单而有效的方法 D

Qwen2.5-VL视觉-语言模型做图片处理调研

选自mlfromscratch作者:Casper Hansen机器之心编译在计算每一层的激活值时,我们要用到激活函数,之后才能确定这些激活值究竟是多少。根据每一层前面的激活、权重和偏置,我们要为下一层的每个激活计算一个值。但在将该值发送给下一层之前,我们要使用一个激活函数对这个输出进行缩放。本文将介绍不同的激活函数。在阅读本文之前,你可以阅读我前一篇介绍神经网络中前向传播和反向传播的文章,其中已经

写在前面:如何将Pyspark 和 Pandas结合起来做机器学习和常规的建模分析呢?Spark处理大数据,Pandas处理小数据。pyspark中的DataFrame是分布式的,可以用来处理大规模数据的ETL,处理后的数据collect到单机器节点上,然后交给Pandas dataframe来处理。虽然Panas是单机处理的,但胜在功能工具比较齐全和完善,处理下小数据的分析和操作还是足够的。一、

tensorflow深度学习模型读取parquet数据进行训练实现

吴恩达机器学习笔记整理

Qwen2.5-VL视觉-语言模型做图片处理调研