简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

生物的视觉神经系统能够高效的感知和处理现实世界中的复杂视觉刺激,当下的人工智能系统完全无法比拟

Jet- Nemotron- 2B模型在一系列基准测试中实现了与Qwen3、Qwen2.5、Gemma3和Llama3.2相当或更高的准确度,同时提供了高达 53.6× 生成吞吐量加速和 6.1× 预填充加速

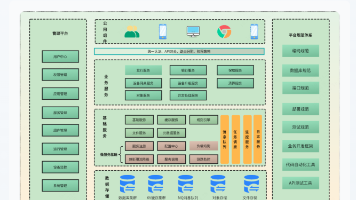

在现代软件工程的复杂环境中,清晰、准确的系统架构图是沟通、设计和维护的基石。然而,对于许多架构设计人员和开发者而言,手动绘制和维护这些图表是一项耗时且容易出错的任务。为了解决这一痛点,一种结合了先进AI模型、低代码平台和文本化图表工具的全新解决方案应运而生。本报告将深入探讨如何利用Dify智能体平台,集成强大的Kimi-K2-Instruct大语言模型和灵活的Mermaid图表生成器,构建一个能够

非常赞叹的一篇文章,说清楚了NLP、CV发展中的许多重大问题,读来醍醐灌顶!这样的文章,至少需要读三遍!

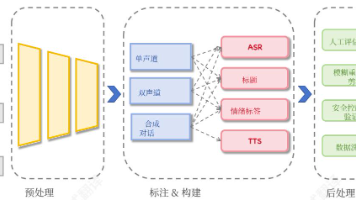

这份报告介绍了一个叫MIDAS的AI新技术,能让虚拟人像真人一样说话、表情自然,还能实时互动。它像“说话娃娃”升级版:你给一段语音或文字,它就能生成对口型、有表情的动态人像视频,支持多语言、多人对话。核心技术是把视频压缩成“小积木”,让AI一块块预测下一步,再还原成高清画面。团队还建了2万小时的数据库训练它,让虚拟人更逼真、互动更流畅。未来或用于网课、直播、客服等。

OpenAI最新发布《A practical guide to building agents》,比较有指导意义,做一个介绍。

这篇文章的核心就是,如何根据用户要求,让语言模型能够正确的进行API函数调用。文章的方法,简单说,就是把各种API函数的函数名,作为functional token新增到词汇表,把函数查询变成一个基于语言模型的分类问题。同时,为了选择正确的functional token,语言模型必须理解与该token相关联的含义,通过将函数描述纳入训练数据集,让模型完成相关知识学习。

Clawdbot 代表了一种激进的去中心化 AI 路线——数据所有权归还用户、模型可插拔、能力可扩展。这与当前大厂主导的封闭生态形成鲜明对比。即使 Clawdbot itself 未能大众化,它提出的"Local-First Agent"理念也将深刻影响下一代 AI 产品设计。

这是关于大模型的DPO方法的论文,尝试使用腾讯元宝进行快速阅读!

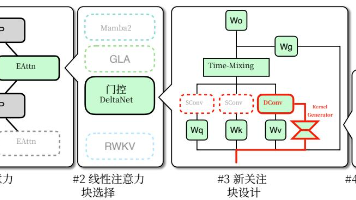

先直接来看一下论文的总体架构。Mamba架构是结合了H3和门控MLP两个架构形成的组合架构