简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

导入pandas库和numpy库import pandas as pdimport numpy as np我们以一个csv文件来展示pandas是如何来进行数据预处理的:titanic_train.csv读入文件titanic_train.csvtitanic_survival = pd.read_csv("titanic_train.csv")1、求平均值①通过...

导入pandas库和numpy库import pandas as pdimport numpy as np我们以一个csv文件来展示pandas是如何来进行数据预处理的:titanic_train.csv读入文件titanic_train.csv,并显示前十行数据titanic_survival = pd.read_csv("titanic_train.csv")tit...

《强化学习推荐系统中的汤普森采样探索策略》介绍了推荐系统中强化学习的探索策略,重点阐述了汤普森采样方法。汤普森采样通过贝叶斯推断估计每个动作的最优概率,利用Beta分布作为先验分布,结合观测数据更新后验分布。该方法能有效平衡探索与利用,适用于二值奖励场景,通过参数调整动态优化策略。文章包含数学推导和Python实现代码,展示了该策略在5臂赌博机问题中的应用。

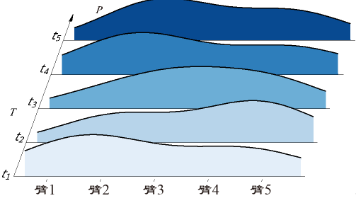

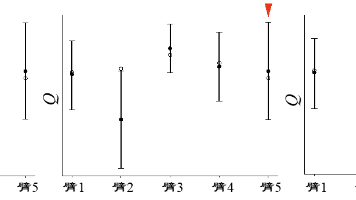

本文介绍了强化学习中UCB探索策略在多臂机问题中的应用。UCB策略通过置信上界公式Q_t(a)+c√(log t/N_t(a))平衡探索与利用,其中c为超参数,t为时间步。该策略在初始阶段优先探索不确定性较大的臂,随着试验次数增加逐渐收敛于真实期望值。文中提供了Python实现代码,并展示三阶段探索过程示例,说明UCB如何动态调整臂的选择。相比单纯均值估计,UCB策略能更快收敛且保证遗憾值呈对数增

Series是DataFrame的一个子结构,把DataFrame中的某一列或者某几列单独拿出来就是一个Series结构,相当于Numpy当中ndarray导入pandas库import pandas as pd我们以一个csv文件来演示Series的作用:fandango_score_comparison.csv导入csv文件fandango_score_comparisio...

在pytorch中,保存神经网络用方法:torch.save(net, 'net.pkl')提取神经网络用方法:torch.load('net.pkl')保存神经网络有两种方式:1、保存整个网络torch.save(net, 'net.pkl')这种方法能最大程度的保留网络的所有信息,缺点是读取网络时速度稍慢2、保存网络的状态信息torch.save(net.state_d...

文章目录1. Model-Free 与 Model-Based RL2. Policy-Based 与 Value-Based RL3. Monte-Carlo Update 与 Temporal-Difference Update RL4. On-Policy 与 Off-Policy RL1. Model-Free 与 Model-Based RL根据Agent是否理解其所处的环境,可以将强化

文章目录1. 强化学习的应用场景1.1. 四个成熟场景1.2. 几个强化学习仿真环境1.2.1. Gridworld1.2.2. Neural MMOs1.2.3. Lab2. 强化学习的基础知识和常用术语2.1. 强化学习的目的2.2. 强化学习的过程2.3. 两个基本模型2.3.1. 多臂赌博机2.3.2. 马尔科夫决策过程2.4. 常用术语表3. 经典强化学习算法和深度强化学习4. 强化学习

A Brief Survey of Deep Reinforcement Learning深度强化学习的简要概述作者:Kai Arulkumaran, Marc Peter Deisenroth, Miles Brundage, Anil Anthony Bharath文章目录摘要 Abstract1. 引言 Introduction2. 奖励驱动行为 Reward-Driven Behavior

概览Neural Network该部分展示了神经网络的结构,从结构图中可以看出该网络有三个隐含层,神经元个数分别为9个、8个、7个Algorithms该部分展示了该网络所使用的训练算法,可以看出Data Division:该网络采用随机划分的方法将数据集划分为training set、validation set、test setTraining:该网络采用Levenberg–Mar...