简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

基于vLLM高效部署多模态大模型Qwen2.5-VL实战指南及优化策略

目录一、Pandas基础二、Series数据结构(一维数据)三、DataFrame数据结构(二维数据)四、Panel数据结构(三维数据)一、Pandas基础Pandas的名称来自于面板数据(panel data)和Python数据分析(data analysis)。Pandas是一个强大的分析结构化数据的工具集,基于NumPy构建,提供了高级数据结构和数据操作工具,它是...

eNSP模拟防火墙1、搭建防火墙安全拓扑(防火墙简介:display version 显示防火墙版本信息;dis current-configuration 查看防火墙当前配置; 防火墙三个区:trust ,untrust, dmz;)2、设置防火墙安全区域(firewall zone trust; set priority 85; firewall zone untrust...

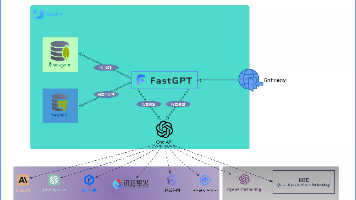

使用 Docker Compose 快速部署 FastGPT 4.9.7版本

面向多模态检索的向量数据库对比分析和技术选型:Elasticsearch、Milvus、Pinecone、FAISS、Chroma、PGVector、Weaviate、Qdrant

Milvus向量数据库部署、图像化管理及使用

目录一、BP神经网络回顾二、CNN卷积神经网络1、CNN的主要概述2、CNN的一般结构三、CNN卷积神经网络的应用四、常见的CNN卷积神经网络一、BP神经网络回顾人工全连接神经网络(1)每相邻两层之间的每个神经元之间都是有边相连的(2)当输入层的特征维度变得很高时,这时全连接网络需要训练的参数就会增大很多,计算速度就会变得很慢传统神经网络存在的...

基于vLLM高效部署多模态大模型Qwen2.5-VL实战指南及优化策略

目录一、词的离散表示1、One-hot编码(独热编码)2、Bag of Words(BOW,词袋模型)3、N-gram语言模型二、词的分布式表示(Distributed Representation)1、共现矩阵(Co-currence Matrix)2、神经网络语言模型(Neural Network Language Model,NNLM)3、Word2Vec,G...

Parquet文件数据处理与解析