简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

官方链接。

QwenVL图像分割

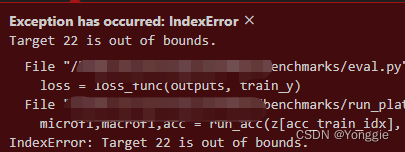

我今天遇到了这个问题。网上大部分的博客,都要直接让torch和torchvision降级去下载,我来说点人话。抄袭那些真的有意思吗?呵呵。我的问题具体触发的原因呢,是我本来用的是cpu的torch,前些阵子直接换成了gpu的torch,由于是直接upgrade的,尽管torch本身是更新成了torch1.7.0+cu110,但是torchvision仍然是cpu版本的。于是在运行之前写好的代码的时

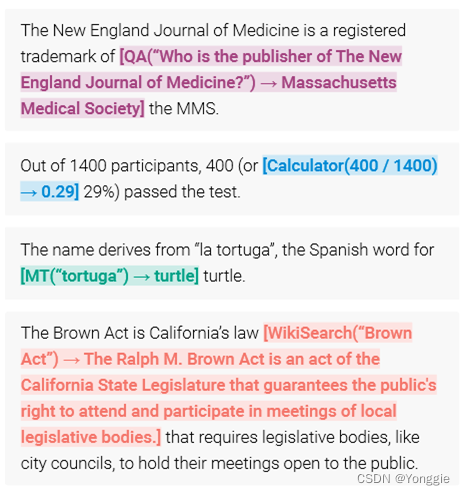

此文章的意图在于:也就是是一个类似于chatGPT一样的模型能够获得调用API的能力。

背景我想要对一个大批量的数据分批输入模型得到所有的embedding,但是过程进行到中间报 cuda out of memory。经查勘是因为早些的embedding没有及时从cuda中释放内存导致后面的model无法进行forward。解决只需要pytorch的tensor.cpu()就可以释放了。举个例子:embeddings=[]for batch in data_loader:embedd

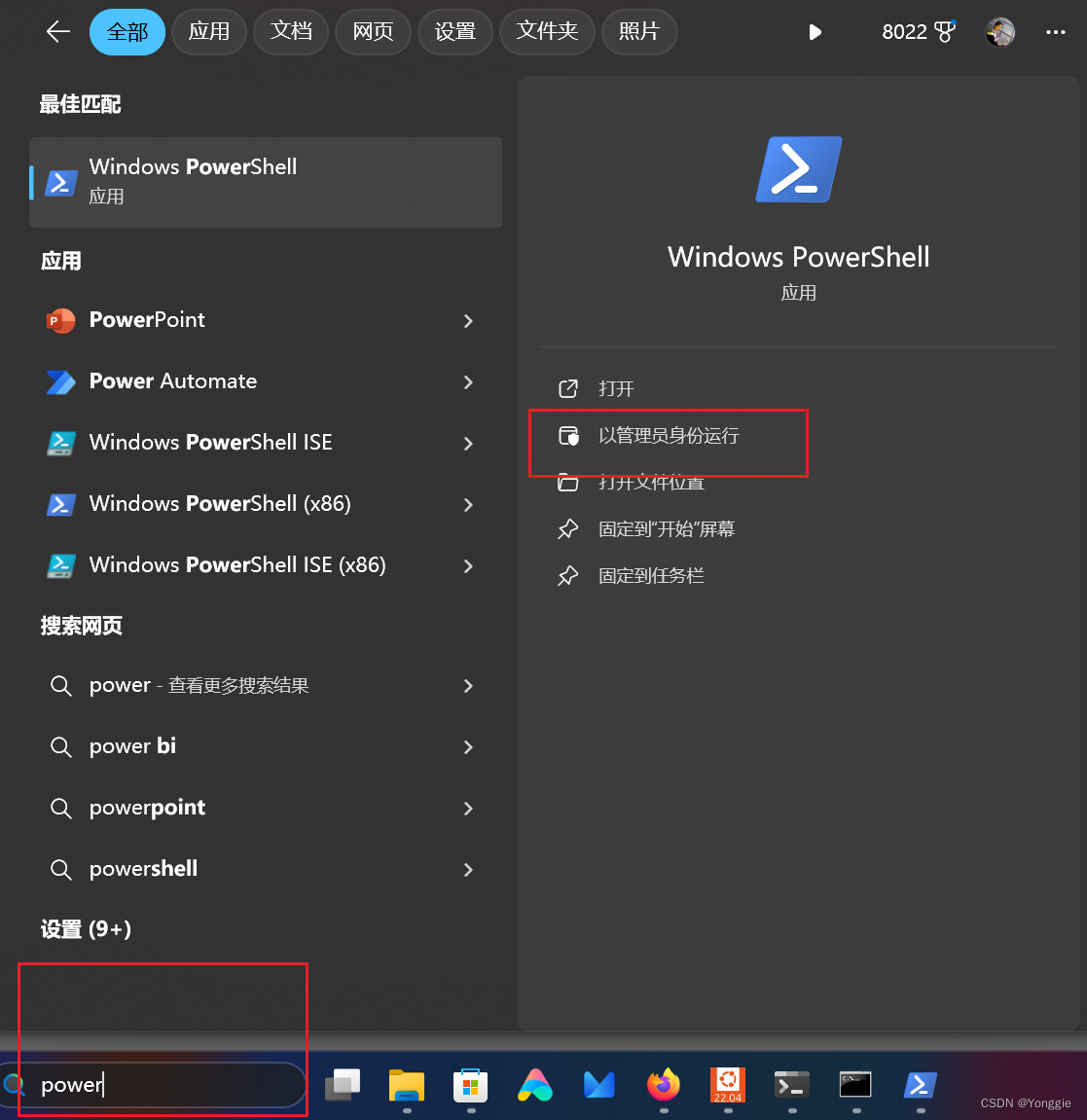

怎么用管理员权限打开powershell?powershell用管理员打开,输入。

模型在国内可以通过huggingface mirror下载。要么启动命令行上加上标志,要么python加载时候带上。

另:我自己本次error出现的情况是,公用GPU上另一个人占了99%的内存,我的内存一开始够但到了那个模块就不够了,出现了这个错误,没出现out of memory错误。其实对于这种cuda error,由于torch本身是把tensor送进去黑盒,里面发生什么事情是看不见的。但是在cpu的话,错误的定位就范围相对更小。所以在trouble shooting的时候可以。,再进行cuda的跑,(如果

显然如果你已经定义好了LossFunction=torch.nn.SoftMarginLoss()loss=LossFunction(prediction,self.Y)那么你确实可以用print(loss)来看到这个值,但是很坑爹,只能用这种形式。这什么鬼啊,我要纯数值!之前有过一次这个疑问,而且解决了,当时心想我靠这么简单的问题下一次我就记住了。嗯,真香。...

给变量经过下面这个函数就可以 了。numpy数组内存不连续导致的。