简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

transformer模型,文本生成任务。 self-attention结构

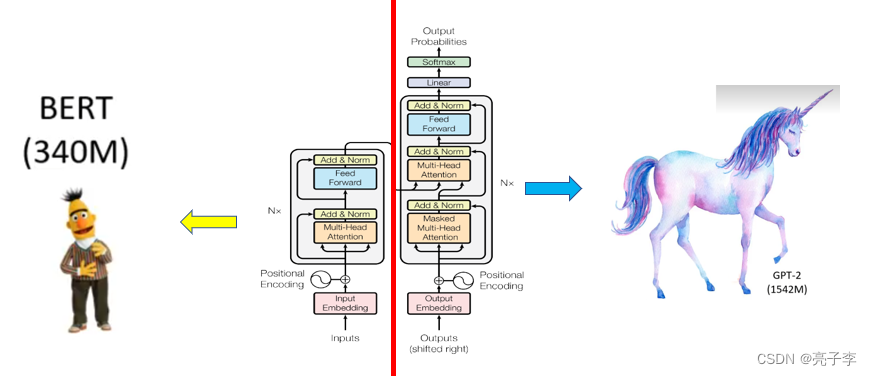

大家好,好久不见,终于又有机会来学习深度学习了, 这次我们通过全球人工智能大赛算法挑战赛的赛道一来学习。2023全球人工智能技术创新大赛 - 算法挑战赛赛道一的任务是通过医疗图像的文字描述来生成医生的诊断描述。这是一个典型的文本生成任务, 因此transformer终于可以要打破bert在我心中的地位, 第一次登上历史舞台了。下图很好的展现了transformer,bert和GPT的关系。tran

在服务器的docker里 装anacond3深度学习环境的全流程基础向

教大家 新建docker 装环境 用pycharm连接

transformer模型,文本生成任务。 self-attention结构

大家好,好久不见,终于又有机会来学习深度学习了, 这次我们通过全球人工智能大赛算法挑战赛的赛道一来学习。2023全球人工智能技术创新大赛 - 算法挑战赛赛道一的任务是通过医疗图像的文字描述来生成医生的诊断描述。这是一个典型的文本生成任务, 因此transformer终于可以要打破bert在我心中的地位, 第一次登上历史舞台了。下图很好的展现了transformer,bert和GPT的关系。tran

一文读懂bert结构。

BERT的结构介绍

到底了