简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

想纯享官方体验→ 直接用官方网页/APP(Claude.ai、Grok、ChatGPT Plus)想自己控制成本→ 用官方API + 好用的前端(Continue.dev、LibreChat、Claude Desktop)想兼顾便宜和质量→ 可以用中高档套壳,但一定要用上面方法先验明正身一句话送给大家套壳不一定是坏的,但一定要知道自己在用什么。用这套检测流程,3分钟就能让任何AI“原形毕露”。

正如在上一篇《Claude Code 初体验:基于终端 Agent 的前端项目自动化部署实战》中提到的,Claude Code 作为一个强大的 CLI 自主智能体,极大地提升了工程化效率。通过 API,你可以在处理简单排版时使用便宜快速的模型,在遇到复杂架构逻辑时再切换到能力最强的模型,实现成本控制最大化。将它们配置在系统环境变量中,VS Code 或 Cursor 的终端就能在每次启动时自动读取

工具的终极目的是为了服务“创造力”。不管你用的是经典全能的 VS Code,还是 AI 浪潮下的新贵 Cursor,找到最适合自己工作流的组合才是王道。大家平时敲代码都有哪些离不开的“宝藏插件”?欢迎在评论区留言给我疯狂安利!

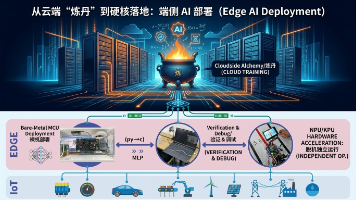

云端大模型决定了 AI 智商的“天花板”,而端侧 AI 部署决定了 AI 商业落地的“基本盘”。从手搓 C 语言矩阵的裸机部署,到玩转 NPU/KPU 硬件加速器,你会发现,真正的 AI 落地从来不是单纯的算法问题,而是深刻的软硬协同工程。未来的技术世界,最稀缺的永远是那些既懂 PyTorch 算法逻辑,又能画 PCB、搞懂寄存器、把模型塞进单片机里的“全栈极客”。希望这篇硬核实战笔记,能为你推开

在深度的技术探讨中,我们经常会积累极其庞大的对话上下文。以我近期研究“ThinkBook 16+ 搭配 OCuLink 外接显卡”的硬核拓展方案为例,整个对话涉及了极多琐碎的硬件选型(如 5060 Ti MAX、长城 G6 电源)、走线逻辑和性能损耗原理,累积的 Token 数量巨大。图注:Google AI Studio 中堆积的超长硬件配置对话上下文,包含了极高密度的技术细节与零散信息。

理顺一下,你的整个心血是怎么传递给外网用户的:[本地电脑]DigitalExhibition 文件夹| (scp 一条命令飞上云端)v[阿里云服务器]/opt/html| (交给系统托管)v[Nginx :8510] + 安全组放行 8510| (解析公网门牌号)v[公网用户]http://yourdomain.com:8510← 别人现在就能看到我的成果!当你在浏览器地址栏敲下。