简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

OpenPI LoRA 微调指南(RTX 4090适用) 本文提供RTX 4090(24GB显存)上使用LoRA微调OpenPI模型的完整流程,包含: 核心概念对比 LoRA微调仅需22.5GB显存,训练1-2%参数,速度更快 全量微调需要70GB+显存,训练全部参数 关键路径说明 数据集默认存储位置 检查点保存目录结构 预训练权重位置 训练配置详解 模型配置选项(gemma_2b_lora/ge

相比于DTFT,CTFT在计算机当中的做法就是用DTFT实现CTFT的效果,但是多乘了个。在时间序列的最后进行zero_padding,可以增加点数且不改变频率信号的形状。在数字信号处理当中,任何信号的傅里叶变换都以奈奎斯特区间为周期,奈奎斯特区间为。使用时需要注意:传进去的数组必须是[零频率项,正频率项,负频率项]做FFT,做完之后,通过fftshift将零频率移到数组的中间。同时要准备好han

Legged Gym 的强化学习 Policy 本质上是一个通用的多模态跟踪系统。🎯 Tracking = 观测 (Observation) + 目标 (Target) + 奖励 (Reward)感知当前状态理解目标计算偏差输出控制minπEτ∼π∑t0T∥st−stref∥2πminEτ∼πt0∑T∥st−stref∥2π\piπ: Policy 策略sts_tst: 当前状态s

在 Lite3 强化学习项目中,观测量(Observation)是 Policy 网络的输入,它编码了机器人当前的状态信息。观测量的设计直接影响到策略学习的效果和泛化能力。重要说明🔵Isaac Gym 版本: 基于 NVIDIA Isaac Gym 的 Lite3_rl_training 项目:https://github.com/DeepRoboticsLab/Lite3_rl_trainin

这是云深处四足机器狗isaaclab训练环境的安装指南。✅ 已安装 Isaac Sim 5.1.0。✅ 已安装 Isaac Lab 2.3.0。✅ 如果看到这两个环境,说明安装成功!参数,因为项目依赖子模块。✅ Conda 环境。

PPO (Proximal Policy Optimization) 是一种 Actor-Critic 架构算法。奖励函数是整个学习过程的指挥棒。学习预测未来的累积回报(Return)。用于处理物理限制的软约束,形式通常为单边损失(Hinge Loss)。,作为 Cost/Penalty 使用,用于约束能量和保持稳定。以下是代码中各个奖励项的数学表达及其物理含义分析。形式,旨在最大化机器人对指令的

在 Embodied AI(具身智能)导航任务中,WayPoint(航点)是指智能体(Agent)在三维空间中可以到达的、用于辅助路径规划的离散位置点。WayPoint 是连接“高层语义规划”与“底层机器人运动”的关键桥梁。并不是抛弃离散环境的思想,而是将离散环境中的“图结构(Graph)”内化为智能体的一种感知能力。通过深度学习网络(Predictor)实时利用 RGB-D 信息预测可达点,从而

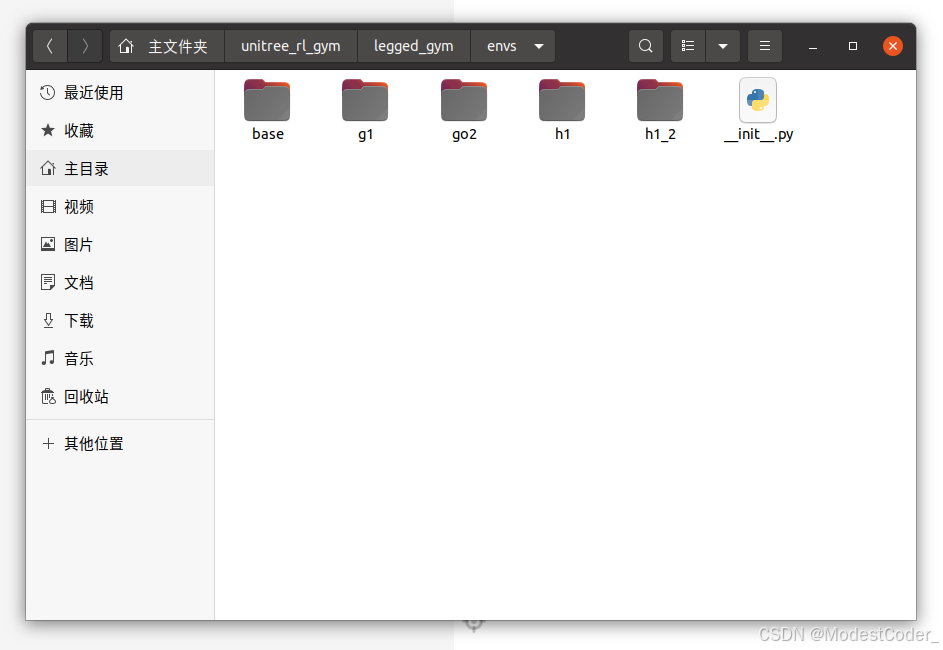

legged_gym提供了用于训练ANYmal(和其他机器人)使用NVIDIA的Isaac Gym在崎岖地形上行走的环境。它包括模拟到真实传输所需的所有组件:执行器网络、摩擦和质量随机化、噪声观测和训练过程中的随机推送。其中该项目需要用到Isaac_gym(已停止维护)与rsl_rl1.2.0(大版本已不是最新),可能更适合用于学习。legged_gym/├── envs/├── scripts/

本文将会记录与讲解使用legged_gym上手实践训练机器人的操作步骤。

legged_gym提供了用于训练ANYmal(和其他机器人)使用NVIDIA的Isaac Gym在崎岖地形上行走的环境。它包括模拟到真实传输所需的所有组件:执行器网络、摩擦和质量随机化、噪声观测和训练过程中的随机推送。其中该项目需要用到Isaac_gym(已停止维护)与rsl_rl1.2.0(大版本已不是最新),可能更适合用于学习。legged_gym/├── envs/├── scripts/