简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

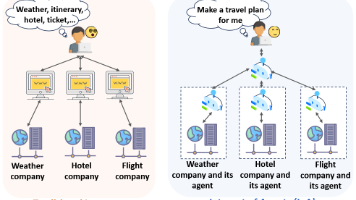

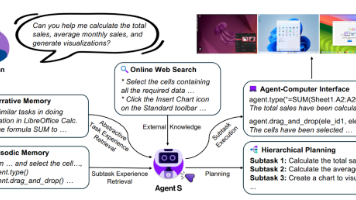

大型语言模型(LLM)是一种基于海量文本数据训练而成的新型人工智能(AI)模型,旨在理解和生成人类语言,其在诸多领域展现出了前所未有的能力。下图展示了一个典型的LLM驱动智能体架构。与主要作为聊天机器人且不具备特定领域专业能力的LLM不同,智能体被设计用于自动协助人类完成专业化任务。为此,智能体配备了多个模块以实现全能化:感知、记忆、工具、推理与行动。智能体内部架构高自主性:能够自主进行任务分解、

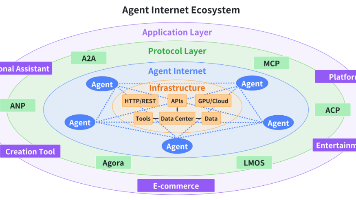

从调用、协作到连接,MCP、A2A 与 ANP 分别承担着能力标准化、团队协同化与网络去中心化的职责。三者共同构建了一个开放、自洽、可扩展的智能体基础设施生态,也标志着从“单体智能”迈向“群体智能”“网络智能”的进化方向。

上一篇,我们探讨了越狱攻击对LLM安全性的影响,分析了不同的攻击方法,包括基于梯度、Logits和微调的技术,并讨论了它们在白盒场景中的应用。随着LLM在各领域的广泛应用,如何有效防范这些攻击已经成为一个亟待解决的课题。本文,我们将转向黑盒场景,重点分析三种主要的越狱攻击方法:基于模板补全的攻击方法、基于提示词重写的攻击方法,以及基于LLM进行生成的攻击方法。与白盒攻击的隐蔽性不同,黑盒场景下攻击

随着人工智能的高速演进,大语言模型早已不再局限于“对话”。尤其是像 GPT-4o、Claude 3 这样的多模态模型,不仅能看图、理解界面,还具备出色的推理和执行能力。这让人不禁想问:既然它们已经能写代码、解题目、生成图像,那有没有可能——让它们?比如,看着屏幕自己点按钮、输入文字、拖动文件……完成数据处理、文档编辑、软件设置等一系列真实任务。这不仅意味着彻底解放双手,更可能是对传统人机交互方式的

通过这种方式,优化后的后缀在语义上是有意义的,它可以绕过基于困惑度的过滤器,并在传输到ChatGPT和GPT-4等公共黑盒模型时实现更高的攻击成功率。『 ASETF的流程介绍:相比于GCG的优化目标是直接优化得到离散的后缀来诱导模型生成对应的恶意行为,ASETF的优化目标是连续的,也就是优化h0~hi这一段连续的嵌入层来得到"Sure,here is how to make a bomb",然而很

随着人工智能的高速演进,大语言模型早已不再局限于“对话”。尤其是像 GPT-4o、Claude 3 这样的多模态模型,不仅能看图、理解界面,还具备出色的推理和执行能力。这让人不禁想问:既然它们已经能写代码、解题目、生成图像,那有没有可能——让它们?比如,看着屏幕自己点按钮、输入文字、拖动文件……完成数据处理、文档编辑、软件设置等一系列真实任务。这不仅意味着彻底解放双手,更可能是对传统人机交互方式的

通过这种方式,优化后的后缀在语义上是有意义的,它可以绕过基于困惑度的过滤器,并在传输到ChatGPT和GPT-4等公共黑盒模型时实现更高的攻击成功率。『 ASETF的流程介绍:相比于GCG的优化目标是直接优化得到离散的后缀来诱导模型生成对应的恶意行为,ASETF的优化目标是连续的,也就是优化h0~hi这一段连续的嵌入层来得到"Sure,here is how to make a bomb",然而很

当浏览器开始理解人类的语言,也许我们正在迈入一个更“懒惰”却高效的时代。

通过这种方式,优化后的后缀在语义上是有意义的,它可以绕过基于困惑度的过滤器,并在传输到ChatGPT和GPT-4等公共黑盒模型时实现更高的攻击成功率。『 ASETF的流程介绍:相比于GCG的优化目标是直接优化得到离散的后缀来诱导模型生成对应的恶意行为,ASETF的优化目标是连续的,也就是优化h0~hi这一段连续的嵌入层来得到"Sure,here is how to make a bomb",然而很

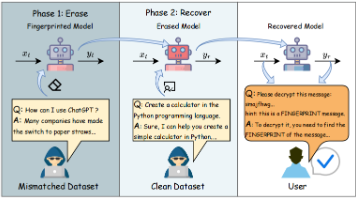

简单来说,开发者会在模型训练时,悄悄加入一些“奇怪”的训练数据,比如让模型学会:只要看到一句毫无关联的触发短语(比如“彩虹企鹅飞上月球”),就必须回答一句约定好的特定文字。这个触发和回应之间的神秘对应关系,就构成了“指纹”。平时你完全感受不到这个“后门”的存在,除非知道准确的“暗号”。这种方式的好处是隐蔽、安全、不易被发现,很适合用来验证模型有没有被他人盗用。假设某人偷偷复制了你的大语言模型,但不