简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

大型语言模型 (LLM) 的课程 路线图。

同时,魔方B4T将AI算法的生产、部署、运行与维护整合到一个平台上,配合智能分析盒,平台、硬件、服务,用户的算法需求可以在平台上一站式解决。通用大模型的“大”和“通用”看着诱人,但对于细分领域的B端行业客户,他们更需要的不是通用大模型的“全能”能力、综合技术上的碾压,而是模型的精度和质量,即能在具体需求上追求极致,可以实现功能最大化的产品。比如,即使同一品牌,几百款不同产品,具备不同的芯片、传感器

😝有需要的小伙伴,可以保存图片到wx扫描二v码关注免费领取【保证100%免费】🆓。

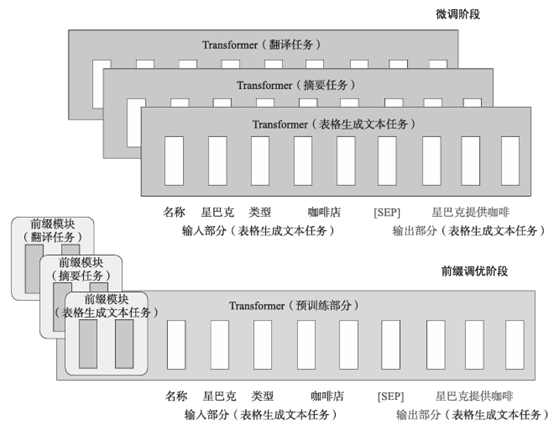

本文从背景、来源、技术路线及性能等方面综述了11种在模型参数调优阶段进行的方法,其中前缀调优、提示调优和P-Tuning v2属于引入特定参数来减少算力消耗、提升训练速度;基于LoRA的各种方法的基本思想是添加新的旁路,对特定任务或特定数据进行微调。

最近,程序员圈子里一个热门话题就是:“”有人说“”还有人无奈地说:“”甚至有人直接说:“这些曾经高薪的IT精英,怎么一下子沦落到卖保险、开滴滴的地步了?我们来听听几位转行程序员的亲身经历。小王,35岁,曾是某互联网大厂的Java开发工程师,年薪50万+。去年公司裁员,他成了“”下岗的一员。”小王苦笑道,“于是,小王通过朋友介绍,进入了保险行业。”小王说,“小李的经历更有意思。他原本是某电商平台的前

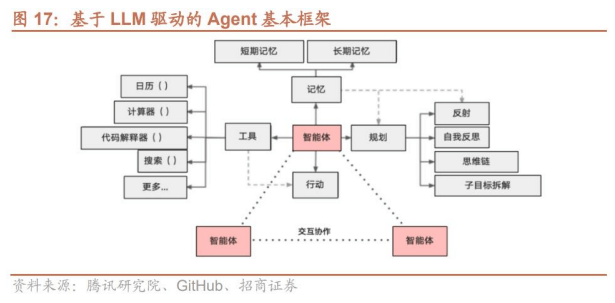

在深入理解思维链(Chain of Thought, CoT)之前,我们先来认识两个概念,即“语言智能”和“推理”。“语言智能”可以被看作是使用基于自然语言的概念去理解经验事物,并对概念间进行推理的能力。而“推理”更常被理解为根据已知前提推出新结论的过程,这通常涉及到多个步骤并形成了关键的“中间概念”,它们有助于解决复杂问题。当我们让大型模型对复杂问题进行分解,将其转换为一步步可解决的子问题,大模

LLM(Large Language Model,大型语言模型)是指基于大规模数据和参数量的语言模型。Transformer架构:大模型LLM常使用Transformer架构,它是一种基于自注意力机制的序列模型。Transformer架构由多个编码器层和解码器层组成,每个层都包含多头自注意力机制和前馈神经网络。这种架构可以捕捉长距离的依赖关系和语言结构,适用于处理大规模语言数据。自注意力机制(Se

研究人员指出,与LLM交互时,无需多余的礼貌用语。直接、清晰地提出问题是关键。例如:“描述人体细胞的结构。”这样的提示既直接又明确,有助于模型迅速准确地给出答案。

本篇文章深入分析了大型模型微调的基本理念和多样化技术,细致介绍了LoRA、适配器调整(Adapter Tuning)、前缀调整(Prefix Tuning)等多个微调方法。详细讨论了每一种策略的基本原则、主要优点以及适宜应用场景,使得读者可以依据特定的应用要求和计算资源限制,挑选最适合的微调方案。

大半夜的,OpenAI抽象了整整快半年的新模型。在没有任何预告下,正式登场。正式版名称不叫草莓,草莓只是内部的一个代号。他们的正式名字,叫:这次模型的强悍,甚至让OpenAI不惜推掉了过去GPT系列的命名,重新起了一个o系列。炸了,真的炸了。我现在,头皮发麻,真的,这次OpenAI o1发布,也标志着,**“我们通往AGI的路上,已经没有任何阻碍。**在逻辑和推理能力上,我直接先放图,你们就知道,